Matematika pada Algoritma AI

- Pengantar Matematika pada Algoritma AI

- Matematika dalam Computer Vision (CV)

- Matematika dalam Computer Vision (CV): Apa Itu Computer Vision?

- Matematika dalam Computer Vision (CV): Memahami Citra sebagai Data Numerik

- Matematika dalam Computer Vision (CV): Analisis Fitur Citra Berbasis Statistik

- Matematika dalam Natural Language Processing (NLP)

- Matematika dalam Natural Language Processing (NLP): Pengenalan

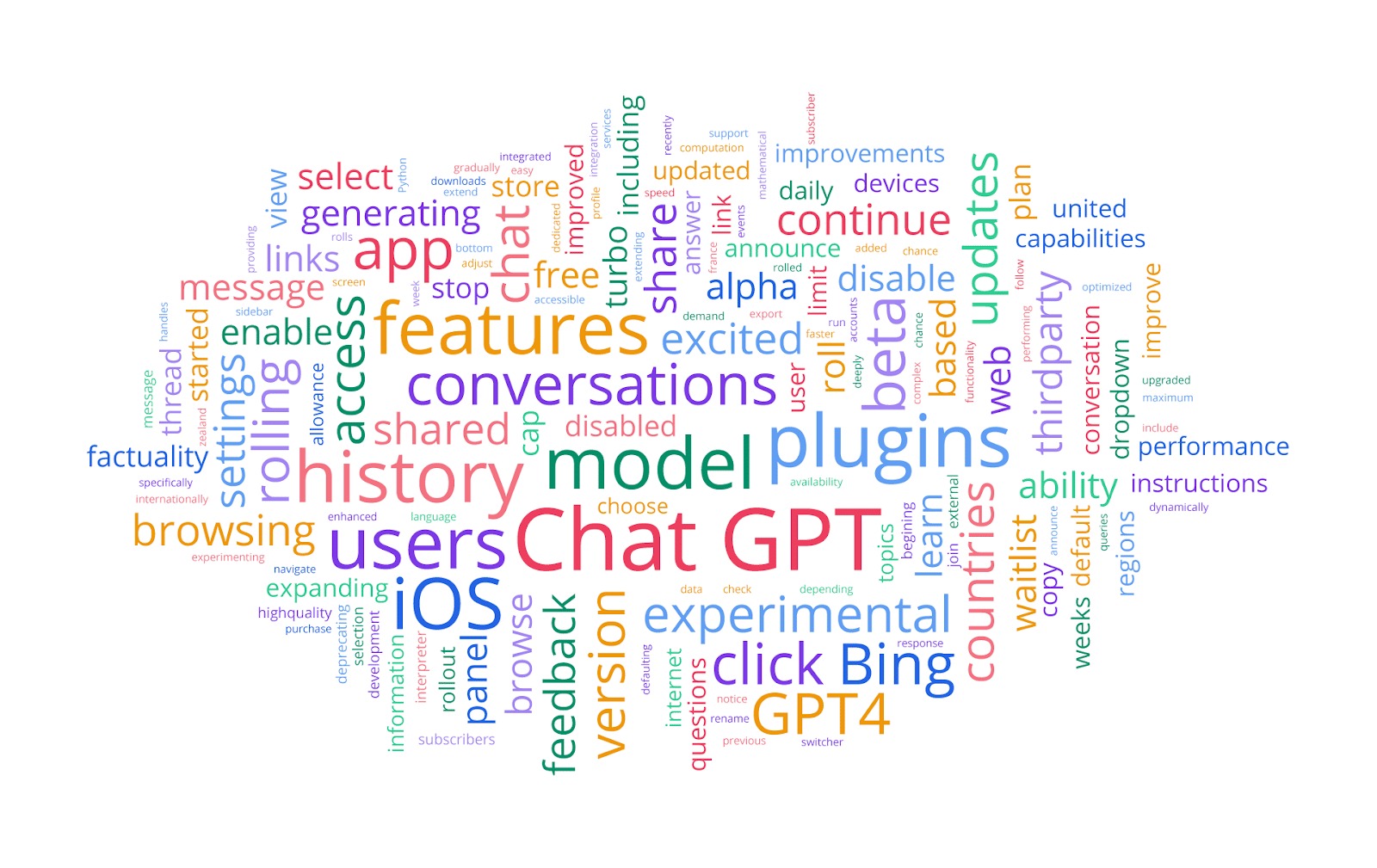

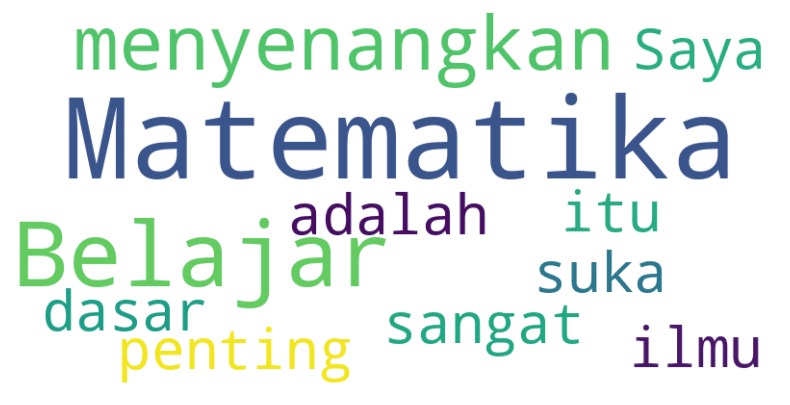

- Matematika dalam Natural Language Processing (NLP): Visualisasi Distribusi Kata dengan WordCloud

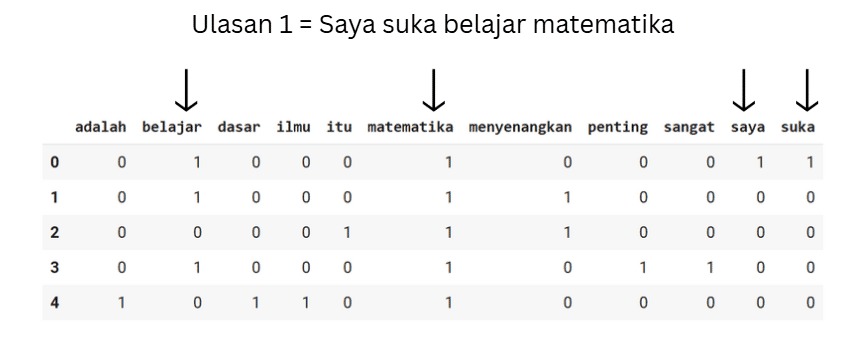

- Matematika dalam Natural Language Processing (NLP): Representasi Frekuensi Kata (Bag-of-Words)

- Matematika dalam Natural Language Processing (NLP): TF-IDF: Memberi Bobot Kata

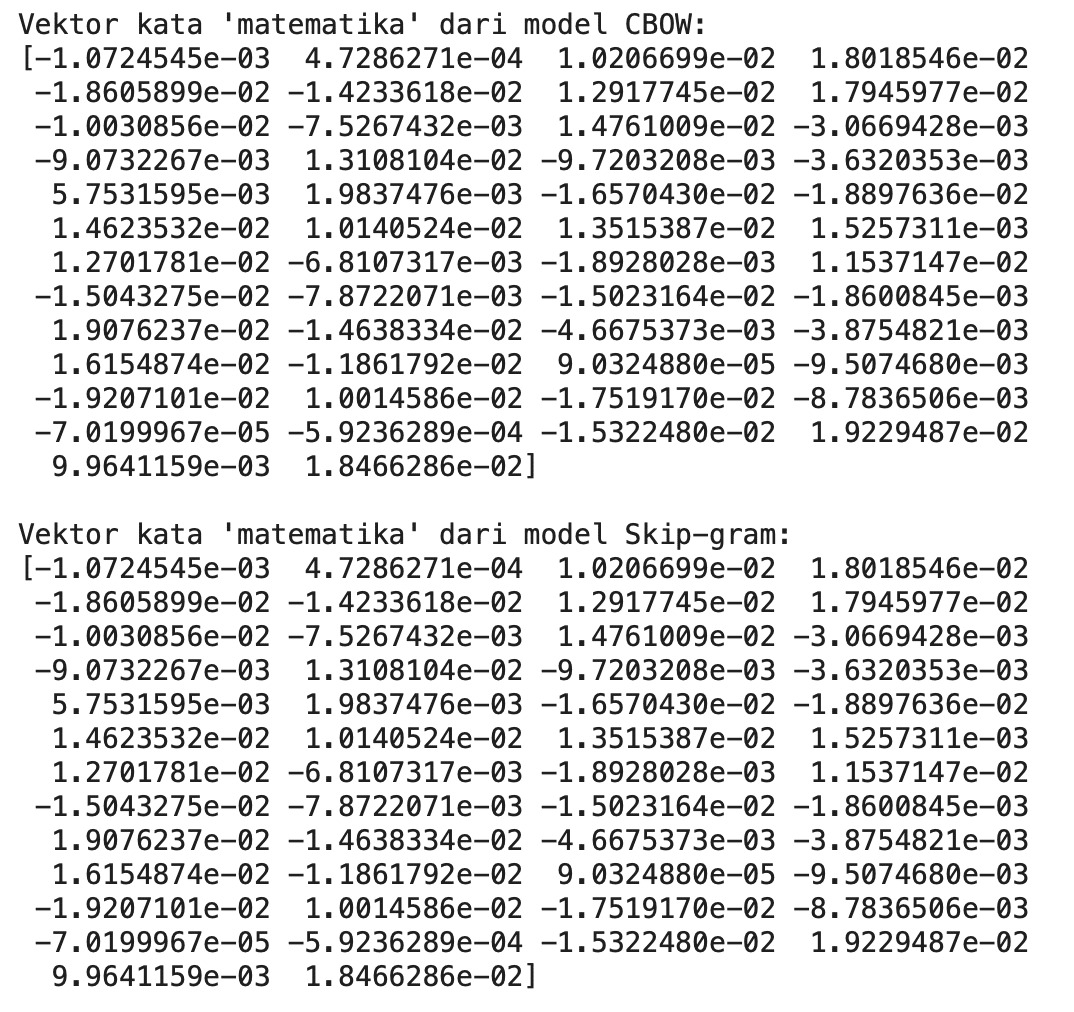

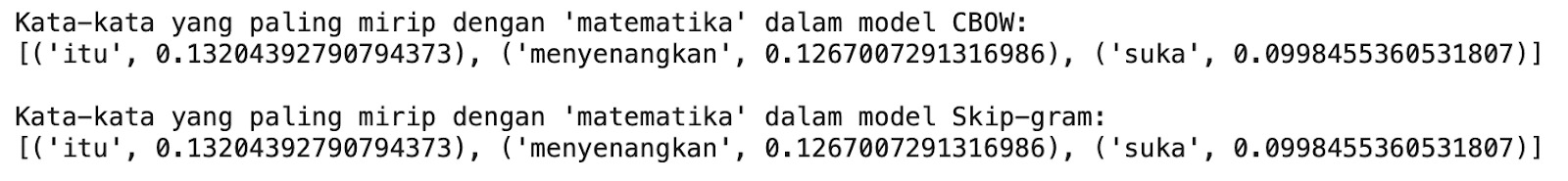

- Matematika dalam Natural Language Processing (NLP): Word Embedding

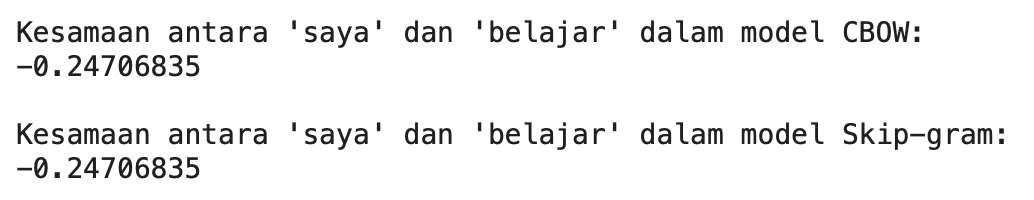

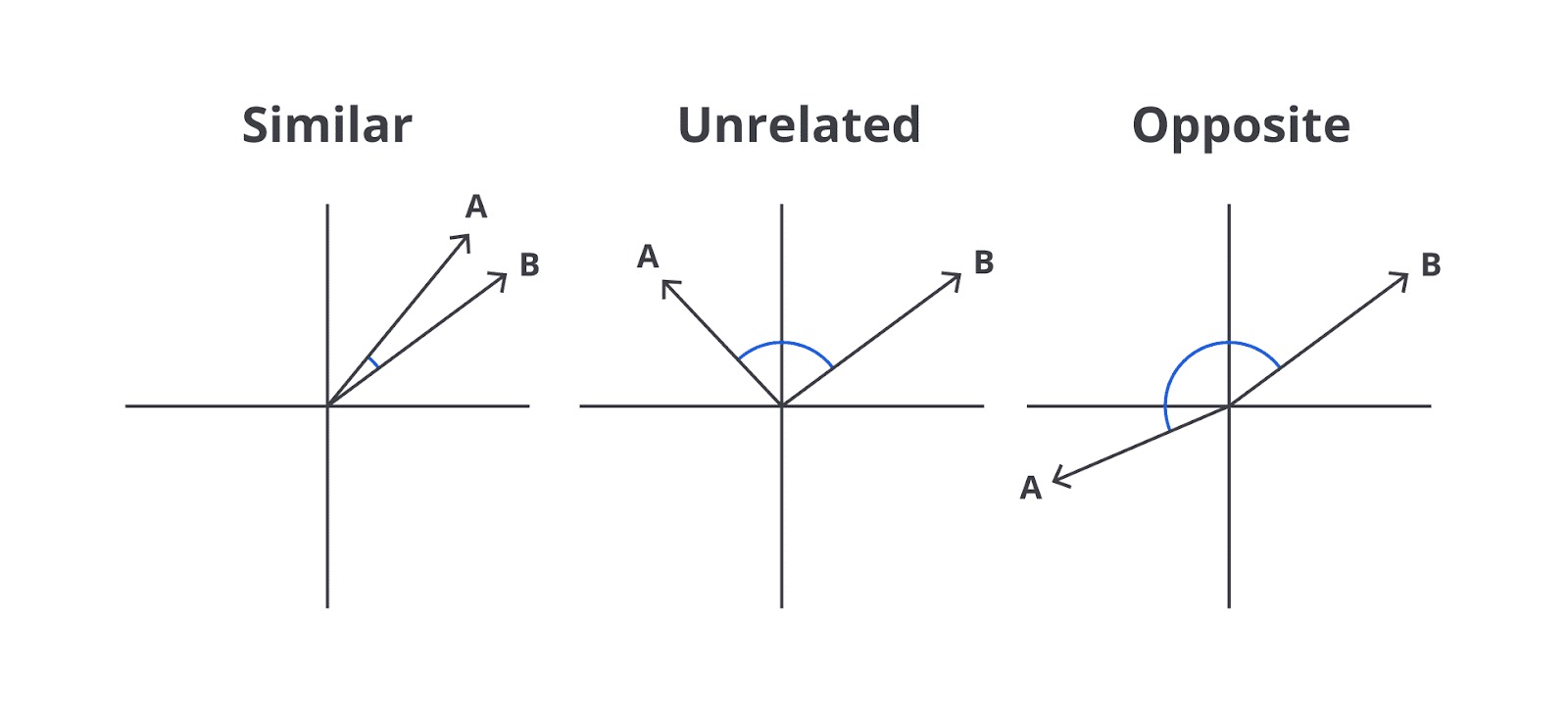

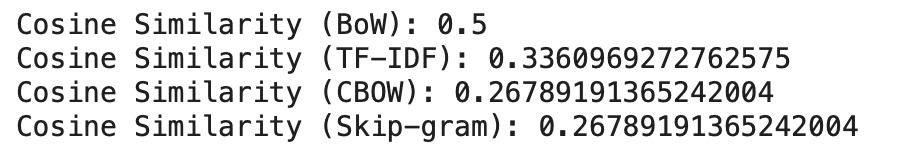

- Matematika dalam Natural Language Processing (NLP): Cosine Similarity

- Matematika dalam Time Series

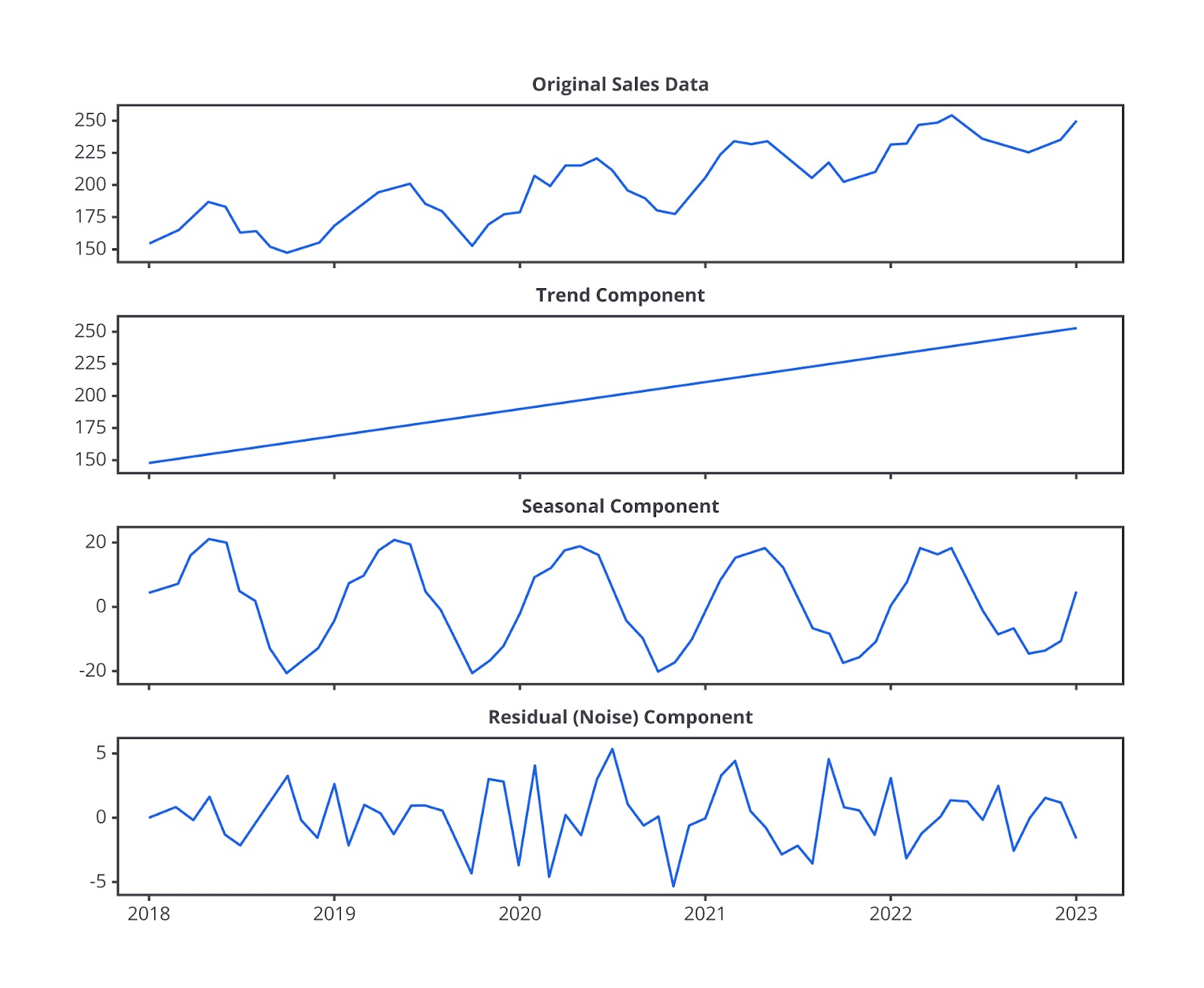

- Matematika dalam Time Series: Komponen Statistik Time Series

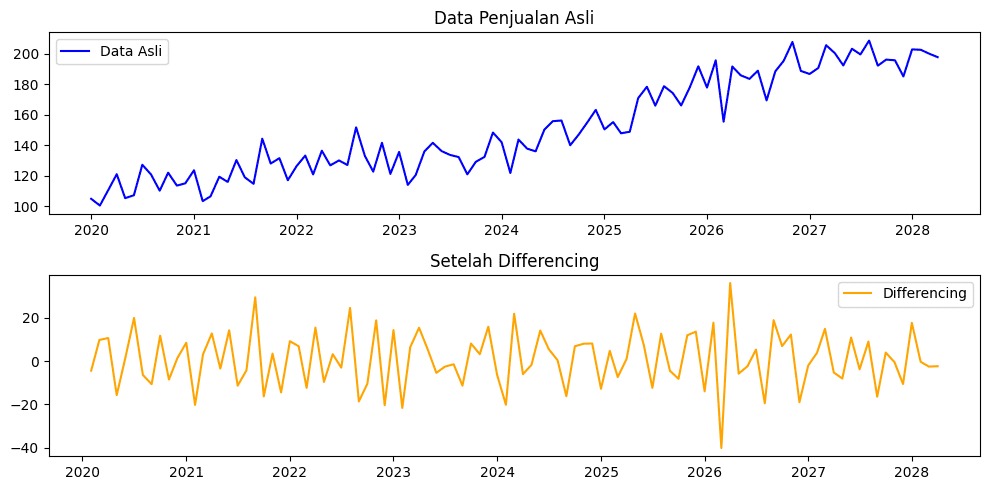

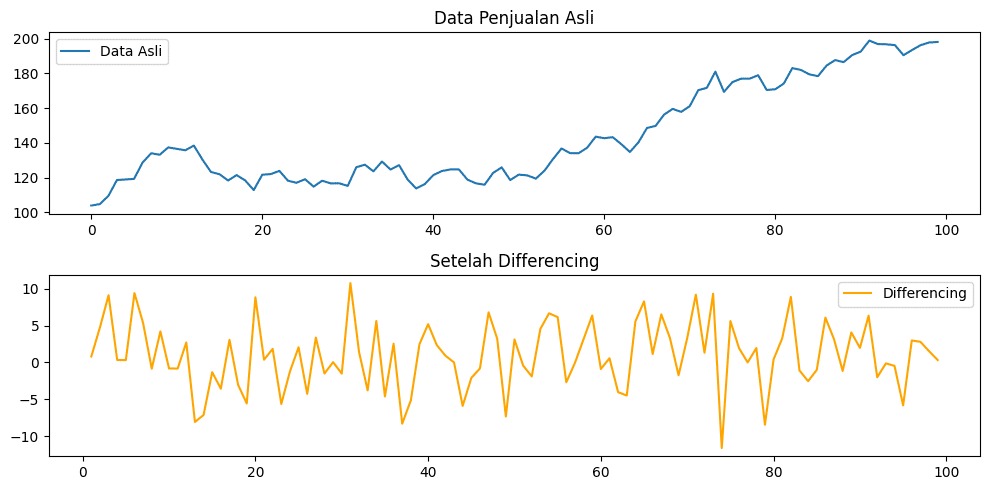

- Matematika dalam Time Series: Stasioneritas: Asumsi Kritis untuk Inferensi

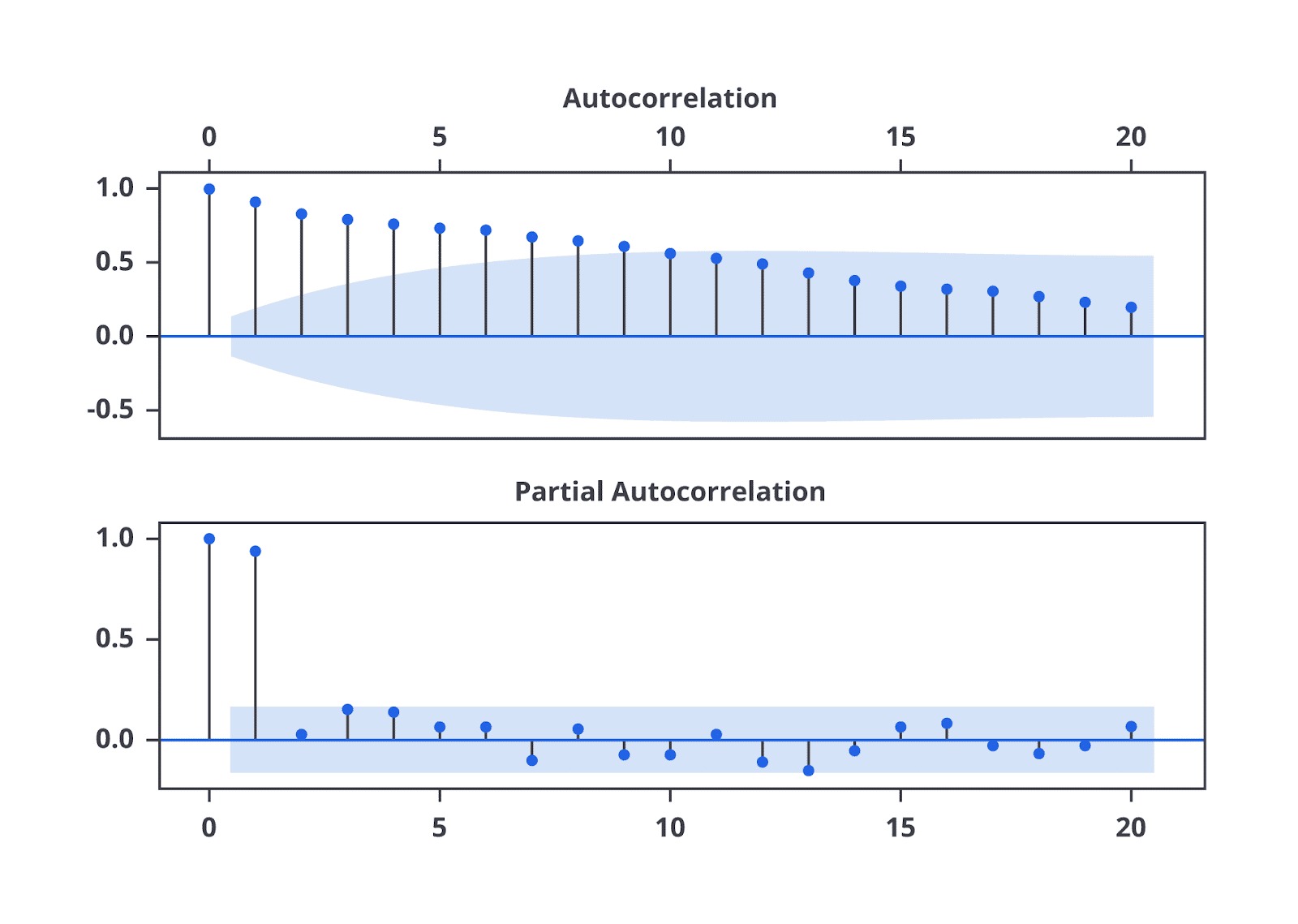

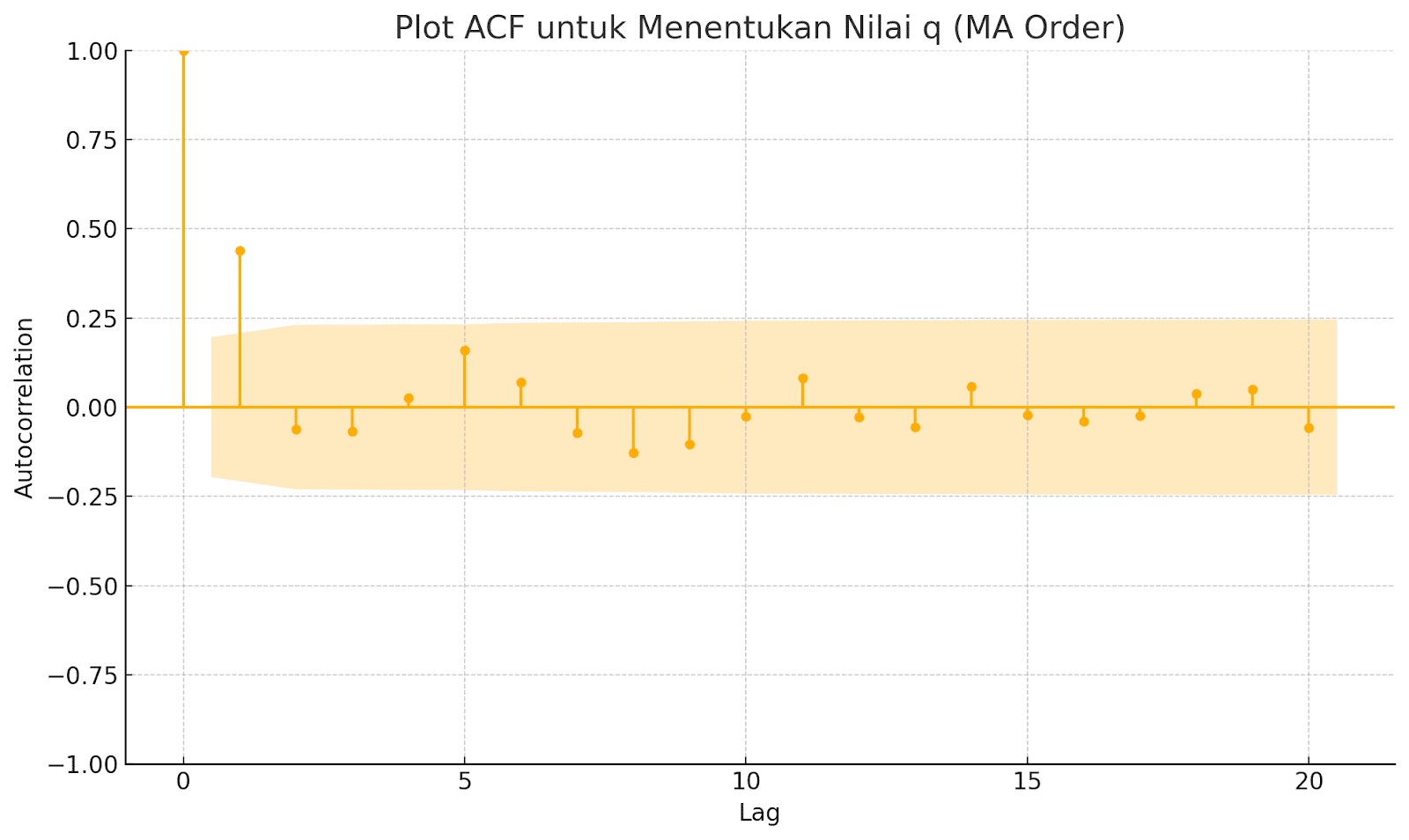

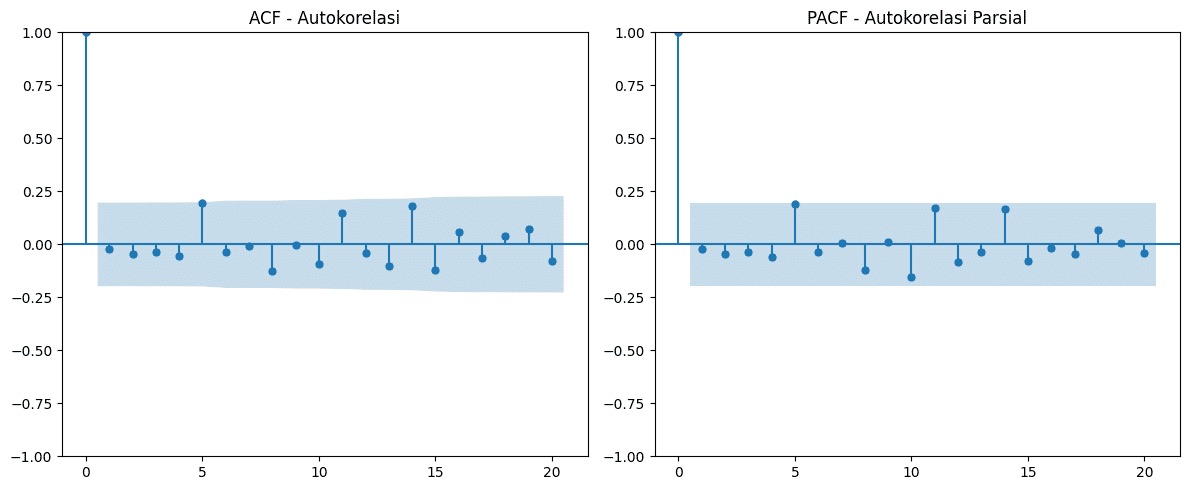

- Matematika dalam Time Series: Mengenal ACF & PACF

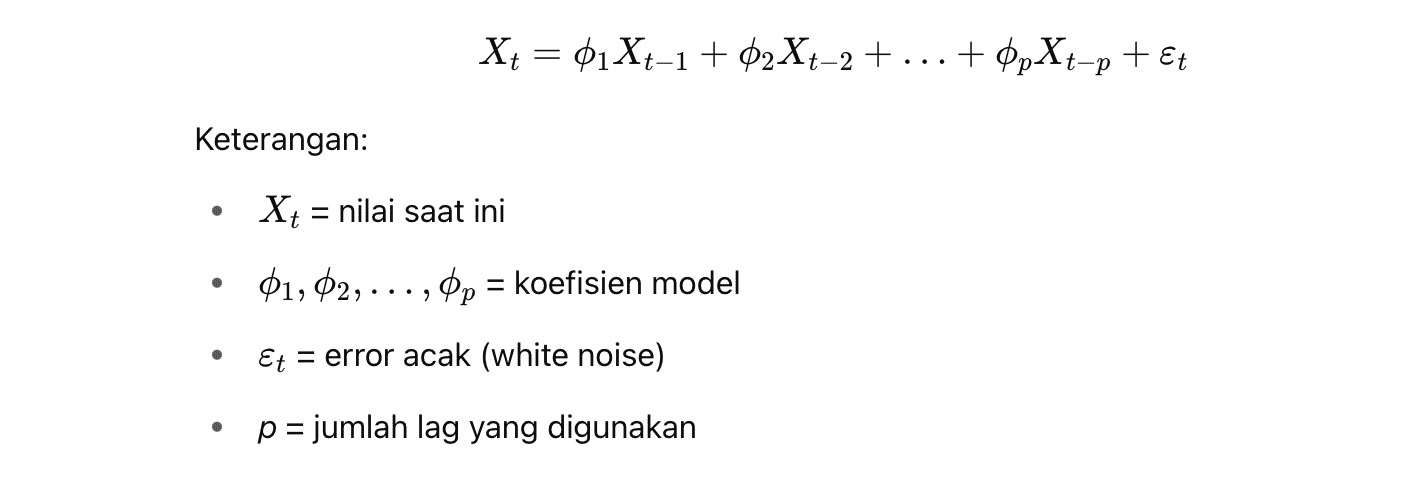

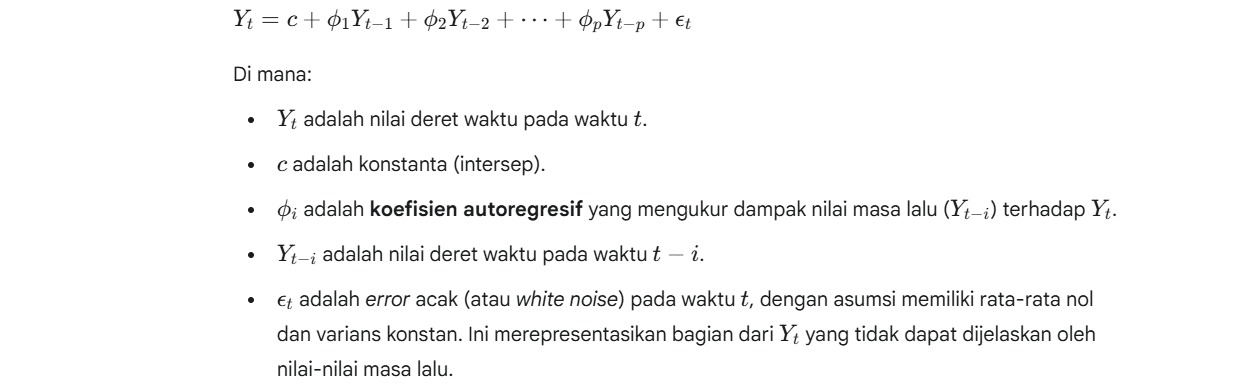

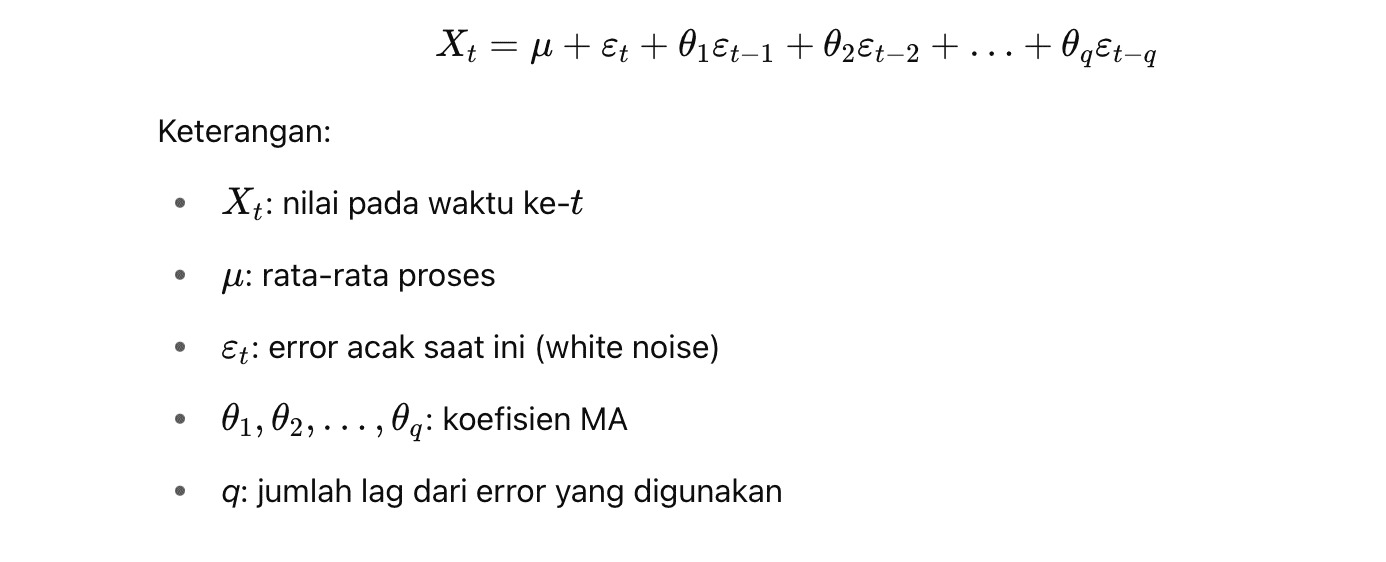

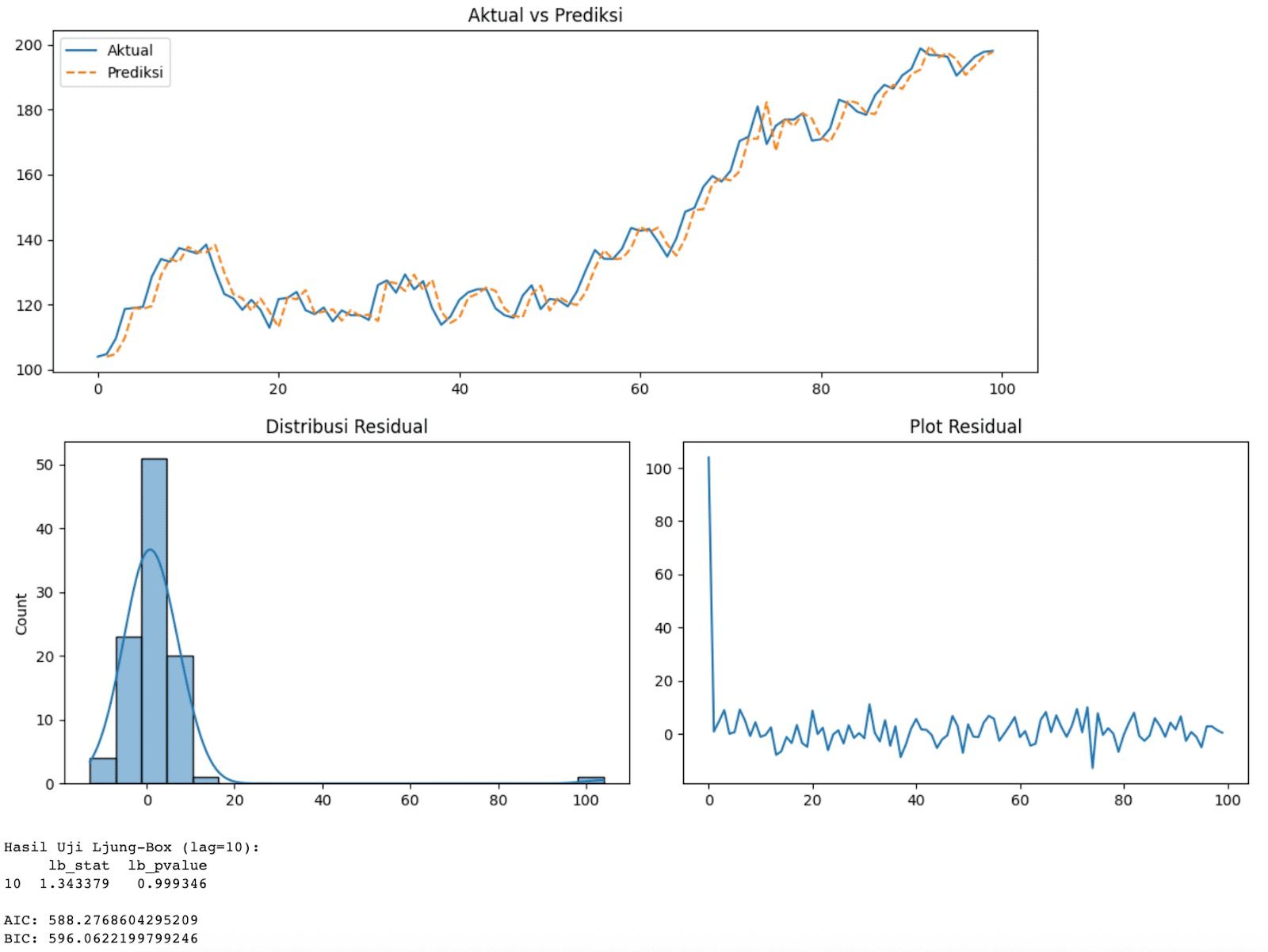

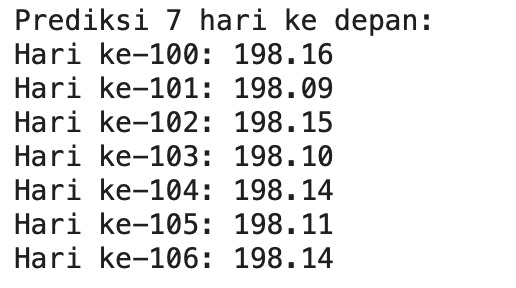

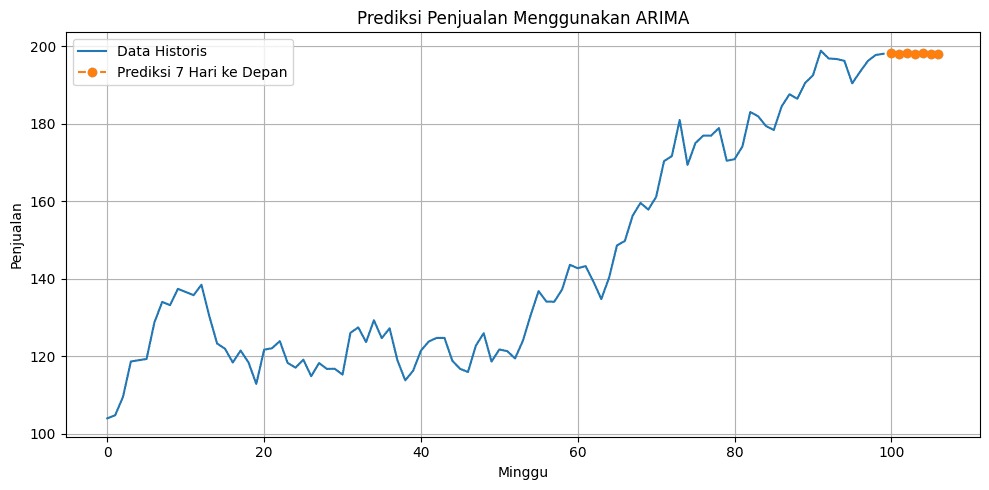

- Matematika dalam Time Series: Komponen Model ARIMA

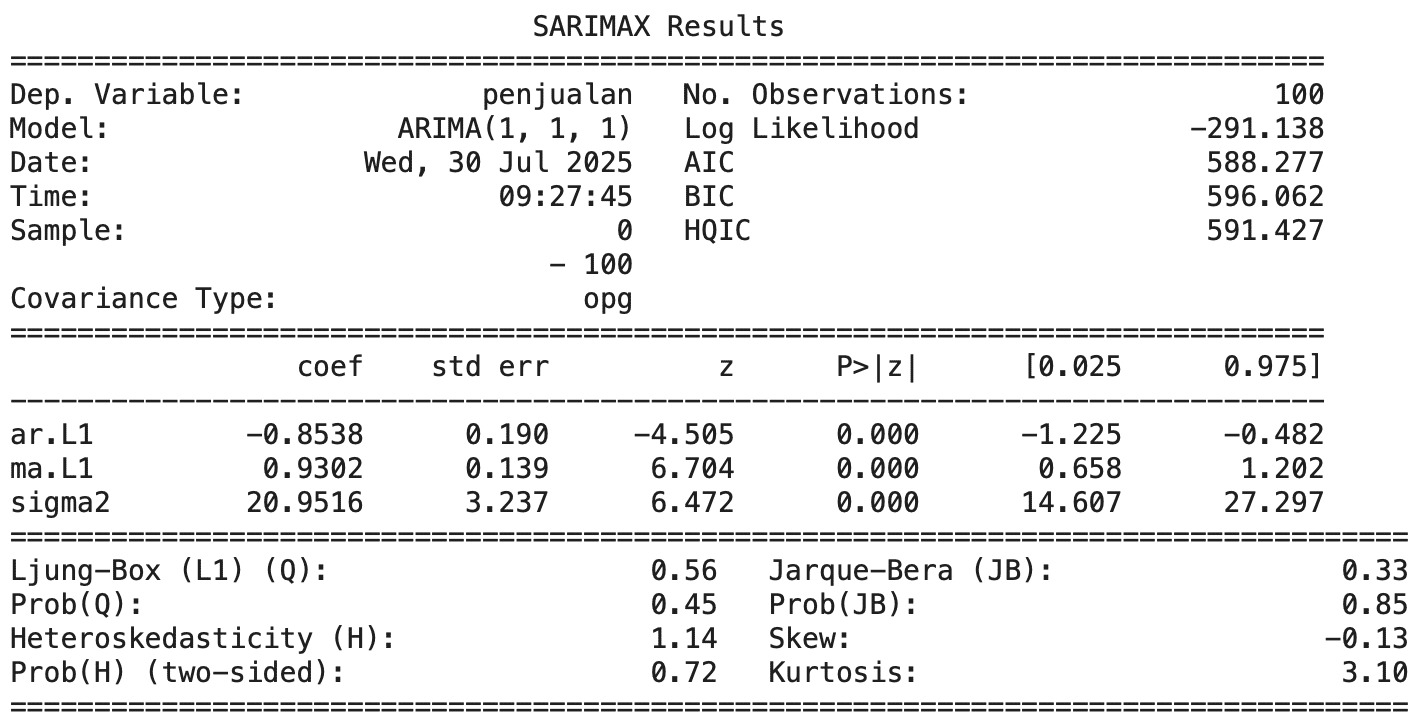

- Matematika dalam Time Series: Membangun Model ARIMA

- Rangkuman Matematika pada Algoritma AI

Pengantar Matematika pada Algoritma AI

Sampai di titik ini, Anda sudah mempelajari banyak hal:

- mempelajari struktur dan karakteristik data–baik univariat maupun multivariat–beserta ukuran pemusatan dan penyebarannya dalam materi Data Univariat dan Multivariat;

- kemudian memahami konsep dasar probabilitas hingga Teorema Bayes yang esensial untuk mengukur ketidakpastian dalam materi Dasar-Dasar Probabilitas;

- lalu belajar berbagai jenis distribusi probabilitas dan penerapannya untuk memodelkan perilaku data dalam materi Distribusi Probabilitas;

- menaklukkan statistik inferensial, jembatan krusial yang memungkinkan kita menarik kesimpulan valid dari sampel menuju populasi;

- serta melakukan A/B testing untuk dapat memberikan rekomendasi strategi bisnis yang paling sesuai berdasarkan interpretasi hasil analisis data dan pengujian hipotesis dalam materi Studi Kasus A/B Testing dengan Python.

Sekarang, dengan fondasi matematika yang kokoh di tangan Anda, saatnya kita melangkah lebih jauh menuju inti dari sistem cerdas yang mengubah dunia: algoritma AI.

Sering kali, AI dipandang sebagai bidang yang murni komputasional atau hanya tentang “belajar” dari data secara ajaib. Namun, anggapan itu berbeda dengan kenyataan yang akan kita pelajari.

Bayangkan Anda ingin membangun sebuah sistem yang dapat mengenali wajah dari gambar, atau memahami makna dari kalimat yang diucapkan, atau bahkan memprediksi tren harga saham di masa depan. Algoritma di balik semua kemampuan luar biasa ini tidak lain adalah aplikasi canggih dari prinsip-prinsip matematika yang telah Anda pelajari.

- Bagaimana sistem mengukur tingkat keyakinannya terhadap suatu prediksi? Itu adalah probabilitas.

- Bagaimana sistem menangani variasi dan ketidakpastian? Itu adalah konsep distribusi.

- Bagaimana sebuah sistem “belajar” pola dalam data? Itu adalah proses estimasi statistik.

Pada materi ini, kita akan membongkar “kotak hitam” AI dan melihat bahwa statistika menjadi bahasa universal yang menjelaskan dan memandu setiap operasinya.

Kita akan secara spesifik menelaah hal berikut.

- Computer Vision (Metode Filtering): Filter gambar, yang esensial untuk mendeteksi tepi atau mengurangi noise, secara fundamental adalah operasi statistik yang menganalisis perubahan distribusi intensitas piksel dan variansi lokal.

- Natural Language Processing (Metode Ekstraksi Fitur): Representasi bahwa teks seperti TF-IDF dan Word Embeddings bukan sekadar kode angka, melainkan cerminan cerdas dari probabilitas kemunculan kata, korelasi kontekstual, serta analisis statistik frekuensi.

- Time Series (ARIMA): Model prediksi deret waktu seperti ARIMA sepenuhnya dibangun di atas konsep proses stokastik, autokorelasi, dan inferensi statistik untuk memahami serta memproyeksikan pola data yang bergantung pada waktu.

Jadi, bersiaplah untuk memperdalam pemahaman Anda, tidak hanya tentang hal yang dilakukan algoritma AI, tetapi yang lebih penting: alasan dan cara statistika untuk melakukannya.

Ini akan memberdayakan Anda untuk tidak hanya menjadi pengguna AI, tetapi juga seorang data scientist yang dapat mengerti, berinovasi, dan bahkan mengembangkan algoritma AI dengan landasan statistik yang kuat.

Matematika dalam Computer Vision (CV)

Kita telah menuntaskan pembahasan fundamental statistika–sebagai salah satu cabang matematika–pada materi-materi sebelumnya, mulai dari struktur data univariat dan multivariat, memahami konsep dasar probabilitas yang membentuk dasar ketidakpastian, menyelami berbagai distribusi probabilitas untuk memodelkan fenomena data, hingga menguasai statistik inferensial yang krusial dalam menarik kesimpulan dari sampel ke populasi. Semua pengetahuan ini adalah fondasi esensial kita.

Sekarang, ayo kita coba aplikasikan pemahaman statistika tersebut pada salah satu domain kunci dalam AI: computer vision.

Sebuah gambar digital, yang kita lihat sebagai representasi visual, pada dasarnya adalah matriks besar berisi data numerik atau berupa kumpulan piksel dengan nilai intensitas atau warna tertentu. Data ini, layaknya data numerik lainnya, sering kali memerlukan pemrosesan untuk menghilangkan gangguan atau menonjolkan fitur penting agar dapat dianalisis secara efektif oleh mesin. Di sinilah metode filtering dalam pemrosesan citra memegang peranan krusial.

Anda mungkin telah familier dengan efek filter dalam aplikasi pengolahan gambar. Namun, apakah Anda memahami prinsip matematika yang mendasari operasi tersebut?

Tahukah Anda?

- Filter mampu menghaluskan noise dan secara presisi mendeteksi tepi objek melalui mekanisme pemrosesan spasial pada intensitas piksel.

- Setiap piksel dalam gambar dapat dimodelkan sebagai sampel acak dari suatu distribusi, sementara noise bisa direpresentasikan secara probabilistik sebagai penyimpangan dari distribusi tersebut.

- Operasi inti seperti konvolusi adalah bentuk rata-rata tertimbang atau pengukuran terhadap perbedaan statistik lokal antar piksel.

- Filter penghalus bekerja dengan cara mengurangi variansi lokal pada intensitas piksel, menyerupai pendekatan smoothing data dalam analisis statistik.

- Filter deteksi tepi mengestimasi gradien atau perubahan signifikan dalam distribusi intensitas piksel dengan menggunakan konsep turunan diskret yang merepresentasikan laju perubahan secara statistik.

Tenang, kita akan bedah istilah-istilah di atas dalam materi ini. Bersiaplah untuk melihat gambar bukan sebatas representasi visual, melainkan sebagai kumpulan data yang dapat diolah dan diinterpretasi melalui lensa statistik untuk mengungkap informasi tersembunyi.

Mari kita mulai eksplorasi.

Matematika dalam Computer Vision (CV): Apa Itu Computer Vision?

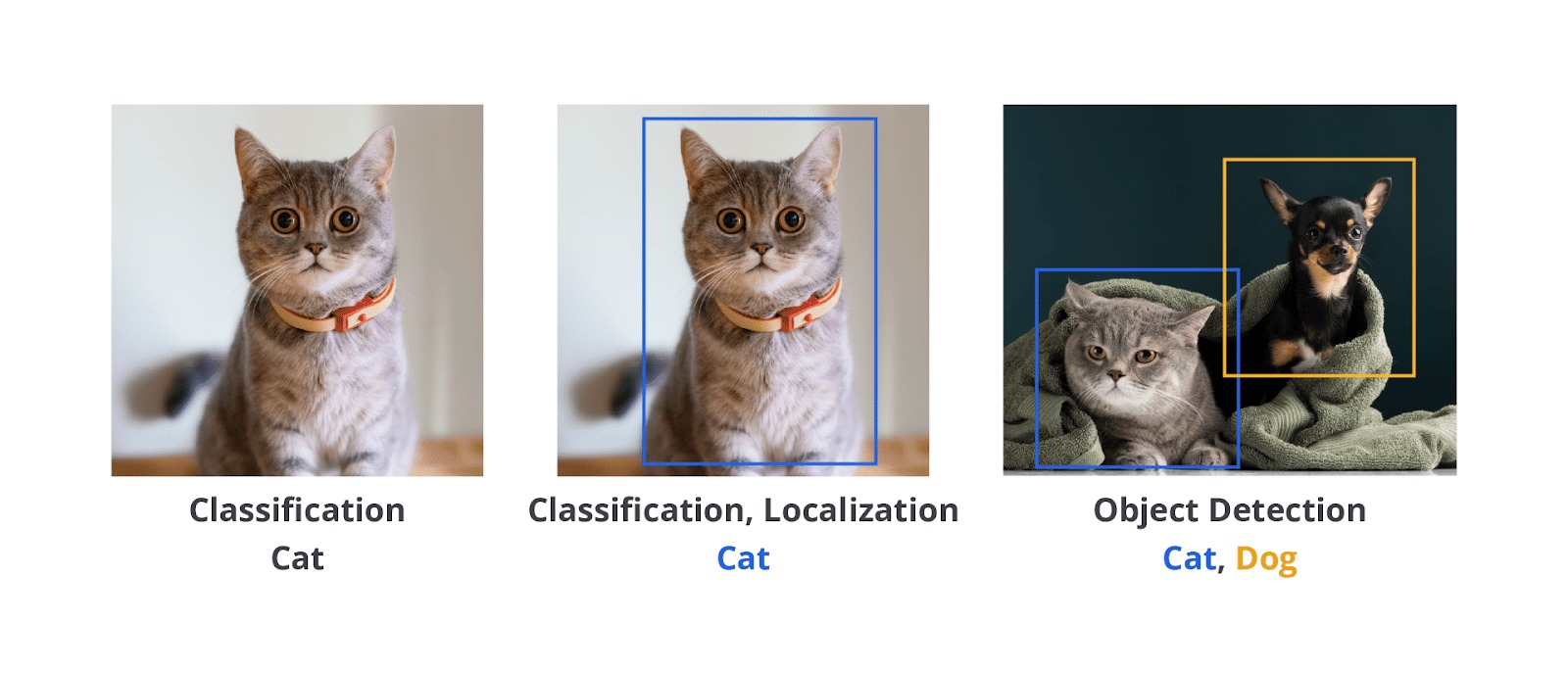

Computer vision (CV) adalah cabang dari bidang ilmu artificial intelligence (AI) untuk melatih komputer agar mampu “melihat” serta “memahami” dunia dari gambar dan video sebagaimana manusia melakukannya.

Tujuan utamanya bukan sekadar menampilkan gambar, melainkan untuk menginterpretasikan dan mengekstraksi informasi yang bermakna dari data visual tersebut.

Bayangkan saja kemampuan mata dan otak kita: mengenali wajah orang yang kita kenal, membaca tulisan pada papan reklame, membedakan berbagai jenis hewan, atau bahkan mengukur jarak benda dari kita. Computer vision berupaya mereplikasi kemampuan luar biasa tersebut pada lingkungan mesin.

Berbeda dengan data tekstual atau numerik biasa, CV bekerja dengan piksel. Setiap gambar atau frame video tersusun dari jutaan piksel, yakni masing-masing piksel memiliki nilai intensitas (untuk gambar hitam-putih) atau nilai warna (untuk gambar berwarna, misalnya red-green-blue atau RGB).

Dengan menganalisis pola, warna, bentuk, dan gerakan dari kumpulan piksel-piksel ini, komputer dapat “belajar” serta “memahami” hal yang sebenarnya terkandung dalam sebuah visual. Proses ini melibatkan banyak sekali perhitungan statistik untuk mengidentifikasi pola, mengukur kesamaan, dan membuat keputusan.

Implementasi computer vision mungkin terdengar rumit, tetapi faktanya, teknologi ini sudah meresap dalam berbagai aspek kehidupan kita sehari-hari, sering kali tanpa kita sadari.

- Pengenalan Wajah (Face Recognition)

Ini adalah salah satu aplikasi CV yang paling populer dan banyak digunakan. Contoh implementasinya sebagai berikut.- Membuka Kunci Smartphone: Anda cukup menatap layar ponsel dan dalam sepersekian detik, ponsel Anda terbuka. Sistem CV menganalisis fitur unik wajah Anda untuk memverifikasi identitas.

- Verifikasi Keamanan: Di bandara, stasiun, dan kantor; sistem CV dapat membandingkan wajah seseorang dengan database untuk memverifikasi identitas mereka.

- Tagging Otomatis pada Media Sosial: Ketika Anda mengunggah foto ke platform media sosial, sistem secara otomatis memberikan tag nama teman-teman Anda dalam foto.

- Mobil Otonom (Self-Driving Cars)

Computer vision bertindak sebagai “mata” utama bagi mobil tanpa pengemudi. Contoh implementasinya adalah berikut.- Deteksi Objek: Kamera pada mobil terus-menerus memindai lingkungan dan CV bertugas mendeteksi objek-objek penting, seperti mobil lain, pejalan kaki, pesepeda, serta hewan.

- Pengenalan Rambu Lalu Lintas dan Marka Jalan: CV membaca rambu “STOP”, “Belok Kiri”, atau mengenali garis putus-putus dan garis solid di jalan.

- Pelacakan Gerakan: Sistem melacak gerakan objek lain di sekitar mobil untuk memprediksi perilakunya dan mencegah tabrakan.

- Filter Media Sosial (Social Media Filters)

Pernah menambahkan telinga anjing, kacamata lucu, atau efek riasan virtual ke wajah Anda di Instagram, Snapchat, atau TikTok? Contoh implementasinya berikut.- CV mendeteksi dan melacak fitur-fitur penting pada wajah Anda secara real-time (misalnya, posisi mata, hidung, mulut, dan garis rahang).

- Setelah fitur-fitur ini terdeteksi, filter dapat menempatkan objek virtual dengan presisi tinggi, membuatnya terlihat menyatu dengan wajah Anda.

Pertanyaan menariknya, “Bagaimana computer vision bisa melakukan itu semua?”

Matematika dalam Computer Vision (CV): Memahami Citra sebagai Data Numerik

Kita telah melihat cara computer vision memungkinkan komputer “melihat” dan “memahami” dunia visual. Namun, bagaimana sebenarnya komputer melakukan itu?

Kuncinya terletak pada cara komputer memandang sebuah gambar: bukan sebagai representasi visual semata, melainkan sebagai kumpulan data numerik. Di sinilah statistika memegang peranan krusial dalam computer vision.

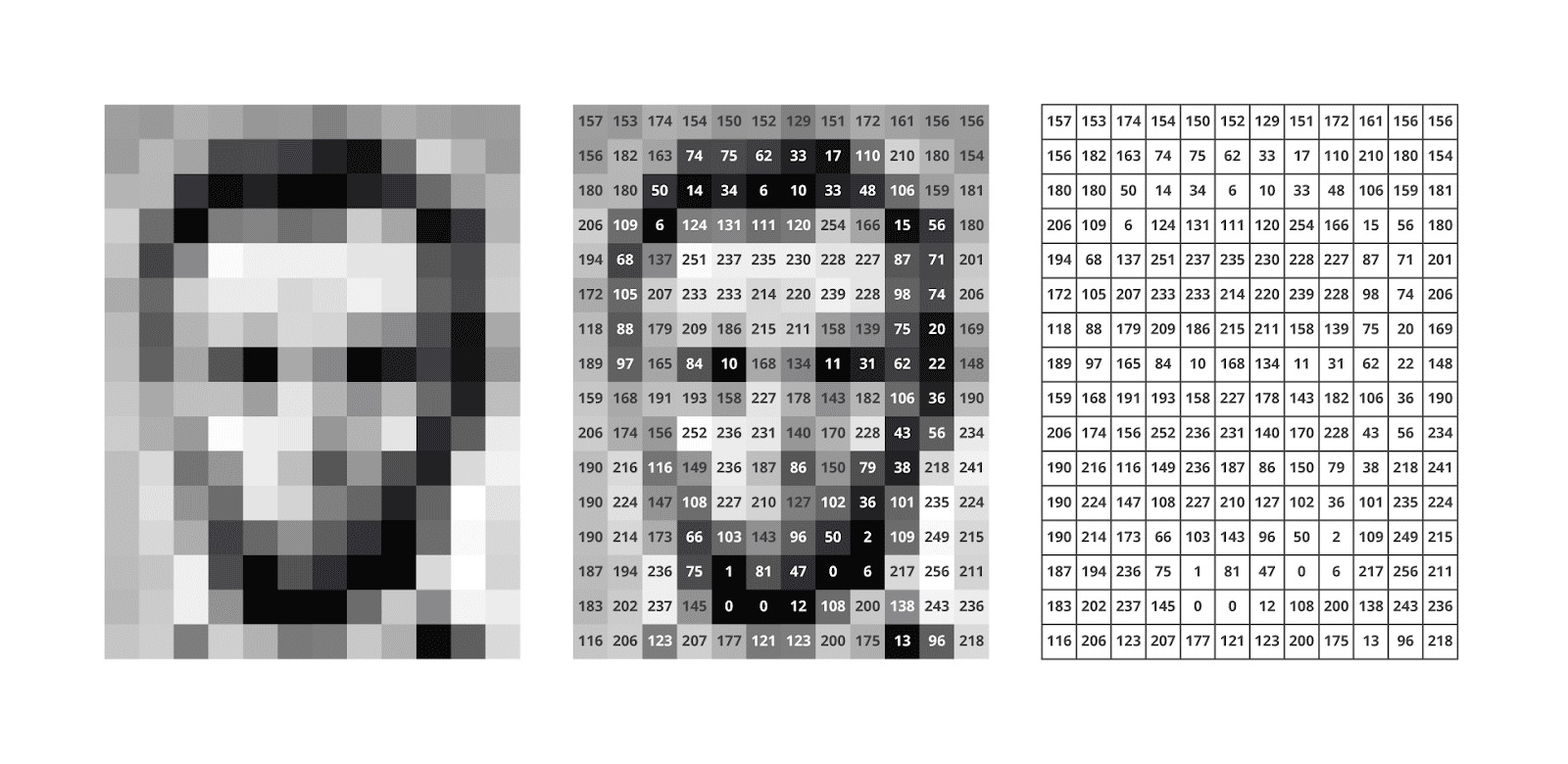

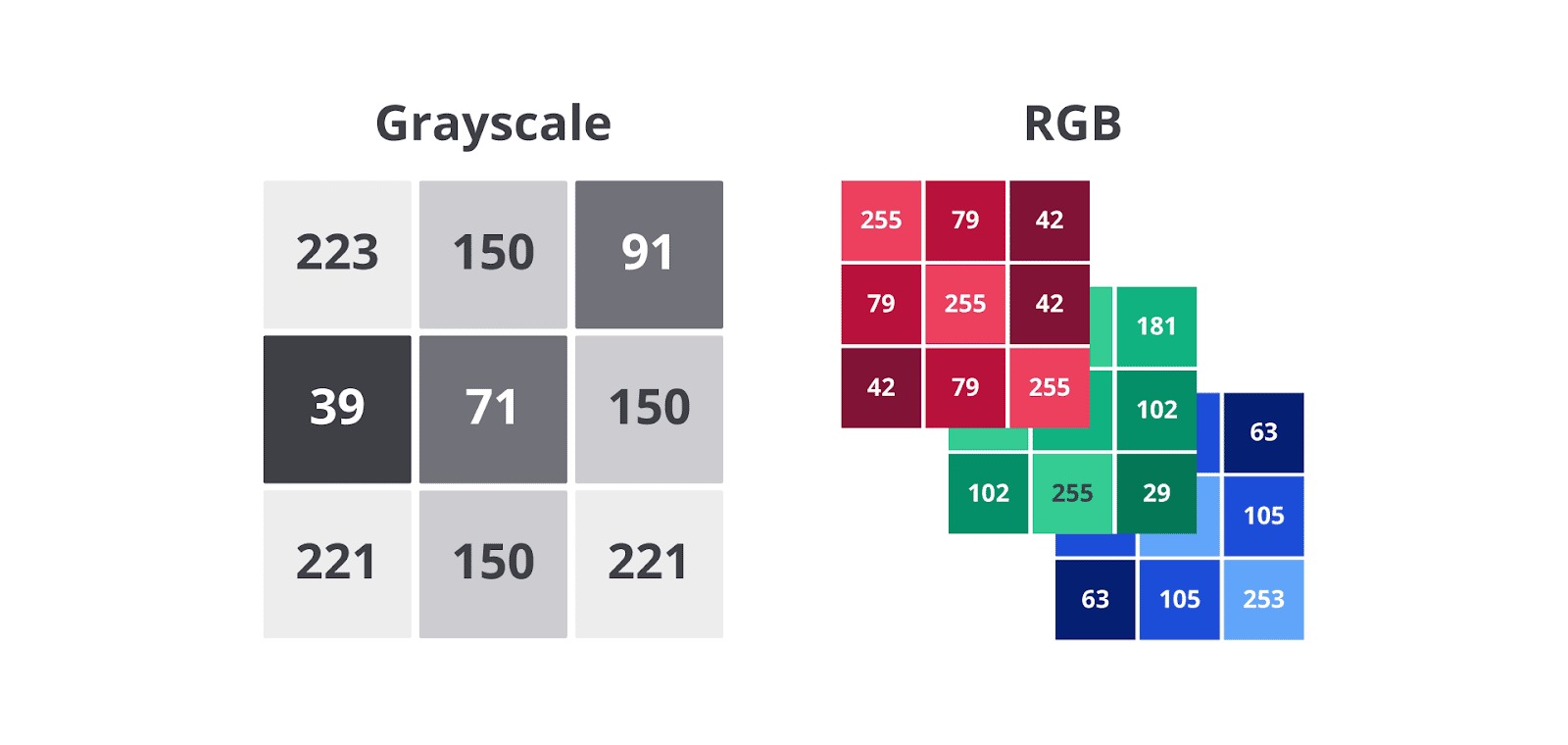

Setiap gambar digital yang kita lihat, dari foto dalam ponsel hingga frame video, pada dasarnya adalah kumpulan angka-angka (piksel). Bayangkan sebuah gambar sebagai lembaran kotak-kotak kecil yang sangat banyak. Setiap kotak kecil ini disebut piksel dan masing-masing piksel menyimpan nilai numerik yang mewakili intensitas cahaya atau warnanya.

- Pada citra grayscale (hitam-putih), setiap piksel memiliki satu nilai intensitas, biasanya dari 0 (hitam pekat) hingga 255 (putih terang).

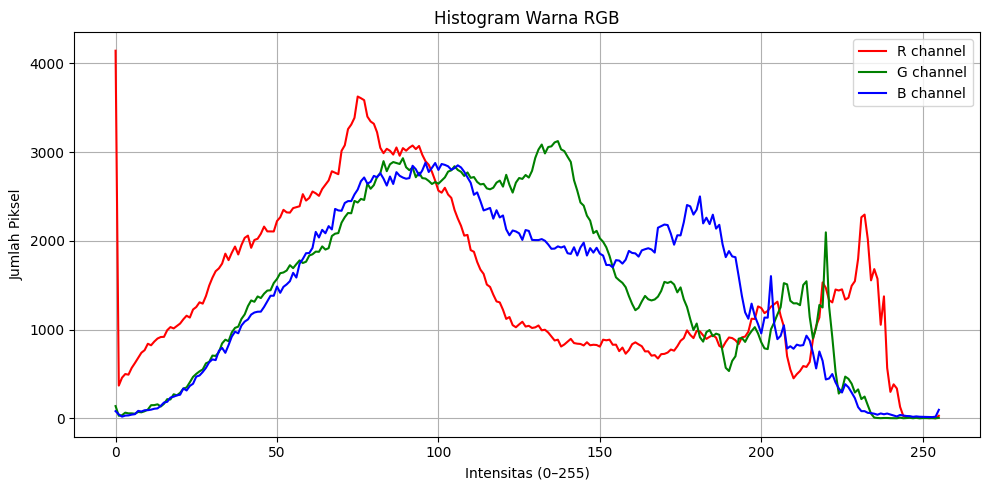

- Untuk citra berwarna, seperti yang kita lihat sehari-hari, setiap piksel sebenarnya terdiri dari kombinasi tiga saluran warna dasar: merah (red), hijau (green), dan biru (blue), sering disebut RGB. Masing-masing saluran ini juga memiliki nilai intensitasnya sendiri (misalnya, dari 0 hingga 255) dan kombinasi ketiganya menghasilkan spektrum warna yang luas.

Karena sebuah gambar adalah kumpulan angka, semua alat dan konsep statistika yang telah kita pelajari menjadi sangat relevan. Kita dapat menggunakan statistika untuk hal-hal berikut.

- Menganalisis distribusi kecerahan atau warna dalam suatu area gambar. Misalnya, dengan menghitung rata-rata nilai piksel di sebuah area, kita bisa mengetahui seberapa terang area tersebut secara keseluruhan. Median bisa memberikan gambaran kecerahan yang lebih robust terhadap noise ekstrem, sementara modus bisa menunjukkan warna atau intensitas yang paling sering muncul.

- Menginterpretasi pola-pola yang tersembunyi dalam data piksel. Apakah ada area yang sangat bervariasi (memiliki variansi tinggi) yang menunjukkan adanya tepi atau tekstur? Atau apakah area tersebut sangat seragam?

- Mengekstrak informasi penting dari data citra. Statistik membantu kita mengidentifikasi fitur-fitur seperti tepi objek, tekstur permukaan, atau bahkan mengenali wajah, dengan mengukur dan memodelkan properti numerik dari kelompok piksel.

Dengan demikian, peran statistika sangat fundamental. Ia menyediakan kerangka kerja untuk menganalisis, menginterpretasi, dan mengekstrak informasi bermakna dari kumpulan data piksel, mengubahnya dari sekadar visual menjadi “pemahaman” yang dapat diolah mesin.

Matematika dalam Computer Vision (CV): Analisis Fitur Citra Berbasis Statistik

Setelah kita memahami bahwa setiap gambar adalah sekumpulan data numerik yang terdiri dari piksel, pertanyaan berikutnya adalah “Bagaimana kita bisa mendapatkan gambaran statistik secara menyeluruh dari miliaran piksel ini?” Lalu, “Bagaimana kita bisa ‘membaca’ data ini untuk memahami karakteristik visual sebuah gambar tanpa harus memeriksa setiap piksel satu per satu?”

Jawabannya ada pada histogram citra.

Histogram Citra: Distribusi Intensitas Piksel

Secara fundamental, histogram citra adalah representasi grafis dari distribusi frekuensi nilai intensitas piksel dalam sebuah gambar. Bayangkan seperti sensus mini yang dilakukan pada setiap piksel: Anda menghitung jumlah piksel yang memiliki nilai intensitas 0 (hitam pekat), yang memiliki nilai 1, yang memiliki nilai 2, dan seterusnya hingga nilai maksimal 255 (putih terang).

Histogram kemudian memvisualisasikan hasil penghitungan ini dalam bentuk grafik yang menunjukkan hubungan antara nilai intensitas (sumbu horizontal) dan jumlah piksel yang memiliki intensitas tersebut (sumbu vertikal). Dengan demikian, histogram membantu kita memahami sebaran kecerahan dalam sebuah gambar.

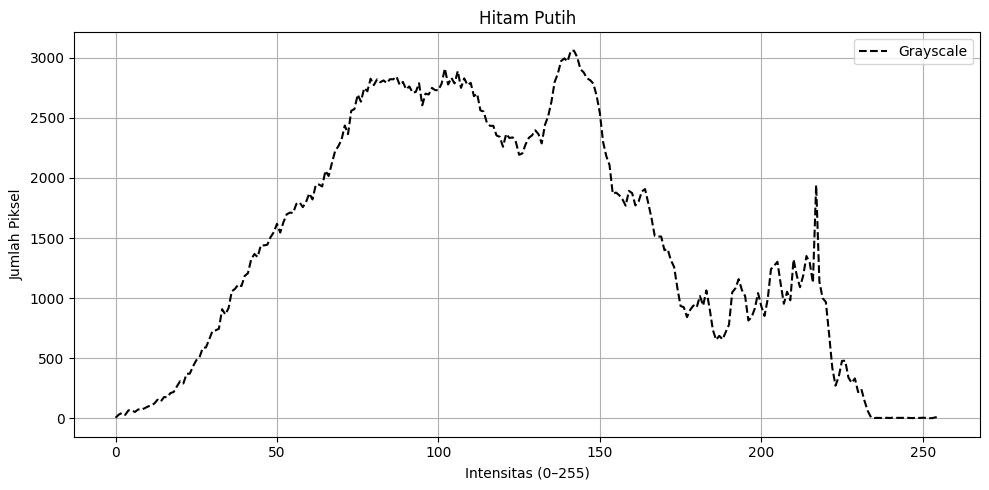

Berikut adalah penjelasan dari grafik histogram di atas.

- Sumbu horizontal (X-axis) mewakili rentang nilai intensitas piksel yang mungkin muncul dalam gambar, biasanya dari 0 hingga 255. Nilai 0 di ujung kiri menunjukkan piksel yang paling gelap, sedangkan nilai 255 di ujung kanan menunjukkan piksel yang paling terang.

- Sumbu vertikal (Y-axis) menunjukkan frekuensi, yaitu jumlah piksel yang memiliki nilai intensitas tertentu. Semakin tinggi nilai pada sumbu ini, semakin banyak piksel dalam gambar yang memiliki intensitas tersebut.

Jadi, dengan sekali pandang pada histogram, kita bisa langsung melihat “kecerahan” atau “warna” sebuah gambar terdistribusi secara statistik.

Statistik Spasial: Hubungan Antar Piksel Tetangga

Setelah kita menganalisis distribusi keseluruhan piksel dalam sebuah gambar menggunakan histogram, kini saatnya masuk lebih dalam pada hubungan antar piksel secara lokal. Ingat bahwa gambar bukan hanya sekumpulan piksel terisolasi; setiap piksel memiliki “tetangga” yang memengaruhi dan dipengaruhi olehnya.

Statistik spasial dalam computer vision berfokus pada analisis pola dan hubungan antar piksel yang berdekatan ini. Kemampuan untuk memahami hubungan lokal antar piksel adalah kunci bagi komputer untuk mengenali bentuk, tekstur, dan tepi objek.

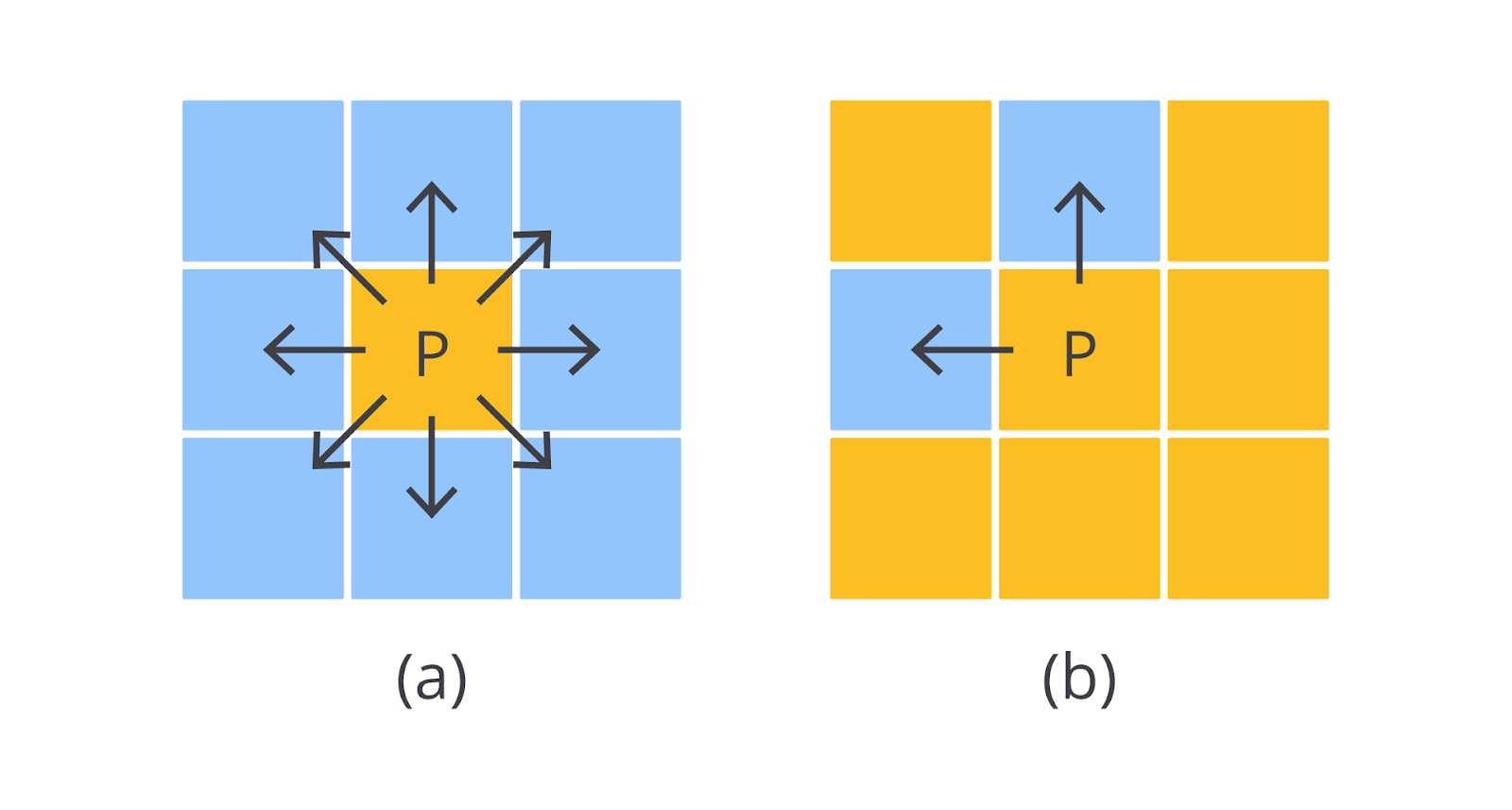

Hubungan antar piksel ini biasanya dianalisis melalui jendela kecil (disebut sebagai filter) yang mengelilingi suatu piksel pusat—misalnya area 3 × 3 atau 5 × 5 piksel. Dalam jendela tersebut, nilai intensitas piksel tetangga digunakan untuk menghitung karakteristik lokal, seperti rata-rata, variansi, atau gradien. Teknik ini memungkinkan kita menangkap pola-pola mikro yang tidak terlihat hanya dari histogram global. Kita bahas lebih lanjut nanti.

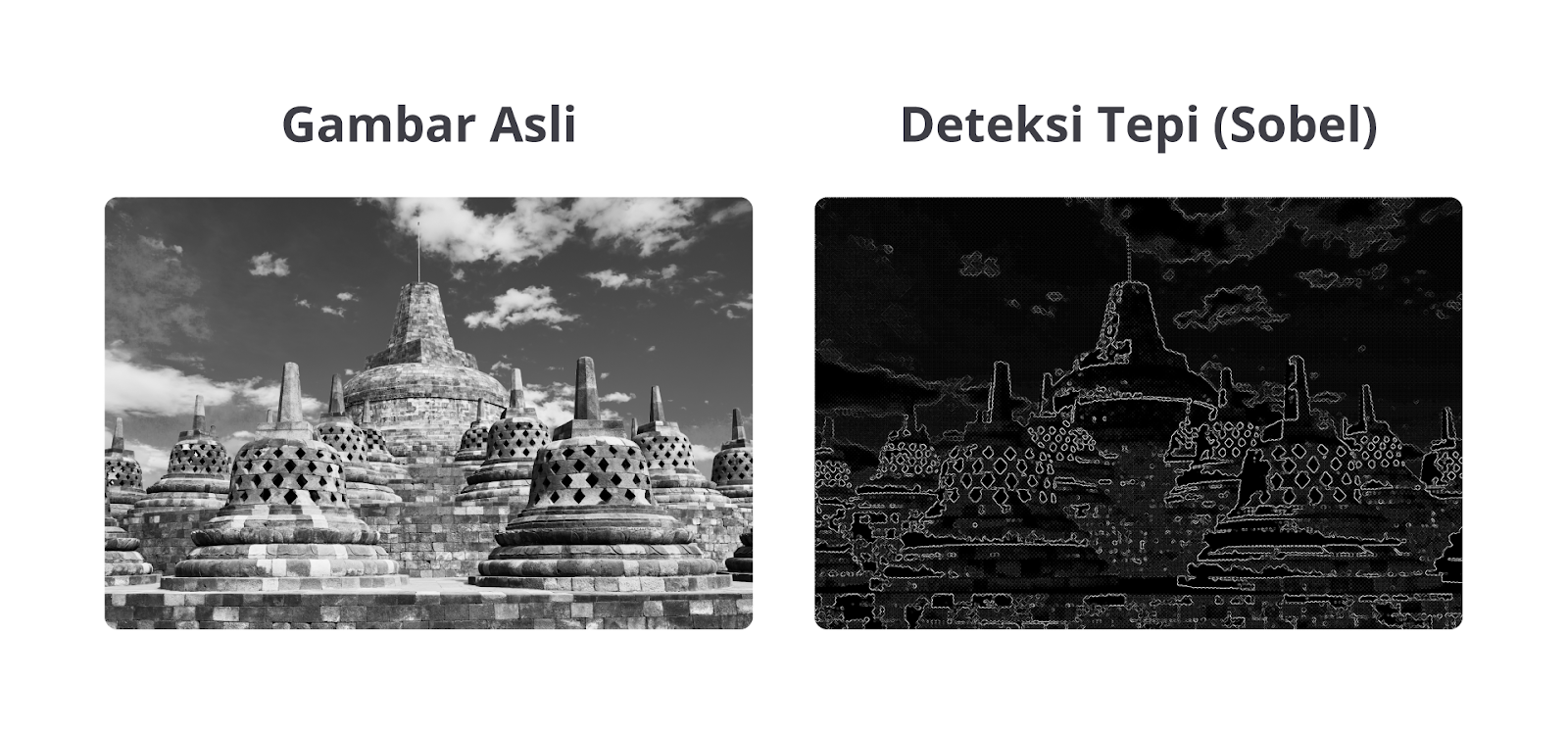

Intinya, statistik spasial menjadi landasan bagi banyak operasi dalam pemrosesan citra digital, seperti filtering, edge detection, dan feature extraction. Misalnya, filter deteksi tepi, seperti Sobel atau Laplacian bekerja dengan mengukur perubahan intensitas antar piksel tetangga untuk menemukan batas objek. Dengan kata lain, statistik spasial memungkinkan algoritma mengenali struktur lokal yang penting bagi pemahaman visual oleh komputer.

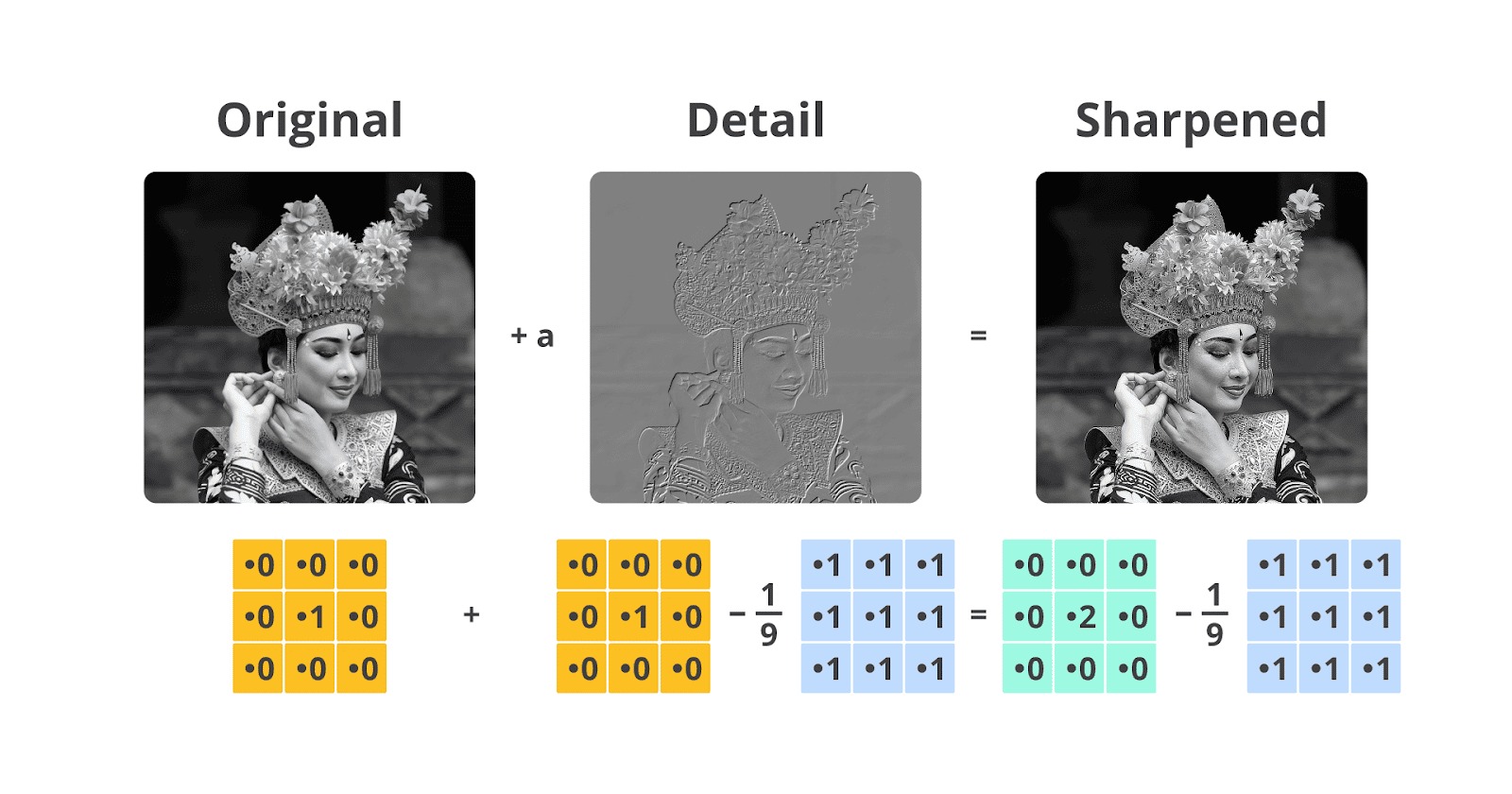

Konvolusi: Jendela Berjalan yang Membaca Pola Lokal

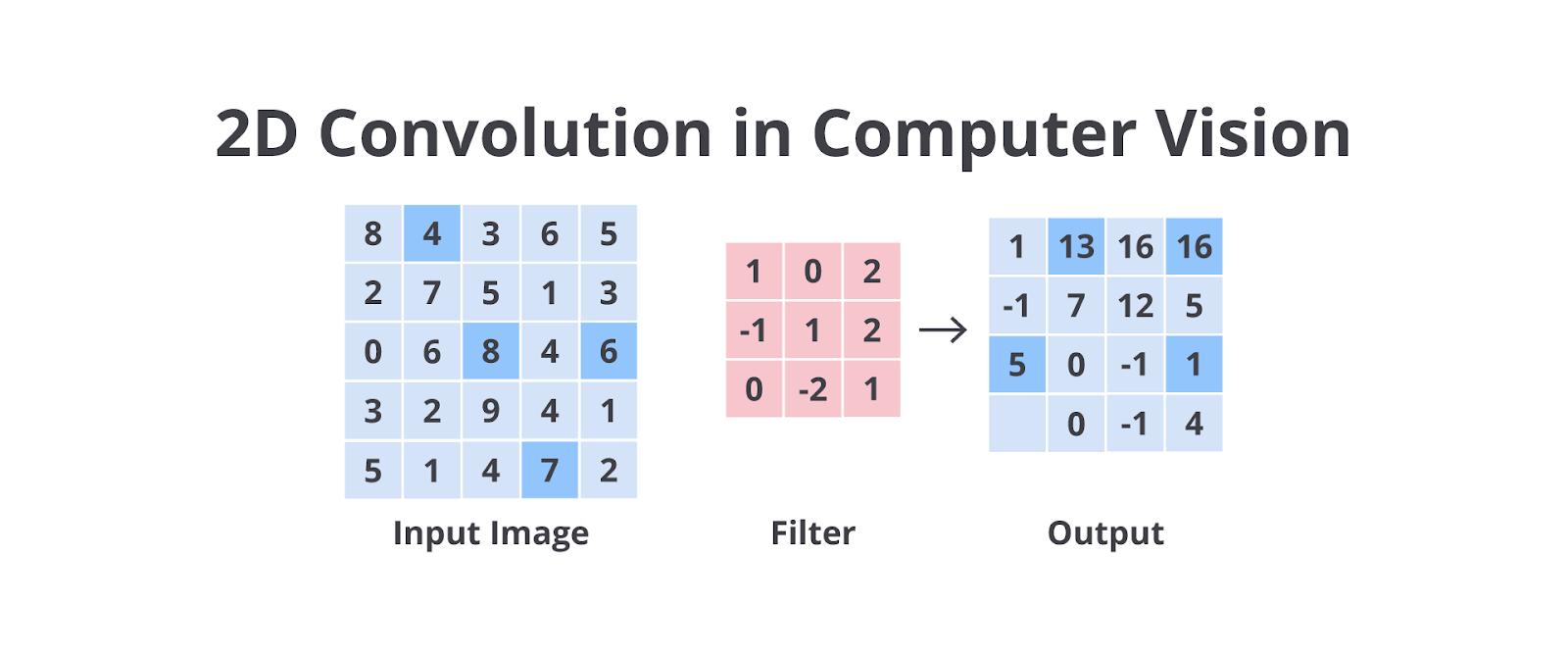

Inti dari banyak operasi statistik spasial dalam computer vision adalah konvolusi. Mungkin terdengar rumit, tapi secara intuitif, konvolusi bisa dibayangkan sebagai sebuah “jendela” kecil (disebut kernel atau filter) yang bergerak secara sistematis di atas seluruh gambar.

Bayangkan seperti ini.

- Jendela yang dimaksud ini berukuran kecil, biasanya 3 × 3 atau 5 × 5 piksel.

- Dalam jendela tersebut ada serangkaian angka (bobot) yang telah ditentukan.

- Jendela ini akan bergeser dari satu area gambar ke area lainnya, piksel demi piksel.

- Untuk setiap posisi jendela, komputer akan mengalikan nilai piksel di bawah jendela dengan bobot yang sesuai dalam jendela, lalu menjumlahkan semua hasil perkalian tersebut.

- Hasil penjumlahan ini kemudian menjadi nilai piksel baru untuk posisi tengah jendela pada gambar output.

Jadi, konvolusi pada dasarnya adalah proses “rata-rata tertimbang” atau “pengukuran perbedaan statistik lokal” antar piksel tetangga. Angka-angka dalam jendela (kernel) menentukan jenis “rata-rata” atau “perbedaan” yang sedang dihitung. Dengan mengubah angka-angka dalam kernel, kita bisa menciptakan berbagai efek filtering yang menyoroti karakteristik statistik spasial tertentu dari gambar.

Setelah kita tahu bahwa komputer bisa “membaca” gambar sebagai angka, langkah selanjutnya adalah cara kita bisa memerintahkan komputer untuk melakukan sesuatu yang berguna dengan angka-angka ini, misalnya membuat gambar jadi lebih halus atau menemukan batas-batas objek di dalamnya.

Mari kita lihat dua contoh umum berikut.

-

Filter Penghalus (Smoothing Filter): Menghilangkan Bintik-Bintik (Noise) dengan Efek Blur

Pernah melihat foto yang tampak memiliki bintik-bintik atau noise kecil yang mengganggu? Filter penghalus adalah salah satu solusi paling umum dalam pengolahan citra untuk mengatasi masalah ini.Filter ini bekerja dengan prinsip sederhana: meratakan nilai-nilai piksel di area lokal untuk menghasilkan tampilan yang lebih halus.

Dalam praktiknya, filter penghalus sering disebut juga sebagai blur filter karena memang efek visual yang dihasilkan adalah blur, yaitu gambar tampak lebih lembut dan tidak terlalu tajam. Efek ini terjadi karena variasi ekstrem antar piksel dikurangi sehingga transisi antar area menjadi lebih mulus.

Salah satu bentuk paling sederhana adalah mean filter atau box blur, yang menggunakan kernel berisi angka-angka seragam (misalnya semua 1). Ketika jendela filter bergerak di atas gambar, ia akan menghitung rata-rata nilai intensitas dari piksel-piksel dalam jendela tersebut, lalu mengganti nilai piksel pusat dengan rata-rata itu.

Apa artinya secara statistik? Piksel yang nilainya sangat berbeda dengan tetangganya— misalnya, terlalu terang di tengah piksel gelap—akan ditarik mendekati nilai rata-rata di sekitarnya. Hal ini efektif untuk mengurangi noise atau detail ekstrem yang tidak konsisten, mirip seperti kita menghitung rata-rata nilai ujian untuk memahami performa keseluruhan siswa, bukan hanya satu nilai ekstrem.

Hasilnya, gambar akan terlihat lebih halus (smooth), noise visual berkurang, serta detail halus dan tepi objek menjadi kurang tajam. Contohnya bisa Anda lihat pada perbandingan berikut: gambar asli vs. gambar setelah diterapkan filter penghalus (blur). Perhatikan detail arsitektur menjadi lebih lembut dan tekstur kasar menjadi rata.

-

Filter Deteksi Tepi: Menemukan Batasan Objek dengan Mengukur Perubahan Drastis

Sekarang, bayangkan Anda ingin komputer dapat mengenali garis-garis batas antara objek dalam sebuah gambar—misalnya tepi meja, batas bangunan, atau garis pada pakaian. Di sinilah filter deteksi tepi digunakan.Berbeda dari filter penghalus yang merata-ratakan nilai, filter deteksi tepi dirancang untuk mencari perbedaan nilai piksel yang signifikan. Kernel pada filter ini tidak diisi angka-angka seragam; biasanya berisi kombinasi nilai negatif dan positif untuk menyoroti perubahan intensitas antar piksel.

Ketika jendela filter ini bergerak di atas gambar, ia tidak lagi menghitung rata-rata, tetapi mengukur seberapa besar perubahan intensitas piksel dari satu sisi ke sisi lain. Bayangkan Anda sedang berjalan di permukaan datar, lalu tiba-tiba menghadapi tebing curam—perubahan drastis itulah yang coba dideteksi oleh filter ini.

Dalam konteks gambar, jika terjadi transisi tajam dari piksel gelap ke terang (atau sebaliknya), filter akan menghasilkan nilai intensitas tinggi, yang mengindikasikan adanya tepi. Area yang warnanya seragam atau perubahan intensitasnya halus tidak akan menghasilkan respons besar dari filter.

Dengan kata lain, filter deteksi tepi bekerja seperti “sensor perubahan”—ia sangat sensitif terhadap lonjakan atau penurunan tajam dalam distribusi nilai piksel. Ini mirip dengan cara ahli statistik mencari “anomali” atau “peristiwa penting” dalam data numerik.

Dengan kata lain, filter deteksi tepi bekerja seperti “sensor perubahan”—ia sangat sensitif terhadap lonjakan atau penurunan tajam dalam distribusi nilai piksel. Ini mirip dengan cara ahli statistik mencari “anomali” atau “peristiwa penting” dalam data numerik.Filter deteksi tepi membantu komputer “melihat” struktur dan bentuk dalam gambar, menjadikannya komponen penting dalam tugas-tugas seperti segmentasi objek, pelacakan (tracking), dan pengenalan pola (pattern recognition).

Ekstraksi Fitur Statistik dari Area Citra

Setelah memahami cara filter sederhana dapat digunakan untuk menghaluskan gambar atau mendeteksi tepi, kini saatnya membahas pendekatan yang lebih canggih dalam “membaca” isi gambar, yaitu ekstraksi fitur statistik dari area citra. Pendekatan ini tidak lagi berfokus pada piksel secara individual, tetapi menganalisis kelompok piksel secara kolektif untuk mengenali pola yang lebih kompleks, seperti tekstur.

Tekstur merupakan salah satu ciri visual penting yang dapat membedakan antara permukaan kasar dan halus, membedakan kayu dari kain, atau bahkan membedakan dua objek yang memiliki warna serupa. Untuk mengenali tekstur, sistem computer vision menggunakan berbagai ukuran statistik—tidak hanya berdasarkan nilai rata-rata, tetapi juga memperhitungkan penyebaran, variasi, dan keteraturan intensitas piksel dalam suatu area.

Mengidentifikasi Tekstur dengan Variansi dan Standar Deviasi Lokal

Salah satu cara paling dasar untuk mengenali tekstur dalam citra adalah dengan mengukur variansi atau standar deviasi intensitas piksel pada area-area kecil yang bergerak melintasi gambar. Pendekatan ini mirip dengan operasi konvolusi—tapi alih-alih menghitung rata-rata, kita menilai seberapa besar sebaran nilai piksel dari nilai tengahnya, baik melalui variansi maupun akar kuadrat dari variansi tersebut (yaitu standar deviasi).

Bayangkan sebuah jendela kecil (misalnya 3 × 3 piksel) yang berjalan di atas gambar. Pada setiap posisi, kita menghitung seberapa bervariasi nilai-nilai piksel dalam jendela tersebut.

Daerah dengan variansi atau standar deviasi lokal tinggi menunjukkan adanya perubahan intensitas yang tajam dan tidak merata, yang merupakan ciri khas dari tekstur kasar atau detail tinggi—seperti permukaan batu, anyaman kain, atau helai daun.

Sebaliknya, area yang halus atau homogen—seperti langit, dinding polos, atau permukaan air—akan memiliki nilai yang rendah karena piksel-pikselnya cenderung seragam.

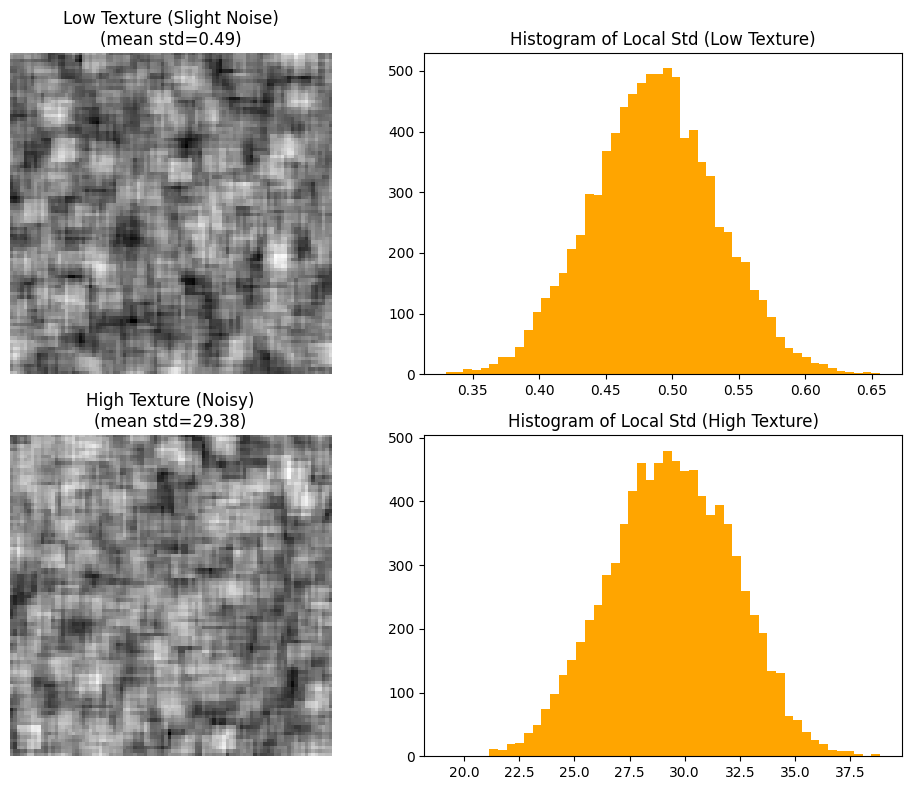

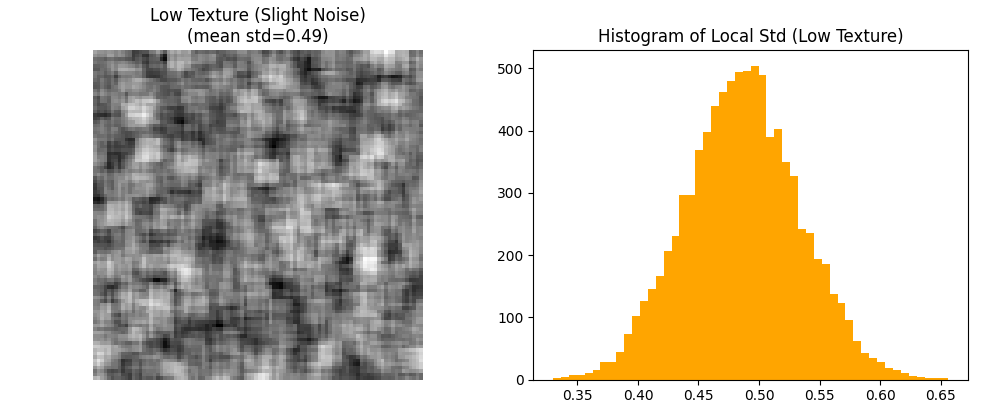

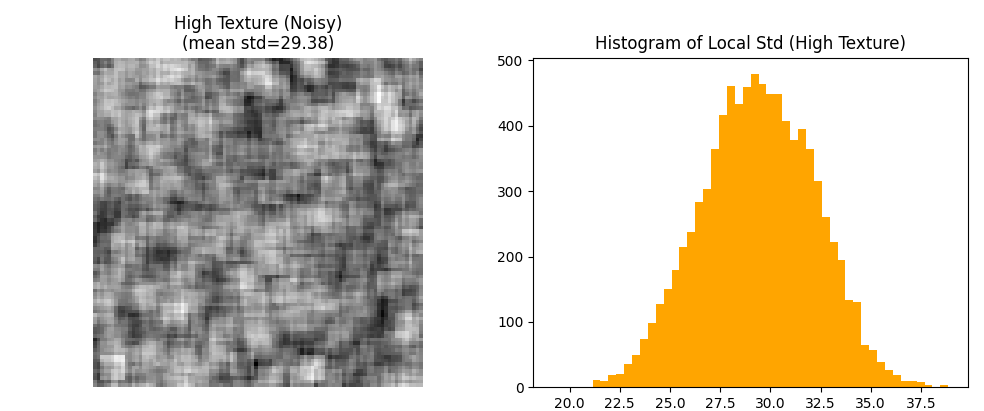

Untuk mempermudah pemahaman, perhatikan gambar visualisasi dari simulasi berikut.

Visualisasi di atas memperlihatkan dua contoh.

- Citra dengan tekstur rendah (sedikit noise) menghasilkan histogram lokal standar deviasi yang sempit dan berpusat pada nilai rendah (mean std ≈ 0.49).

- Citra dengan tekstur tinggi (noisy) memiliki sebaran standar deviasi yang jauh lebih besar (mean std ≈ 29.38), menandakan tingkat keberagaman intensitas yang tinggi.

Dengan pendekatan ini, komputer dapat membedakan area bertekstur dari area datar hanya melalui analisis statistik lokal. Ini mirip dengan mengukur “keberagaman” nilai piksel di suatu wilayah—semakin tinggi keberagamannya, semakin bertekstur area tersebut.

Anda bisa mencoba simulasi di atas dengan menjalankan kode Python berikut pada Google Colab.

- import numpy as np

- import matplotlib.pyplot as plt

-

from numpy.lib.stride_tricks import sliding_window_view

- # Generate two synthetic images (100x100)

- np.random.seed(0)

- # Smooth image now with slight noise (low texture but non-zero std)

- img_smooth = np.random.normal(loc=128, scale=0.5, size=(100, 100))

- # Noisy image (high texture)

-

img_noisy = np.random.normal(loc=128, scale=30, size=(100, 100))

- # Compute local standard deviation with a 7x7 window

- window_size = 7

- def local_std(img):

- w = sliding_window_view(img, (window_size, window_size))

-

return w.std(axis=(2, 3))

- std_smooth = local_std(img_smooth)

-

std_noisy = local_std(img_noisy)

- # Mean std for titles

- mean_s = std_smooth.mean()

-

mean_n = std_noisy.mean()

- # Plotting

-

fig, axes = plt.subplots(2, 2, figsize=(10, 8))

- # Smooth local std map and histogram

- axes[0, 0].imshow(std_smooth, cmap=‘gray’)

- axes[0, 0].set_title(f”Low Texture (Slight Noise)\n(mean std={mean_s:.2f})”)

-

axes[0, 0].axis(‘off’)

- axes[0, 1].hist(std_smooth.flatten(), bins=50, color=‘orange’)

-

axes[0, 1].set_title(“Histogram of Local Std (Low Texture)”)

- # Noisy local std map and histogram

- axes[1, 0].imshow(std_noisy, cmap=‘gray’)

- axes[1, 0].set_title(f”High Texture (Noisy)\n(mean std={mean_n:.2f})”)

-

axes[1, 0].axis(‘off’)

- axes[1, 1].hist(std_noisy.flatten(), bins=50, color=‘orange’)

-

axes[1, 1].set_title(“Histogram of Local Std (High Texture)”)

- plt.tight_layout()

- plt.show()

Kode di atas untuk mengidentifikasi dan membandingkan tekstur dalam citra menggunakan standar deviasi lokal sebagai ukuran statistik penyebaran intensitas piksel di area-area kecil. Mari kita bedah esensi kodenya.

Pembuatan Citra Sintetik

- img_smooth = np.random.normal(loc=128, scale=0.5, size=(100, 100))

- img_noisy = np.random.normal(loc=128, scale=30, size=(100, 100))

img_smooth: citra dengan tekstur rendah (sedikit noise), dibuat dari distribusi normal dengan standar deviasi kecil (scale=0.5).img_noisy: citra dengan tekstur tinggi (banyak noise), dibuat dari distribusi normal dengan standar deviasi besar (scale=30).

Kedua citra berukuran 100 × 100 piksel dan memiliki nilai intensitas pusat di sekitar 128 (abu-abu netral).

Menghitung Standar Deviasi Lokal

- window_size = 7

- def local_std(img):

- w = sliding_window_view(img, (window_size, window_size))

- return w.std(axis=(2, 3))

Fungsi local_std() menggunakan sliding window 7 × 7 untuk setiap piksel (tanpa padding). Untuk setiap jendela, kode menghitung standar deviasi nilai-nilai piksel dalam jendela tersebut. Ini memberi kita peta (map) yang menunjukkan seberapa besar variasi lokal di setiap wilayah gambar.

Visualisasi Citra dan Histogram

- axes[0, 0].imshow(std_smooth, cmap=‘gray’)

- axes[0, 1].hist(std_smooth.flatten(), bins=50, color=‘orange’)

Gambar kiri menunjukkan peta standar deviasi lokal dari citra dengan tekstur rendah. Gambar kanan adalah histogram distribusi nilai standar deviasi—sebagian besar nilainya rendah, mencerminkan area yang seragam.

- axes[1, 0].imshow(std_noisy, cmap=‘gray’)

- axes[1, 1].hist(std_noisy.flatten(), bins=50, color=‘orange’)

Gambar kiri menampilkan peta standar deviasi lokal untuk citra dengan tekstur tinggi. Histogramnya tersebar lebih luas dan memiliki nilai rata-rata lebih tinggi, menandakan keragaman piksel yang besar, tipikal dari tekstur kasar atau noisy.

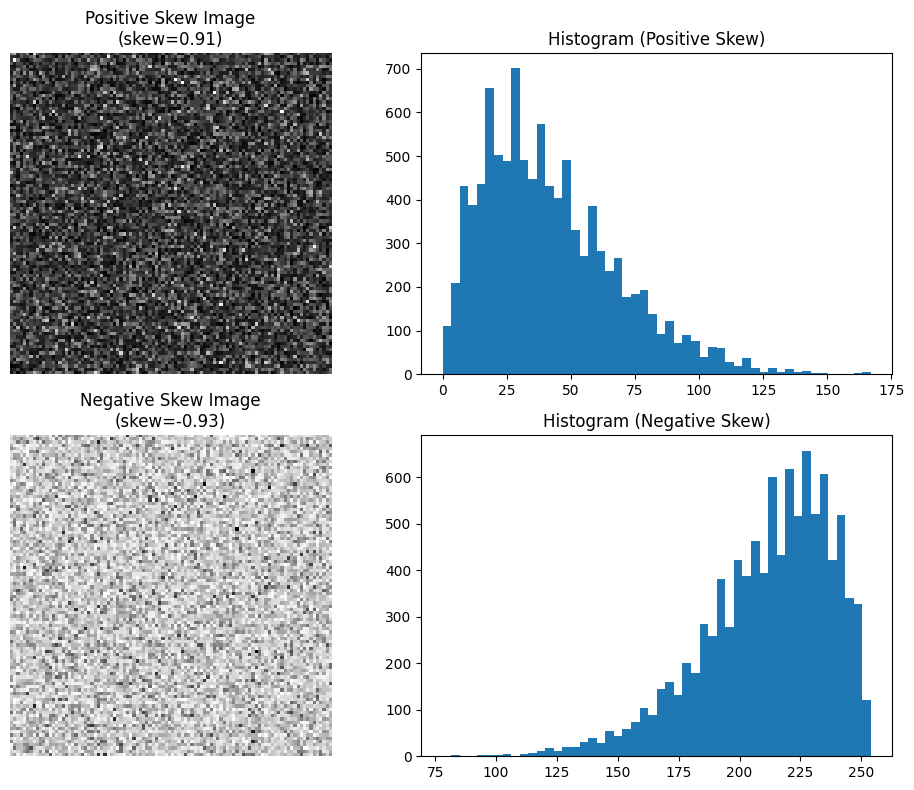

Mendeskripsikan Bentuk Distribusi Intensitas dengan Skewness dan Kurtosis

Untuk mendeskripsikan tekstur secara lebih rinci, kita bisa melangkah lebih jauh dari sekadar variansi dan mulai memperhatikan bentuk distribusi intensitas piksel dalam suatu area menggunakan ukuran statistik, seperti skewness dan kurtosis.

Skewness (Kemiringan Distribusi)

Skewness mengukur seberapa asimetris distribusi nilai intensitas piksel di suatu area. Nilai skewness memberikan informasi tentang kecenderungan distribusi: apakah sebagian besar piksel berada dalam nilai rendah, tinggi, atau seimbang.

- Positive skew (skew > 0): Distribusi condong ke kiri. Artinya, sebagian besar piksel bernilai gelap dengan sedikit piksel terang. Histogram berpuncak di sisi kiri dan memiliki ekor panjang ke kanan.

- Negative skew (skew < 0): Distribusi condong ke kanan. Sebagian besar piksel bernilai terang dengan sedikit piksel gelap. Histogram berpuncak di kanan dan memiliki ekor ke kiri.

Metode ini membantu komputer membedakan tekstur atau pola pencahayaan berdasarkan persebaran intensitas terang-gelap di permukaan suatu objek.

Untuk melakukan simulasi di atas, Anda dapat menjalankan kode berikut pada Google Colab.

- import numpy as np

- import matplotlib.pyplot as plt

-

from scipy.stats import skew

- # Generate two synthetic images (100x100)

- # Positive skew: many dark pixels, few bright

- np.random.seed(0)

-

image_pos = (np.random.beta(a=2, b=10, size=(100, 100)) * 255).astype(int)

- # Negative skew: many bright pixels, few dark

-

image_neg = (np.random.beta(a=10, b=2, size=(100, 100)) * 255).astype(int)

- # Compute skewness

- skew_pos = skew(image_pos.flatten())

-

skew_neg = skew(image_neg.flatten())

- # Plotting

-

fig, axes = plt.subplots(2, 2, figsize=(10, 8))

- # Positive skew image and histogram

- axes[0, 0].imshow(image_pos, cmap=‘gray’)

- axes[0, 0].set_title(f”Positive Skew Image\n(skew={skew_pos:.2f})”)

-

axes[0, 0].axis(‘off’)

- axes[0, 1].hist(image_pos.flatten(), bins=50)

-

axes[0, 1].set_title(“Histogram (Positive Skew)”)

- # Negative skew image and histogram

- axes[1, 0].imshow(image_neg, cmap=‘gray’)

- axes[1, 0].set_title(f”Negative Skew Image\n(skew={skew_neg:.2f})”)

-

axes[1, 0].axis(‘off’)

- axes[1, 1].hist(image_neg.flatten(), bins=50)

-

axes[1, 1].set_title(“Histogram (Negative Skew)”)

- plt.tight_layout()

- plt.show()

Kode di atas membuat dua citra sintetis (100 × 100).

- Positive skew image dihasilkan dari distribusi beta(2, 10), menunjukkan ekor panjang ke kanan.

- Negative skew image menggunakan beta(10, 2) sehingga distribusi terbalik.

Setiap baris subplot menampilkan hal berikut.

- Citra dalam skala abu-abu.

- Histogram frekuensi piksel (memperlihatkan kemiringan distribusi).

- Nilai skewness tercetak di judul citra, memudahkan interpretasi.

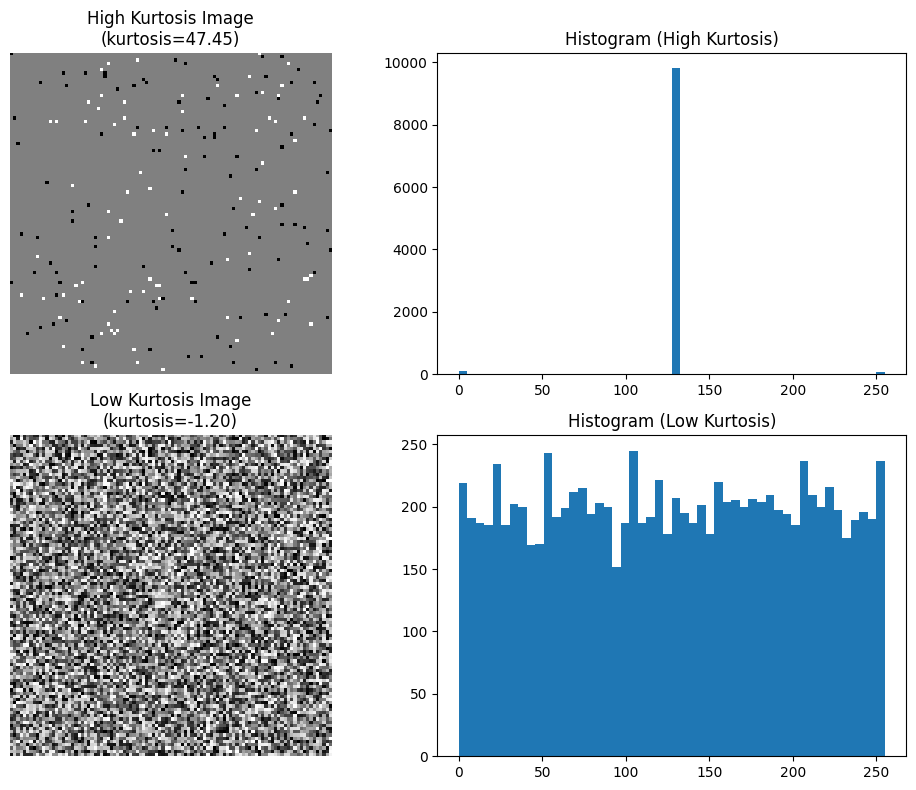

Kurtosis (Keruncingan Distribusi)

Kurtosis mengukur “puncak” atau “kerataan” distribusi nilai piksel di area tertentu. Area dengan kurtosis tinggi (“leptokurtic”) menampilkan distribusi yang sangat runcing—banyak piksel terpusat pada nilai intensitas tertentu dengan beberapa outlier (misal area seragam dengan beberapa bintik kontras tinggi).

Sebaliknya, area dengan kurtosis rendah (“platykurtic”) memiliki distribusi yang lebih datar, yakni saat nilai piksel tersebar merata dalam rentang nilai.

Untuk melakukan simulasi di atas, Anda dapat menjalankan kode berikut pada Google Colab.

- import numpy as np

- import matplotlib.pyplot as plt

-

from scipy.stats import kurtosis

- # Generate two synthetic images (100x100)

-

np.random.seed(1)

- # High kurtosis: mostly constant with few extreme spots

- base = np.full((100, 100), 128, dtype=int)

- num_spots = 200

- coords = (np.random.randint(0, 100, num_spots), np.random.randint(0, 100, num_spots))

-

base[coords] = np.random.choice([0, 255], size=num_spots)

- # Low kurtosis: uniform distribution across range

-

uniform_img = np.random.randint(0, 256, (100, 100))

- # Compute kurtosis

- kurt_high = kurtosis(base.flatten(), fisher=True)

-

kurt_low = kurtosis(uniform_img.flatten(), fisher=True)

- # Plotting

-

fig, axes = plt.subplots(2, 2, figsize=(10, 8))

- # High kurtosis image and histogram

- axes[0, 0].imshow(base, cmap=‘gray’)

- axes[0, 0].set_title(f”High Kurtosis Image\n(kurtosis={kurt_high:.2f})”)

-

axes[0, 0].axis(‘off’)

- axes[0, 1].hist(base.flatten(), bins=50)

-

axes[0, 1].set_title(“Histogram (High Kurtosis)”)

- # Low kurtosis image and histogram

- axes[1, 0].imshow(uniform_img, cmap=‘gray’)

- axes[1, 0].set_title(f”Low Kurtosis Image\n(kurtosis={kurt_low:.2f})”)

-

axes[1, 0].axis(‘off’)

- axes[1, 1].hist(uniform_img.flatten(), bins=50)

-

axes[1, 1].set_title(“Histogram (Low Kurtosis)”)

- plt.tight_layout()

- plt.show()

Kode di atas menghasilkan dua citra sintetis (100 × 100).

- High Kurtosis Image: mayoritas piksel bernilai 128 dengan sedikit titik ekstrem pada nilai 0 atau 255 sehingga histogramnya sangat terpusat dan “runcing” (kurtosis ≈ 47.45).

- Low Kurtosis Image: piksel mengikuti distribusi uniform 0–255, menghasilkan histogram datar (kurtosis ≈ –1.20).

Dengan skewness dan kurtosis, kita mendapatkan gambaran statistik yang lebih kaya tentang cara intensitas piksel terdistribusi dan memberikan petunjuk lebih lanjut tentang karakteristik tekstur.

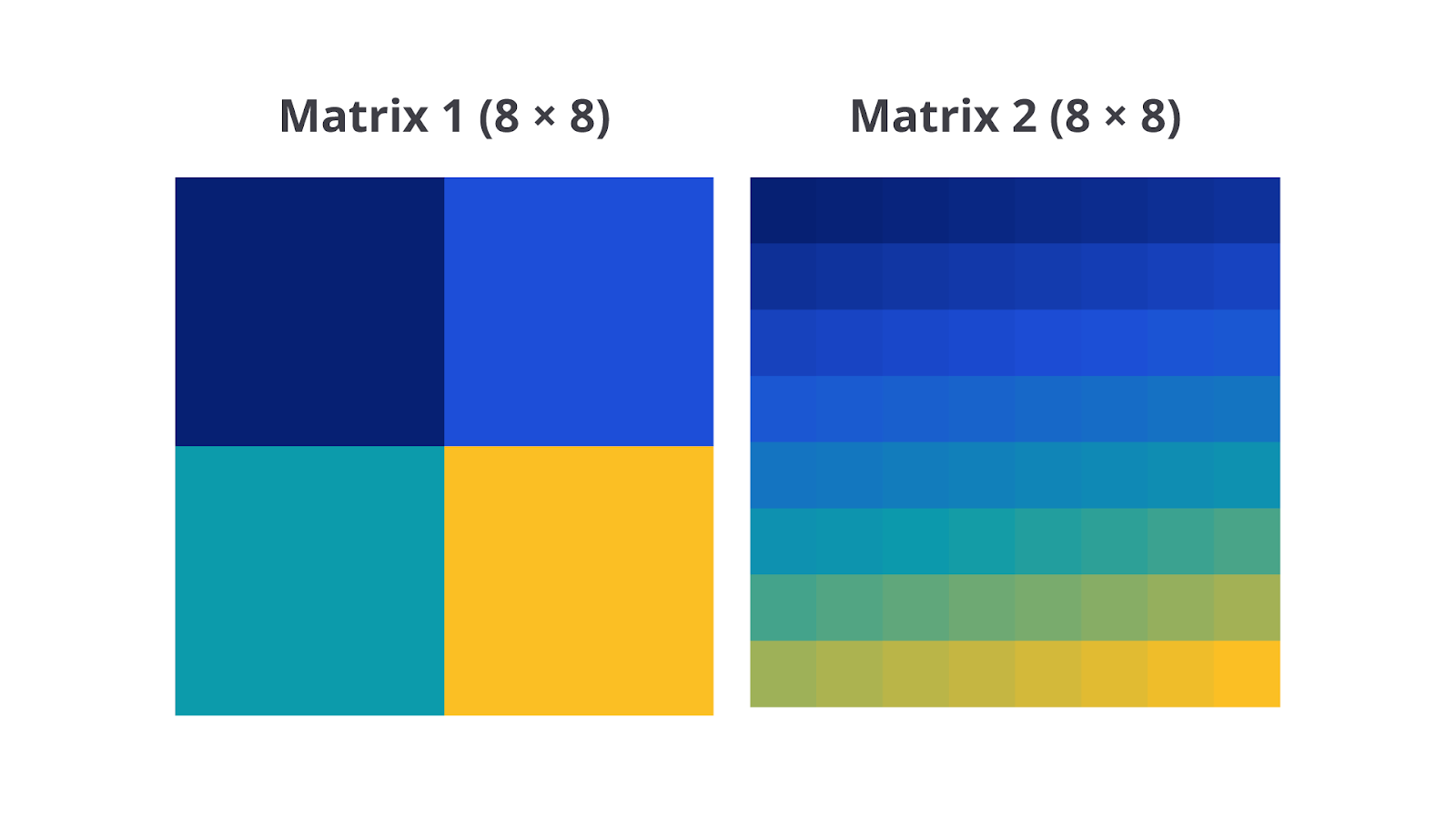

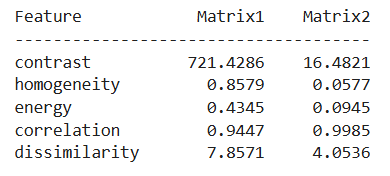

Mengekstraksi Pola Tekstur Kompleks dengan Fitur Haralick dan Matriks GLCM

Untuk mengenali tekstur kompleks dan memiliki pola berulang, metode yang lebih canggih sering digunakan, salah satunya adalah Fitur Haralick. Konsep dasar dari pendekatan ini adalah penggunaan Gray-Level Co-occurrence Matrix (GLCM).

GLCM adalah sebuah tabel statistik yang mencatat seberapa sering pasangan nilai intensitas piksel tertentu muncul bersama dalam citra dengan mempertimbangkan jarak dan arah tertentu.

Misalnya, secara konseptual, kita bisa membayangkan pertanyaan seperti berikut.

- “Berapa kali piksel dengan nilai 100 muncul tepat di sebelah kanan piksel bernilai 150?”

- “Berapa kali piksel bernilai 50 muncul dua langkah di bawah piksel bernilai 200?”

Pertanyaan-pertanyaan ini membantu kita memahami bahwa GLCM menangkap pola kemunculan lokal antar piksel yang membentuk tekstur.

Dari GLCM ini, berbagai fitur statistik yang dikenal sebagai Fitur Haralick dapat dihitung. Ada sekitar 14 fitur standar, masing-masing merepresentasikan karakteristik berbeda dari pola tekstur. Beberapa fitur utamanya berikut.

- Contrast: Mengukur perbedaan intensitas antara piksel-piksel yang berdekatan. Contoh: Tekstur kasar menghasilkan nilai kontras tinggi.

- Homogeneity: Mengukur seberapa dekat nilai-nilai GLCM terhadap diagonal utama. Contoh: Tekstur halus menghasilkan nilai homogenitas tinggi.

- Energy/Angular Second Moment: Mengukur tingkat keseragaman atau keteraturan dalam tekstur. Contoh: Area yang seragam memiliki energi tinggi.

Selain itu masih banyak lagi, yakni Correlation, Entropy, Dissimilarity, dll. Masing-masing menangkap aspek statistik yang berbeda dari pola distribusi piksel dalam ruang.

Fitur Haralick ini banyak digunakan dalam aplikasi nyata, seperti klasifikasi tekstur (misalnya, jenis kain, permukaan logam), deteksi anomali (pada citra medis atau satelit), dan segmentasi citra berbasis pola.

Berikut adalah contoh kode untuk melakukan simulasi dari penggunaan Fitur Haralick. Anda bisa menjalankan kode ini pada Google Colab (Anda perlu menginstal library scikit-image terlebih dahulu).

- import numpy as np

- import pandas as pd

- import matplotlib.pyplot as plt

-

from skimage.feature import graycomatrix, graycoprops

- # Define larger (8x8) example matrices

- matrix1 = np.array([

- [0, 0, 0, 0, 10, 10, 10, 10],

- [0, 0, 0, 0, 10, 10, 10, 10],

- [0, 0, 0, 0, 10, 10, 10, 10],

- [0, 0, 0, 0, 10, 10, 10, 10],

- [100, 100, 100, 100, 200, 200, 200, 200],

- [100, 100, 100, 100, 200, 200, 200, 200],

- [100, 100, 100, 100, 200, 200, 200, 200],

- [100, 100, 100, 100, 200, 200, 200, 200]

-

], dtype=np.uint8)

-

matrix2 = np.linspace(0, 255, 64, dtype=np.uint8).reshape((8, 8))

- # Compute Haralick features

- def compute_haralick(mat, distances=[1], angles=[0]):

- glcm = graycomatrix(mat, distances=distances, angles=angles, levels=256, symmetric=True, normed=True)

- return {

- ’contrast’: graycoprops(glcm, ’contrast’)[0,0],

- ’homogeneity’: graycoprops(glcm, ’homogeneity’)[0,0],

- ’energy’: graycoprops(glcm, ’energy’)[0,0],

- ’correlation’: graycoprops(glcm, ’correlation’)[0,0],

- ’dissimilarity’: graycoprops(glcm, ’dissimilarity’)[0,0]

-

}

- feat1 = compute_haralick(matrix1)

-

feat2 = compute_haralick(matrix2)

- # Plot heatmaps

- fig, axs = plt.subplots(1, 2, figsize=(10, 5))

- axs[0].imshow(matrix1, interpolation=‘nearest’)

- axs[0].set_title(“Matrix 1 (8×8)”)

-

axs[0].axis(‘off’)

- axs[1].imshow(matrix2, interpolation=‘nearest’)

- axs[1].set_title(“Matrix 2 (8×8)”)

-

axs[1].axis(‘off’)

- plt.tight_layout()

-

plt.show()

- # Compute features

- feat1 = compute_haralick(matrix1)

-

feat2 = compute_haralick(matrix2)

- # Print results in a table format

- print(f”{‘Feature’:<15} {‘Matrix1’:>10} {‘Matrix2’:>10}”)

- print(‘-‘ * 37)

- for key in feat1:

- print(f”{key:<15} {feat1[key]:>10.4f} {feat2[key]:>10.4f}”)

Kode di atas digunakan untuk membandingkan dua pola tekstur dengan menggunakan fitur Haralick, yang dihitung dari Gray-Level Co-occurrence Matrix (GLCM).

Pertama, dua buah matriks 8 × 8 dibuat seperti berikut.

matrix1terdiri dari dua blok homogen yang berbeda nilai. Empat baris pertama berisi nilai rendah (0–10) dan empat baris berikutnya berisi nilai tinggi (100–200). Matriks ini menampilkan perubahan tajam antar blok yang menyerupai tekstur kasar.matrix2adalah gradien linier dari 0 hingga 255 yang tersebar merata. Ini merepresentasikan tekstur halus tanpa batas blok yang jelas.

Fungsi compute_haralick() kemudian melakukan hal berikut.

- Menghitung GLCM pada jarak 1 piksel dalam arah horizontal (

angle = 0) dengan nilai piksel berada dalam rentang 0–255 (levels=256). - Menormalisasi GLCM.

- Mengekstraksi lima metrik Haralick utama.

contrast– perbedaan intensitas antar piksel bertetangga.homogeneity– seberapa dekat nilai GLCM terhadap diagonal utama.energy– tingkat keseragaman tekstur.correlation– hubungan linier antar nilai piksel.dissimilarity– perbedaan absolut antar nilai piksel tetangga.

Visualisasi dua matriks ditampilkan sebagai heatmap, sedangkan hasil perhitungan fitur ditampilkan dalam bentuk tabel agar mudah dibandingkan. Hasilnya menunjukkan hal berikut.

- Struktur blok yang tajam pada matrix1 menghasilkan kontras dan dissimilarity yang tinggi, serta homogeneity yang rendah.

- Gradien halus pada matrix2 cenderung menghasilkan nilai fitur lebih seimbang dan menggambarkan perubahan tekstur yang lebih lembut.

Akhirnya, nilai-nilai Fitur Haralick dari masing-masing matriks dicetak dalam bentuk tabel ringkas. Dengan membandingkan hasilnya, kita dapat langsung melihat bahwa struktur blok tajam pada matrix1 menghasilkan nilai kontras serta dissimilarity yang tinggi, sementara gradasi lembut pada matrix2 menghasilkan fitur lebih rendah dan homogen. Hal ini menunjukkan bahwa perbedaan visual dalam pola tekstur dapat diukur secara objektif menggunakan statistik dari GLCM.

Fitur Haralick memungkinkan computer vision untuk mengenali pola tekstur yang kompleks, berulang, dan tidak teratur—sesuatu yang tidak dapat ditangkap hanya dengan statistik dasar, seperti variansi, skewness, atau histogram piksel.

Dengan pendekatan ini, komputer dapat membedakan berbagai jenis permukaan yang tampak serupa secara warna, tapi berbeda secara pola, seperti berikut.

- Serat kayu yang memiliki arah dan ketebalan tertentu.

- Pola batu bata yang bersifat periodik dan kontras.

- Tekstur kulit yang acak, tapi khas.

Melalui pendekatan ini, kita dapat menghitung pola tekstur secara statistik dan memahami perbedaan visual dalam citra tecermin pada nilai-nilai Fitur Haralick.

Anda bisa akses kode lengkap yang dijelaskan dalam topik computer vision pada link berikut: Modul 6 - Computer Vision.ipynb

Matematika dalam Natural Language Processing (NLP)

Setelah memahami bahwa data numerik dianalisis secara statistik, kini saatnya kita berhadapan dengan jenis data yang lain, yang lebih kompleks, tapi juga sangat menarik, yaitu teks.

Anda mungkin bertanya-tanya, bagaimana mungkin mesin bisa memahami bahasa manusia yang penuh makna, nuansa, dan konteks? Kita saja sebagai manusia kadang harus bertanya dua kali untuk memahami maksud seseorang. Jadi, bagaimana caranya mesin bisa “mengerti”?

Ternyata, mesin tidak benar-benar “mengerti” seperti manusia. Namun, mereka bisa belajar dari pola dan caranya belajar adalah dengan menghitung. Statistik menjadi alat utama bagi sistem untuk memahami teks, bukan lewat arti kata dalam kamus, melainkan dari seberapa sering kata itu muncul, pada konteks apa, dan hubungannya dengan kata-kata lain.

Dalam materi ini, kita akan menyelami cara-cara sistem komputer mengekstrak fitur dari teks, mulai yang paling sederhana, seperti menghitung kemunculan kata, hingga metode yang bisa menangkap hubungan semantik yang lebih halus, seperti TF-IDF dan Word Embeddings.

Hal yang menarik, semua itu berpijak pada prinsip-prinsip statistik yang sudah Anda kenal.

Matematika dalam Natural Language Processing (NLP): Pengenalan

Natural language processing (NLP) adalah sebuah cabang menarik dari artificial intelligence (AI) yang berfokus pada cara komputer dapat memahami, menginterpretasi, dan bahkan menghasilkan bahasa manusia, baik itu teks tertulis maupun ucapan.

Tujuan utama NLP adalah menjembatani kesenjangan antara cara manusia berkomunikasi secara alami dengan cara komputer memproses informasi. Bayangkan komputer Anda bisa membaca sebuah berita, meringkasnya, lalu menjawab pertanyaan tentang isinya. Atau bisa mendengarkan perintah suara Anda, memahami maksudnya, dan melaksanakannya.

Inilah inti dari NLP: memberikan kemampuan “berbahasa” kepada mesin. Bahasa manusia itu rumit—penuh dengan ambiguitas, metafora, dan aturan yang fleksibel. NLP berupaya mengajarkan komputer untuk mengatasi kerumitan ini sehingga memungkinkannya berinteraksi dengan manusia secara lebih intuitif dan cerdas.

Sebelum sebuah sistem bisa memahami bahasa manusia, ia perlu tahu dulu cara “membaca” teks sebagai data. Namun, tidak seperti manusia yang bisa memahami makna kata berdasarkan pengalaman dan intuisi, komputer tidak punya kemampuan itu. Ia buta terhadap makna, nada, emosi, atau konteks. Hal yang bisa komputer lakukan hanyalah menghitung dan justru dari proses menghitung inilah muncul kemampuan dasar untuk “memahami” bahasa secara statistik.

Langkah awal ini penting karena dari sinilah semua proses lanjutan dibangun. Sebelum bisa berbicara tentang semantik, konteks, atau prediksi, kita harus mulai dari mengenali bahwa kata adalah bagian terkecil dari informasi dalam teks dan kemunculan kata bisa dihitung serta dijadikan dasar untuk mengenali pola.

Matematika dalam Natural Language Processing (NLP): Visualisasi Distribusi Kata dengan WordCloud

Distribusi kata mengacu pada cara kata-kata tertentu muncul dalam teks atau koleksi dokumen. Dengan memvisualisasikan distribusi kata, kita dapat dengan mudah memahami kata-kata yang sering muncul dalam teks dan yang jarang digunakan. Salah satu cara yang paling efektif untuk menggambarkan distribusi kata dalam teks adalah melalui WordCloud.

Apa itu WordCloud?

WordCloud adalah representasi grafis dari teks bahwa kata-kata yang lebih sering muncul dalam teks akan ditampilkan dengan ukuran lebih besar. Sebaliknya, kata-kata yang jarang muncul akan memiliki ukuran font lebih kecil.

WordCloud adalah salah satu teknik visualisasi yang sangat berguna dalam natural language processing (NLP) untuk memberikan gambaran umum tentang frekuensi kata pada sebuah teks atau kumpulan dokumen.

WordCloud sering digunakan dalam berbagai aplikasi seperti berikut.

- Analisis Sentimen: Untuk memvisualisasikan kata-kata yang sering digunakan dalam teks dengan sentimen positif atau negatif.

- Pencarian Informasi: Untuk mengetahui kata-kata kunci atau topik dominan dalam koleksi dokumen.

- Penyajian Data Teks: Membantu dalam presentasi data teks dengan cara yang mudah dipahami dan menarik.

Bagaimana WordCloud Mencerminkan Distribusi Kata?

Distribusi kata merujuk pada frekuensi kemunculan kata dalam sebuah teks atau koleksi teks. Dalam visualisasi WordCloud, distribusi kata ini digambarkan melalui ukuran font kata. Kata-kata yang sering muncul dalam teks akan memiliki font lebih besar, sementara kata-kata yang muncul lebih jarang akan tampil dengan ukuran font lebih kecil.

Berikut adalah proses visualisasi distribusi kata menggunakan WordCloud.

- Menghitung frekuensi kata: Setiap kata dalam dokumen dihitung dengan seberapa sering muncul.

- Memetakan frekuensi ke ukuran font: Kata dengan frekuensi tinggi akan diberi ukuran font besar, sedangkan kata dengan frekuensi rendah akan diberi ukuran kecil.

- Menampilkan visualisasi: WordCloud akan menampilkan kata-kata dalam bentuk gambar, yaitu kata-kata yang lebih sering muncul akan lebih dominan secara visual.

Manfaat Penggunaan WordCloud

Visualisasi distribusi kata dengan WordCloud memiliki banyak manfaat dalam konteks NLP, terutama untuk eksplorasi data dan analisis teks, antara lain berikut.

- Pengenalan Kata Kunci

WordCloud dapat memberikan gambaran sekilas tentang kata-kata kunci dalam teks atau dokumen. Kata-kata yang muncul dengan ukuran besar adalah kata-kata yang dianggap paling penting atau dominan dalam teks tersebut. - Identifikasi Tema atau Topik Dominan

Dengan menganalisis WordCloud, kita dapat dengan mudah mengidentifikasi tema atau topik yang sering dibicarakan dalam kumpulan dokumen. Misalnya, dalam koleksi artikel berita, kata-kata yang sering muncul akan memberikan petunjuk tentang topik utama dalam berita tersebut. - Memudahkan Eksplorasi Teks

WordCloud adalah alat yang sangat berguna untuk eksplorasi data teks secara cepat dan mudah dipahami. Ini memungkinkan kita untuk melihat pola atau hubungan antara kata-kata yang mungkin sulit dilihat hanya dengan analisis numerik atau statistik. - Memvisualisasikan Perubahan dalam Data Teks

WordCloud juga dapat digunakan untuk memvisualisasikan perubahan dalam distribusi kata dari waktu ke waktu. Misalnya, jika memiliki koleksi dokumen atau tweet yang terorganisasi berdasarkan waktu, kita dapat membuat WordCloud untuk setiap periode waktu dan melihat kata-kata yang lebih menonjol.

Membuat WordCloud dengan Python

Setelah memahami pengertian, cara kerja, dan manfaat dari penggunaan WordCloud, sekarang kita coba praktikkan pembuatan WordCloud dalam bahasa pemrograman Python. Anda bisa ikuti dengan menjalankan kode pada Google Colab.

Berikut adalah langkah-langkah untuk membuat WordCloud dengan Python.

Langkah 1: Impor Library

Hal pertama yang perlu dilakukan adalah mengimpor library yang dibutuhkan. Untuk membuat WordCloud dengan Python, kita dapat menggunakan library Matplotlib dan WordCloud.

- import matplotlib.pyplot as plt

- from wordcloud import WordCloud

Langkah 2: Menyiapkan Data Teks

Anda bisa menggunakan teks dari dokumen atau kumpulan ulasan, berita, atau sentimen. Kita akan gunakan contoh data statis berupa daftar ulasan pembelajaran matematika dari siswa seperti berikut.

- # Daftar ulasan

- reviews = [

- ”Saya suka belajar Matematika.”,

- ”Belajar matematika menyenangkan.”,

- ”Matematika itu menyenangkan.”,

- ”Belajar matematika sangat penting.”,

- ”Matematika adalah ilmu dasar.”

- ]

Kumpulan kalimat disimpan dalam list reviews. Kalimat-kalimat ini merepresentasikan opini atau pernyataan pengguna tentang topik tertentu (dalam hal ini: matematika).

Langkah 3: Menggabungkan Kalimat Menjadi Satu String

Untuk membuat WordCloud, semua teks digabungkan menjadi satu string panjang.

- # Gabungkan semua ulasan menjadi satu string untuk WordCloud

- combined_reviews = “ “.join(reviews)

Metode .join() menggabungkan elemen list reviews dengan spasi sebagai pemisah antar kalimat.

Langkah 4: Membuat WordCloud

Setelah datanya siap, sekarang saatnya kita generate WordCloud dengan kode berikut.

- # Membuat WordCloud

- wordcloud = WordCloud(width=800, height=400, background_color=‘white’).generate(combined_reviews)

Berikut detail penjelasannya.

WordCloud()adalah objek dari librarywordcloudyang digunakan untuk menghasilkan visualisasi.- Parameter

widthdanheightmenentukan ukuran kanvas gambar. background_color='white'menjadikan latar belakang Word Cloud berwarna putih..generate(combined_reviews)membuat visualisasi berdasarkan string gabungan yang sudah disiapkan.

Langkah 5: Menampilkan WordCloud

Langkah terakhir adalah bagian yang menyenangkan, yakni saatnya kita menampilkan visualisasi dari WordCloud yang tadi dibuat.

- # Menampilkan WordCloud

- plt.figure(figsize=(10, 5))

- plt.imshow(wordcloud, interpolation=‘bilinear’)

- plt.axis(‘off’) # Menyembunyikan axis

- plt.show()

Berikut detail penjelasannya.

plt.figure()menentukan ukuran figur tampilan.plt.imshow()menampilkan gambar WordCloud.interpolation='bilinear'memperhalus tampilan visual.plt.axis('off')menyembunyikan sumbu agar hasil tampak lebih bersih.plt.show()menampilkan hasil akhir pada layar.

Inilah tampilan visualisasi dari WordCloud yang kita buat.

Kita bisa lihat bahwa dalam contoh ini, kata “Matematika”, “Belajar”, dan “menyenangkan” tampil lebih besar karena sering muncul pada ulasan.

Dengan memperhitungkan frekuensi kata dalam sebuah dokumen atau kumpulan dokumen, WordCloud memungkinkan kita untuk melihat secara langsung kata-kata yang lebih dominan atau penting. Ini sangat berguna dalam eksplorasi data, analisis sentimen, pencarian informasi, dan aplikasi NLP lainnya.

Dengan menggunakan WordCloud, kita dapat mengidentifikasi kata kunci atau topik utama dalam kumpulan teks, serta melihat perubahan distribusi kata dari waktu ke waktu atau antar dokumen. Teknik visualisasi ini memungkinkan kita untuk lebih mudah memahami pola-pola dalam data teks besar.

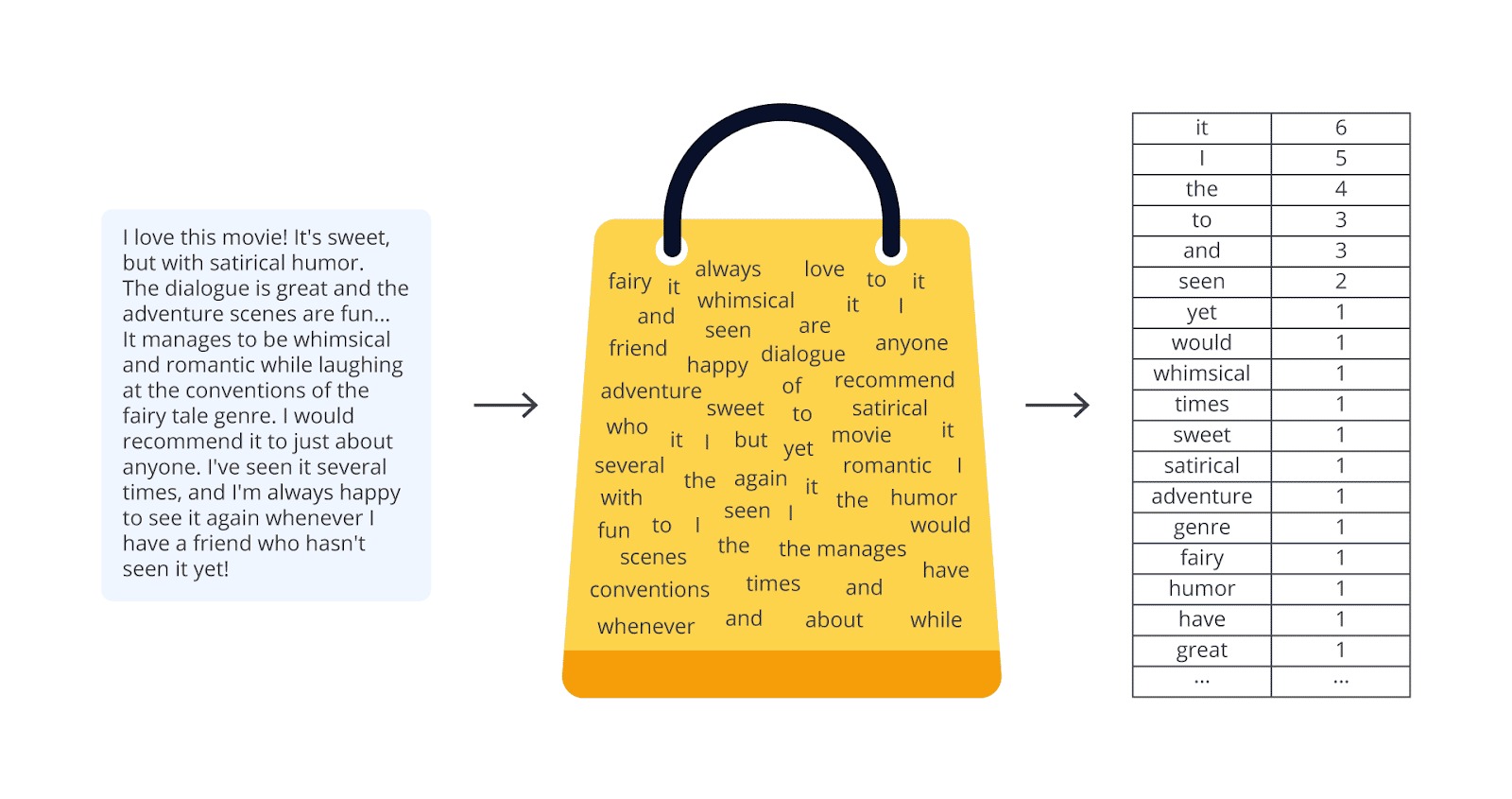

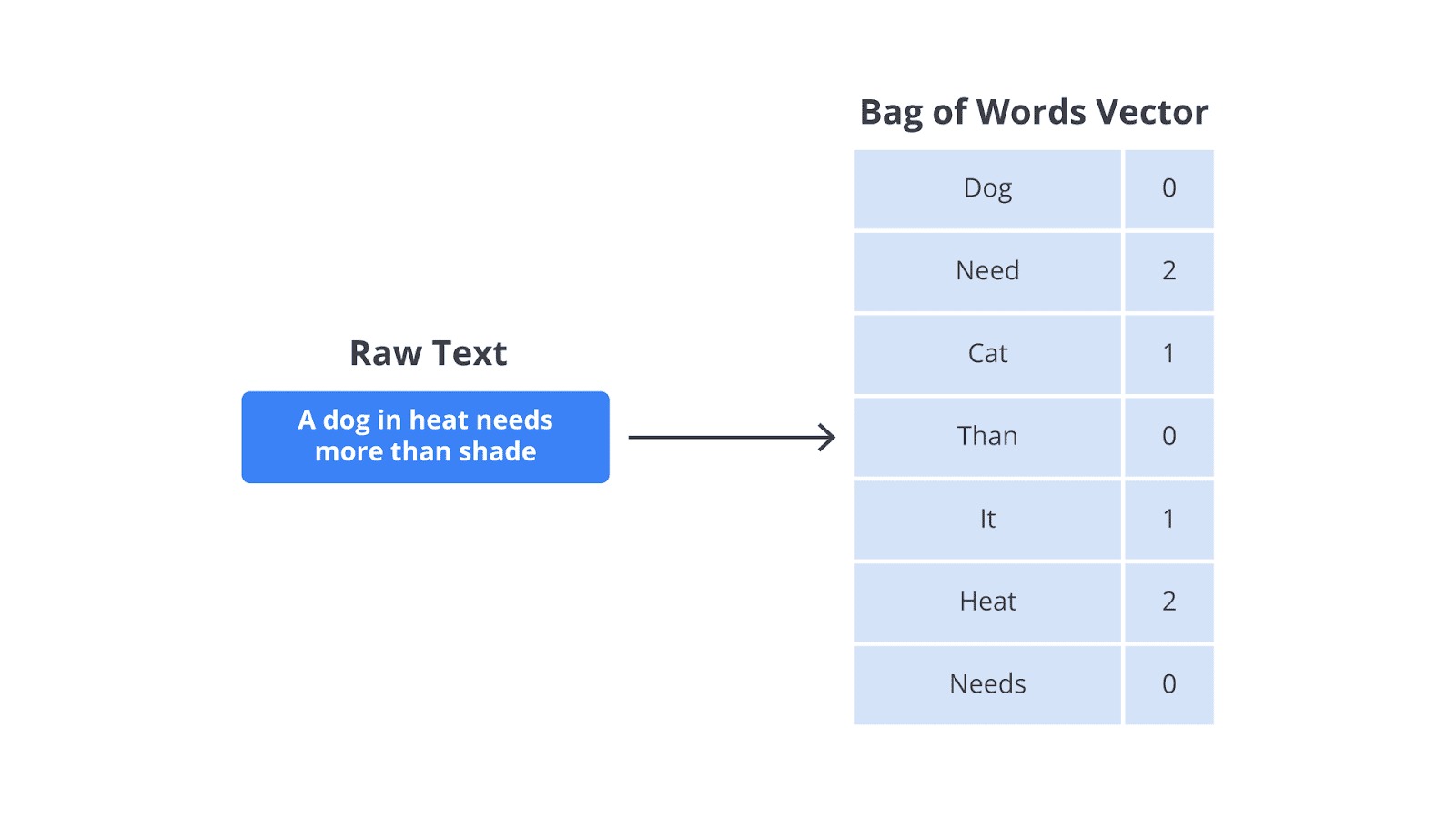

Matematika dalam Natural Language Processing (NLP): Representasi Frekuensi Kata (Bag-of-Words)

Dalam dunia natural language processing (NLP), salah satu tantangan terbesar adalah membuat komputer memahami bahasa manusia.

Komputer, pada dasarnya, hanya mengerti angka. Jadi, jika ingin komputer menganalisis ulasan pelanggan, email, atau berita, kita harus mengubah teks-teks itu menjadi format numerik yang bisa diolah.

Di sinilah teknik Bag of Words (BoW) berperan sebagai salah satu metode paling sederhana dan paling awal untuk melakukan “terjemahan” ini.

Apa itu Bag of Words?

Bayangkan Bag of Words ini seperti sebuah tas belanja. Ketika Anda memasukkan bahan-bahan makanan ke tas, Anda mungkin tidak peduli dengan urutan memasukkannya. Hal yang penting adalah bahan dalam tas itu dan jumlah dari setiap jenis bahan yang Anda punya.

Konsep yang sama berlaku untuk BoW: kita hanya peduli kata dalam sebuah dokumen teks dan jumlah kemunculan masing-masing kata itu, tanpa memedulikan urutan atau konteks gramatikalnya.

Oleh karena itu, metode ini disebut “Bag of Words” karena mirip seperti kita melihat isi tas—kita hanya peduli tentang “apa” yang ada di dalamnya, bukan “bagaimana” urutannya.

Bag of Words adalah pendekatan sederhana untuk merepresentasikan teks sebagai vektor angka berdasarkan frekuensi kemunculan kata dalam kumpulan dokumen.

Dalam konteks ini, setiap kata unik yang muncul pada semua ulasan disebut sebagai fitur (feature). Setiap teks diubah menjadi sebuah vektor yang menyatakan jumlah setiap kata muncul dalam ulasan tersebut.

Metode ini disebut “bag” karena struktur kalimat diabaikan dan urutan kata tidak diperhatikan; yang penting hanyalah keberadaan serta frekuensi kata.

Tujuan utama BoW adalah menghasilkan fitur numerik dari dokumen teks sehingga teks tersebut dapat diaplikasikan pada berbagai algoritma machine learning. Algoritma seperti Naïve Bayes, support vector machine (SVM), atau decision tree tidak bisa langsung bekerja dengan teks mentah. Mereka butuh angka.

Dalam metode BoW, setiap kata unik yang ditemukan dalam seluruh koleksi dokumen (sering disebut korpus) akan dianggap sebagai fitur tersendiri. Kemudian, untuk setiap dokumen, kita akan menghitung frekuensi (berapa kali) setiap kata unik tersebut muncul.

Hasilnya, setiap dokumen akan direpresentasikan sebagai sebuah vektor (barisan angka), yakni setiap elemen pada vektor tersebut menunjukkan frekuensi kemunculan kata tertentu dalam dokumen itu.

Metode ini sangat sering digunakan dalam tugas-tugas seperti klasifikasi teks, contohnya untuk menentukan jika sebuah ulasan bersifat positif atau negatif, atau lainnya untuk mengetahui bahwa sebuah email adalah spam atau bukan.

Cara Kerja Bag of Word

Untuk memahami cara kerja metode bag of words, mari kita mulai dengan sebuah contoh sederhana dan relevan. Bayangkan Anda adalah seorang analis yang ingin mengklasifikasikan ulasan siswa tentang pembelajaran matematika dalam dua kategori: “positif” atau “negatif” berdasarkan isi teks ulasannya.

Berikut adalah beberapa contoh ulasan yang berhasil dikumpulkan.

- Ulasan 1: “Saya suka belajar Matematika.”

- Ulasan 2: “Belajar matematika menyenangkan.”

- Ulasan 3: “Matematika itu menyenangkan.”

- Ulasan 4: “Belajar matematika sangat penting.”

- Ulasan 5: “Matematika adalah ilmu dasar.”

Namun, agar dapat dianalisis oleh komputer—terutama oleh algoritma machine learning—teks harus diubah dalam format numerik karena komputer tidak memahami makna bahasa seperti manusia. Di sinilah metode Bag of Words (BoW) berperan.

Untuk menerapkan metode Bag of Words, kita perlu melalui beberapa tahapan penting. Mari kita uraikan langkah-langkahnya berdasarkan contoh ulasan yang sudah dikumpulkan sebelumnya.

Menyusun Kosakata Unik (Vocabulary)

Langkah pertama adalah menyusun daftar kosakata unik yang muncul dalam seluruh kumpulan ulasan. Disebut “unik” karena setiap kata hanya dicatat satu kali meskipun muncul pada beberapa ulasan atau berulang kali dalam satu dokumen.

Dari lima ulasan yang dimiliki, kita memperoleh 11 kata unik, yaitu berikut.

‘adalah’, ‘belajar’, ‘dasar’, ‘ilmu’, ‘itu’, ‘matematika’, ‘menyenangkan’, ‘penting’, ‘sangat’, ‘saya’, ‘suka’

Kosakata ini akan menjadi fitur-fitur (kolom) dalam tabel representasi numerik.

Menghitung Frekuensi Kemunculan Kata per Dokumen

Setelah memiliki kosakata, kita menghitung jumlah setiap kata muncul dalam masing-masing ulasan.

- Jika sebuah kata muncul, kita beri nilai sesuai dengan frekuensinya (contohnya: 1 jika muncul satu kali).

- Jika tidak muncul, nilainya adalah 0.

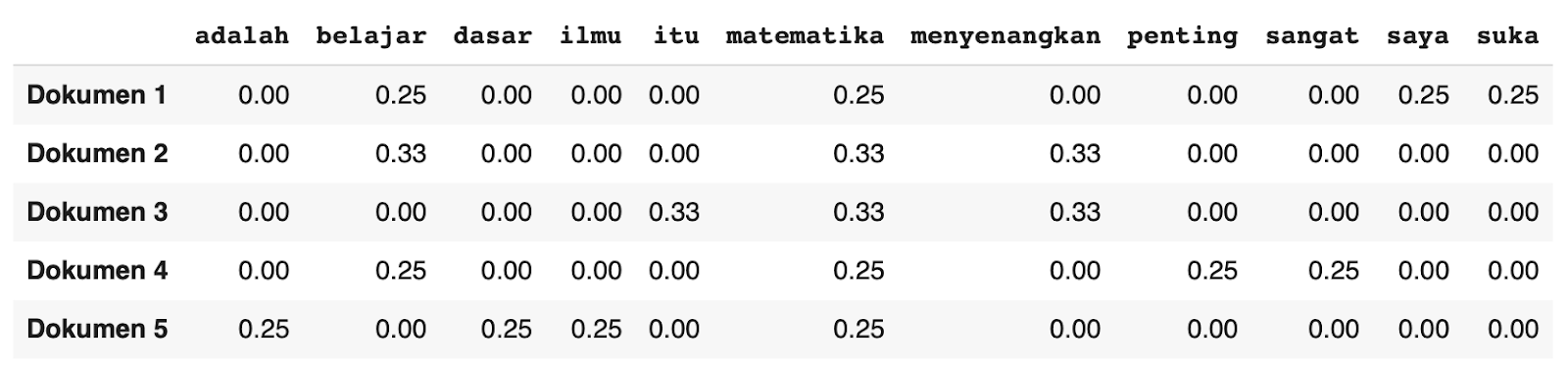

Dengan cara ini, kita memperoleh tabel representasi dokumen, seperti gambar berikut.

Setiap baris mewakili satu ulasan dan setiap kolom merepresentasikan sebuah kata dari kosakata. Misalnya berikut.

Ulasan ke-1 (“Saya suka belajar matematika”) direpresentasikan sebagai [0, 1, 0, 0, 0, 1, 0, 0, 0, 1, 1]

Merepresentasikan Dokumen sebagai Vektor

Dari tabel tersebut, setiap ulasan kini telah berubah menjadi sebuah vektor angka.

Inilah inti dari metode Bag of Words—mengubah teks menjadi representasi numerik berdasarkan frekuensi kata.

Vektor-vektor ini kemudian dapat digunakan oleh algoritma machine learning, seperti Naive Bayes, logistic regression, atau SVM untuk menganalisis dan mempelajari pola dari ulasan yang bersifat positif ataupun negatif.

Metode Bag of Words adalah pendekatan yang sederhana, tapi efektif untuk mengubah teks menjadi data numerik.

Meski tidak memperhatikan struktur atau urutan kata, metode ini mampu menangkap informasi penting dari keberadaan dan jumlah kata, yang cukup untuk banyak kasus klasifikasi teks dasar.

Implementasi BoW dengan Python

Pada bagian sebelumnya, kita sudah belajar konsep dan cara melakukan perhitungan manual menggunakan metode Bag of Words. Agar kemampuan kita semakin baik, pada bagian ini akan disajikan contoh implementasi metode BoW menggunakan bahasa pemrograman Python.

Untungnya, kita tidak perlu menulis kode dari nol untuk menghitung frekuensi kata dan membuat vektor. Library scikit-learn pada Python menyediakan alat yang sangat praktis untuk ini, yaitu CountVectorizer.

- from sklearn.feature_extraction.text import CountVectorizer

-

import pandas as pd

- # Data ulasan

- reviews = [“Saya suka belajar Matematika.”,

- ”Belajar matematika menyenangkan.”,

- ”Matematika itu menyenangkan.”,

- ”Belajar matematika sangat penting.”,

- ”Matematika adalah ilmu dasar.”

-

]

- # Membuat objek CountVectorizer

-

vectorizer = CountVectorizer()

- # Menghitung representasi BoW

-

X = vectorizer.fit_transform(reviews)

- # Menampilkan hasilnya dalam bentuk array

-

bow_array = X.toarray()

- # Menampilkan kata-kata dalam BoW

-

words = vectorizer.get_feature_names_out()

- # Menampilkan hasil representasi BoW

- print(“Kata-kata dalam BoW:”, words)

- print(“jumlah kata dalam bow:”, len(words))

- print(“Representasi BoW:”)

-

bow_array

- # Menampilkan hasilnya dalam bentuk array dan konversi ke DataFrame

- bow_array = X.toarray()

-

words = vectorizer.get_feature_names_out()

- # Membuat DataFrame dari BoW

- df_bow = pd.DataFrame(bow_array, columns=words)

- df_bow

Berikut adalah penjelasan singkat dan padat tentang kode di atas.

- Data ulasan: Kumpulan lima ulasan yang akan diproses menjadi representasi Bag of Words (BoW).

- CountVectorizer: Digunakan untuk mengubah teks menjadi representasi BoW dengan menghitung frekuensi kemunculan kata-kata unik dalam ulasan.

- fit_transform(): Menghitung dan mengubah ulasan menjadi vektor BoW.

- toarray(): Mengonversi hasil BoW yang berupa matriks sparse menjadi array biasa.

- get_feature_names_out(): Mengambil daftar kata-kata unik yang ditemukan dalam semua ulasan.

- pandas DataFrame: Hasil BoW disimpan dalam bentuk DataFrame untuk memudahkan pembacaan serta analisis lebih lanjut dengan kolom-kolom berupa kata-kata dan baris berupa ulasan.

Oke, kini Anda sudah mengetahui cara mengimplementasikan bag-of-word dalam bahasa pemrograman Python. Luar biasa!

Pertimbangan Penggunaan BoW

Ada hal yang perlu Anda perhatikan saat berinteraksi dengan BoW, yaitu ia tidak peduli pada urutan kata dalam sebuah kalimat atau dokumen. Metode ini hanya menghitung keberadaan serta frekuensi kata sehingga struktur kalimat dan hubungan antar kata diabaikan.

Misalkan ada dua kalimat ini: “Ilham mengejar Rina” dan “Rina mengejar Ilham”. Dalam konteks bahasa manusia, kedua kalimat ini memiliki arti yang sangat berbeda karena subjek dan objeknya bertukar posisi. Namun, bagi BoW, kedua kalimat ini akan direpresentasikan oleh vektor yang identik (jika hanya menghitung frekuensi kata) sebab keduanya mengandung kata-kata yang sama (“Ilham”, “mengejar”, “Rina”) dengan frekuensi sama.

Lebih jauh lagi, metode Bag of Words memiliki keterbatasan dalam menangkap nuansa makna yang bergantung pada susunan kata atau kehadiran kata negasi. Misalnya, bandingkan kalimat berikut.

- “Saya suka film ini”

- “Saya tidak suka film ini”

Secara struktur, kedua kalimat memiliki kata-kata yang hampir sama. Namun, jika kata “tidak” tak ada dalam kosakata (misalnya karena dihapus saat pra-pemrosesan), Bag of Words akan menganggap kedua kalimat tersebut sangat mirip secara numerik, padahal maknanya justru berlawanan secara emosional.

Hal ini menunjukkan bahwa Bag of Words tidak mempertimbangkan konteks, urutan kata, atau relasi antar kata sehingga kesulitan dalam memahami hal berikut.

- Negasi (“tidak suka” ≠ “suka”)

- Sarkasme

- Perubahan makna karena struktur kalimat

Akibatnya, representasi BoW tidak mampu menangkap makna semantik yang lebih dalam dari teks.

Matematika dalam Natural Language Processing (NLP): TF-IDF: Memberi Bobot Kata

Kita telah memahami bahwa metode Bag of Words (BoW) mengubah teks menjadi vektor numerik berdasarkan frekuensi kata. BoW adalah fondasi yang baik, tetapi kita juga telah mengidentifikasi beberapa kelemahan utamanya.

- Tidak Mempertimbangkan Urutan Kata: BoW tidak menangkap konteks atau makna yang berubah karena susunan kata (misalnya, “saya suka” vs. “suka saya”).

- Masalah Dimensi Tinggi dan Sparsity: Untuk kosakata yang sangat besar, vektor menjadi sangat panjang dan sebagian besar isinya nol. Ini akan memakan banyak memori dan komputasi.

- Tidak Membedakan Kata Penting dari Kata Umum: Kata-kata yang sangat sering muncul (seperti “dan”, “di”, “yang”) dianggap sama pentingnya dengan kata-kata spesifik yang lebih informatif hanya karena frekuensinya tinggi.

Nah, untuk mengatasi ketiga kelemahan ini, hadirlah teknik yang lebih canggih, tapi tetap berbasis frekuensi: TF-IDF (Term Frequency-Inverse Document Frequency).

Konsep Inti TF-IDF: Menilai Pentingnya Kata dalam Konteks

TF-IDF (Term Frequency-Inverse Document Frequency) adalah teknik pembobotan kata yang populer dalam pencarian informasi dan text mining. Tujuannya adalah menilai seberapa penting suatu kata dalam sebuah dokumen, relatif terhadap seluruh kumpulan dokumen (korpus).

TF-IDF bekerja dengan memberikan bobot numerik kepada setiap kata dalam dokumen. Semakin tinggi bobot TF-IDF sebuah kata, semakin relevan atau unik kata tersebut bagi dokumen itu dalam konteks korpus yang lebih besar.

Komponen TF-IDF

TF-IDF terdiri dari dua komponen utama sebagai berikut.

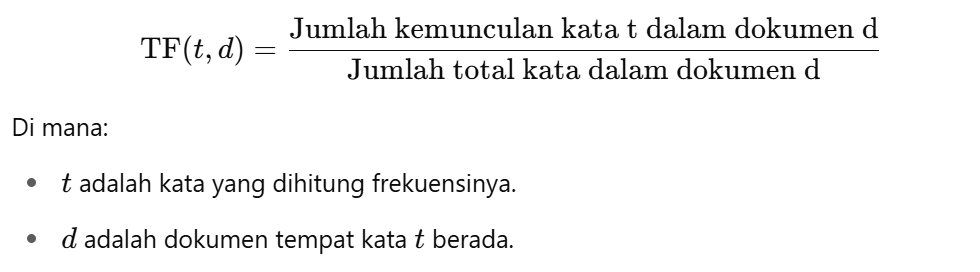

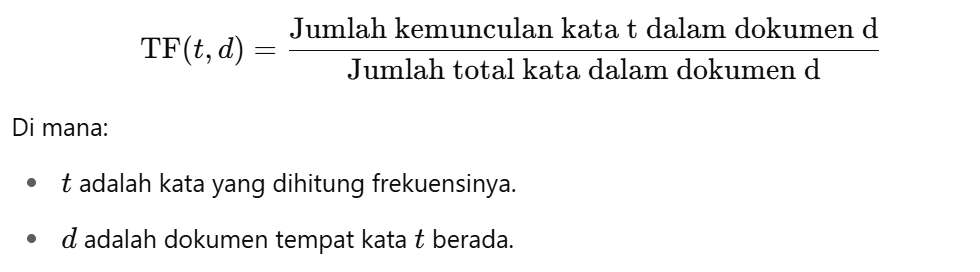

Term Frequency (TF)

TF mengukur seberapa sering sebuah kata (atau term) muncul dalam satu dokumen spesifik. Semakin sering sebuah kata muncul dalam dokumen, semakin tinggi nilai TF-nya, yang mengindikasikan bahwa kata tersebut mungkin penting untuk dokumen itu.

Jika sebuah kata muncul berkali-kali dalam sebuah artikel, kemungkinan besar artikel tersebut memang membahas topik yang terkait dengan kata itu.

Ada beberapa cara menghitung TF, tetapi yang paling sederhana adalah berikut.

Contoh: Jika sebuah kata muncul dua kali dari total sepuluh kata dalam dokumen, TF = 2/10 = 0.2

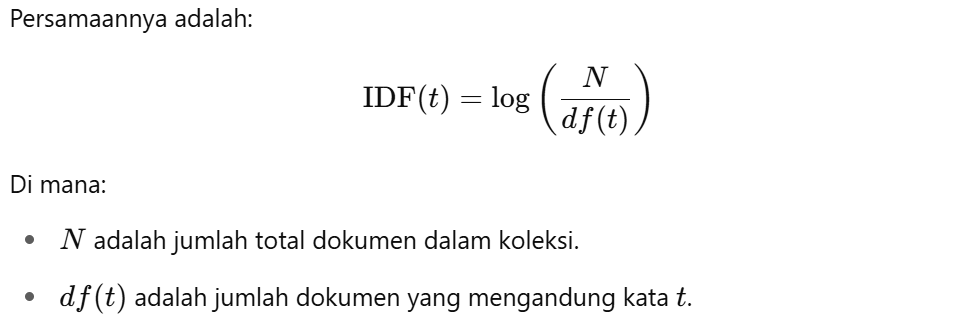

Inverse Document Frequency (IDF)

IDF mengukur seberapa “langka” atau “unik” sebuah kata dalam seluruh koleksi dokumen (korpus).

Jika sebuah kata muncul pada banyak dokumen dalam korpus, nilai IDF-nya akan rendah (karena kata itu umum). Sebaliknya, jika sebuah kata hanya muncul dalam sedikit dokumen (atau hanya pada satu dokumen saja), nilai IDF-nya akan tinggi (karena kata itu khas dan informatif).

Agar lebih jelas, mari lihat contoh cara IDF bekerja dalam membedakan kata-kata umum dan kata-kata khas pada korpus dokumen perfilman. Kata-kata seperti “dan”, “di”, atau “yang” muncul hampir pada semua dokumen sehingga tidak efektif untuk membedakan satu dokumen dari yang lain.

Sebaliknya, kata-kata seperti “sinematografi” atau “plot twist” mungkin jarang muncul, tetapi jika ada, biasanya sangat spesifik dan relevan terhadap topik film. IDF dirancang untuk menurunkan bobot kata-kata umum dan menaikkan bobot kata-kata yang lebih khas serta informatif.

Berikut adalah cara untuk menghitung IDF.

Misalkan kita memiliki lima dokumen ulasan film dan kata yang ingin dihitung IDF-nya adalah

t = “sinematografi”

Lalu diketahui

- N = 5 (jumlah total dokumen)

- df(“sinematografi”) = 1 (kata “sinematografi” hanya muncul dalam 1 dokumen)

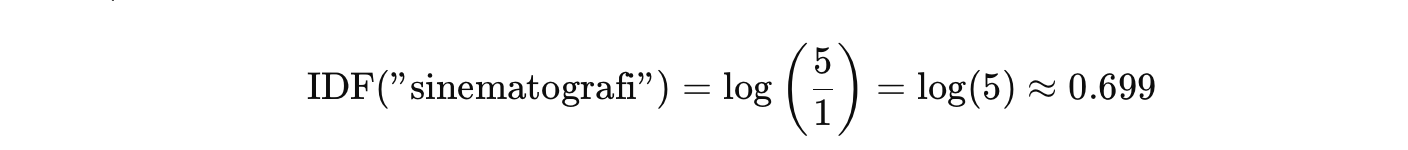

Jadi, rumusnya berikut.

Artinya, karena kata “sinematografi” hanya muncul dalam satu dokumen, nilainya tinggi. Ini menandakan bahwa kata tersebut cukup unik dan relevan secara spesifik untuk dokumen itu.

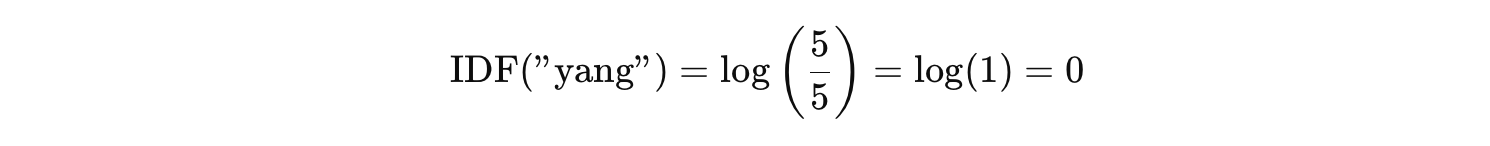

Sebaliknya, coba kita hitung untuk kata berikut.

t = “yang”

- df(“yang”) = 5 (muncul pada semua dokumen)

Nilainya nol karena kata “yang” terlalu umum—tidak membantu membedakan dokumen satu dengan yang lain.

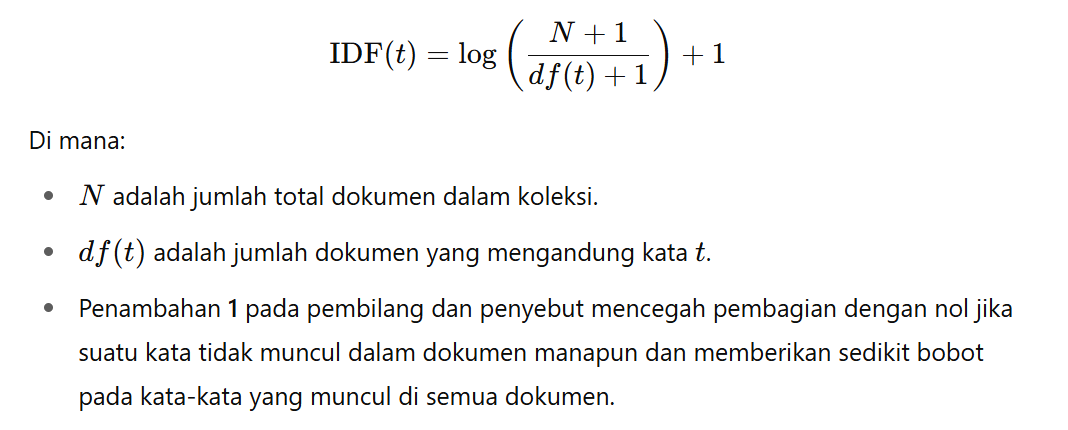

Untuk menghindari pembagian dengan nol jika sebuah kata tidak muncul dalam dokumen mana pun–atau untuk memberikan bobot pada kata yang muncul dalam semua dokumen–sering kali ditambahkan +1 pada pembilang dan/atau penyebut, misalnya seperti ini.

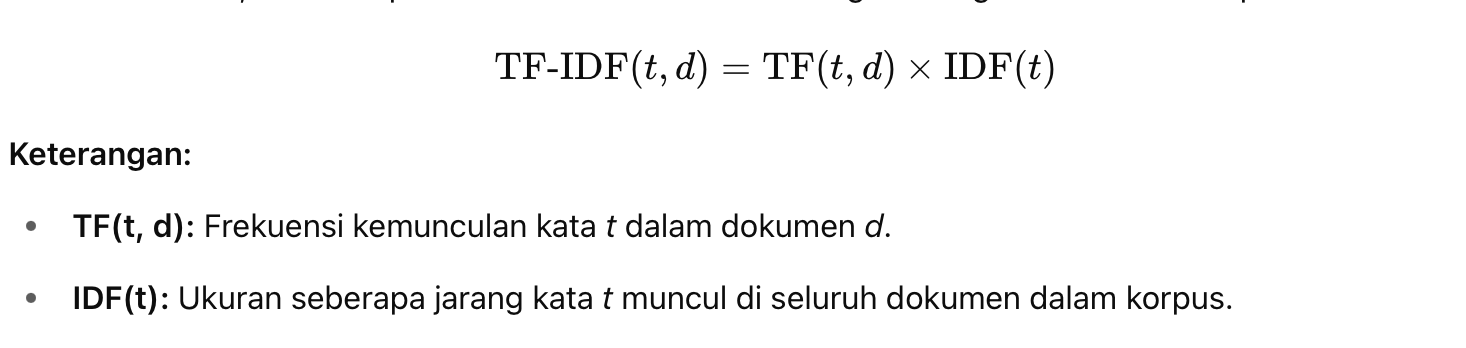

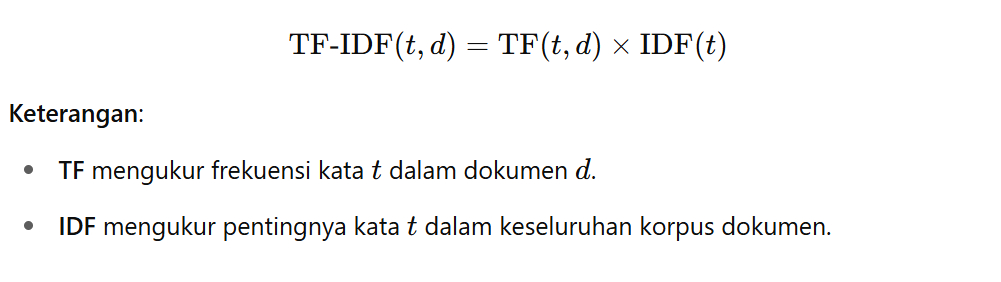

Perhitungan TF-IDF

Setelah menghitung nilai term frequency (TF) dan inverse document frequency (IDF) untuk setiap kata dalam dokumen, kita memperoleh bobot akhir TF-IDF dengan mengalikan kedua komponen tersebut.

Persamaannya berikut.

Sebuah kata akan memiliki bobot TF-IDF yang tinggi jika ia sering muncul dalam sebuah dokumen tertentu (TF tinggi) dan jarang muncul dalam dokumen-dokumen lain pada korpus (IDF tinggi). Ini adalah kombinasi yang menunjukkan relevansi dan kekhasan.

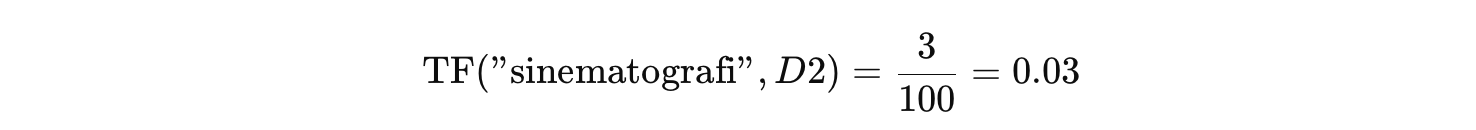

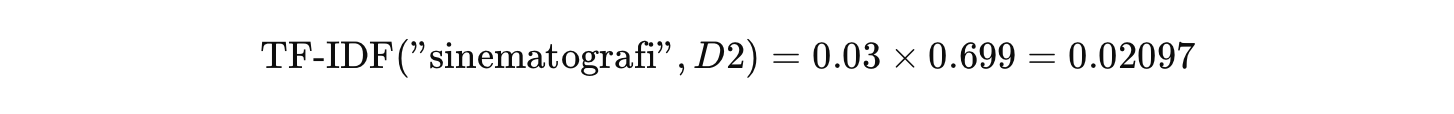

Bayangkan kita punya lima dokumen ulasan film. Kita ingin menghitung TF-IDF untuk kata “sinematografi” dalam Dokumen 2 dengan informasi sebagai berikut.

Kata “sinematografi” muncul sebanyak 3 kali pada Dokumen 2, yang memiliki total 100 kata. Jadi, penghitungan TF sebagai berikut.

Kemudian diketahui bahwa kata “sinematografi” hanya muncul dalam 1 dari 5 dokumen. Jadi, penghitungan IDF sebagai berikut.

Dengan demikian, hasil akhir penghitungan TF-IDF adalah berikut.

Artinya, bobot 0.02097 menunjukkan bahwa kata “sinematografi” cukup penting dalam Dokumen 2 karena cukup sering muncul dan jarang ada pada dokumen lain.

Menggunakan TF-IDF untuk Ulasan Matematika

Kali ini kita akan kembali dalam skenario ulasan matematika yang kita gunakan pada materi sebelumnya. Kita akan mengubah ulasan teks menjadi representasi angka menggunakan metode TF-IDF dengan langkah-langkah berikut.

Menyusun Kosakata Unik (Vocabulary)

Langkah pertama adalah seperti yang sudah dilakukan dalam Bag of Words (BoW), yaitu menyusun kosakata unik yang muncul di seluruh kumpulan ulasan pembelajaran matematika.

Berikut adalah beberapa contoh ulasan yang berhasil dikumpulkan.

- Dokumen 1: “Saya suka belajar Matematika.”

- Dokumen 2: “Belajar matematika menyenangkan.”

- Dokumen 3: “Matematika itu menyenangkan.”

- Dokumen 4: “Belajar matematika sangat penting.”

- Dokumen 5: “Matematika adalah ilmu dasar.”

Dari ulasan di atas, kosakata unik yang dihasilkan adalah sebelas kata.

‘adalah’, ‘belajar’, ‘dasar’, ‘ilmu’, ‘itu’, ‘matematika’, ‘menyenangkan’, ‘penting’, ‘sangat’, ‘saya’, ‘suka’

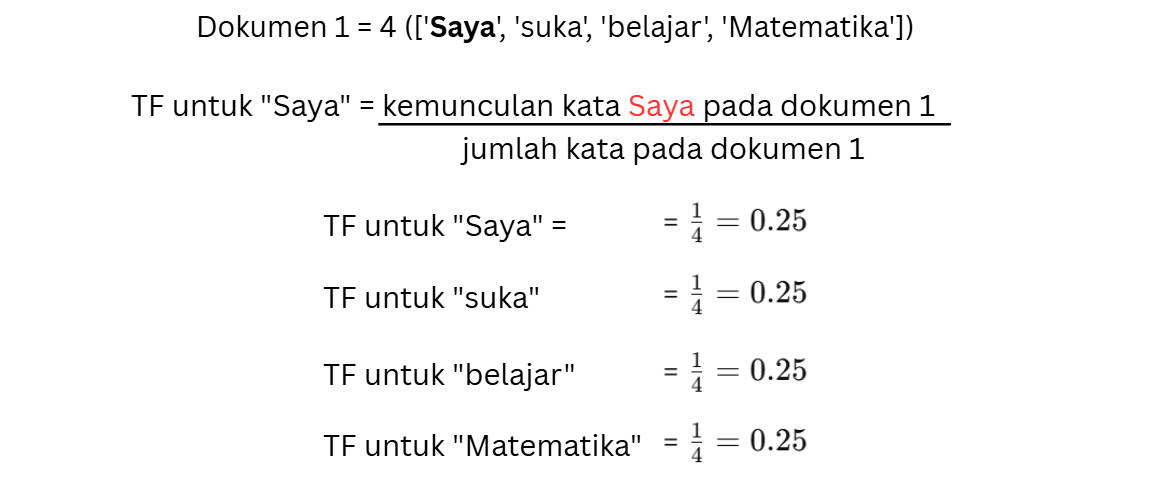

Menghitung Term Frequency (TF)

Term frequency (TF) mengukur seberapa sering sebuah kata muncul dalam suatu dokumen (ulasan). Rumusnya adalah berikut.

Dalam kasus ini, jumlah total kata dalam “Dokumen 1” adalah 4, yakni ([‘Saya’, ‘suka’, ‘belajar’, ‘Matematika’]). Kita hitung TF untuk setiap kata seperti berikut.

Dengan cara yang sama kita bisa menghitung TF untuk masing-masing dokumen atau ulasan sehingga akan mendapatkan hasil berikut.

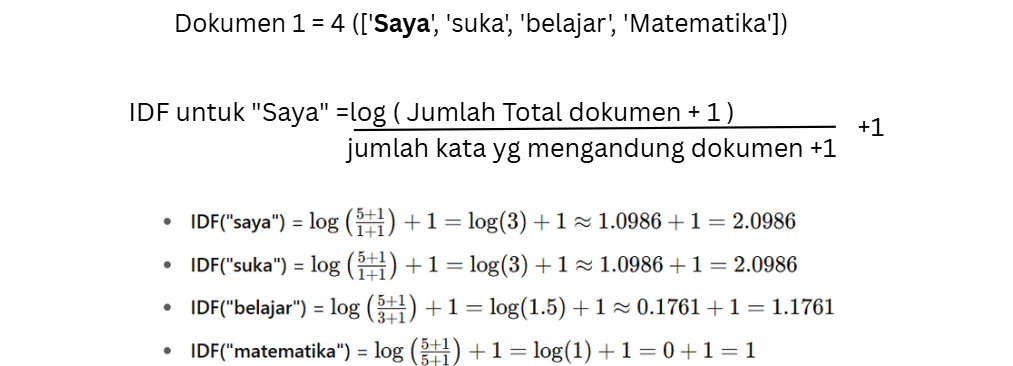

Menghitung Inverse Document Frequency (IDF)

IDF mengukur seberapa penting suatu kata dalam seluruh koleksi dokumen. Semakin jarang kata muncul dalam koleksi, semakin tinggi nilai IDF-nya. IDF sangat berguna untuk menurunkan bobot kata yang sering muncul dalam semua dokumen, misalnya kata-kata umum seperti “dan” atau “adalah” yang tidak memberikan banyak informasi.

Pada perhitungan di atas, kata “Matematika” muncul dalam setiap dokumen. Jadi, kita simpulkan bahwa

- df(“Matematika”) = 5 (yaitu 5 dokumen).

- N = 5 (total jumlah dokumen).

- Hasilnya, IDF(“Matematika”) = 1

Karena kata ini muncul dalam setiap dokumen, IDF-nya menjadi 0, yang berarti kata ini tidak memberikan banyak informasi untuk membedakan dokumen.

Dengan cara yang sama, kita bisa menghitung IDF untuk setiap kata unik sehingga akan mendapatkan hasil berikut.

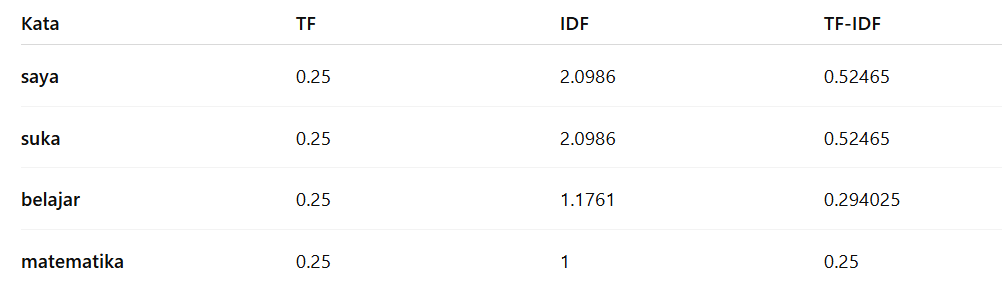

Menghitung TF-IDF

Setelah menghitung TF dan IDF, kita dapat mengalikan keduanya untuk mendapatkan TF-IDF. TF-IDF mengukur pentingnya sebuah kata dalam dokumen dengan mempertimbangkan seberapa sering kata tersebut muncul dalam dokumen (TF) dan seberapa jarang kata tersebut muncul pada seluruh dokumen (IDF).

Rumus TF-IDF adalah berikut.

Dari data TF dan IDF yang sudah dihitung sebelumnya, kita dapat menghitung nilai TF-IDF untuk setiap kata pada Dokumen 1.

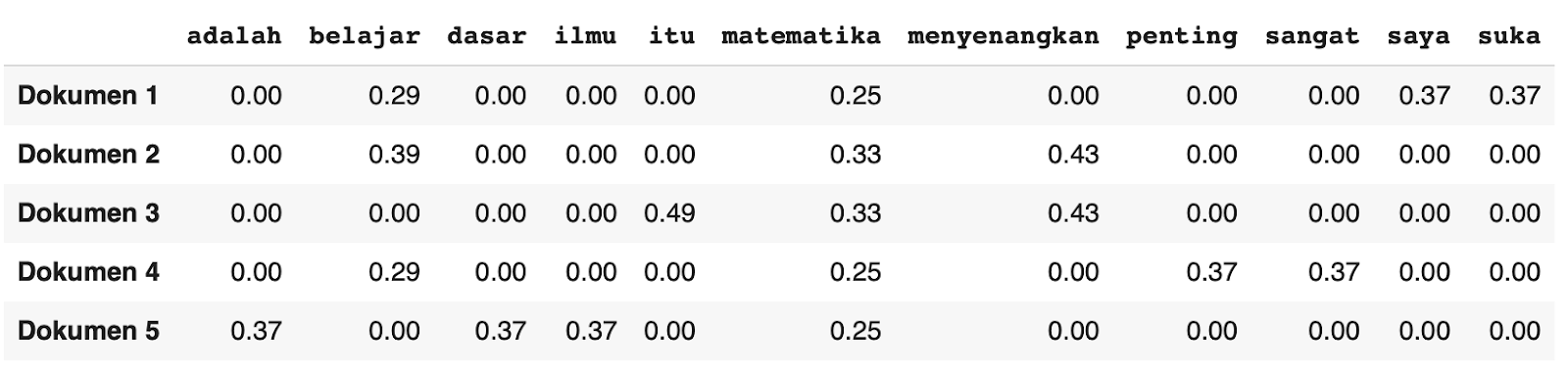

Dengan cara yang sama, kita dapat menghitung TF-IDF untuk setiap kata pada dokumen sehingga akan mendapatkan hasil berikut.

Dari hasil TF-IDF di atas, kita dapat melihat bahwa nilai bobot untuk kata matematika berbeda dalam tiap dokumennya, bergantung pada kata lain dalam dokumen tersebut. Berdasarkan data tersebut, kita dapat mendapat kesimpulan sebagai berikut.

- TF mengukur frekuensi kemunculan kata dalam satu dokumen.

- IDF mengukur seberapa penting kata tersebut di seluruh koleksi dokumen.

- TF-IDF adalah perkalian antara TF dan IDF, yang memberikan bobot lebih pada kata-kata penting untuk membedakan dokumen.

Ini adalah cara manual menghitung TF, IDF, dan TF-IDF yang dapat digunakan dalam tugas seperti klasifikasi teks atau pencarian informasi.

Implementasi TF-IDF dengan Python

Setelah memahami konsep dasar dan perhitungan manual TF-IDF, saatnya kita lihat cara mengimplementasikannya dengan efisien menggunakan Python.

Kode yang akan dibahas ini bertujuan untuk menghitung TF (term frequency), IDF (inverse document frequency), dan TF-IDF dari kumpulan data ulasan teks menggunakan Python, lalu menyajikan hasilnya dalam bentuk tabel menggunakan pandas.

Langkah 1: Persiapan Library dan Data

Pertama, kita perlu mengimpor beberapa library terlebih dahulu, antara lain berikut.

pandasuntuk manipulasi data tabular.mathdigunakan untuk perhitungan logaritma.Counterdari collections digunakan untuk menghitung frekuensi kata.

Selain itu, kita juga menyiapkan data ulasan yang akan dipakai. Variabel reviews adalah kumpulan dokumen berupa ulasan pendek yang akan dianalisis.

- import pandas as pd

- import math

-

from collections import Counter

- # Data ulasan

- reviews = [

- ”saya suka belajar matematika”,

- ”belajar matematika menyenangkan”,

- ”matematika itu menyenangkan”,

- ”belajar matematika sangat penting”,

- ”matematika adalah ilmu dasar”

- ]

Langkah 2: Membangun Kosakata

Kemudian, kita menggabungkan semua teks, menjadikannya huruf kecil, memecah menjadi kata, lalu membuat daftar kata unik yang telah diurutkan.

- # Membuat daftar kata unik di seluruh dokumen (ubah set menjadi list dan urutkan)

- all_words = sorted(list(set(“ “.join(reviews).lower().split())))

Langkah 3: Menghitung Term Frequency (TF)

Selanjutnya, kita menghitung proporsi kemunculan setiap kata dalam satu dokumen merujuk pada rumus ini TF = (jumlah kata tertentu) / (total kata dalam dokumen).

- # Menghitung TF untuk setiap dokumen

- def compute_tf(doc):

- word_count = Counter(doc.lower().split())

- total_words = len(doc.split())

- tf = {word: count / total_words for word, count in word_count.items()}

- return tf

Langkah 4: Menghitung Inverse Document Frequency (IDF)

Setelah itu, kita menghitung seberapa umum atau jarang suatu kata muncul dalam seluruh dokumen dengan rumus: IDF = log10((N + 1) / (df + 1)) + 1

- N = jumlah dokumen

- df = jumlah dokumen yang mengandung kata tersebut

- Tambahan +1 untuk mencegah pembagian nol atau log(0)

- # Menghitung IDF untuk seluruh koleksi dokumen

- def compute_idf(reviews, all_words):

- N = len(reviews)

- idf = {}

- for word in all_words:

- df = sum(1 for review in reviews if word in review.lower())

- idf[word] = math.log10((N + 1) / (df + 1)) + 1 # Ditambahkan +1 untuk mencegah pembagian dengan nol

- return idf

Langkah 5: Menghitung TF-IDF

Langkah berikutnya adalah kita mengalikan nilai TF dengan IDF untuk setiap kata pada setiap dokumen. Di sini kita memberikan bobot yang menekankan kata-kata penting (unik untuk dokumen tertentu).

- # Menghitung TF-IDF

- def compute_tfidf(reviews, all_words):

- idf = compute_idf(reviews, all_words)

- tfidf = []

- for review in reviews:

- tf = compute_tf(review)

- tfidf.append({word: tf.get(word, 0) * idf[word] for word in all_words})

- return tfidf

Langkah 6: Mengeksekusi Perhitungan

Setelah kita membuat fungsi untuk menghitung TF, IDF, dan TF-IDF, kini saatnya mengeksekusi fungsi tersebut.

- tf_results = [compute_tf(review) for review in reviews]

- idf_results = compute_idf(reviews, all_words)

- tfidf_results = compute_tfidf(reviews, all_words)

Langkah 7: Membuat Tabel Pandas

Untuk memudahkan dalam melihat hasil perhitungan TF, IDF, dan TF-IDF sebelumnya, kali ini kita membuat tabel data frame untuk masing-masing.

Kode ini akan menampilkan frekuensi relatif kata pada tiap dokumen.

- # Membuat DataFrame untuk TF

- df_tf = pd.DataFrame(tf_results, columns=all_words)

- df_tf.index = [f”Dokumen {i+1}” for i in range(len(tf_results))]

- df_tf = df_tf.fillna(0).round(2)

- df_tf

Inilah hasil untuk tabel TF yang menunjukkan seberapa sering kata muncul dalam dokumen.

Kemudian, kode berikut akan menampilkan nilai IDF dari setiap kata dalam kosakata.

- df_idf = pd.DataFrame(list(idf_results.items()), columns=[“Kata”, “IDF”])

- df_idf = df_idf.round(2)

- df_idf

Inilah tampilan hasil untuk tabel IDF yang menunjukkan seberapa unik kata dalam seluruh dokumen.

Terakhir, kode berikut menampilkan bobot pentingnya kata pada tiap dokumen berdasarkan kombinasi TF dan IDF.

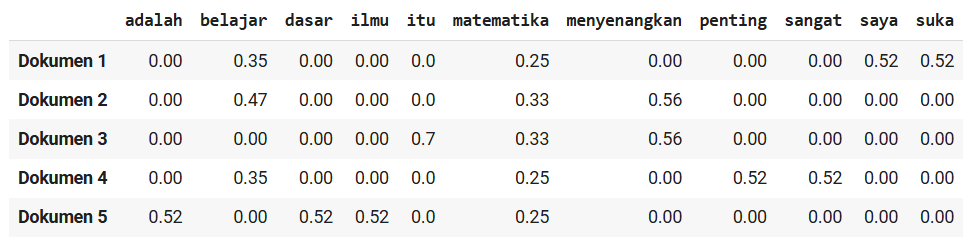

- df_tfidf = pd.DataFrame(tfidf_results, columns=all_words)

- df_tfidf.index = [f”Dokumen {i+1}” for i in range(len(tfidf_results))]

- df_tfidf = df_tfidf.round(2)

- df_tfidf

Inilah tampilan hasil untuk tabel TF-IDF yang menunjukkan bobot pentingnya kata dalam konteks dokumen.

Perhatikan tabel TF-IDF di atas. Setiap baris mewakili satu ulasan, sementara setiap kolom merepresentasikan satu kata unik dari seluruh kumpulan ulasan (atau yang kita sebut korpus). Nilai yang kita lihat pada setiap sel adalah bobot TF-IDF untuk kata tertentu dalam ulasan spesifik.

Nilai bobot yang lebih tinggi mengindikasikan bahwa kata tersebut sangat relevan dan spesifik untuk ulasan itu. Ini biasanya berarti kata tersebut sering muncul dalam ulasan tersebut, tetapi jarang atau bahkan tidak muncul sama sekali pada ulasan lain dalam korpus.

Menariknya, Anda akan melihat bahwa kata “matematika” memiliki bobot TF-IDF yang relatif seragam dalam semua ulasan. Ini terjadi karena “matematika” muncul pada setiap ulasan dalam korpus.

Dalam filosofi TF-IDF, kata-kata yang sering muncul pada banyak dokumen biasanya memiliki nilai IDF lebih rendah karena dianggap kurang mampu membedakan satu dokumen dari yang lain. Namun karena kemunculannya tetap proporsional dan tidak terlalu dominan, nilai TF-IDF “matematika” tetap memiliki bobot sedang.

Sebaliknya, kata-kata seperti “saya”, “suka”, “itu”, “sangat”, “penting”, “adalah”, “ilmu”, dan “dasar” bisa memiliki bobot TF-IDF lebih tinggi ketika hanya muncul pada satu atau dua ulasan, menjadikannya lebih khas untuk dokumen tempat mereka muncul.

Pertimbangan Penggunaan TF-IDF

Oke, sampai saat ini kita sudah berhasil menghitung TF-IDF menggunakan Python. Ada beberapa hal yang harus Anda perhatikan saat menggunakan teknik TF-IDF ini.

Meskipun TF-IDF lebih unggul dibandingkan metode Bag of Words (BoW) karena lebih informatif dengan mengurangi bobot kata umum, tetap saja pendekatan TF-IDF ini masih memiliki beberapa keterbatasan penting yang mirip dengan BoW.

- Pertama, TF-IDF tidak mempertimbangkan urutan kata. Artinya, dua kalimat dengan susunan kata berbeda, tapi makna yang sangat berbeda tetap bisa dianggap serupa. Sebagai contoh, kalimat “Ilham mengejar Rina” dan “Rina mengejar Ilham” akan diberikan bobot kata yang sama oleh TF-IDF meskipun maknanya jelas berbeda.

- Kedua, TF-IDF kesulitan menangkap konteks negasi atau ironi. Misalnya, kalimat “Saya suka film ini” dan “Saya tidak suka film ini” dapat dianggap mirip jika kata “tidak” diabaikan selama pra-pemrosesan, padahal maknanya berlawanan.

- Ketiga, TF-IDF tidak memahami makna semantik antar kata. Kalimat seperti “Saya ingin membeli mobil baru” dan “Saya ingin membeli rumah baru” mungkin dianggap serupa, padahal secara makna dan konteks sangat berbeda.

Oleh karena itu, untuk menangkap konteks, makna, dan hubungan antar kata secara lebih mendalam, pendekatan lanjutan seperti Word Embedding lebih sesuai.

Matematika dalam Natural Language Processing (NLP): Word Embedding

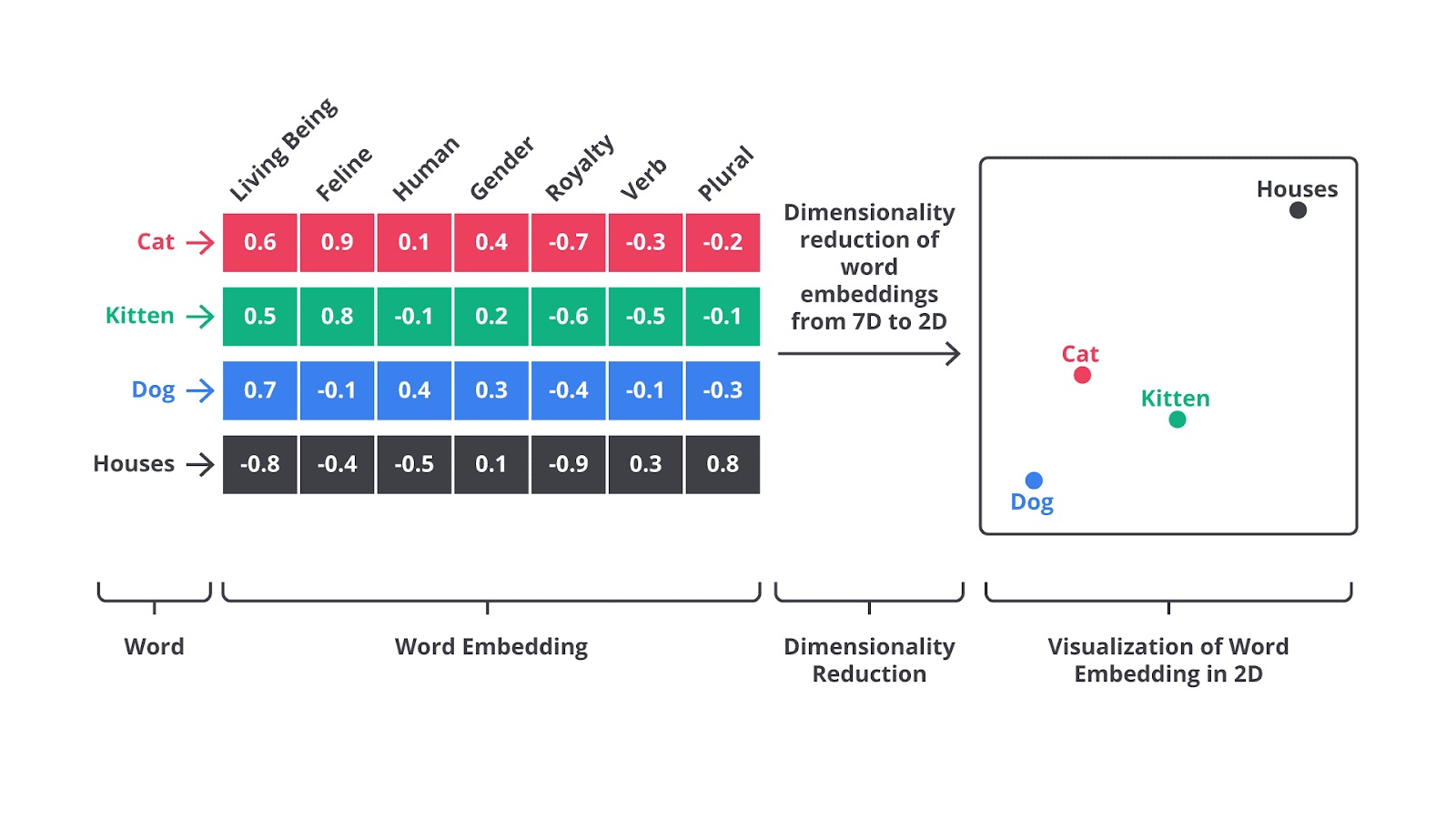

Word Embedding adalah teknik pada natural language processing (NLP) yang digunakan untuk mengonversi kata-kata dalam teks menjadi representasi numerik, biasanya berbentuk vektor berdimensi rendah. Tujuannya adalah menangkap makna semantik dan hubungan antar kata dalam sebuah korpus teks.

Dengan Word Embedding, kata-kata yang memiliki makna serupa atau sering muncul dalam konteks serupa akan memiliki representasi numerik lebih mirip, memungkinkan mesin untuk “memahami” dan memproses bahasa manusia dengan lebih efektif.

Berbeda dengan teknik lama, seperti Bag of Words (BoW) atau TF-IDF yang hanya memperhitungkan frekuensi kata, Word Embedding berfokus pada makna kata dalam konteks kalimat sehingga menghasilkan representasi kata yang lebih kaya dan bermakna.

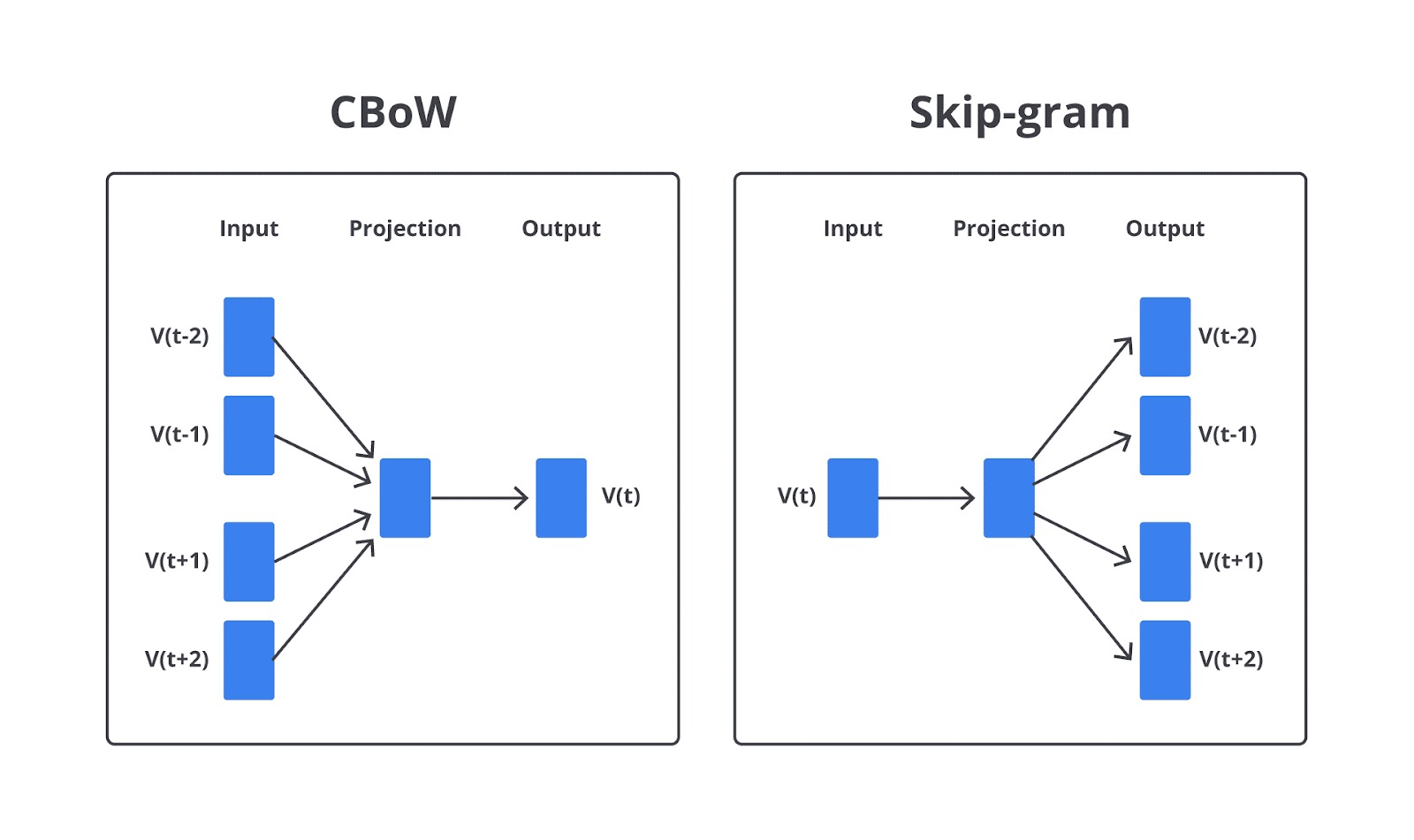

Cara Kerja Word Embedding