Membangun dan Mengelola Metadata dengan Tools Open-Source

- Pengenalan Version Control

- Jenis-Jenis Version Control System

- Tools yang Umum Digunakan

- Dasar-Dasar Penggunaan Version Control

- Pengenalan MLflow: Tracking dan Project

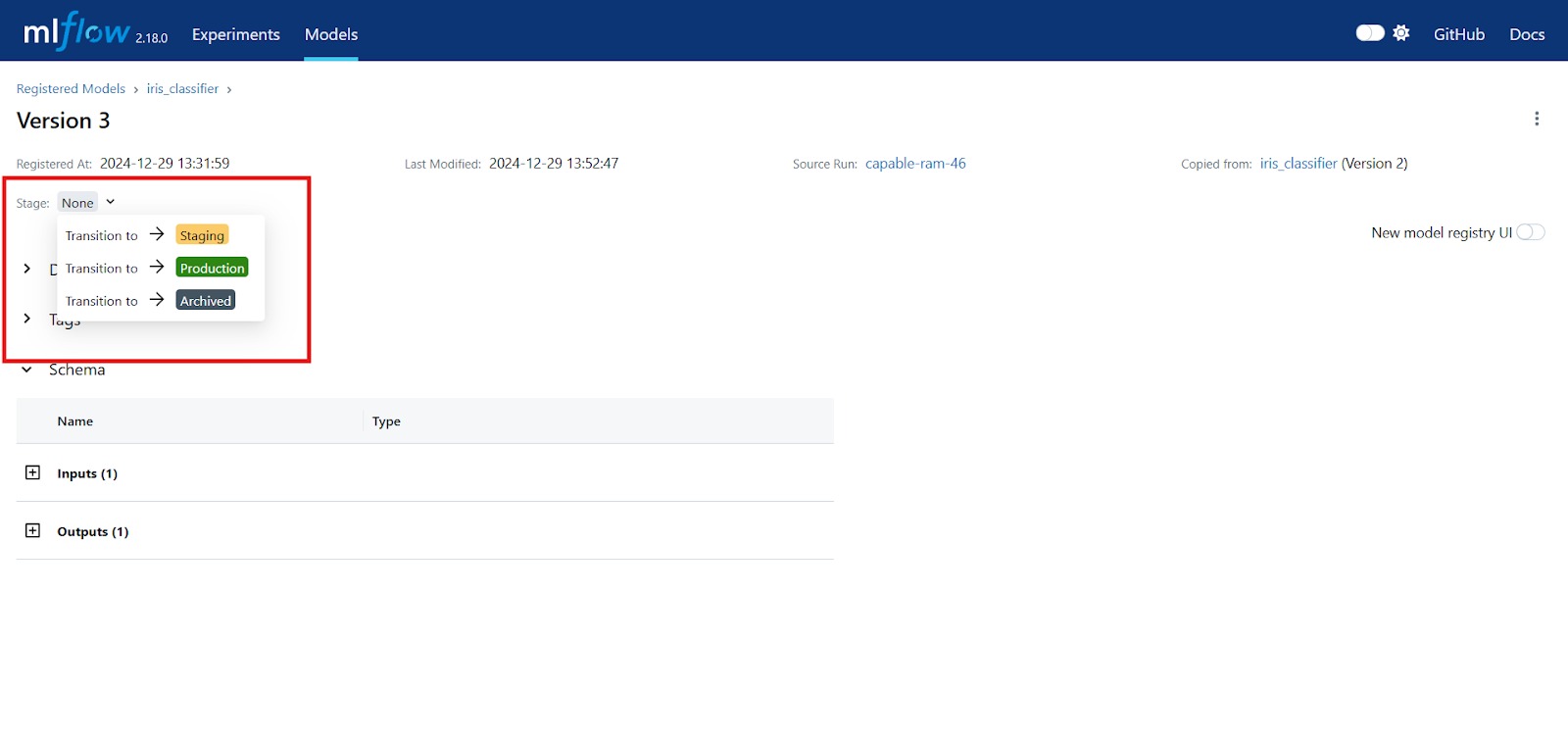

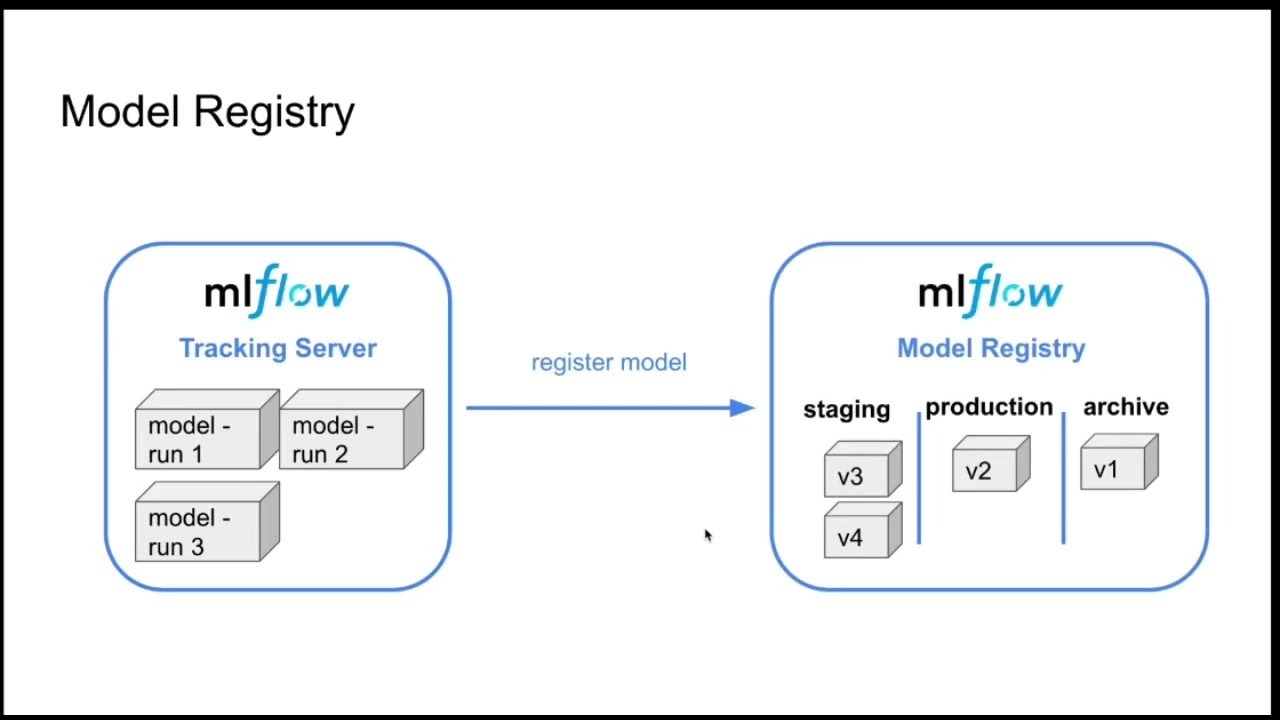

- Pengenalan MLflow: Model dan Model Registry

- Pengenalan MLflow: Pipelines dan Keypoints

- Version Control dengan MLflow

- Metadata dan Sekitarnya

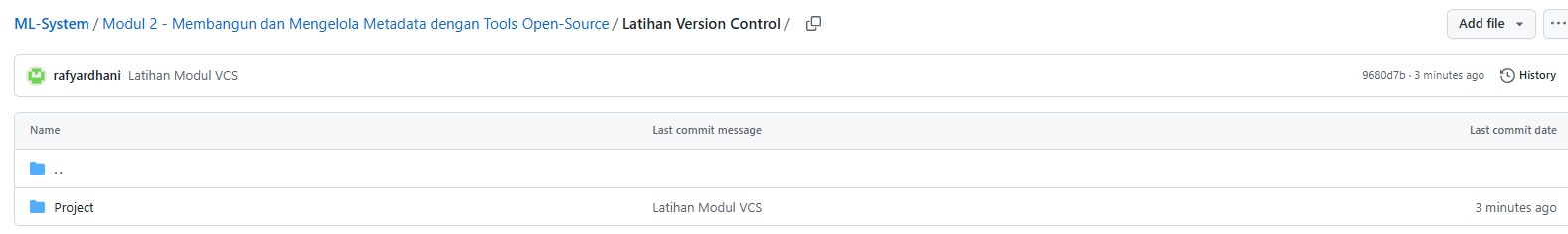

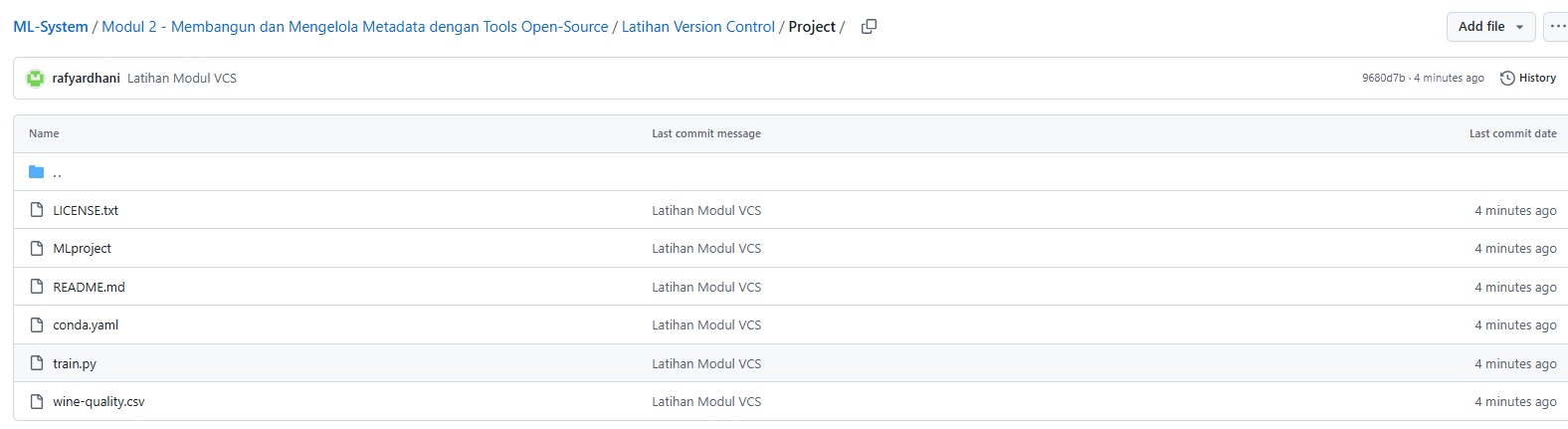

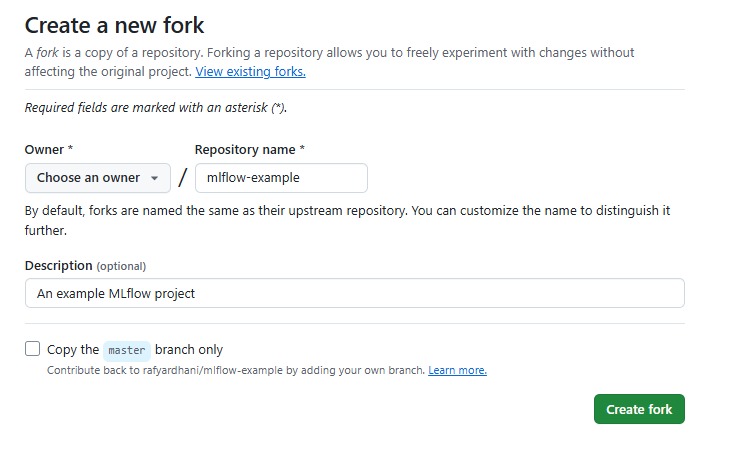

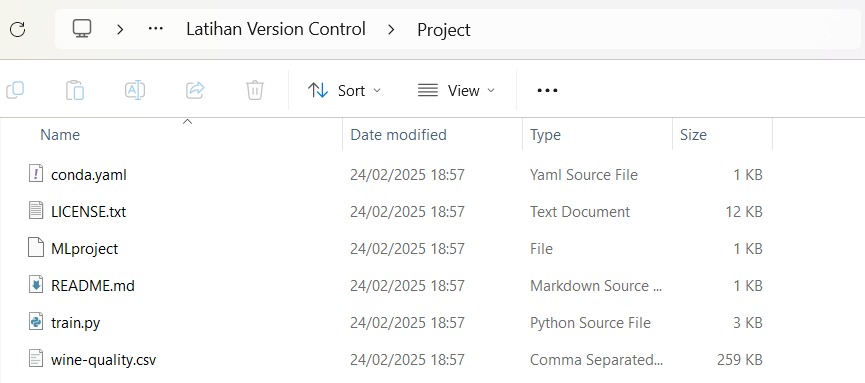

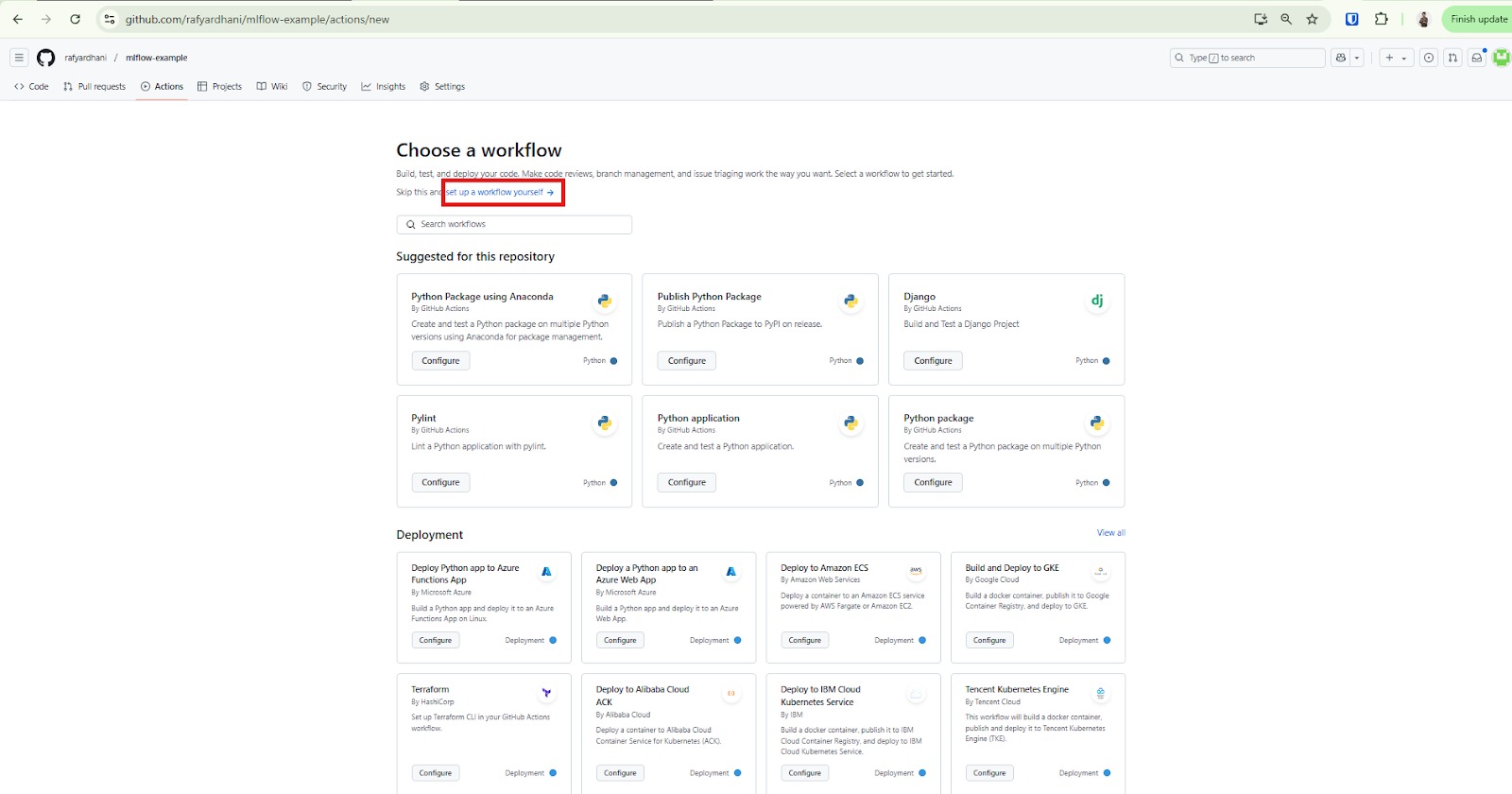

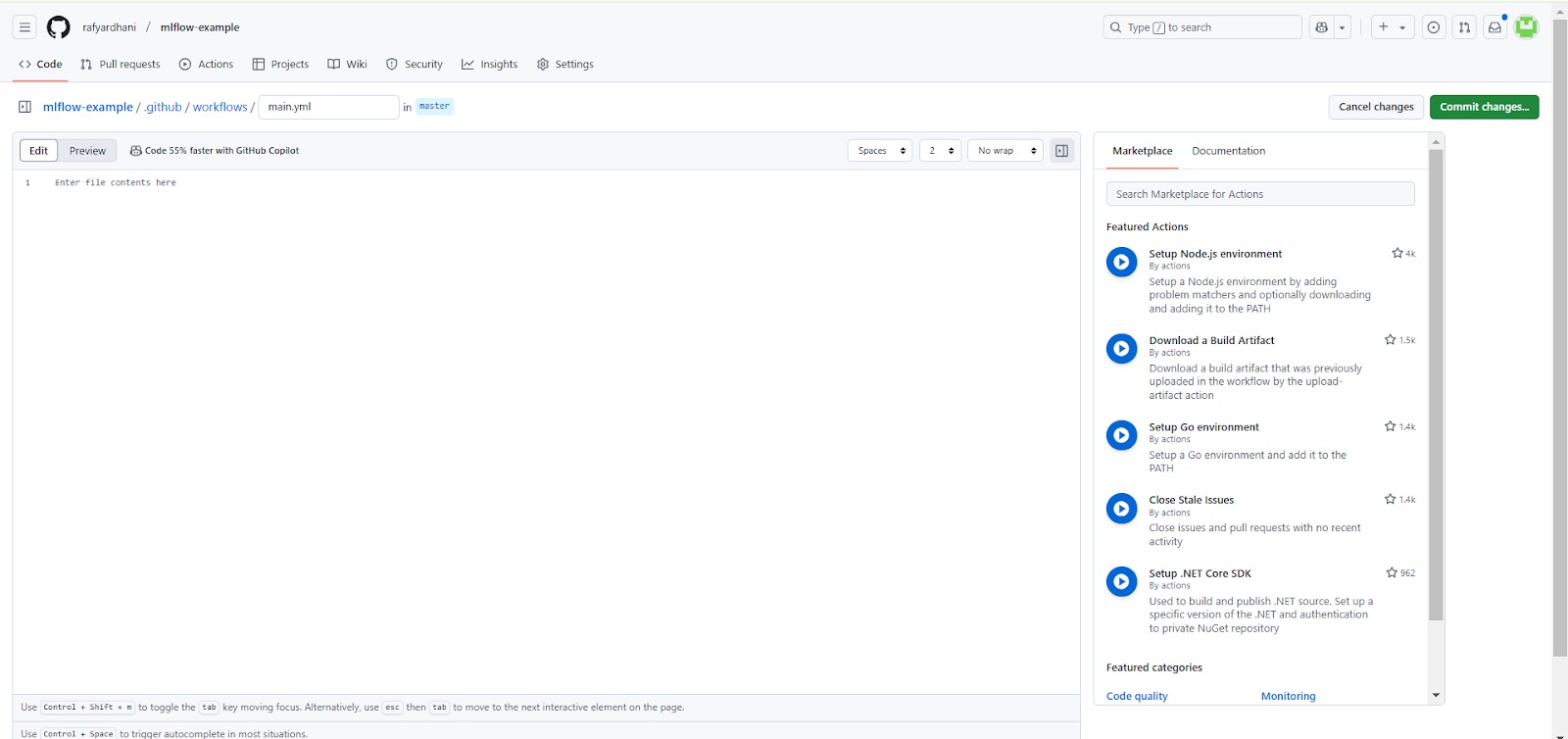

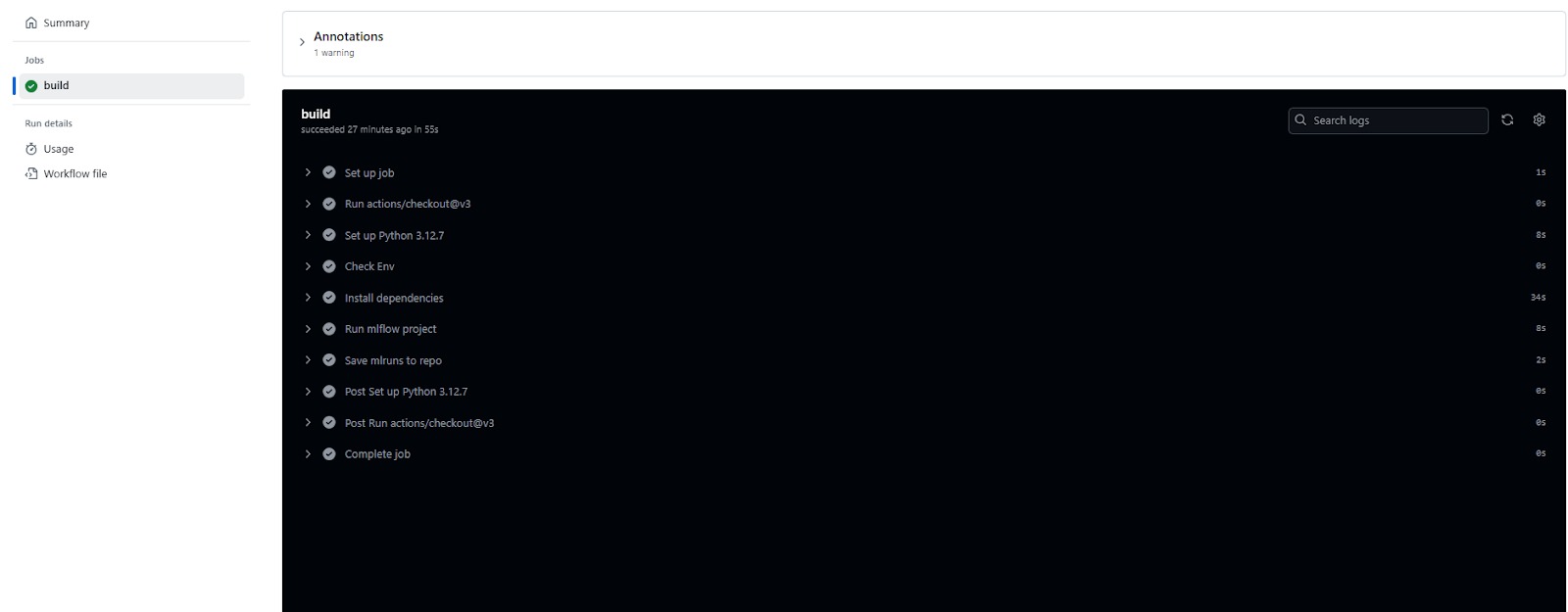

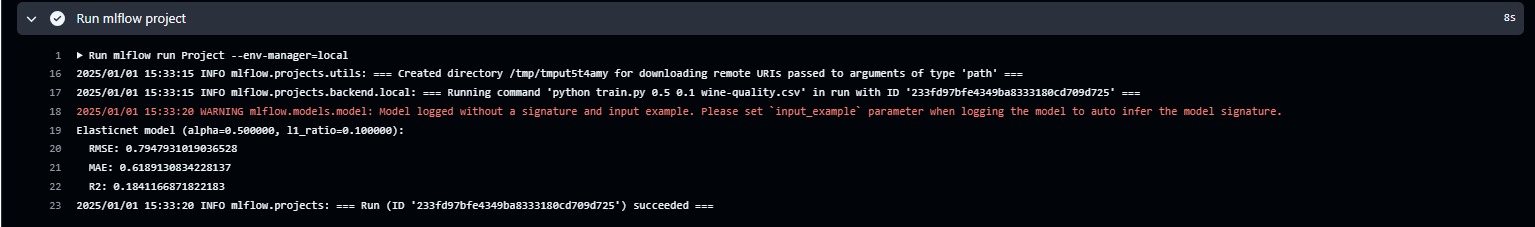

- Latihan: Membuat Version Control Menggunakan MLflow

- Rangkuman Membangun dan Mengelola Metadata dengan Tools Open-Source

Pengenalan Version Control

“The more that you read, the more things you will know. The more that you learn, the more places you’ll go.” – Dr. Seus, American children’s author.

Selamat datang kembali di kelas Membangun Sistem Machine Learning. Setelah mempelajari seluk-beluk MLOps pada modul sebelumnya, bukan berarti pembelajaran Anda berhenti di sini karena sejatinya menjadi seorang machine learning engineer merupakan perjalanan yang sangat panjang.

Sesuai dengan kutipan di atas, semakin banyak pembelajaran yang dilalui, niscaya kelak akan mengantarkan Anda menuju posisi pekerjaan yang sesuai dengan kapabilitasnya.

Pada kesempatan kali ini, kita akan membahas version control sebagai salah satu langkah pertama sebelum mengupas tuntas MLOps di materi berikutnya.

Version control adalah salah satu pilar penting dalam pengembangan perangkat lunak secara umum maupun spesifik seperti data science dan machine learning. Dalam dunia yang serba cepat dan kolaboratif ini, pengelolaan perubahan pada kode, data, dan dokumen menjadi hal yang krusial. Bayangkan Anda membuat sebuah proyek besar tanpa sistem yang bisa melacak perubahan—bisa kacau, bukan? Sebagai manusia yang tak lepas dari kata “lupa”, tentu akan sedikit kewalahan jika ingin melakukan rollback (kembali ke kode sebelumnya), apalagi ketika kode memiliki jumlah history perubahan yang sangat banyak tanpa adanya identitas.

Version control mengajarkan kita bahwa setiap perubahan perlu dicatat dan dievaluasi, bukan hanya dilakukan secara ugal-ugalan. Tahapan ini merupakan bentuk refleksi teknis dalam kerja tim maupun individu.

Selain itu, kita juga belajar tentang kolaborasi yang lebih baik, pengelolaan risiko, hingga memastikan bahwa setiap langkah kita terdokumentasi dengan rapi. Di sinilah teknologi seperti Git, Subversion, atau bahkan platform seperti MLflow dalam machine learning memainkan peran penting.

Nah, pada modul ini, mari kita eksplorasi bersama bagaimana version control dapat meningkatkan efisiensi dan kualitas pekerjaan seorang machine learning engineer, serta menjadikan proyek kita lebih terorganisasi dan terkontrol. Siapkan semangat Anda karena perjalanan kita baru saja dimulai!

Definisi dan Pentingnya Version Control

Version control adalah sistem atau pendekatan yang digunakan untuk mencatat, mengelola, dan melacak perubahan pada file atau kumpulan file seiring waktu. Dalam dunia teknologi, version control sangat erat kaitannya dengan pengembangan perangkat lunak, dokumentasi, hingga pengelolaan data. Namun, version control tidak hanya berkutat di teknologi saja melainkan dapat diterapkan secara umum pada berbagai macam bidang.

Mungkin sebagai siswa Anda familier dengan revisi tugas hingga file revisian yang dibuat menjadi sangat banyak dengan nama yang berbeda-beda.

Penamaan file tugas yang berubah-ubah dan menjamur menjadi banyak file seperti gambar di atas merupakan masalah umum dalam pengembangan proyek, terutama jika tidak menggunakan version control system. Sekilas terlihat sederhana dan tidak ada masalah, ya? Jangan salah, masalah kecil seperti ini akan menjadi sebuah issue yang sangat besar ketika kita tidak aware dengan ancaman yang menghantuinya. Setidaknya beberapa masalah berikut akan hadir ketika kita menghiraukan hal sepele ini.

- Jika nama file berubah-ubah (misal, laporan_akhir.docx menjadi laporan_revisi1.docx, lalu laporan_revisi_final.docx), penulis dapat dengan mudah kehilangan jejak revisi mana yang terbaik atau perubahan apa yang dilakukan di setiap revisi. Mencari file yang tepat menjadi sulit dan memakan waktu karena kita cenderung membuka dokumen satu per satu hingga menemukan versi yang dicari.

- Adanya banyak revisi dengan nama yang mirip atau berbeda sedikit menyebabkan duplikasi file yang tidak perlu, membengkaknya ruang penyimpanan, dan mempersulit manajemen.

- Jika beberapa orang bekerja pada file yang sama secara bersamaan tanpa version control system, konflik terhadap versi sangat mungkin terjadi. Seseorang mungkin menimpa perubahan yang dilakukan orang lain tanpa sadar sehingga mengakibatkan permasalahan yang cukup serius.

- Berbagi dan menggabungkan perubahan menjadi sangat kompleks dan rawan kesalahan.

Dari sini, kita semua tahu tanpa sistem kontrol versi (VCS), mengelola proyek dengan banyak file dan revisi yang berubah-ubah menimbulkan beberapa masalah serius. Beberapa hal di antaranya seperti kehilangan jejak perubahan dan revisi, duplikasi file yang tidak perlu, konflik versi yang sulit diselesaikan, kesulitan dalam kolaborasi, dan risiko kehilangan data. Secara keseluruhan, ini mengakibatkan inefisiensi, potensi kesalahan, dan manajemen proyek yang kacau.

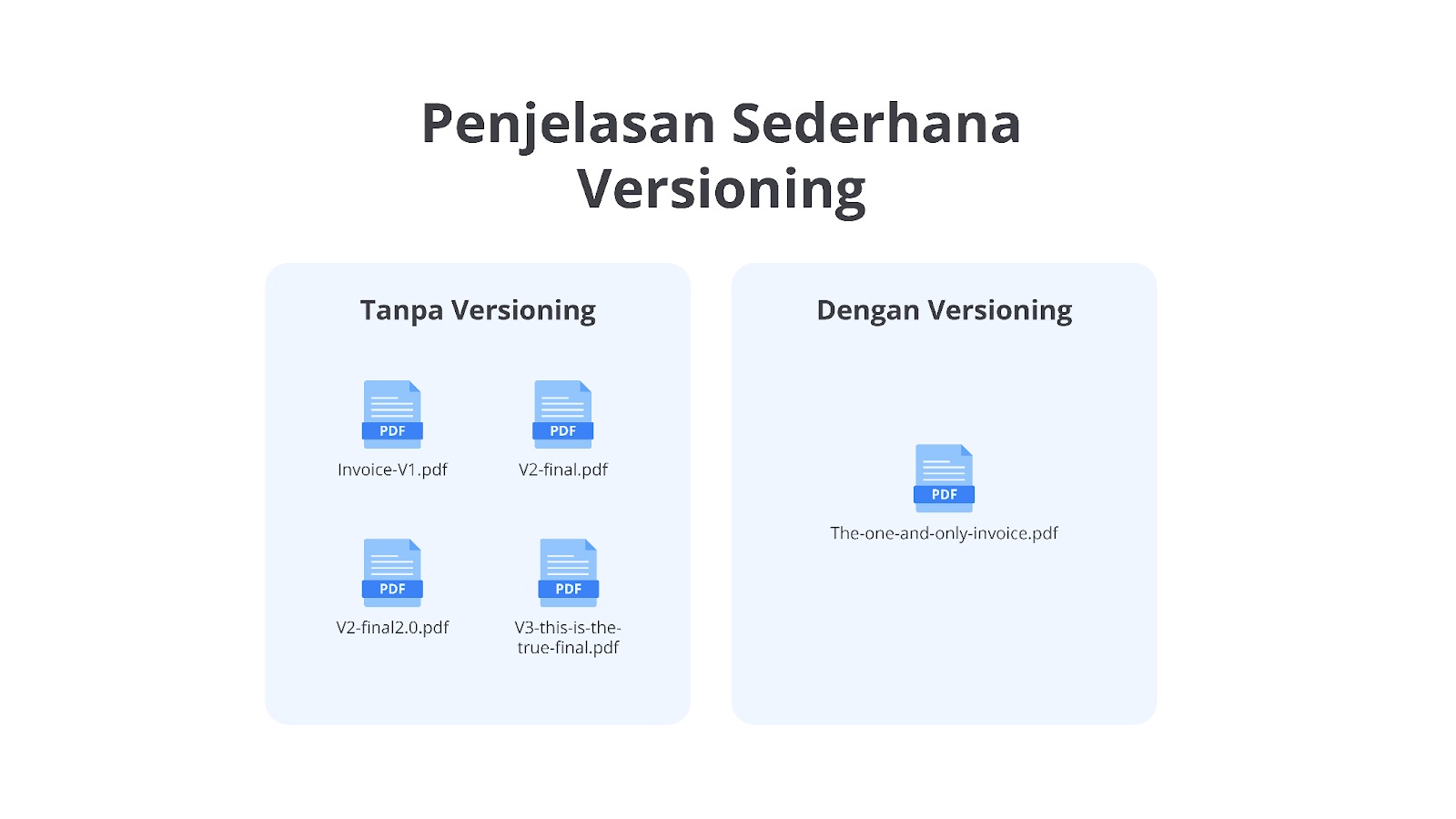

Berangkat dari permasalahan seperti ini, kita perlu menerapkan version control system agar terhindar dari permasalahan yang terlihat sepele, tetapi mematikan. Dengan menggunakan VCS, setiap perubahan disimpan dalam bentuk yang serupa sehingga memungkinkan pengguna untuk melihat riwayat perubahan, memulihkan versi sebelumnya, atau bahkan menggabungkan kontribusi dari beberapa orang dalam tim.

Pendekatan ini sering digunakan pada proyek berbasis teknologi, seperti pengembangan perangkat lunak, dokumentasi teknis, hingga pengelolaan data dalam proyek analitik. Versi-versi yang dikelola mencakup kode program, dokumen, gambar, atau file lainnya yang sering mengalami pembaruan.

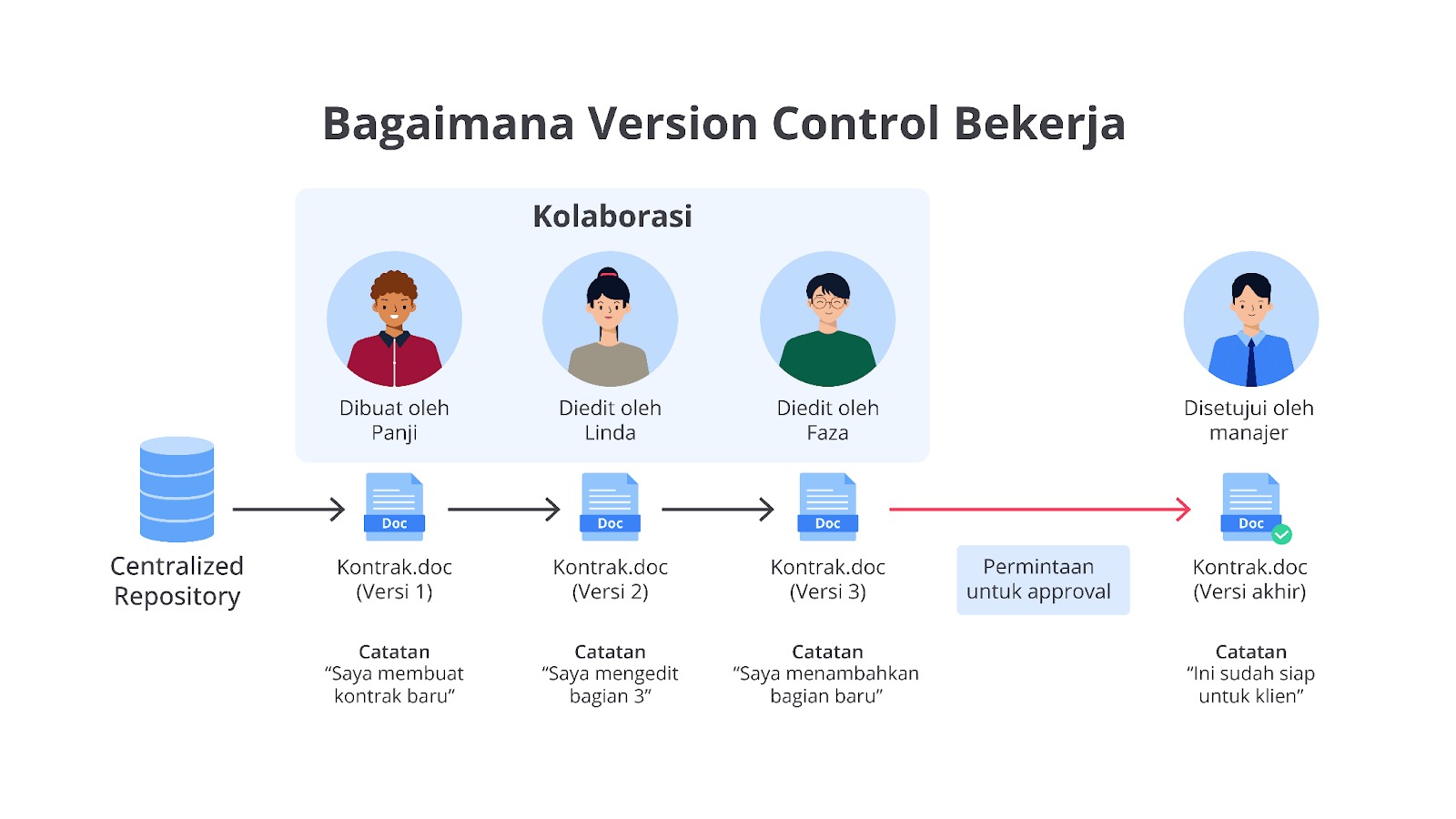

Version control bekerja dengan cara mencatat perubahan yang dilakukan pada file dan menyimpannya sebagai snapshot. Setiap snapshot setidaknya mencatat informasi berikut.

- Nama pengguna yang membuat perubahan.

- Waktu dilakukannya perubahan.

- Bagian yang berubah dari file tersebut.

Sistem ini memungkinkan pengguna untuk melihat riwayat perubahan secara detail, mengembalikan file ke kondisi sebelumnya jika diperlukan, hingga mengintegrasikan kontribusi dari banyak pengguna tanpa konflik.

Bagaimana menurut Anda? Apakah dari penjelasan di atas sudah dapat menyimpulkan peran dari VCS ini? Bagus, tetapi jika Anda belum yakin dan membutuhkan validasi, mari kita bahas bersama-sama peran VCS yang sering dianggap sepele.

-

Melacak Riwayat Perubahan

Version control memungkinkan pengguna untuk melacak setiap perubahan yang dilakukan pada file. Dengan mencatat siapa yang mengubah, apa yang diubah, dan kapan perubahan itu terjadi, developer dapat mengetahui asal-usul perubahan dengan lebih detail, memahami alasan di balik perubahan yang dilakukan, hingga membandingkan versi yang berbeda untuk menganalisis dampaknya. Sebagai contoh, jika sebuah bug ditemukan dalam program, pengembang dapat melihat riwayat versi untuk mengidentifikasi kapan bug tersebut muncul dan memperbaikinya—rollback, atau memperbarui kode. -

Reproduksi dan Pemulihan

Dalam proyek apa pun, terkadang perubahan yang salah dapat terjadi, baik disengaja maupun tidak. Dengan version control, developer dapat dengan mudah mengembalikan file atau proyek ke versi sebelumnya tanpa kehilangan data penting dan mengidentifikasi titik perubahan yang menyebabkan masalah untuk mencegah terulangnya kesalahan yang sama.Contohnya, jika sebuah dokumen atau skrip yang penting secara tidak sengaja dihapus atau diubah, versi sebelumnya masih dapat diakses tanpa harus memulai dari awal.

-

Kolaborasi Menjadi Lebih Efektif

Dalam proyek yang melibatkan banyak anggota tim, version control memungkinkan semua anggota untuk bekerja pada file yang sama tanpa khawatir akan saling tumpang tindih atau kehilangan hasil kerja mereka. Fitur seperti branching (pencabangan) dan merging (penggabungan) memungkinkan setiap anggota tim bekerja pada cabang yang terpisah tanpa mengganggu file utama dan dapat mengintegrasikan perubahan dari seluruh anggota tim ke dalam satu versi final secara terorganisasi.Contohnya, dalam pengembangan perangkat lunak, seorang developer dapat membuat cabang untuk menambahkan fitur baru, sementara developer lain memperbaiki bug di cabang lain. Kedua perubahan tersebut dapat digabungkan dengan mudah pada satu file yang sama tanpa harus membuat nama yang berbeda. Waktunya berkata bye-bye file_final_banget.docx!

-

Efisiensi dan Produktivitas

Version control membantu mengurangi pekerjaan manual dengan menyediakan tools untuk mengotomasi pencatatan perubahan, integrasi file, dan manajemen versi. Hal ini memungkinkan tim agar lebih fokus pada pengembangan inti proyek dan menghindari duplikasi kerja atau kebingungan terkait versi terbaru dari file.Sebagai contoh, dalam pengembangan perangkat lunak, integrasi otomatis melalui sistem seperti Git memudahkan tim untuk memeriksa apakah perubahan yang baru kompatibel dengan versi saat ini atau tidak.

-

Audit Menjadi Lebih Mudah

Version control menciptakan jejak audit yang lengkap sehingga memungkinkan developer untuk melacak setiap perubahan dengan transparansi penuh. Hal ini sangat penting dalam proyek yang membutuhkan akuntabilitas tinggi, seperti proyek penelitian atau pengembangan produk yang diawasi oleh regulasi ketat.Sebagai contoh, dalam proyek ilmiah, pencatatan perubahan data eksperimen memastikan bahwa semua hasil dapat direproduksi dan diverifikasi. For your information, perubahan hyperparameter dan metriks dalam pengembangan model machine learning juga perlu Anda catat agar memudahkan reproduksibilitas sistem.

-

Eksperimen Pengembangan

Dalam proyek yang membutuhkan sisi kreatif atau inovatif seperti pengembangan model, sering kali diperlukan eksperimen untuk menghasilkan banyak versi dari produk yang sama. Version control memungkinkan pengguna untuk menciptakan cabang eksperimental tanpa memengaruhi versi utama hingga membandingkan hasil dari berbagai eksperimen secara terpisah sebelum memutuskan versi terbaik.Sebagai contoh, dalam desain model machine learning, Anda perlu melakukan hyperparameter tuning dengan mengalokasikan puluhan, ratusan, bahkan ribuan kombinasi, tentunya akan sulit jika kita harus mencatat satu per satu sebelum memilih model terbaik. Dengan menerapkan VCS kita dapat memilih model terbaik dengan lebih mudah karena sudah ditulis secara otomatis oleh sistem.

-

Manajemen Risiko

Dengan version control, risiko kehilangan data akibat kesalahan manusia atau kerusakan sistem dapat diminimalisasi. Bahkan, jika terjadi masalah teknis seperti kerusakan perangkat keras atau file yang terhapus secara tidak sengaja, semua perubahan dan file sebelumnya tetap aman dalam repositori version control.

Nah, melalui penjelasan di atas, kita telah melihat bagaimana VCS berperan krusial dalam menanggulangi masalah-masalah yang timbul akibat penamaan file yang berubah-ubah dan banyaknya revisi. Dengan kemampuannya melacak perubahan, mengelola cabang, menangani konflik, dan menyediakan riwayat versi akan memberikan berbagai macam benefit dalam pengembangan proyek. Hal ini menghilangkan kekhawatiran kita terhadap kehilangan jejak revisi, duplikasi file, dan kesulitan dalam berkolaborasi.

Dengan demikian, dapat disimpulkan bahwa dengan version control, tim dapat bekerja secara lebih terorganisasi, efisien, dan transparan. Dalam dunia kerja yang modern, proyek akan terus berkembang dan semakin kompleks sehingga peran version control bukan hanya sekadar alat, tetapi sebuah kebutuhan untuk mengelola pekerjaan dengan baik dan memastikan keberhasilan jangka panjang.

Nah, untuk memilih kebutuhan tersebut ternyata tidak bisa asal atau cherry picking lho. Sebenarnya tools VCS ini memiliki beberapa jenis yang perlu Anda sesuaikan dengan proyek yang sedang dikerjakan.

Selanjutnya, agar Anda dapat memilih tools VCS yang paling cocok mari kita pelajari terlebih dahulu jenis-jenis VCS beserta kegunaannya.

Jenis-Jenis Version Control System

Sampai di sini, kita telah memahami definisi dan betapa pentingnya peran VCS dalam mengelola proyek, terutama yang melibatkan banyak file dan perubahan. Dengan kata lain, VCS ibarat asisten digital yang andal untuk mencatat setiap detail revisi, mempermudah kolaborasi, dan menjadi penyelamat saat terjadi kesalahan.

Nah, dengan pemahaman dasar ini, pertanyaan selanjutnya adalah, “Apakah hanya ada satu jenis asisten digital seperti ini?” Tentu saja tidak. Sama seperti aplikasi yang memiliki beragam variasi, dunia VCS pun menawarkan berbagai pilihan dengan karakteristik dan fungsinya masing-masing.

Secara umum, untuk membantu pengelolaan perubahan pada file dan dokumen proyek, version control systems (VCS) dapat dikategorikan menjadi beberapa tipe utama, yaitu Distributed, Centralized, Lock-based, dan Optimistic. Setiap tipe memiliki karakteristik, keunggulan, dan kelemahan yang dirancang untuk memenuhi kebutuhan proyek dengan kompleksitas dan skala yang berbeda. Pada materi ini, kita akan membahas masing-masing tipe ini secara lebih detail.

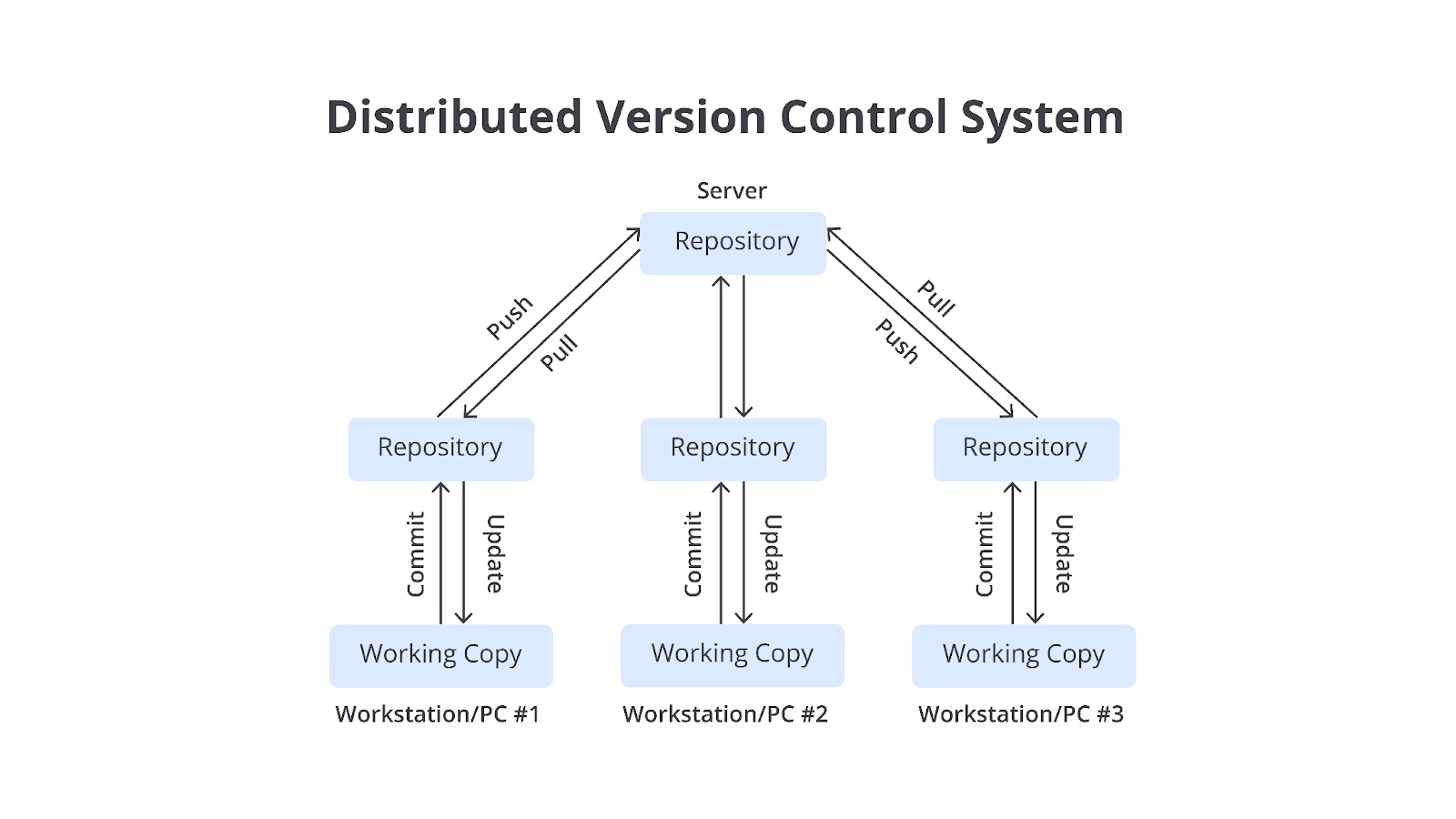

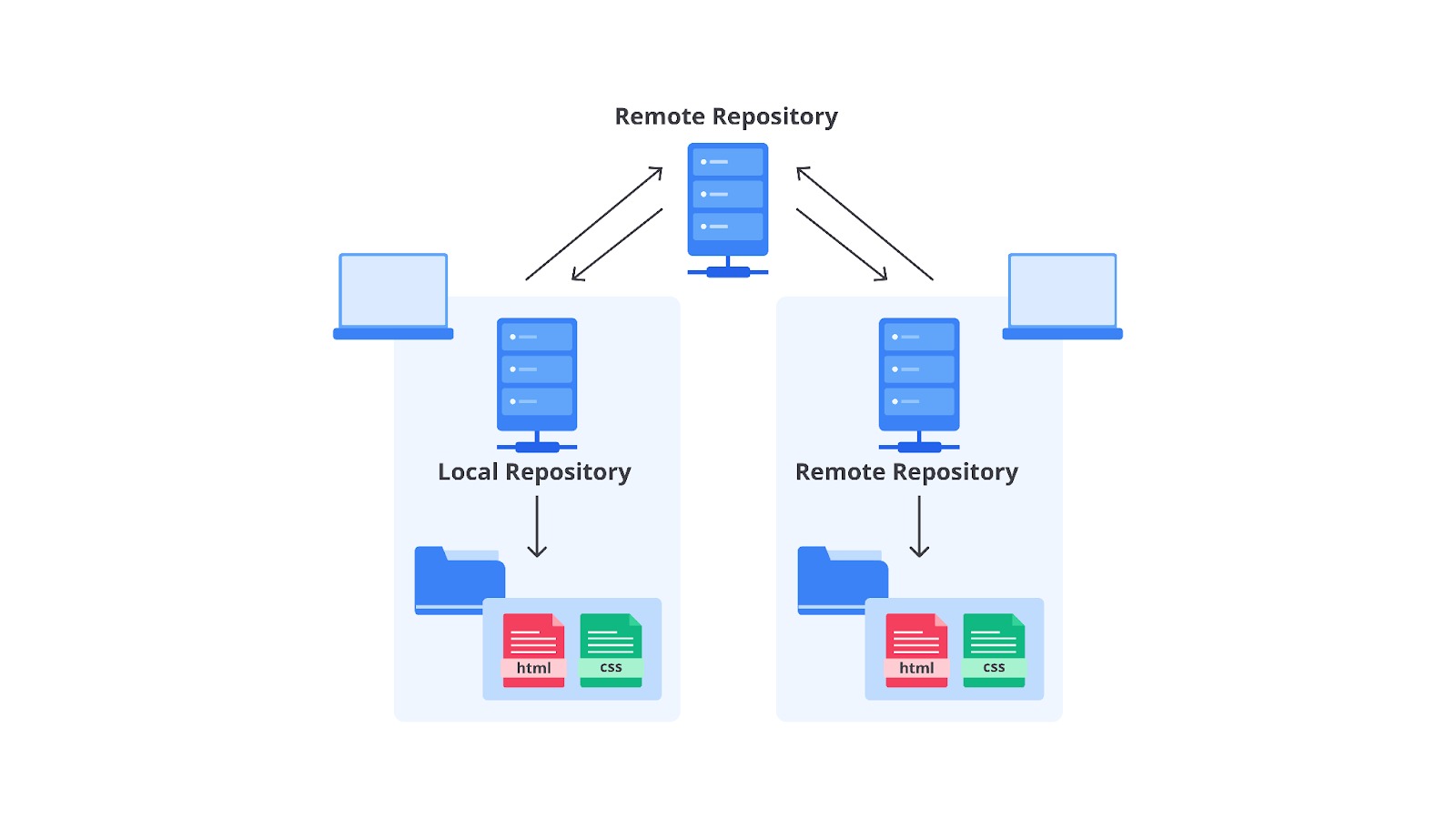

Distributed Version Control System (DVCS)

DVCS merupakan sistem yang memungkinkan setiap developer memiliki salinan lengkap dari repositori utama termasuk semua file, perubahan, dan riwayat. Dengan pendekatan ini, pengguna dapat bekerja secara independen tanpa bergantung pada koneksi internet atau server utama. Semua perubahan dicatat secara lokal dan sinkronisasi dengan repositori pusat atau pengguna lain dilakukan ketika diperlukan.

Keunggulan utama DVCS adalah fleksibilitasnya dalam mendukung pekerjaan offline serta memiliki keamanan data yang tinggi. Hal ini karena setiap pengguna memiliki salinan lengkap repositori sehingga risiko kehilangan data akibat kerusakan server dapat diminimalisasi. Selain itu, sistem ini memiliki kemampuan branching dan merging yang sangat fleksibel sehingga cocok untuk proyek kolaborasi yang melibatkan banyak eksperimen atau pengembangan secara paralel.

Namun, pendekatan ini membutuhkan lebih banyak ruang penyimpanan karena seluruh data pada suatu repositori harus disalin ke setiap device pengguna, serta kompleksitas yang lebih tinggi dibandingkan sistem lainnya.

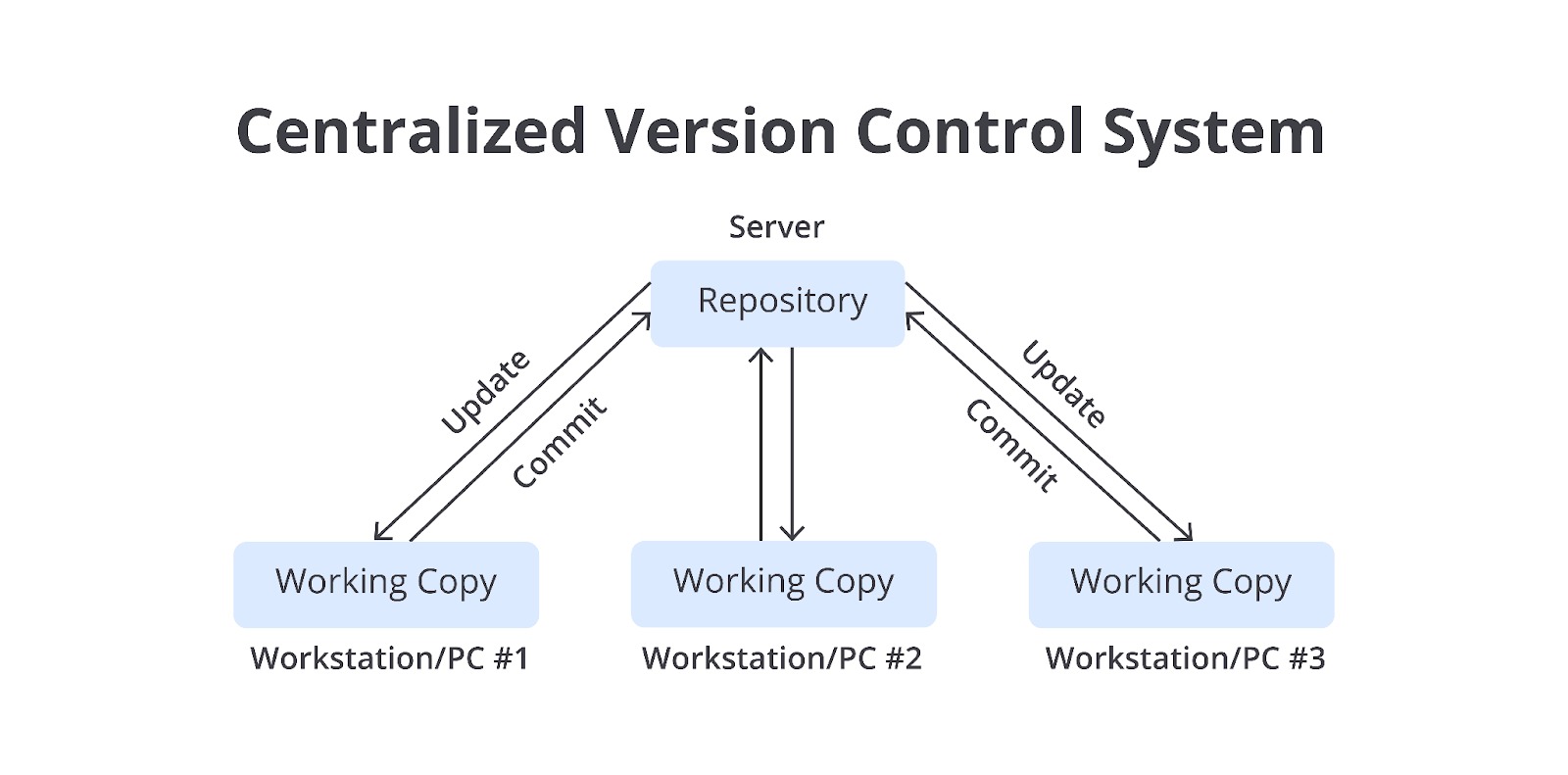

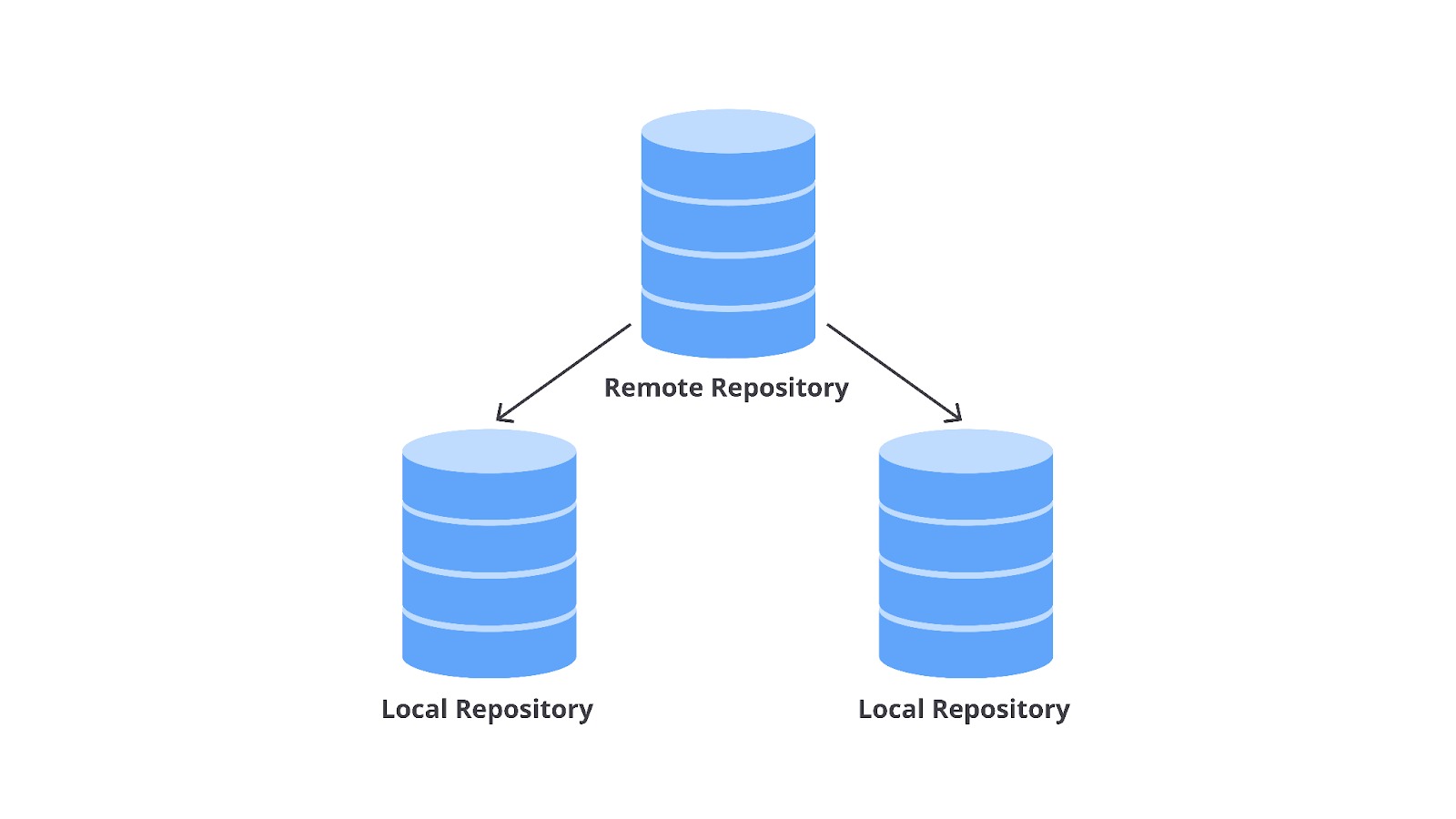

Centralized Version Control System (CVCS)

Berbeda dengan DVCS, CVCS mengandalkan server terpusat untuk menyimpan semua file, perubahan, dan riwayat versi. Setiap pengguna atau developer akan terhubung ke server utama untuk mengunduh file (checkout), melakukan perubahan, dan mengunggah kembali perubahan tersebut (commit).

Keunggulan utama CVCS adalah struktur yang lebih sederhana dan mudah digunakan untuk tim kecil atau proyek dengan kebutuhan kolaborasi yang terorganisir. Semua data tersimpan di server pusat, sehingga memudahkan pengelolaan akses dan pencatatan perubahan secara terpusat. Namun, kelemahan utama sistem ini adalah ketergantungan tinggi pada server pusat. Jika server bermasalah atau tidak dapat diakses, seluruh tim tidak dapat bekerja.

Meski lebih sederhana dibandingkan DVCS, CVCS memiliki keterbatasan dalam mendukung pekerjaan offline dan tidak sefleksibel DVCS dalam menangani branching.

Lock-based Version Control System

Lock-based adalah tipe VCS di mana file yang sedang diedit oleh satu pengguna akan “dikunci” (locked), sehingga pengguna lain tidak dapat melakukan perubahan pada file tersebut hingga dilepas baik itu karena selesai atau berpindah. Pendekatan ini dirancang untuk menghindari konflik saat banyak pengguna bekerja pada file yang sama secara bersamaan.

Keunggulan utama sistem ini adalah kemampuannya dalam memastikan bahwa tidak ada perubahan yang saling tumpang tindih, sehingga sangat cocok untuk file yang tidak mudah digabungkan (merge), seperti dokumen binari, desain grafis, atau CAD. Namun, pendekatan ini dapat membatasi kolaborasi karena pengguna lain harus menunggu kunci dilepas sebelum dapat mengedit file yang sama.

Biasanya lock-based systems sering digunakan dalam proyek-proyek desain atau media, di mana konflik file sulit untuk diselesaikan melalui penggabungan otomatis.

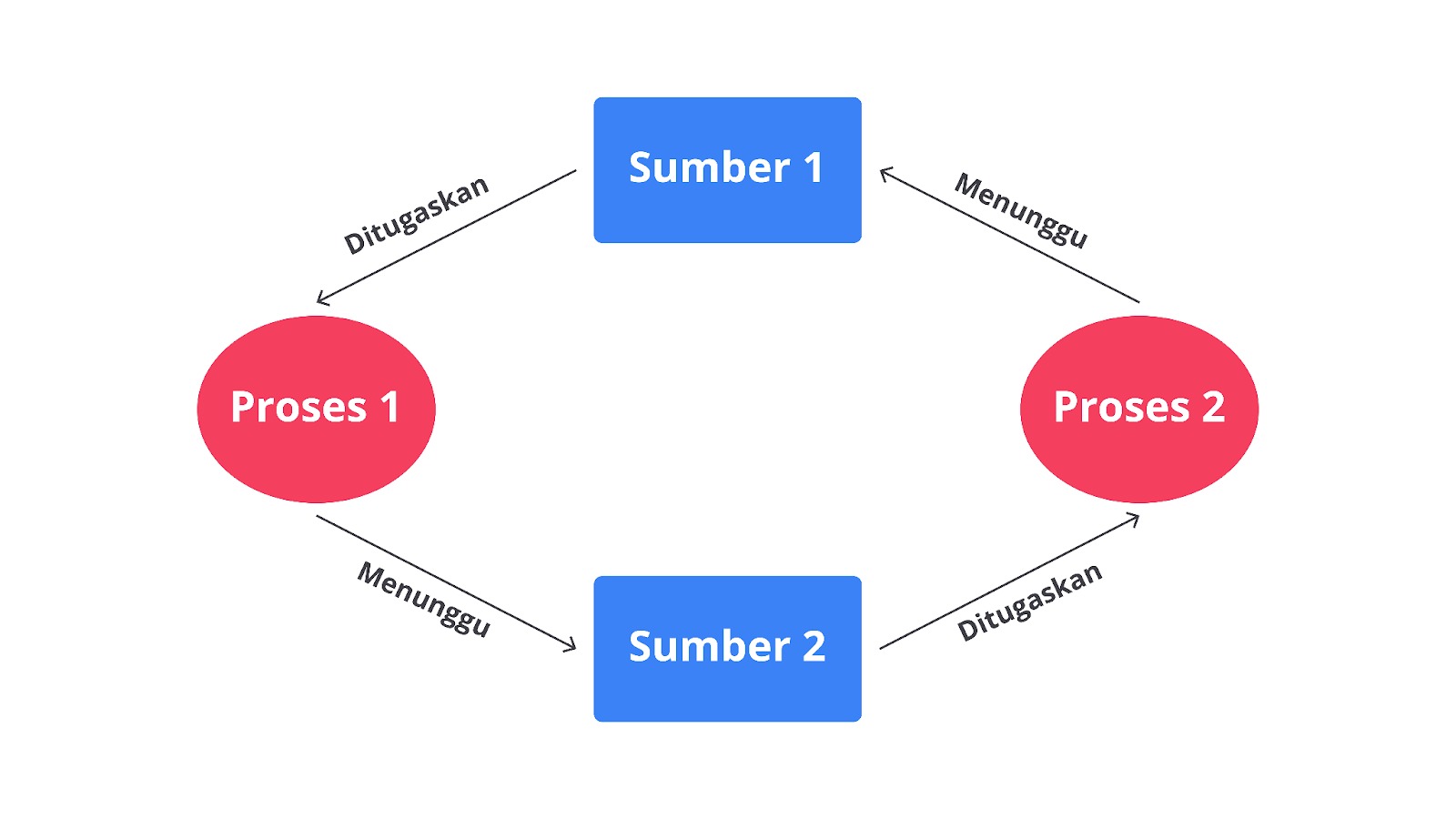

Optimistic

Optimistic VCS mengambil pendekatan yang lebih fleksibel dibandingkan lock-based systems. Dalam sistem ini, beberapa pengguna dapat mengedit file yang sama secara bersamaan tanpa adanya penguncian. Ketika perubahan dilakukan, sistem akan mencoba menggabungkan (merge) perubahan tersebut secara otomatis. Jika terjadi konflik, pengguna perlu menyelesaikannya secara manual.

Keunggulan utama sistem ini adalah kemampuannya mendukung kolaborasi yang dinamis sehingga semua pengguna dapat bekerja tanpa harus saling menunggu. Pendekatan ini sangat efisien untuk file yang dapat digabungkan dengan mudah, seperti source code atau teks. Namun, sistem ini membutuhkan upaya tambahan untuk menyelesaikan konflik jika penggabungan yang dilakukan secara otomatis gagal/crash.

Optimistic VCS sering digunakan dalam pengembangan perangkat lunak, di mana pengembang bekerja secara independen pada bagian yang sama dari proyek.

Sampai di sini kita telah berpetualang menjelajahi berbagai jenis Version Control System, mulai dari Distributed VCS (DVCS) yang bagaikan pasukan gerilya dengan fleksibilitas dan kebebasan, Centralized VCS (CVCS) yang seperti kerajaan terpusat dengan kendali penuh di satu server utama, hingga sistem yang lebih spesifik seperti Lock-based VCS yang menjaga file dengan ketat dan Optimistic VCS yang mengedepankan asumsi minim konflik. Masing-masing memiliki keunikan, kekuatan, dan kelemahannya sendiri; ibarat berbagai macam senjata dengan fungsi dan kegunaannya masing-masing.

Anda dapat melihat perbedaan keempat tipe VCS, melalui tabel berikut.

| Jenis VCS | Cara Kerja |

|---|---|

| Distributed VCS (DVCS) | Memungkinkan setiap developer memiliki salinan lengkap dari repositori utama termasuk semua file, perubahan, dan riwayat. |

| Centralized VCS (CVCS) | Mengandalkan server terpusat untuk menyimpan semua file, perubahan, dan riwayat versi. |

| Lock-based VCS | File yang diedit akan dikunci, mencegah pengguna lain mengubahnya hingga dibuka kembali. |

| Optimistic VCS | Semua bisa mengedit file, konflik diselesaikan saat merge. |

Sekarang, setelah memahami medan pertempuran dan jenis-jenis senjata yang tersedia, saatnya kita memilih perkakas yang tepat untuk memenangkan pertempuran tersebut. Memahami konsep jenis-jenis VCS saja tidak cukup, kita perlu menguasai tools atau perangkat lunak VCS yang akan menjadi andalan kita. Ibarat seorang ksatria yang harus memilih pedang dan perisainya, kita pun perlu memilih tools VCS yang sesuai dengan kebutuhan. Jadi, mari kita selami dunia perkakas Version Control System dan temukan tools yang akan membawa kita menuju manajemen kode yang efektif, kolaborasi yang solid, dan proyek yang sukses. So, sudah siap untuk petualangan selanjutnya? Let’s goooooo~

Tools yang Umum Digunakan

Sebagai seorang developer, tentu kita semua membutuhkan “alat tempur” terbaik untuk menunjang pekerjaan yang beragam agar menghasilkan output maksimal. Sampai pada tahap ini kita telah memahami konsep dan jenis-jenis Version Control System. Sekarang, saatnya kita berkenalan dengan bintang utama dalam dunia version control yaitu perangkat lunaknya atau tools-nya.

Pada materi ini, kita akan mengeksplorasi berbagai tools VCS yang populer digunakan, seperti Git, SVN, dan Mercurial (akan kita pelajari nanti). Kita akan menilik cara kerja dari beberapa tools tersebut dan memilih tools yang tepat untuk proyek yang sedang dikerjakan.

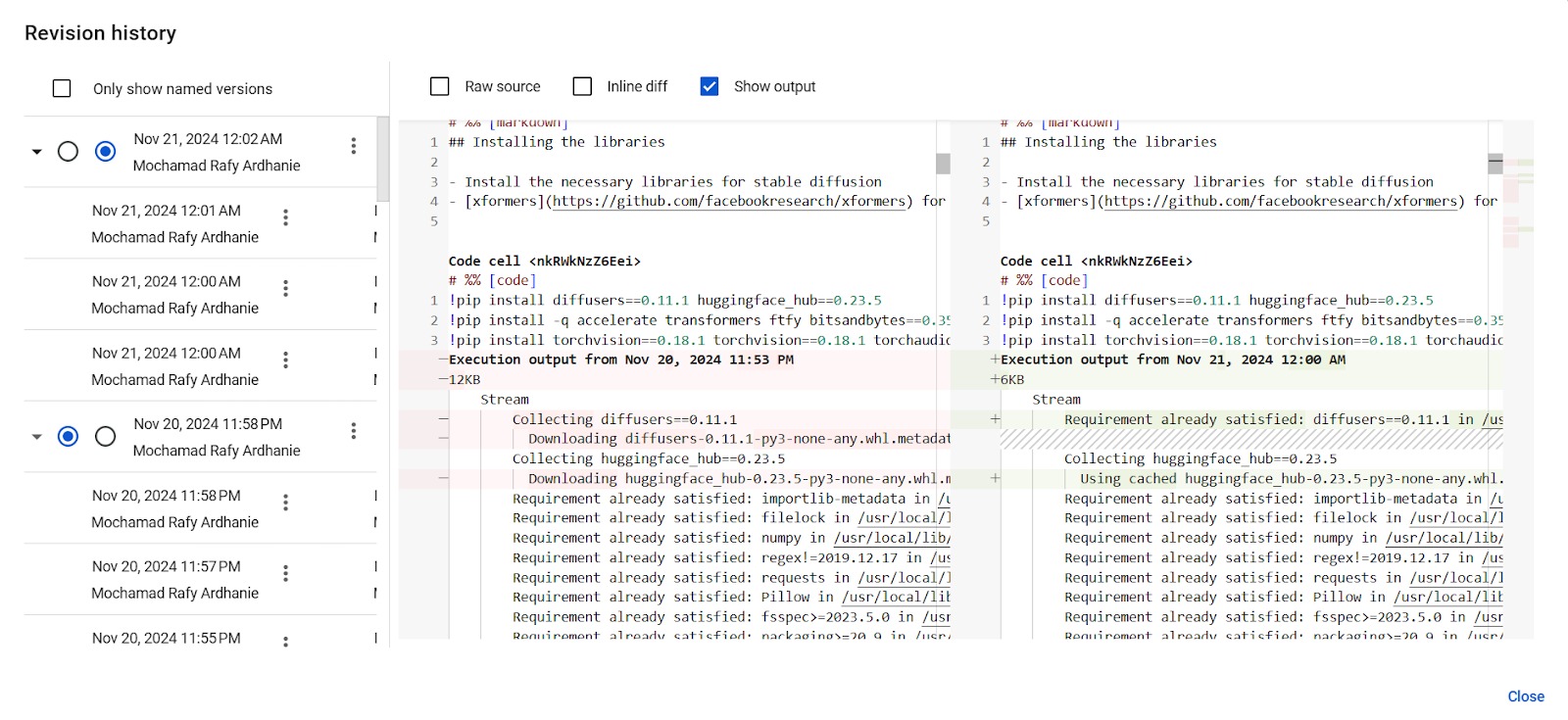

Loh, ngomong-ngomong VCS, sepertinya Google Workspace sudah memiliki kemampuan seperti itu, ya? Apakah itu termasuk VCS?

Tidak guys, Google Workspace bukanlah tools Version Control System (VCS) seperti Git, SVN, atau Mercurial. Google Workspace lebih tepat dikategorikan sebagai platform kolaborasi online yang menyediakan berbagai aplikasi untuk produktivitas dan kerja sama tim.

Memang betul Google Docs, Sheets, Colab, dan Slides memiliki fitur version history yang memungkinkan Anda melihat perubahan yang dilakukan dan kembali ke versi sebelumnya. Namun, fitur ini terbatas dan tidak sekompleks fitur yang ditawarkan oleh VCS sesungguhnya.

Jadi tolong dicatat, meskipun Google Workspace dan Sistem Kontrol Versi (VCS) sama-sama menawarkan fitur untuk melacak perubahan, keduanya memiliki tujuan dan fungsi yang sangat berbeda. Google Workspace adalah platform kolaborasi online yang dirancang untuk produktivitas dan kerja sama tim secara umum dengan fitur utama seperti pengeditan dokumen bersama, penyimpanan file, dan komunikasi. Fitur version history di Google Docs, Colab, Sheets, dan Slides memang berguna, tetapi lebih ditujukan untuk dokumen yang relatif sederhana dan tidak sekompleks fitur VCS.

Sementara itu, VCS seperti Git, SVN, dan Mercurial dirancang khusus untuk manajemen source code dan proyek pengembangan software. VCS menawarkan fitur-fitur advanced seperti branching, merging, commit yang deskriptif, dan rollback yang canggih. Fitur-fitur tersebut dapat mendukung alur kerja pengembangan software yang kompleks dan proyek berskala besar dengan banyak kontributor.

Singkatnya, Google Workspace unggul dalam kolaborasi dokumen, sedangkan VCS adalah alat yang tak tergantikan dalam pengembangan software profesional. Keduanya dapat digunakan bersamaan untuk produktivitas yang optimal, tetapi memiliki peran yang berbeda dan tidak dapat saling menggantikan.

Berikut perbedaan utama antara Google Workspace dan Version Control System (VCS).

| Fitur | Google Workspace | Version Control System (VCS) |

|---|---|---|

| Melacak perubahan | Ya | Ya |

| Kembali ke versi sebelumnya | Ya | Ya |

| Mendukung Kolaborasi | Ya (via real-time collaboration) | Ya (via branch dan merge) |

| Branching & merging | No | Ya |

| Sistem Kontrol Terdistribusi | No | Ya |

| Pesan Komit dan Perbedaannya | No | Ya |

Sedari tadi, kita sudah menyinggung Git, SVN, dan Mercurial, mungkin beberapa dari Anda sudah familier dengan tools tersebut, tetapi tenang saja jika belum terbiasa karena pada materi ini, kita akan mengupas tuntas pengertian tools tersebut bersama-sama.

Sekilas Informasi

Sebelum dapat mempraktikkan Control System pada pengembangan machine learning, ada hal dasar yang harus benar-benar Anda pahami terlebih dahulu. Tahukah Anda apa yang dimaksud dengan istilah “integration” dalam prinsip continuous integration? Sebenarnya, apa sih yang diintegrasikan?

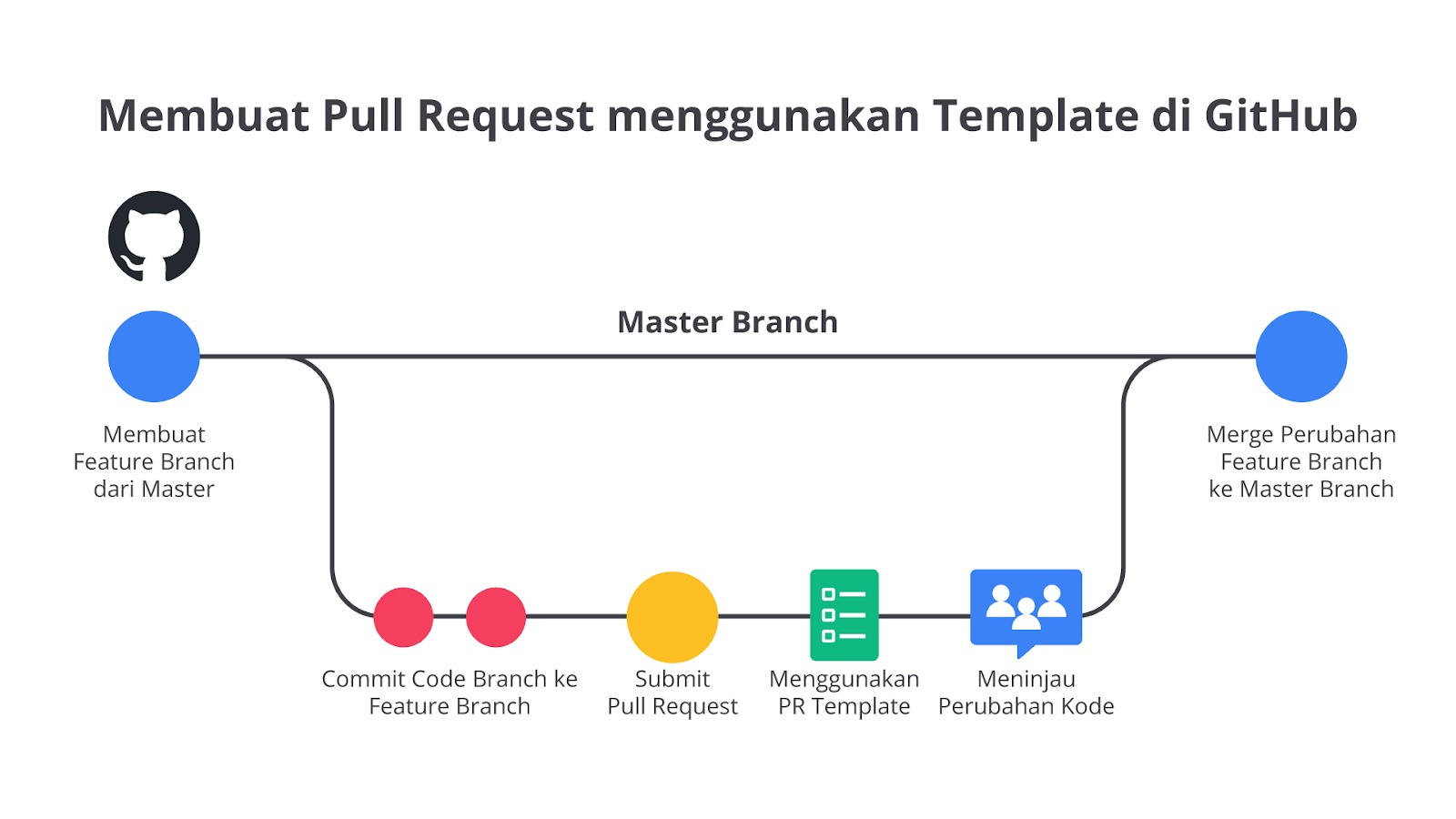

Jadi, integrasi di sini adalah penggabungan kode baru atau perubahan kode yang ditulis oleh satu atau banyak kontributor (bisa Developer, IT Operations, Tester/QA, dsb) ke dalam satu proyek aplikasi atau perangkat lunak. Proses integrasi ini biasanya dilakukan dengan merge (menggabungkan) feature branch ke main branch melalui pull request.

Materi ini merupakan dasar sebelum Anda mengelola version control system dengan Mlflow (akan kita pelajari nanti). So, jangan sampai di-_skip_ ya!

Git

Ada beberapa hal yang acapkali ditanyakan saat mengembangkan aplikasi, di antaranya sebagai berikut.

- “Bagaimana cara mengelola source code aplikasi yang dibangun oleh banyak developer?”

- “Bagaimana cara agar beberapa developer bisa mengerjakan sebuah proyek menggunakan codebase yang sama?”

- “Bagaimana agar fitur yang sedang dikerjakan seorang Developer tidak bertabrakan dengan pekerjaan Developer lain?”

Pernahkah Anda merasa frustrasi karena kehilangan kode berharga? Atau bingung menentukan versi file mana yang terbaru saat bekerja dalam tim? Atau mungkin pusing tujuh keliling saat harus menggabungkan perubahan kode dari beberapa orang? Tenang, Anda tidak sendirian! Banyak developer di luar sana yang juga mengalami hal serupa. Kabar baiknya, ada solusi jitu untuk mengatasi semua masalah itu Version Control System (VCS) atau Source Control Management, seperti Git.

Dengan Version Control, ibarat memiliki asisten digital super canggih, setiap developer bisa bekerja sama dalam satu codebase yang sama dengan mudah. Bayangkan, Anda bisa melacak setiap perubahan yang terjadi, mengetahui siapa yang mengubah kode, mengerjakan fitur baru tanpa mengganggu kode utama, dan masih banyak lagi kemudahan lainnya.

Menariknya lagi, Git ini bisa dijalankan di komputer lokal maupun di server. Nah, jika aplikasi dikembangkan oleh banyak developer, menggunakan Git server atau Git hosting menjadi pilihan yang cerdas. Ini akan memastikan source code yang dimiliki setiap developer selalu sinkron dan up-to-date. Ibarat sebuah perpustakaan pusat tempat semua orang bisa mengakses versi buku terbaru.

Anda bisa membuat Git server sendiri, atau lebih mudahnya lagi, menggunakan layanan berbasis cloud yang sudah populer seperti GitHub atau GitLab. Dengan Git hosting, mengelola repositori (tempat penyimpanan kode) menjadi jauh lebih praktis dan efisien.

Mungkin sebagian dari Anda sudah tidak asing dengan Git, bahkan mungkin sudah setia menggunakan GitHub sebagai Git hosting untuk menyimpan source code di internet.

Nah, bagi Anda yang baru ingin berkenalan dengan Git, jangan khawatir. Berikut beberapa istilah dalam Git yang perlu Anda ketahui agar semakin akrab dengannya.

Repository

Repository adalah istilah yang digunakan sebagai penyimpanan source code. Repository dapat bersifat local dan remote. Local repository merupakan repository yang berada di komputer pribadi developer dan digunakan selama proses penulisan kode. Sementara itu, remote repository adalah repository yang berada di server. Ia menjadi repository induk agar repository lokal dapat selalu tersinkron dan up-to-date. Jika kita berkolaborasi dengan banyak Developer, remote repository adalah solusinya. Salah satu contoh remote repository adalah GitHub repository.

Clone

Clone (cloning) adalah proses menyalin atau mengkloning repositori dari remote repository (misal, GitHub repository) ke local repository (komputer pribadi) untuk mempermudah penambahan, pengubahan, atau penghapusan kode; perbaikan konflik saat penggabungan branch (merge conflict); dan sebagainya. Saat Anda melakukan clone repository, itu berarti Anda mengambil salinan lengkap dari semua data yang dimiliki repository pada saat itu, termasuk semua versi dari setiap berkas dan folder untuk proyek tersebut.

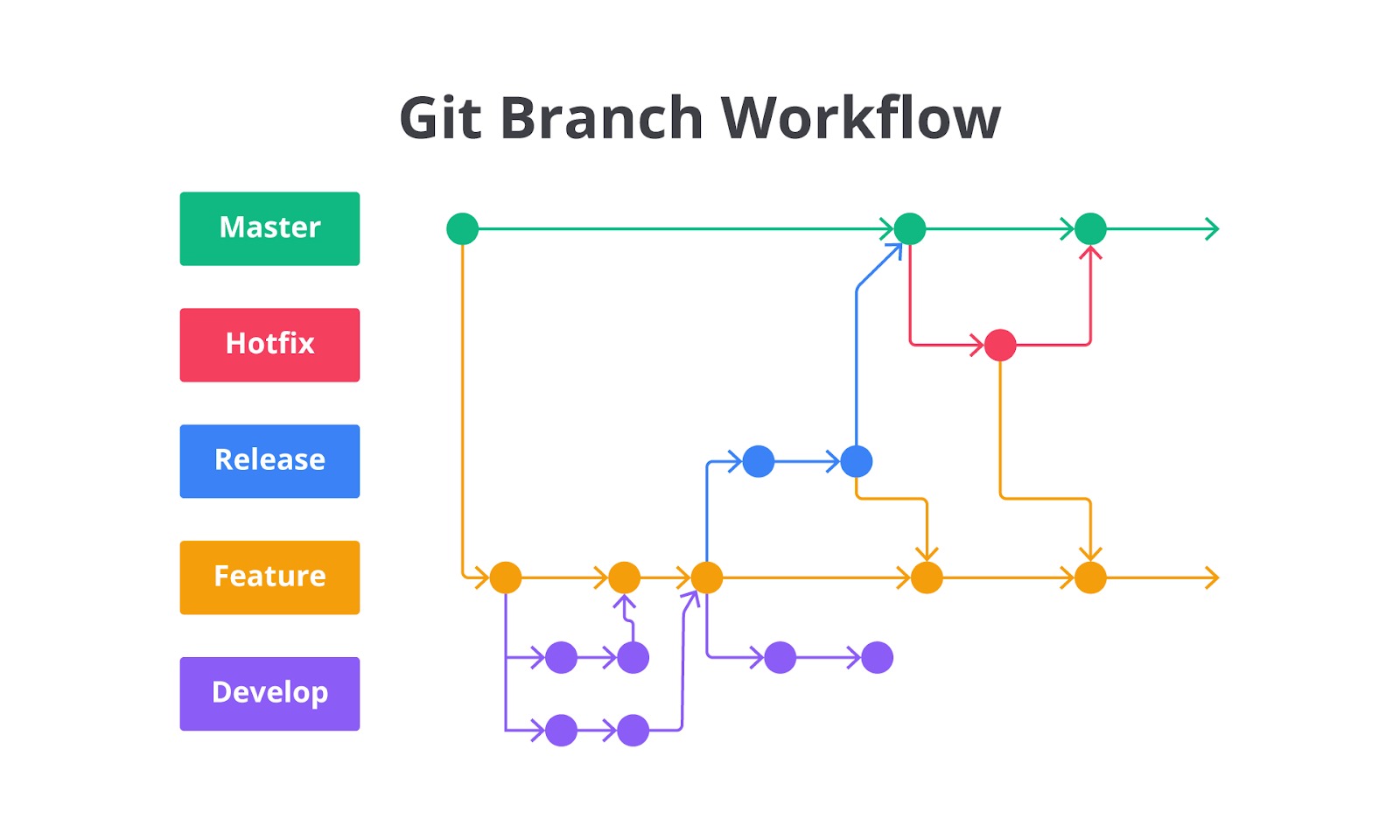

Branch

Sebagaimana yang kita tahu, git adalah version control system, di mana versioning ini salah satunya diatur oleh fitur branch (cabang). Setiap git repository memiliki minimal satu branch, yakni main branch (cabang utama). Umumnya, seluruh source code aplikasi yang sudah matang berada di main branch. Bila seorang developer hendak mengembangkan fitur baru, ia perlu membuat branch baru agar source code yang sudah matang tidak terganggu.

Commit

Commit merupakan sebuah aksi yang dilakukan Developer untuk membuat rekam jejak (snapshot) terhadap perubahan kode yang ia tulis. Seorang Developer akan melakukan commit ketika kode yang dituliskan sudah benar atau sudah mencapai poin-poin tertentu. Jika Developer tersebut mengalami kesalahan dalam menuliskan kode berikutnya, ia dapat dengan mudah mengembalikan source code ke versi di mana ia melakukan commit. Penting Anda ingat bahwa aksi commit haruslah dilakukan untuk perubahan kode sekecil mungkin. Tujuannya agar perubahan kode selalu terekam dengan baik.

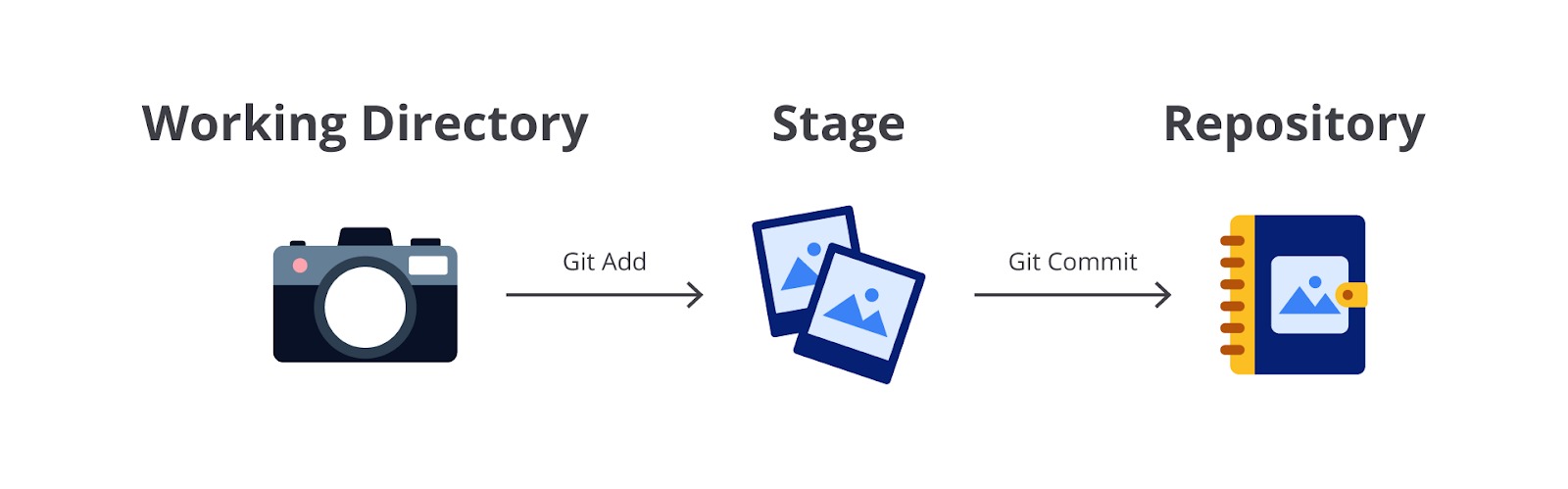

Ketika Anda menggunakan antarmuka GitHub, Anda dapat secara langsung menggunakan perintah git commit untuk menyimpan setiap perubahan yang dilakukan. Namun, ketika menggunakan local repository, Anda harus mengoperasikan git add sebelum memanggil git commit.

Git add berguna untuk menambahkan berkas yang dimodifikasi di working directory (direktori saat ini) ke dalam daftar antrean perubahan (stage), sedangkan git commit berfungsi untuk menambahkan berkas yang dimodifikasi tadi ke repository (ke local jika di komputer pribadi; ke remote jika langsung dari GitHub).

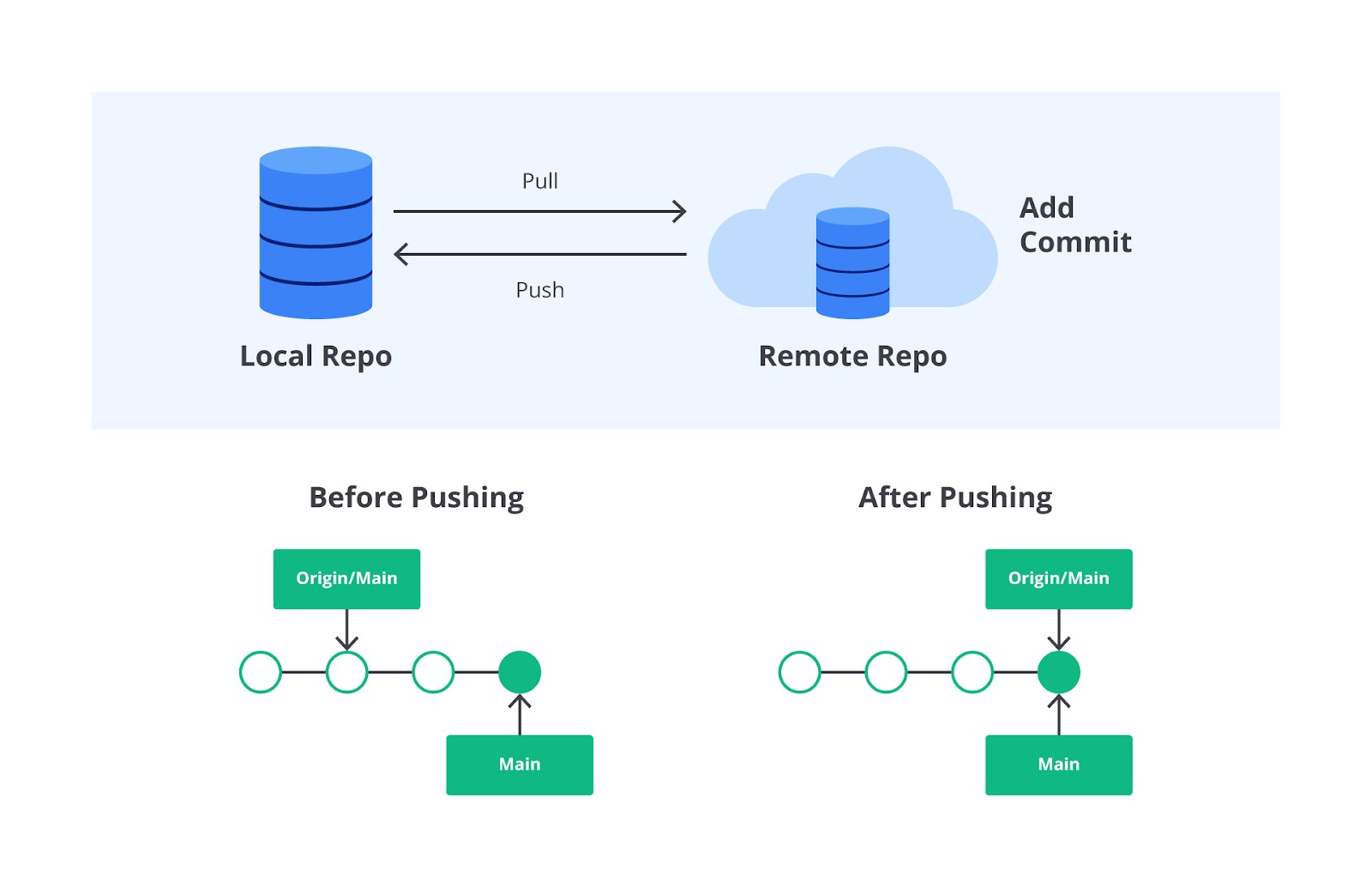

Push

Perintah git push merupakan tindakan lanjutan dari perintah git commit. Push merupakan aksi untuk mengirim perubahan kode dari local repository ke remote repository. Push dilakukan untuk memperbarui kode yang ada di remote dengan kode di local.

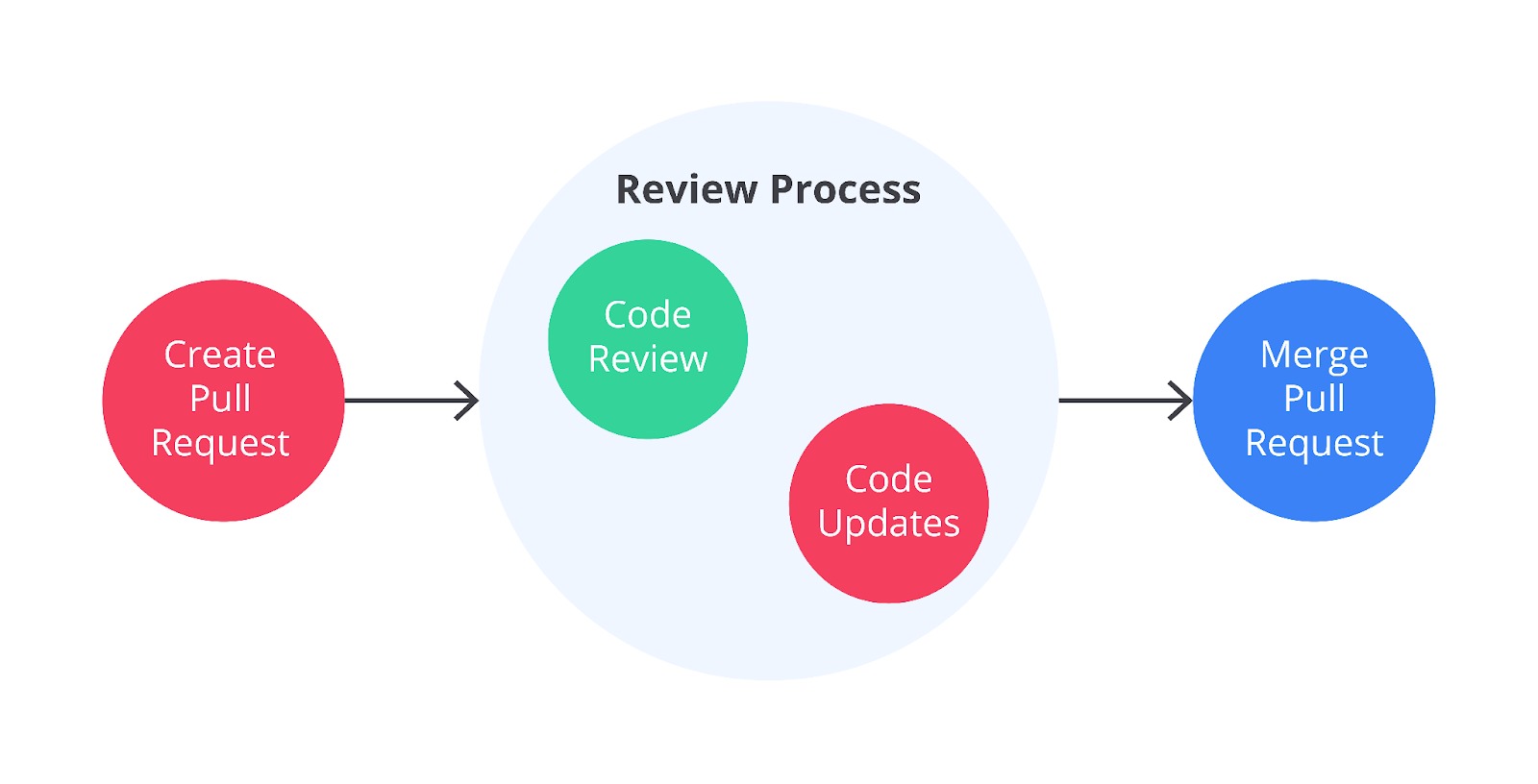

Pull Request

Pull Request adalah sebuah pengajuan/permintaan (request) untuk menggabungkan perubahan kode pada suatu branch ke branch lain. Contohnya, ketika mengembangkan fitur pada branch B dan pengembangannya sudah selesai serta kode yang ditulis sudah matang, Anda bisa melakukan pull request dari branch B ke main branch agar fitur yang sedang dikembangkan dapat diterapkan pada aplikasi.

Biasanya, proses pull request akan membutuhkan review dari developer lain (peer review) dan/atau sebuah test hingga akhirnya bisa bergabung ke main branch.

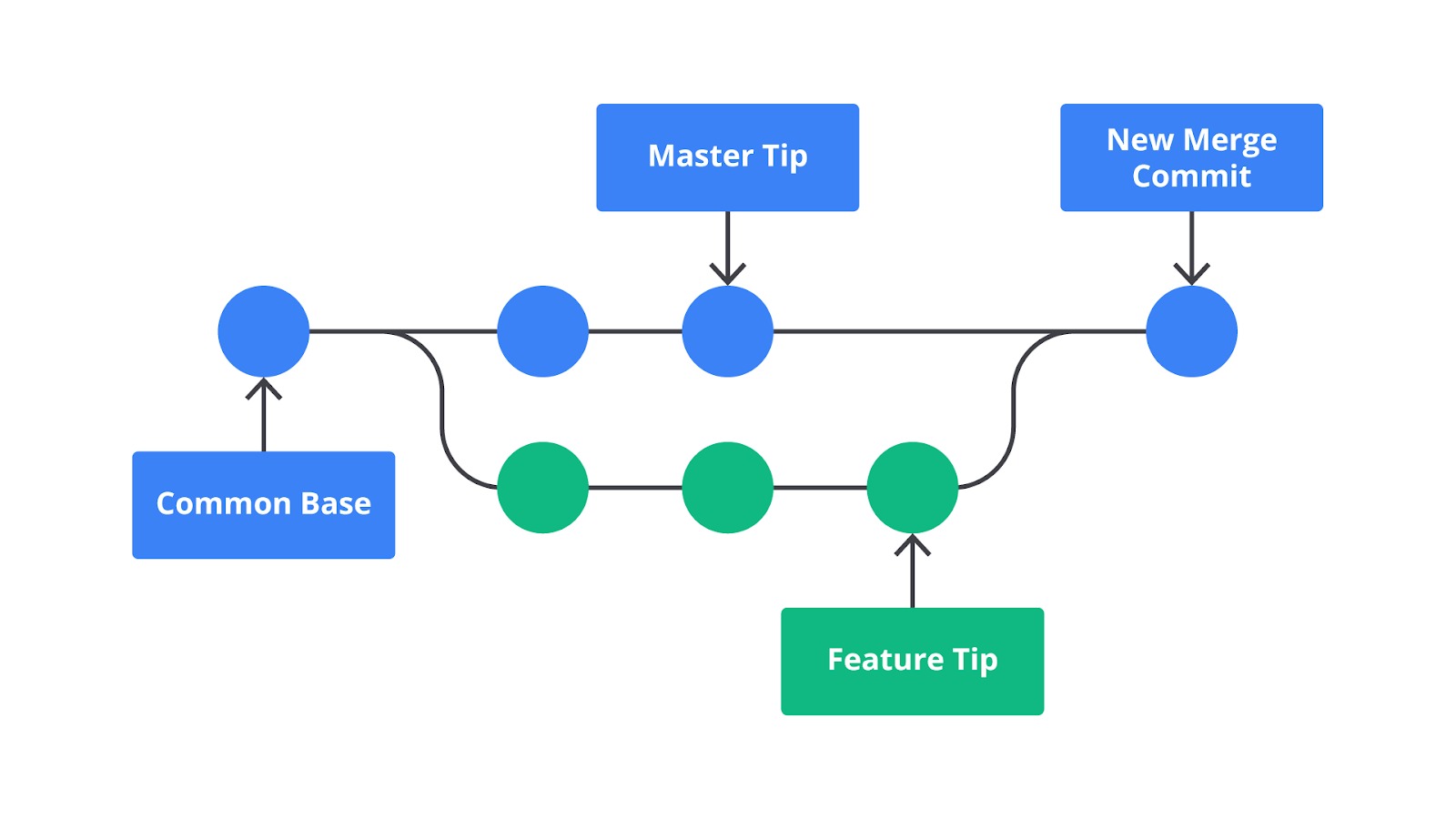

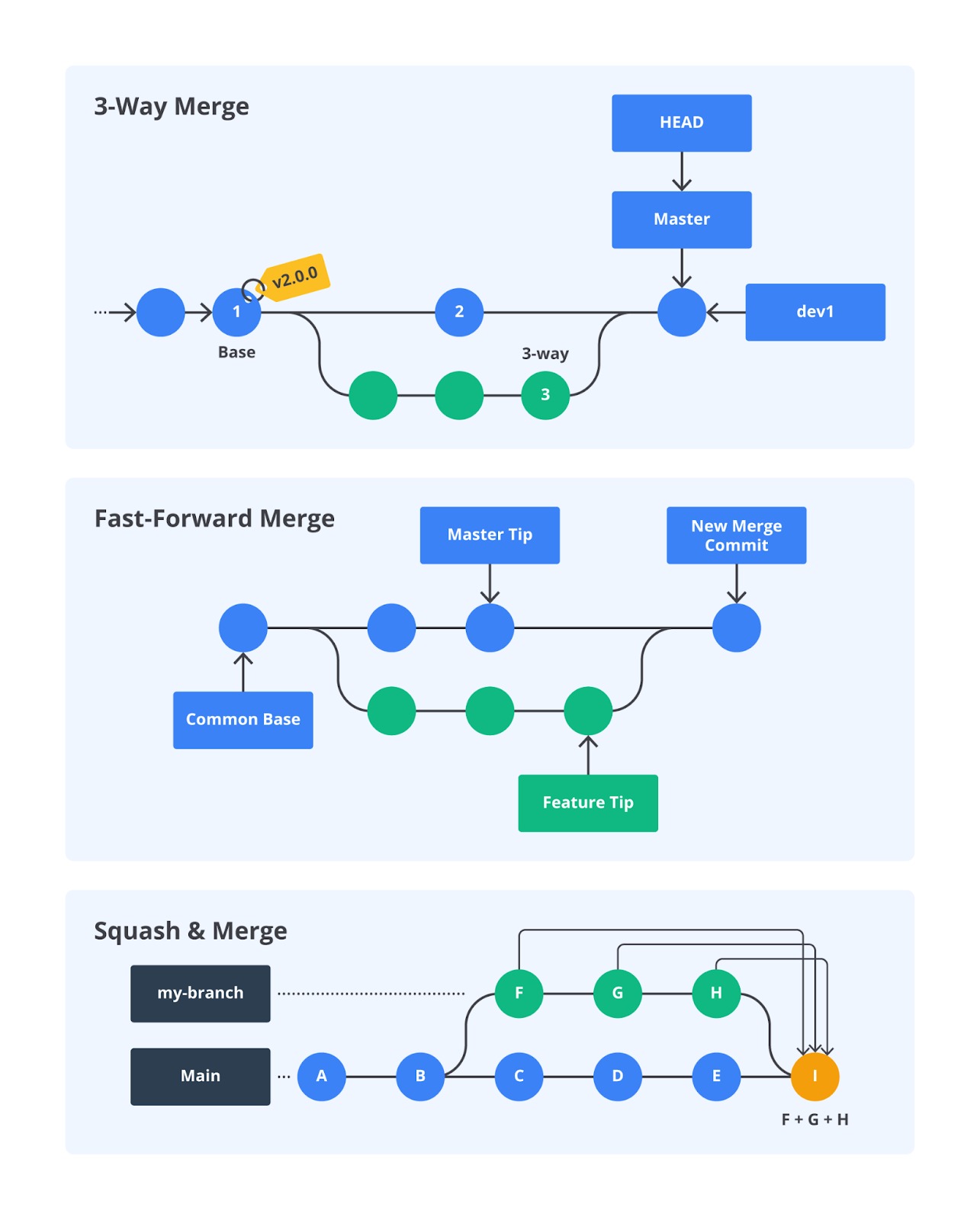

Merge

Merge merupakan aksi untuk menggabungkan perubahan kode pada suatu branch ke branch lain. Merge dapat dilakukan melalui atau tanpa pull request. Saat kita melakukan merge, Anda akan dihadapkan dengan beberapa opsi metode merge, seperti fast-forward merge, 3-way merge, squash and merge, dll.

Pastikan Anda benar-benar paham dengan semua istilah di atas sebab kita akan sering memakainya selama belajar di kelas ini. Lebih lengkapnya, Anda bisa belajar di kelas Belajar Dasar Git dengan GitHub.

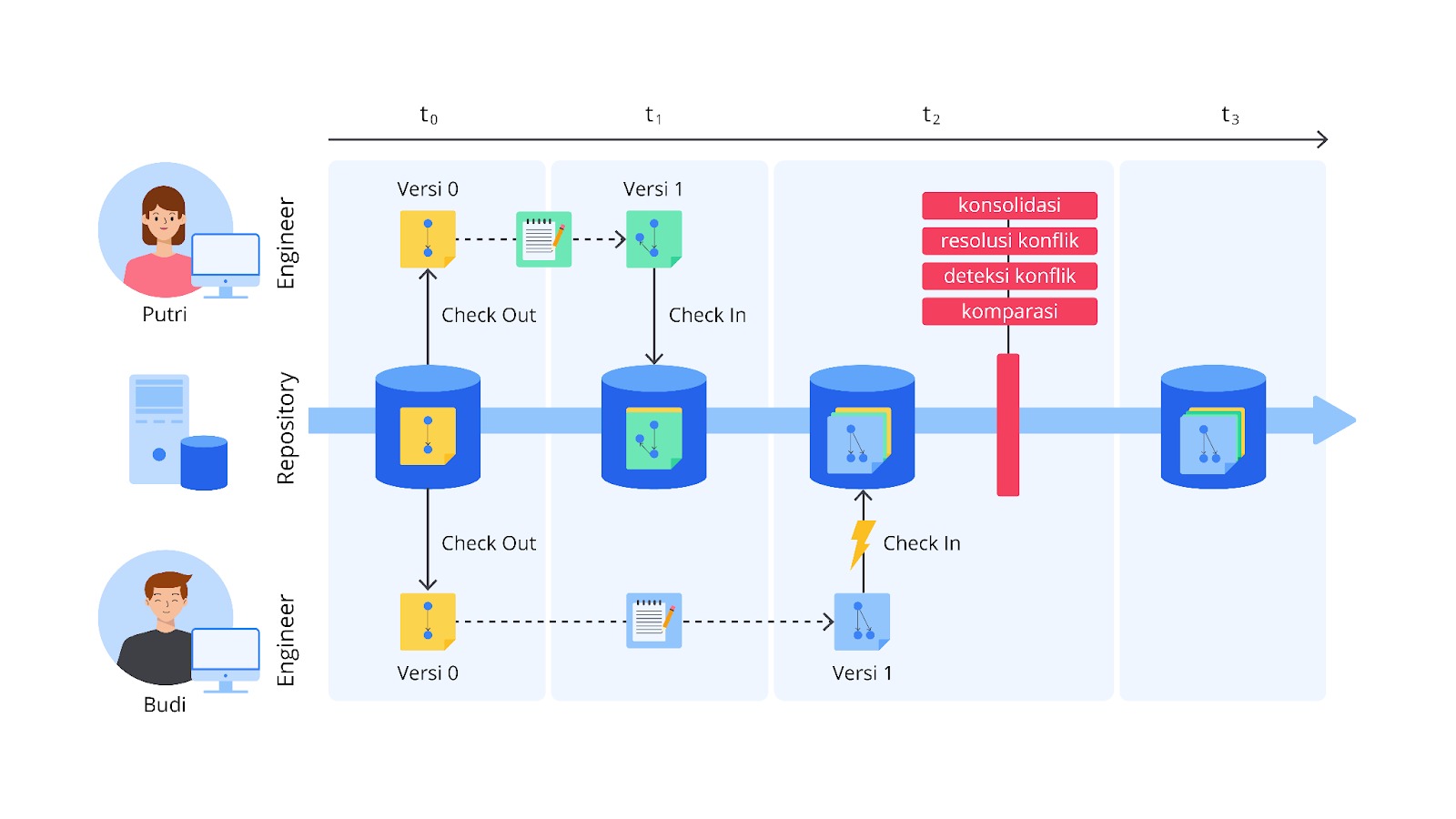

SVN

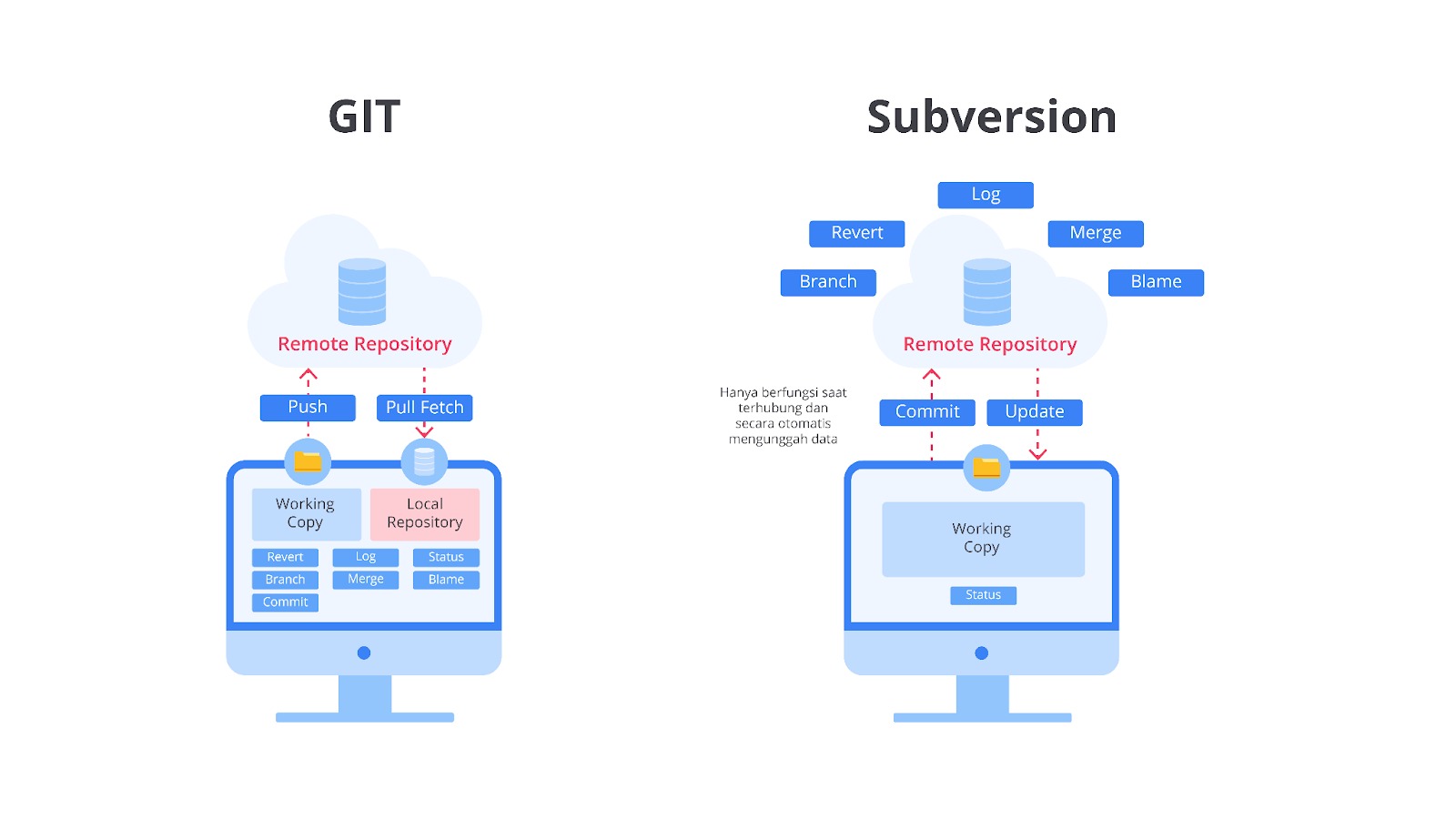

SVN atau Apache Subversion adalah salah satu jenis Centralized Version Control System (CVCS) yang digunakan untuk melacak perubahan pada file dan direktori dalam proyek pengembangan perangkat lunak. Dikembangkan oleh CollabNet pada tahun 2000 dan saat ini dikelola oleh Apache Software Foundation, SVN dirancang untuk menggantikan sistem CVS (Concurrent Versions System) yang memiliki banyak keterbatasan.

SVN memungkinkan pengguna untuk mengelola versi dari file proyek, baik itu source code, dokumen, maupun aset digital lainnya. Sistem ini sangat populer sebelum munculnya Distributed Version Control Systems (DVCS) seperti Git.

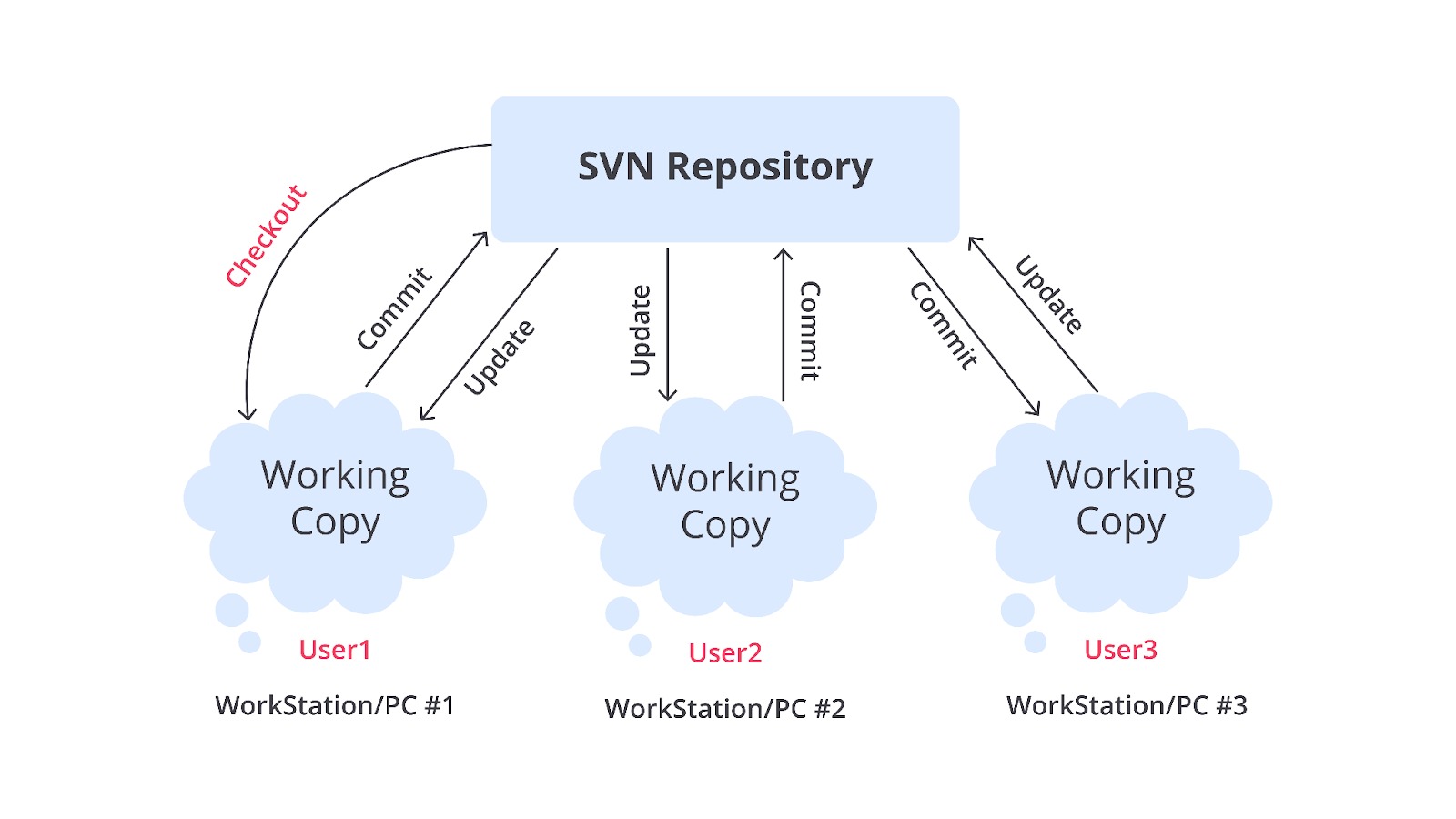

Apa bedanya dengan Git? Lalu, bagaimana SVN bekerja? SVN menggunakan server pusat untuk menyimpan semua data proyek, termasuk file, riwayat perubahan, dan metadata terkait.

Pengguna dapat mengakses server pusat untuk melakukan Checkout, Commit, dan Update pada proyek yang sedang dikerjakan.

Quick Recap

Checkout: mengunduh salinan file ke komputer lokal.

Commit: mengunggah perubahan file ke server pusat.

Update: mengambil perubahan terbaru dari server ke salinan lokal.

Biasanya repositori SVN berfungsi sebagai tempat penyimpanan pusat untuk semua file dan perubahan, sedangkan salinan lokal adalah versi sementara yang dimiliki setiap pengguna. Ketika pengguna membuat perubahan pada file lokal, mereka harus segera melakukan commit untuk menyinkronkan perubahan tersebut ke repositori pusat.

Layaknya tools VCS seperti Git, SVN juga memiliki beberapa fitur yang tidak kalah menarik. Beberapa di antaranya seperti berikut.

- **Versioning Direktori dan File

**SVN tidak hanya melacak perubahan pada file, tetapi juga pada direktori, termasuk operasi seperti penggantian nama, penghapusan, dan pemindahan direktori. - Atomic Commit

**SVN memastikan bahwa semua perubahan yang dilakukan selama proses commit diterapkan secara **atomic. Artinya, jika ada kesalahan, semua perubahan akan dibatalkan sehingga repositori tidak pernah berada dalam kondisi setengah selesai atau pun crash. - Branching dan Tagging

**SVN memungkinkan pengguna untuk membuat **branch (cabang) atau tag (label) dengan cepat. Ini memungkinkan pengelolaan eksperimen atau rilis proyek tanpa mengganggu versi utama. - Riwayat Revisi yang Lengkap

**Setiap perubahan yang dilakukan di repositori dicatat sebagai **revisi dengan nomor unik. Pengguna dapat dengan mudah melihat riwayat revisi untuk melacak perubahan atau mengembalikan versi sebelumnya. - **Dukungan untuk Binary Files

**SVN dapat menangani file biner dengan baik, seperti gambar atau dokumen, tanpa mengabaikan perubahan yang terjadi. - **Locking File

**SVN mendukung penguncian file untuk mencegah konflik saat file sedang diedit oleh beberapa pengguna, terutama file yang sulit digabungkan (merge). - **Protokol Akses Beragam

**SVN mendukung beberapa protokol akses, seperti HTTP, HTTPS, SSH, dan protokol SVN bawaan sehingga memudahkan pengguna untuk mengakses repositori dari berbagai lingkungan. - **Multi-Platform

**SVN dapat digunakan pada berbagai sistem operasi seperti Windows, Linux, dan macOS, serta memiliki antarmuka grafis tambahan (seperti TortoiseSVN) untuk mempermudah pengguna yang tidak terbiasa dengan antarmuka baris perintah.

Dari penjelasan di atas, kita dapat melihat bahwa SVN memiliki fitur-fitur dasar yang cukup lengkap untuk mengelola version control, seperti versioning direktori dan file, atomic commit, branching, dan tagging. Namun, untuk memahami SVN secara menyeluruh, kita perlu melihat lebih dari sekedar fitur-fitur dasarnya. SVN juga memiliki beberapa keunggulan spesifik yang menjadi ciri khasnya dan berkontribusi pada popularitasnya yang bertahan lama. Mari kita bahas keunggulan-keunggulan SVN tersebut satu per satu.

- **Stabil dan Teruji

**SVN telah digunakan selama lebih dari dua dekade dalam proyek-proyek besar sehingga dianggap sebagai alat yang stabil dan tepercaya. - **Repositori Terpusat

**Semua data disimpan di satu tempat, memudahkan pengelolaan akses, dan pencatatan perubahan. - **Dukungan untuk File Besar

**SVN lebih efisien dalam menangani file besar atau biner dibandingkan dengan beberapa DVCS seperti Git. - **Atomic Commit

**Fitur ini memastikan repositori tidak pernah berada dalam keadaan korup atau setengah selesai akibat kegagalan commit. - **Mudah Dipahami

**Untuk pengguna baru, konsep CVCS seperti SVN sering kali lebih sederhana dibandingkan DVCS karena pengguna tidak perlu memahami repositori lokal.

Kita telah melihat sisi terang dari SVN dengan kestabilannya yang teruji, repositori terpusat yang memudahkan pengelolaan, kemampuannya menangani file besar, atomic commit yang menjaga integritas data, dan kemudahan pemahamannya bagi pemula. Fitur-fitur ini membuat SVN bersinar di berbagai skenario.

Namun, ibarat sebuah timbangan, setiap kelebihan pasti memiliki sisi lain yang perlu dipertimbangkan. Untuk mendapatkan gambaran yang utuh, mari kita timbang dan lihat beberapa hal yang menjadi kekurangan SVN agar dapat memilih tools yang paling tepat sesuai kebutuhan.

- Ketergantungan pada Server Pusat

Karena semua data disimpan di server pusat, jika server tidak tersedia (downtime), pengguna tidak dapat melakukan commit atau mendapatkan pembaruan. - **Tidak Mendukung Pekerjaan Offline

**SVN mengharuskan koneksi ke server pusat untuk sebagian besar operasi. Tanpa koneksi, pengguna hanya dapat mengedit file tetapi tidak dapat melakukan commit atau update. - **Branching dan Merging yang Kurang Efisien

**Meski mendukung branching, proses merging di SVN kurang fleksibel dan efisien dibandingkan sistem seperti Git. Karena pendekatannya yang berbasis salinan, ketergantungan pada server pusat, serta kurangnya mekanisme pelacakan perubahan yang terintegrasi membuatnya kurang fleksibel dan efisien dibandingkan Git. - **Kinerja Menurun pada Repositori Besar

**Ketika repositori menjadi sangat besar, kinerja SVN dapat menurun, terutama untuk operasi checkout atau commit. - **Kurangnya Keamanan Data Lokal

**Karena pengguna tidak memiliki salinan penuh dari repositori, risiko kehilangan data lebih tinggi jika terjadi masalah pada server pusat.

Kita telah menimbang kekurangan SVN, seperti ketergantungan pada koneksi server pusat, proses branching dan merging yang lebih rumit, serta potensi masalah kinerja pada repositori yang sangat besar. Namun, perlu diingat bahwa tidak ada tools yang sempurna untuk semua situasi. Ibarat memilih alat yang tepat untuk pekerjaan tertentu, SVN pun memiliki skenario ideal di mana kekurangannya dapat diminimalisasi dan kekuatannya justru bersinar. Jadi, kapan sebaiknya kita menggunakan SVN? Mari kita lihat situasi dan kondisi yang membuat SVN menjadi pilihan yang tepat.

- Proyek yang Membutuhkan Struktur Terpusat

SVN sangat cocok untuk proyek yang membutuhkan pengelolaan terpusat. Dalam struktur ini, semua file dan riwayat versi disimpan di server pusat sehingga memudahkan pengelolaan akses dan kontrol atas data. Pertanyaannya, apa kapan ini bisa disebut relevan? Tenang, mari kita bahas beberapa kondisinya.- Ketika tim ingin memiliki repositori tunggal untuk semua file.

- Ketika manajer proyek ingin memonitor perubahan dengan cara yang lebih terpusat.

- Ketika keamanan repositori di server pusat menjadi prioritas utama.

Contoh sederhananya, perusahaan dengan kebijakan IT yang ketat, seperti lembaga pemerintah atau perusahaan besar, mungkin lebih memilih SVN karena struktur terpusatnya memberikan kontrol yang lebih besar atas siapa yang dapat mengakses repositori.

- Proyek dengan File Biner Besar

SVN memiliki kemampuan untuk menangani file biner besar seperti gambar, video, atau file desain yang tidak mudah digabungkan (merge). Sistem ini lebih efisien dalam menyimpan perubahan pada file biner dibandingkan dengan Git yang terkadang mengalami masalah kinerja untuk file besar. Pemilihan SVN akan lebih relevan ketika memenuhi kondisi berikut.- Dalam proyek desain grafis atau CAD (Computer-Aided Design).

- Dalam proyek media yang melibatkan file video, audio, atau animasi.

- Ketika perubahan file biner perlu dilacak secara rinci.

Seperti penjelasan di atas, pemilihan SVN dapat dilakukan ketika studio animasi atau perusahaan desain ingin melacak perubahan pada file desain grafis dan aset media.

-

Proyek dengan Tim Kecil hingga Menengah

SVN cocok untuk tim yang relatif kecil hingga menengah, terutama jika tim tersebut bekerja secara terorganisasi dan tidak membutuhkan banyak eksperimen paralel. Struktur yang terpusat dapat mengurangi kebutuhan untuk memahami konsep cabang (branching) yang kompleks sehingga lebih mudah diadopsi pada proyek skala kecil. -

Proyek dengan Infrastruktur Stabil

Karena SVN bergantung pada server pusat, sistem ini lebih cocok untuk proyek dengan infrastruktur jaringan yang stabil dan dapat diandalkan. Ketika server selalu tersedia, pengembang dapat bekerja tanpa hambatan, tetapi ketika infrastruktur kantor kurang stabil maka akan mengakibatkan “kurang kerjaan” alias tidak bisa bekerja dengan maksimal. -

Proyek yang Memerlukan Penguncian File (File Locking)

SVN menyediakan fitur file locking, yang memungkinkan pengguna untuk mengunci file tertentu agar tidak diubah oleh pengguna lain selama proses pengeditan. Fitur ini sangat penting untuk file yang tidak dapat digabungkan (merge) dengan mudah, seperti dokumen Word, spreadsheet, atau file biner lainnya. -

Proyek Tradisional atau Warisan (Legacy Projects)

Alasan ultimate-nya yaitu banyak proyek warisan (legacy) yang masih menggunakan SVN karena sudah diadopsi sejak lama dan migrasi ke sistem lain dianggap terlalu mahal atau kompleks. Selain itu, organisasi dengan kebijakan konservatif mungkin tetap menggunakan SVN karena stabilitas dan familiaritasnya.

Hingga saat ini, SVN tetap menjadi salah satu tools yang relevan dalam beberapa situasi tertentu, terutama ketika struktur terpusat, pengelolaan file besar, atau stabilitas repositori menjadi kebutuhan utama. Meskipun tidak sepopuler Git dalam dunia pengembangan perangkat lunak modern, SVN memiliki keunggulan dalam proyek-proyek dengan fokus pada pengelolaan sederhana, infrastruktur stabil, atau kebutuhan khusus seperti file locking.

Nah, setelah menyelami seluk-beluk Git dan SVN, kita jadi tahu bahwa masing-masing memiliki kekuatan dan kelemahannya sendiri. Git dengan branching dan merging yang powerful dan SVN dengan kemudahan pengelolaan repositori terpusat. Namun, bagaimana jika Anda mencari pilihan lainnya dalam kategori DVCS yang menawarkan keseimbangan antara fitur dan kemudahan penggunaan? Di sinilah Mercurial hadir sebagai pemain yang patut diperhitungkan. Mari kita berkenalan dengan Mercurial dan melihat apa yang membuatnya spesial.

Mercurial

Mercurial adalah sistem Distributed Version Control System (DVCS) yang cepat, efisien, dan dirancang untuk menangani proyek-proyek pengembangan perangkat lunak untuk berbagai macam skala proyek. Dikembangkan oleh Matt Mackall pada tahun 2005, Mercurial bertujuan untuk menyediakan sistem version control yang ringan, cepat, dan mudah digunakan, terutama bagi pengguna yang membutuhkan pengelolaan proyek dengan banyak file dan kolaborator.

Mercurial merupakan tools open-source yang dapat membantu tim melacak perubahan pada file proyek, mendukung kolaborasi, dan memastikan integritas data. Sebagai DVCS, Mercurial memungkinkan setiap pengguna memiliki salinan lengkap dari repositori, termasuk semua file, perubahan, dan riwayat proyek. Fitur ini memungkinkan pengguna bekerja secara independen dan offline tanpa bergantung pada server pusat.

Mercurial dapat menjadi pilihan lain ketika Anda mulai bosan menggunakan Git atau SVN karena memiliki karakteristik yang perlu dipertimbangkan, beberapa diantaranya seperti berikut.

- Kinerja Cepat: dirancang untuk menangani proyek besar dengan respons yang cepat, bahkan dengan ribuan file.

- Portabilitas: mendukung berbagai sistem operasi, termasuk Windows, macOS, dan Linux.

- Sederhana dan Ramah Pengguna: memiliki antarmuka baris perintah (CLI) yang intuitif dan konsisten sehingga mudah dipelajari oleh pemula.

- Reproduksi Penuh: setiap pengguna memiliki salinan lengkap dari repositori yang mencakup semua riwayat versi.

- Keamanan: menggunakan algoritma hashing kriptografi untuk melindungi data dan memastikan integritas repositori.

- Dukungan untuk Branching: Mercurial menyediakan mekanisme branching yang fleksibel dan efisien untuk pengembangan paralel.

Dengan karakteristik di atas, Mercurial didukung oleh berbagai macam fitur yang siap Anda gunakan untuk menunjang berbagai macam proyek. Sebenarnya, fiturnya tidak jauh beda dengan Git, tetapi Anda tidak boleh melewatkan penjelasannya, ya. Berikut fitur utama dari Mercurial yang perlu Anda ketahui.

- Repositori Terdistribusi

Setiap pengguna memiliki repositori lengkap, memungkinkan mereka bekerja offline dan menjaga keamanan data tanpa bergantung kepada satu server pusat. -

Branching yang Fleksibel

Mercurial menyediakan dua jenis branching yaitu Named Branches—Cabang dengan nama tertentu yang tercatat dalam repositori— dan Anonymous Branches—Cabang sementara yang dibuat dengan mekanisme seperti bookmark— sehingga branching pada Mercurial mudah dikelola dan mendukung pengembangan paralel. - **Mekanisme Merging yang Kuat

**Mercurial menggunakan algoritma merge otomatis untuk menyelesaikan konflik dengan opsi penyelesaian manual jika diperlukan. - **Antarmuka yang Konsisten

**Semua perintah Mercurial memiliki sintaks yang sederhana dan seragam, seperti hg commit, hg push, dan hg pull. Mirip dengan Git, ya? Tentu saja karena keduanya serupa tapi tak sama.???? - **Keamanan dan Integritas Data

**Mercurial menggunakan hashing SHA-1 untuk memastikan setiap perubahan dicatat dengan aman dan repositori tidak dapat dimodifikasi tanpa jejak. - Portabilitas

Dapat digunakan di berbagai sistem operasi tanpa perubahan signifikan, menjadikannya alat yang fleksibel untuk tim lintas platform. - **Kompatibilitas dengan Proyek Besar

**Mercurial dirancang untuk menangani proyek besar dengan banyak file dan pengguna tanpa penurunan kinerja yang signifikan.

Tentu saja, sebagai pilihan ketiga setelah Git dan SVN, Mercurial ini memiliki beberapa kekurangan yang menyebabkan popularitasnya kalah dari Git yang kini menjadi standar de facto untuk version control.

Salah satu kekurangannya adalah Mercurial memiliki ekosistem yang lebih sedikit dibandingkan Git sehingga banyak tools atau services yang tidak kompatibel sehingga perlu penanganan khusus. Kondisi tersebut mengakibatkan komunitas pengguna Mercurial tidak sebesar Git Community. Oleh karena itu, pengguna baru mungkin kesulitan mendapatkan dukungan atau tutorial dibandingkan dengan Git yang memiliki komunitas besar.

Setelah sekian lama, perjalanan materi ini telah membawa kita berkenalan dengan Git, SVN, dan Mercurial, tiga tools VCS yang mumpuni dengan fitur-fitur andalannya. Kita telah belajar tentang konsep distributed versus centralized, branching, merging, commit, dan berbagai istilah penting lainnya. Ibarat seorang musisi yang telah mengenal berbagai jenis instrumen, kini saatnya kita beralih dari teori ke praktik. Mari kita pelajari dasar-dasar penggunaan VCS yang akan memandu Anda dalam mengelola kode, berkolaborasi, dan melacak perubahan dengan efektif, terlepas dari tools VCS apa pun yang Anda gunakan.

Dasar-Dasar Penggunaan Version Control

Kita telah mempelajari konsep Version Control System dan berkenalan dengan berbagai tools-nya. Cukup dengan teori, saatnya beraksi sesuai dengan kutipan Tim Sanders berikut.

“Education without application is just entertainment. “ — Tim Sanders, Former Yahoo chief solutions officer.

Tidak afdal rasanya jika kita tidak langsung terjun ke lapangan untuk merasakan experience penuh materi ini. Sekarang, kita akan mempraktikkan semua itu dengan menggunakan Git, tools VCS yang paling populer di kalangan developer. Untuk mendapatkan pengalaman yang lebih seru, kita akan menggunakan GitHub, platform hosting Git yang luar biasa lengkap. So, sudah siap untuk petualangan coding yang sesungguhnya? Mari kita mulai praktik sederhana menggunakan GitHub.

GitHub adalah platform berbasis cloud untuk hosting, mengelola, dan berkolaborasi dalam proyek perangkat lunak menggunakan Git yang sudah kita pelajari. Tools ini dibuat pada tahun 2008 dan kini dimiliki oleh Microsoft. GitHub mendukung pengembangan perangkat lunak secara individu maupun tim, memungkinkan kolaborasi yang lebih mudah, transparan, dan terorganisasi seperti Git yang sudah kita bahas pada materi sebelumnya.

Nah, kita tidak akan membahas pengertian dan fitur-fitur pada GitHub karena sejatinya tools ini merupakan implementasi Git sehingga semua materinya sudah kita pahami sepenuhnya.

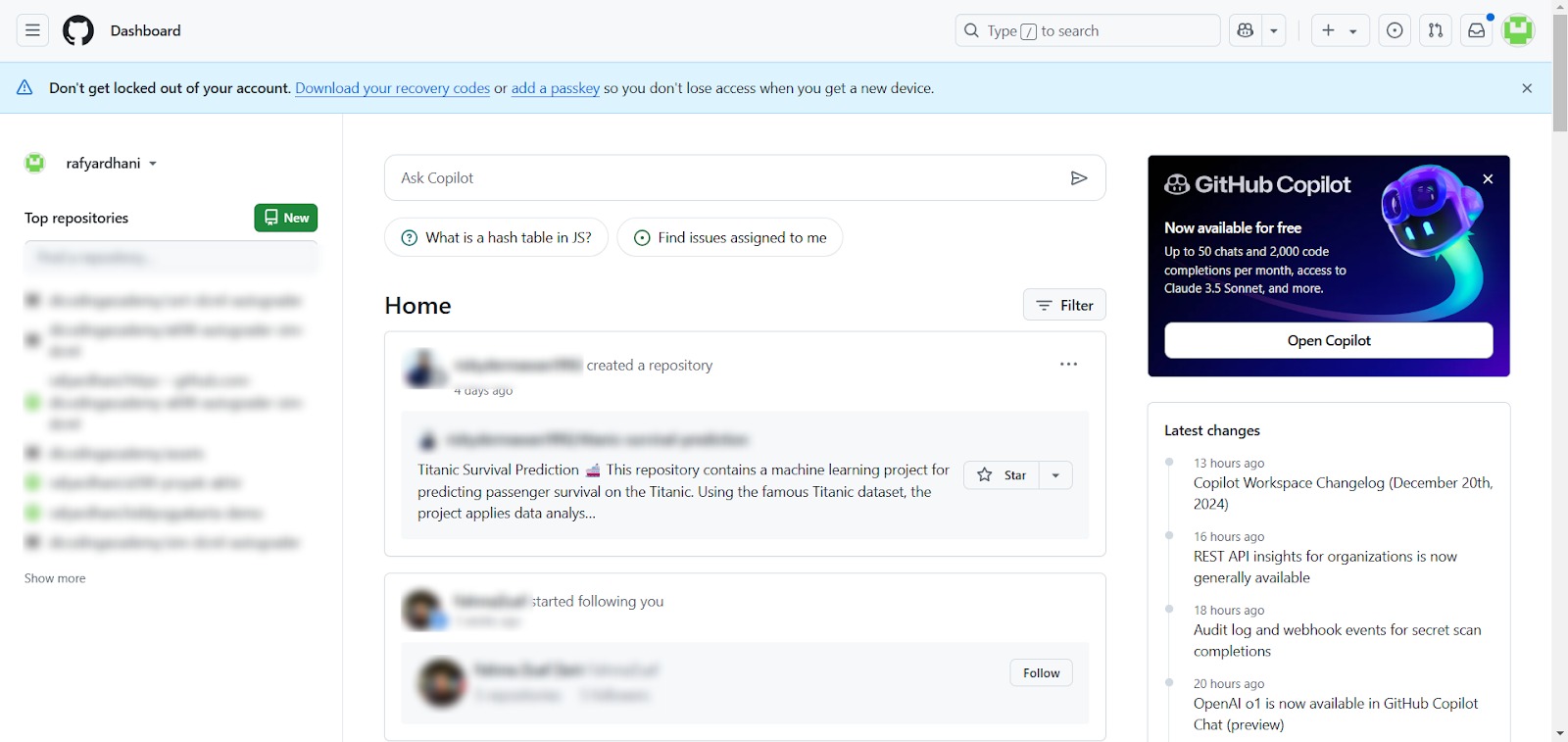

Hal pertama yang perlu kita lakukan adalah menuju halaman website GitHub dan masuk ke akun pribadi Anda. Pada tutorial ini, kita asumsikan Anda sudah memiliki akun GitHub yang siap digunakan sehingga halaman awal setelah masuk akun terlihat seperti berikut.

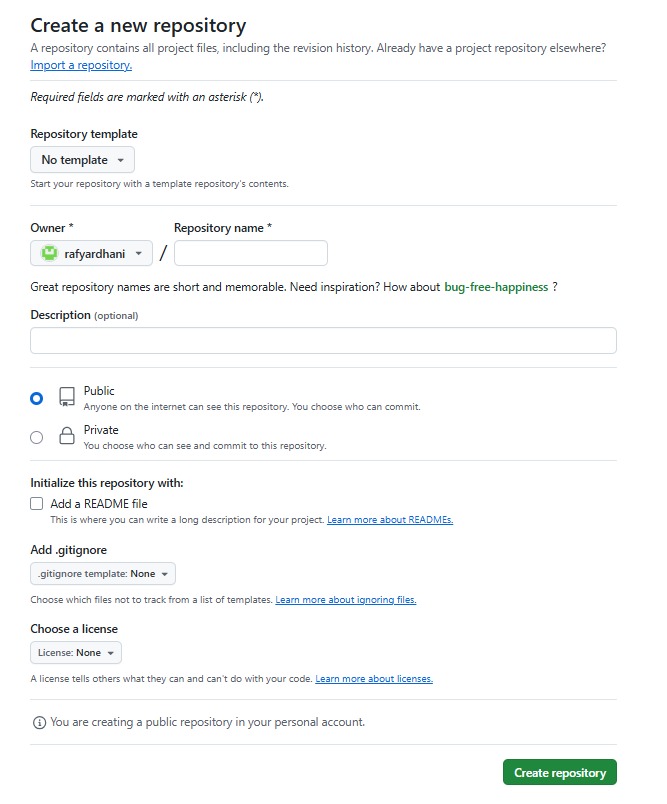

Selanjutnya, silakan klik tombol “New” untuk membuat sebuah repositori baru sehingga menampilkan interface berikut.

Pada halaman pembuatan repository, Anda akan diminta mengisi beberapa informasi yang dapat disesuaikan dengan kebutuhan proyek. Beberapa hal penting yang perlu Anda ingat mencakup poin-poin berikut.

- Owner

Berisikan username pemilik repository Github. Menariknya, Anda bisa memilih akun pribadi Anda atau organisasi jika Anda menjadi anggota organisasi di GitHub. - Repository Name

Masukkan nama untuk repository. Contohnya latihan-mlsystem. - Description (Optional)

Tambahkan deskripsi singkat tentang repository Anda. Contoh: Repository untuk belajar GitHub pada kelas Membangun System Machine Learning. - Privacy Settings

- Public: semua orang bisa melihat repository ini (open-source).

- Private: repositori ini hanya dapat diakses oleh Anda dan pengguna yang Anda undang termasuk anggota organisasi.

- Initialize Repository

Centang “Add a README” file jika Anda ingin langsung memiliki file README, biasanya digunakan untuk menjelaskan proyek Anda secara detail. - Opsional

- Tambahkan file .gitignore untuk mengecualikan file tertentu dari version control (pilih template yang sesuai dengan jenis proyek Anda).

- Tambahkan License untuk menetapkan lisensi proyek sesuai dengan kebutuhan proyek Anda.

Setelah mengisi semua detail, klik tombol “Create repository” di bagian bawah halaman. Repositori baru Anda akan dibuat secara otomatis dan Anda akan diarahkan ke halaman utama repositori tersebut.

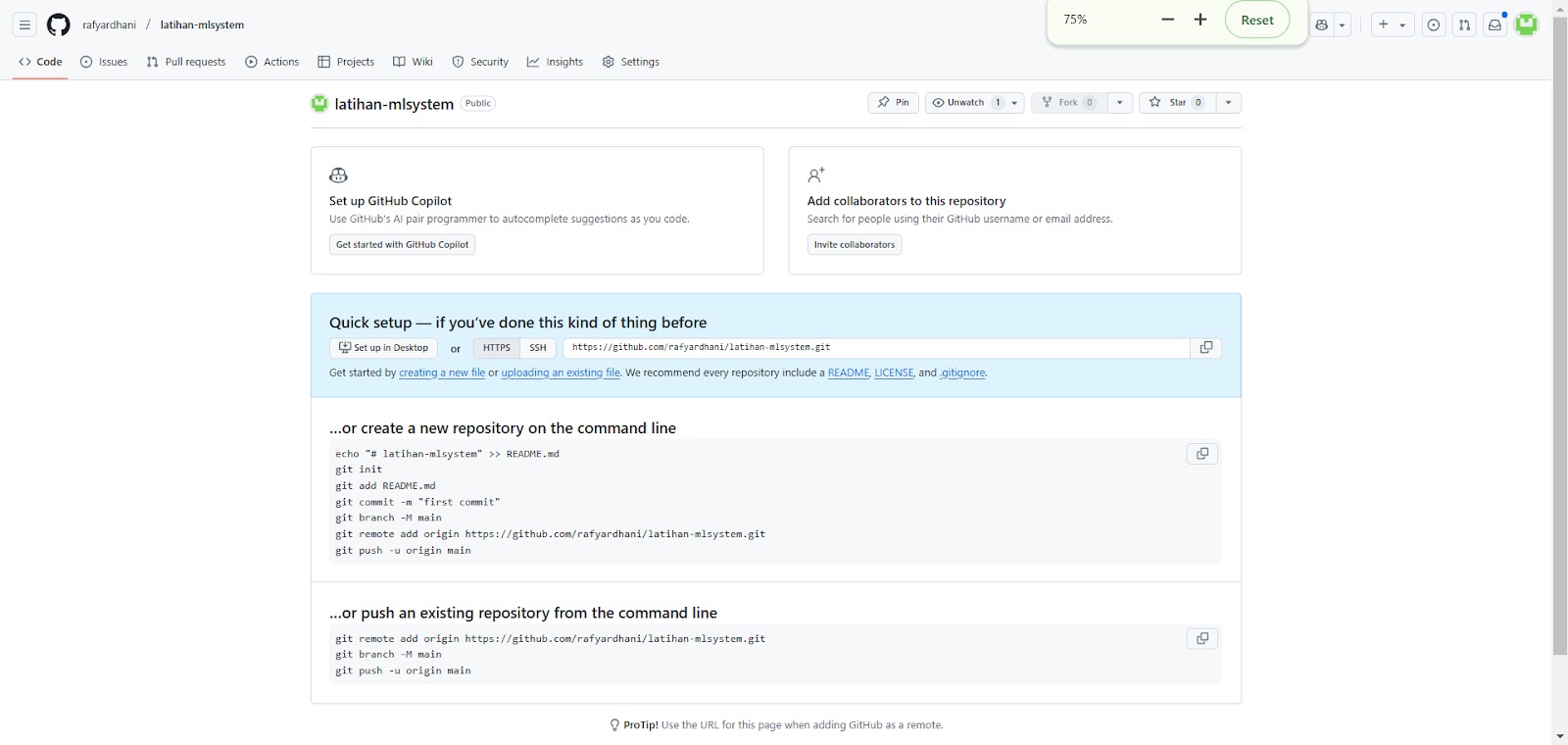

Halaman ini memiliki banyak sekali tombol action yang dapat Anda pilih untuk melanjutkan proyek. Namun, Anda tidak perlu risau karena pada materi ini kita tidak akan menggunakan semua tombol action pada bagian navbar. Sebagai tahapan awal, mari kita fokus pada section utama yang berisikan dua cara untuk memulai menggunakan repositori baru.

Quick Setup

Pada bagian ini, GitHub memberikan dua cara untuk memulai menggunakan repositori baru.

- Set up in Desktop: opsi ini digunakan untuk mengatur repositori menggunakan aplikasi GitHub Desktop.

- HTTPS/SSH URL: URL repositori yang dapat digunakan untuk menghubungkan repositori lokal ke repositori GitHub menggunakan protokol HTTPS atau SSH.

Membuat Repositori Baru dari Command Line

GitHub menyarankan langkah-langkah untuk menginisialisasi repositori baru di komputer lokal Anda dan menghubungkannya ke repositori di GitHub dengan mengikut langkah-langkah berikut.

-

**Autentikasi Akun GitHub

**Jika ini merupakan kali pertama Anda menggunakan GitHub pada terminal, pastikan Anda sudah memberikan akses akun yang akan digunakan pada terminal komputer. Anda dapat menggunakan perintah berikut untuk mengonfigurasi Git agar menggunakan PAT sebagai kredensial.- git config --global user.name “NamaAnda”

- git config --global user.email “email@example.com”

Setelah semua env dipastikan aman, Anda harus memasukkan sebuah kode sebagai password untuk mengakses repository GitHub. Anda dapat membaca dokumentasi resmi GitHub berikut untuk mendapatkan personal access token (PAT).

Ganti “NamaAnda” dengan username github dan “email@example.com” dengan email yang terhubung dengan github Anda.

-

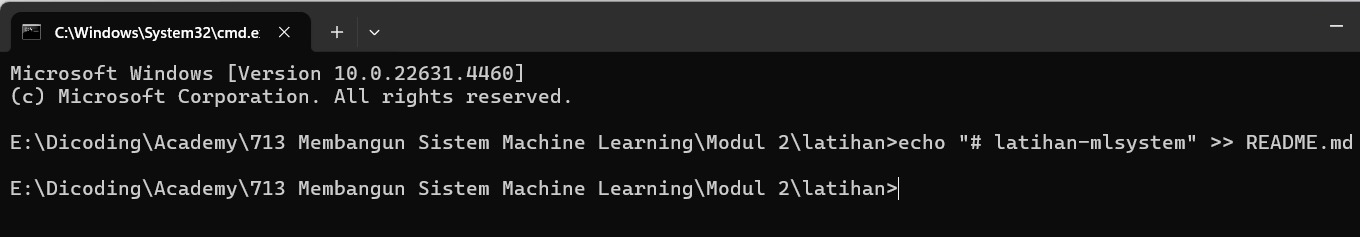

(Opsional) Buat File README.md

Jalankan Perintah berikut pada command line untuk membuat file README.md dengan konten awal # latihan-mlsystem.echo “# latihan-mlsystem” » README.md

File ini biasanya digunakan untuk menjelaskan proyek Anda, tidak ada batasan tertentu untuk mengenai isinya tetapi biasanya penjelasan lengkap mulai dari deskripsi dan penggunaan proyek.

-

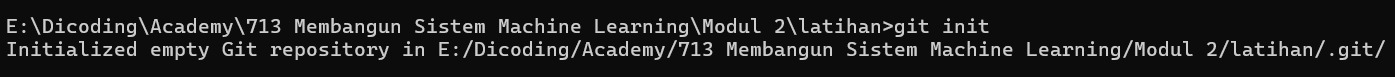

Inisialisasi Repositori Lokal

Selanjutnya jalankan perintah berikut pada command line yang sama. Anda perlu memastikan bahwa repositori yang digunakan sudah benar, ya.git init

Perintah ini mengubah direktori lokal Anda menjadi repositori Git sehingga nantinya Anda dapat melakukan sinkronisasi setiap kali merubah source code pada direktori lokal.

-

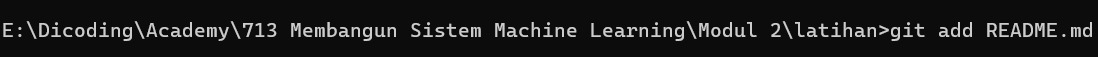

Tambahkan File ke Staging

Gunakan perintah berikut untuk menambahkan file README.md ke staging area commit.git add README.md

-

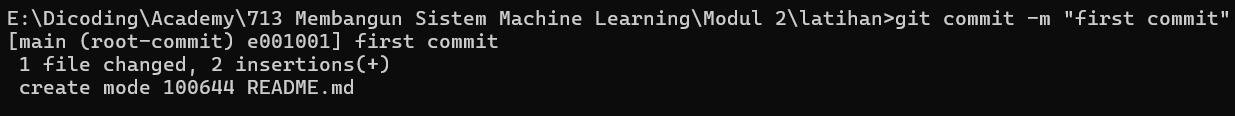

Commit Perubahan

Fungsi commit untuk mencatat perubahan pertama dengan pesan “first commit” sebagai deskripsinya. Anda dapat menyesuaikan pesan sesuai dengan perubahan yang dilakukan.git commit -m “first commit”

-

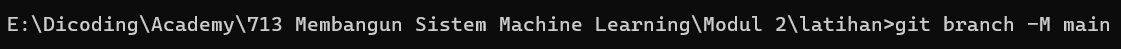

Buat Cabang Utama (Main/Master)

Perintah ini mengubah nama branch default menjadi main/master sesuai dengan nama branch yang Anda tentukan. -

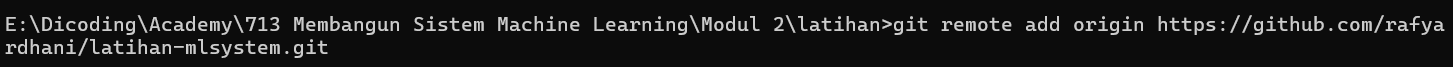

Hubungkan ke Repositori GitHub

Gunakan perintah berikut untuk menghubungkan repositori lokal Anda ke repositori GitHub dengan URL yang disediakan.git remote add origin https://github.com/

/<nama\_repo>.git [](# "dos-d12e80a38638757606dcb22482ee281920250317130446.png") -

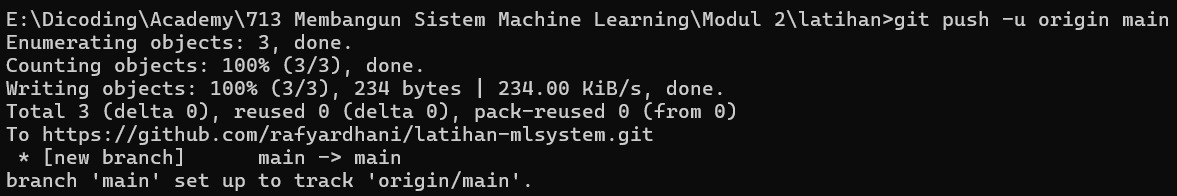

Push ke Repositori GitHub

Terakhir, gunakan perintah mengunggah (push) branch main ke repositori GitHub sehingga semua perubahan Anda dapat dilihat di GitHub.git push -u origin main

Dengan mengikuti tahapan di atas, Anda telah berhasil menghubungkan repositori lokal dengan remote repositori GitHub sehingga kelak Anda dapat melakukan sinkronisasi setiap perubahan dan menyalin seluruh proyek ke lingkungan kerja yang baru.

Jika masih ada hambatan, jangan sungkan untuk bertanya via Forum Diskusi ya.

Eh, tetapi bagaimana kalau kita sudah memiliki sebuah proyek yang sudah rampung? Tenang, GitHub juga menyediakan fitur untuk mengunggah (push) seluruh repositori yang sudah Anda kerjakan sejak zaman dahulu kala.

Menghubungkan Repositori yang Sudah Ada ke GitHub

Jika Anda memiliki repositori lokal yang sudah ada dan ingin menghubungkannya ke repositori GitHub tentu kita tidak perlu mengikuti semua langkah pada metode sebelumnya. Pada metode ini hanya terdapat tiga langkah secara umum (dapat Anda sesuaikan) dengan tahapan seperti berikut.

-

Tambahkan Remote Repository

Gunakan perintah yang sama untuk menambahkan repositori GitHub sebagai remote dengan nama origin seperti pada metode sebelumnya. Pastikan Anda sudah berada pada direktori yang diinginkan ya.- git remote add origin https://github.com/

/<nama\_repository>.git

- git remote add origin https://github.com/

-

Ganti Nama Cabang Utama

Perintah ini mengubah nama branch default menjadi main/master sesuai dengan nama branch yang Anda tentukan.- git branch -M main

-

Push Perubahan ke GitHub

Terakhir, gunakan perintah mengunggah (push) branch main ke repositori GitHub sehingga semua perubahan Anda dapat dilihat di GitHub.- git push -u origin main

Dengan mengikuti langkah-langkah di atas Anda dapat memulai bekerja dengan repositori GitHub baik dengan membuat repositori baru dari awal maupun menghubungkan repositori yang sudah ada di komputer Anda. Setelah selesai, Anda dapat mulai menambahkan file, mengelola versi kode, dan berkolaborasi dengan tim Anda menggunakan repositori GitHub tersebut.

Apakah semuanya selesai setelah kita menamatkan materi GitHub? Tentu saja tidak karena ini merupakan tahapan awal bahkan tidak mencakup 10% materi kelas Membangun System Machine Learning.

GitHub itu ibarat potongan puzzle penting dalam alur kerja pengembangan software, yang menyediakan platform untuk kolaborasi dan manajemen kode yang efektif. Namun, dalam proyek machine learning, puzzle tersebut belum lengkap. Kita membutuhkan kepingan lain untuk melacak eksperimen, mengelola model, dan memastikan reproducibility. Kepingan puzzle yang hilang itu salah satunya adalah MLflow.

Hah, apa hubungannya dengan MLflow?

Untuk menjawab pertanyaan tersebut mari kita lihat bagaimana MLflow melengkapi puzzle alur kerja machine learning kita, membuatnya lebih utuh dan efisien.

Pengenalan MLflow: Tracking dan Project

Sejauh ini kita telah mengetahui bahwa GitHub menjadi tools yang sangat berguna dalam pengembangan software dengan menyediakan platform untuk berkolaborasi, mengelola versi kode, dan melacak perubahan. Namun, materi tersebut belum memasuki tahapan pengembangan machine learning.

Sampai di sini, tentu banyak sekali pertanyaan untuk mengatasi permasalahan pembangunan model machine learning pada kelas-kelas sebelumnya.

- Bagaimana kita melacak berbagai eksperimen yang kita jalankan?

- Bagaimana kita mengelola versi model yang berbeda-beda?

- Bagaimana kita memastikan bahwa hasil yang kita dapatkan dapat direproduksi kembali?

Di sinilah MLflow hadir sebagai solusi yang Andal. So, Mari kita berkenalan dengan MLflow, sebuah platform open-source yang dirancang khusus untuk menyederhanakan dan menstandardisasi machine learning lifecycle.

Mungkin tebersit di benak Anda “apa sih MLflow itu?” Tenang saja, mari kita bahas secara runut dari awal.

MLflow adalah platform open-source yang dirancang untuk mengelola alur kerja machine learning (ML) secara end-to-end. MLflow membantu para data scientist, machine learning engineer, dan tim pengembang untuk mencatat, melacak, mengelola, dan mendistribusikan model ML dengan lebih mudah. Dengan MLflow, semua elemen penting dalam proyek ML, seperti eksperimen, parameter, metrik, artefak, dan model, dapat dikelola secara terpusat.

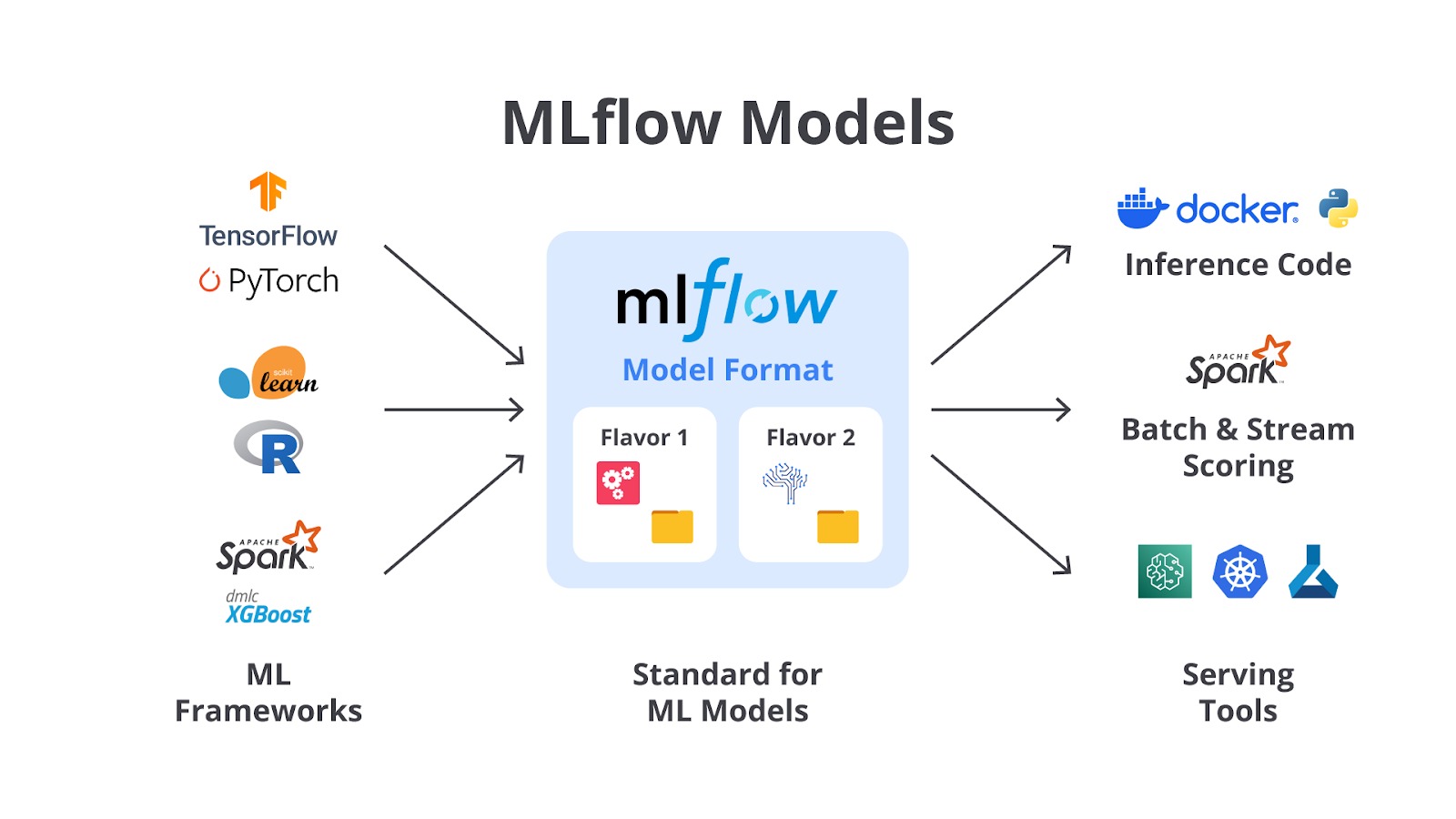

MLflow dapat digunakan bersama dengan berbagai library machine learning seperti TensorFlow, PyTorch, Scikit-learn, XGBoost, dan 20 library lainnya.

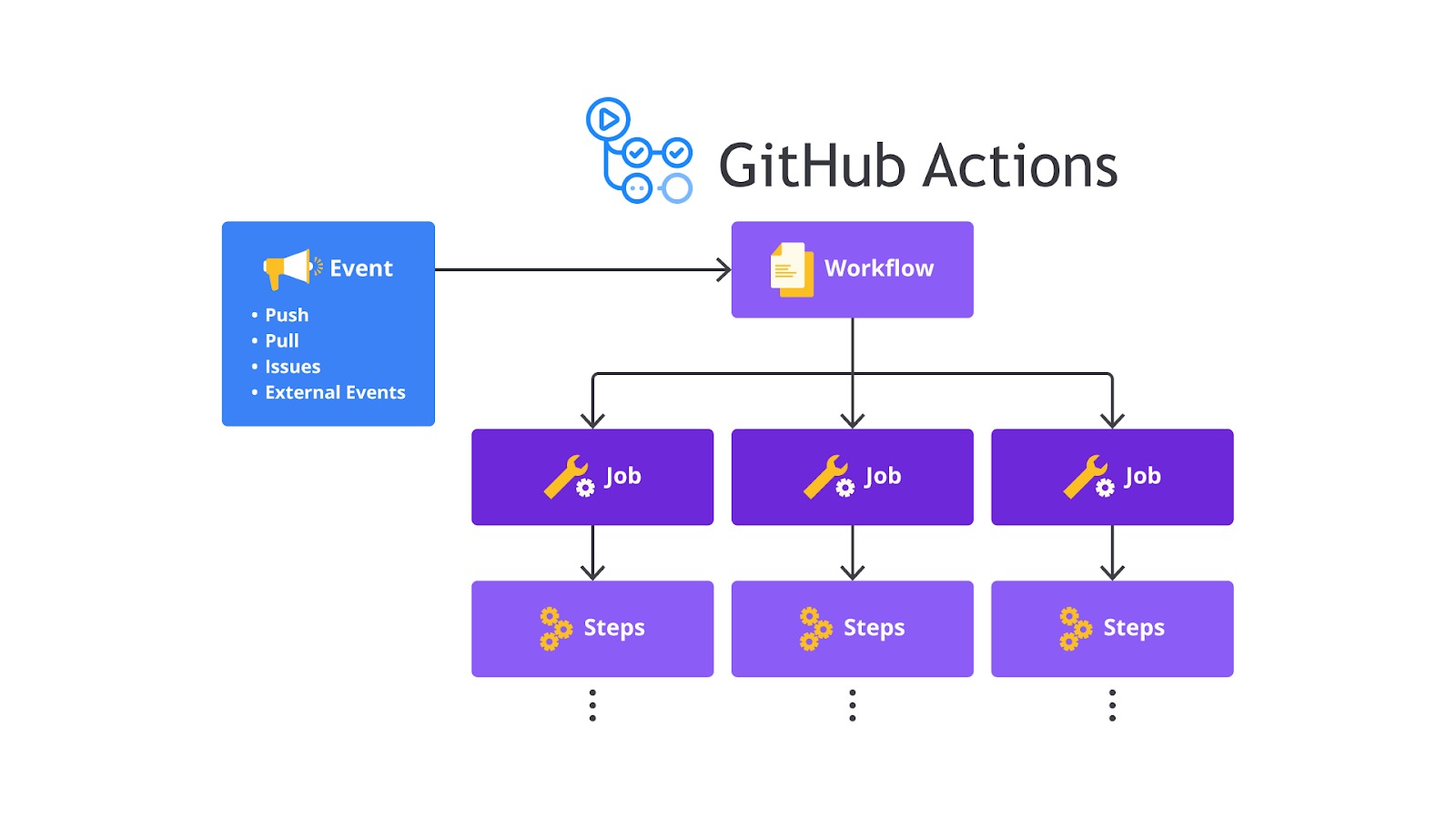

Platform ini juga mendukung integrasi dengan alat CI/CD seperti GitHub untuk mempermudah implementasi dan manajemen model di lingkungan produksi. Tidak berhenti di sini, sebagai tools yang sangat powerful tentunya MLflow memiliki berbagai macam fitur yang siap membantu Anda membangun sistem machine learning.

Lalu, bagaimana cara menggunakan semua fitur di atas? Eitss, sebagai permulaan, mari kita bahas cara menginstal MLflow pada local environment terlebih dahulu_._ Sebenarnya, proses yang dilakukan sama saja dengan library lainnya. Anda dapat menggunakan pip sebagai tools untuk menginstal MLflow seperti berikut.

- pip install mlflow

Namun, jika ingin menguji fitur-fitur baru dan memvalidasi versi MLflow lainnya, Anda dapat menginstal kandidat rilis terbaru dengan menggunakan kode berikut.

- pip install --pre mlflow

Last but not least, jika Anda ingin menguji versi spesifik kandidat rilis MLflow, silakan gunakan kode berikut, ya.

- pip install mlflow==2.14.0rc0

Sebagai informasi, pada kelas ini kita akan menggunakan versi 2.18.0 sehingga Anda dapat melakukan instalasi dengan menggunakan kode berikut jika ingin menyamakan dengan tutorial.

- pip install mlflow==2.18.0

Seluruh pilihan di atas menjelaskan cara menginstal MLflow pada working environment yang akan Anda gunakan. Tentu saja Anda tidak perlu menggunakan ketiga tahapan tersebut, silakan sesuaikan dengan kebutuhan dan kenyamanan, ya.

Sampai di sini, Anda sebenarnya sudah dapat menggunakan ML. Jadi tanpa berlama-lama lagi, mari kita bahas saksama seluruh fitur yang nantinya akan Anda gunakan untuk membuat submission di kelas ini.

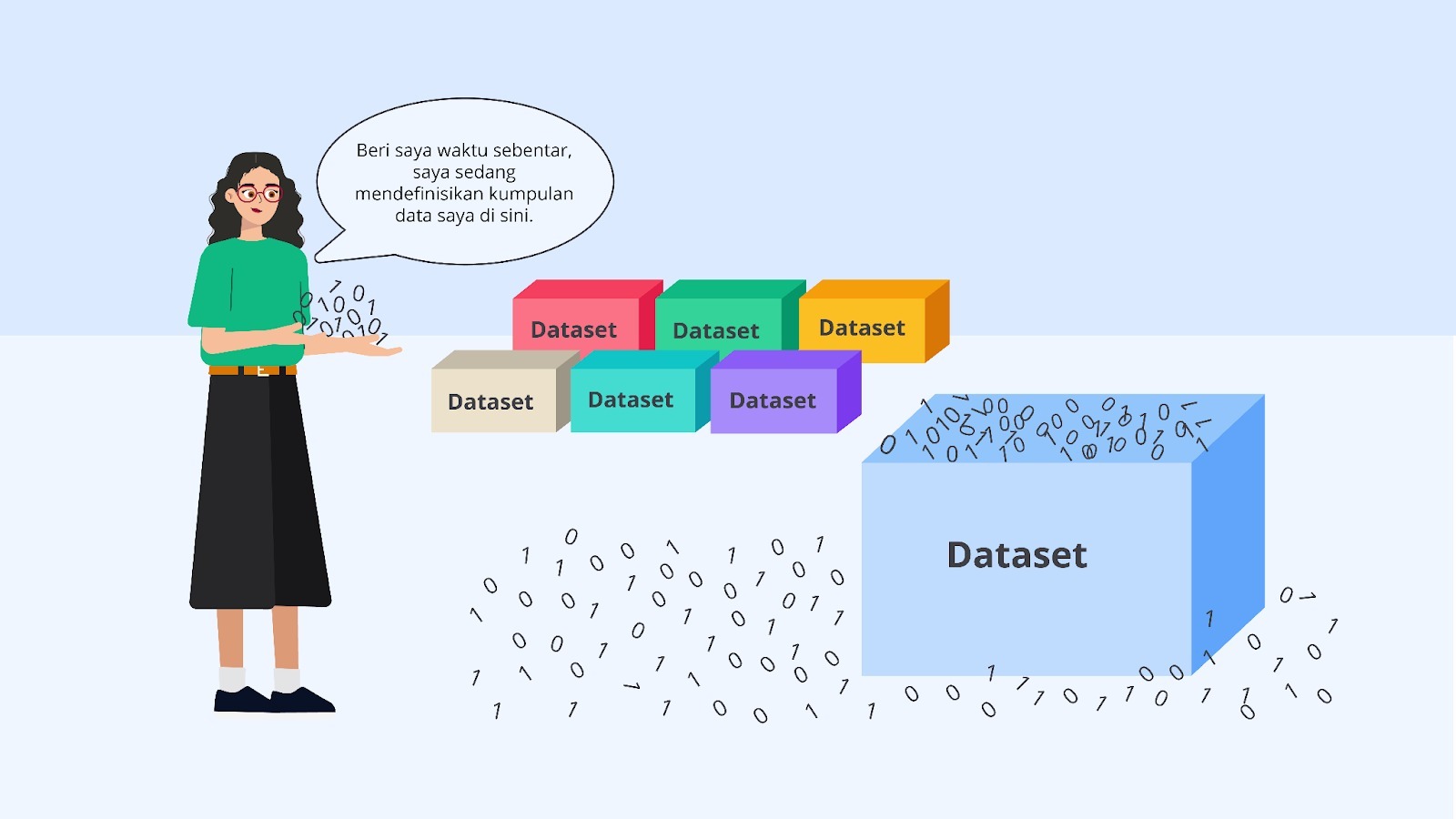

MLflow Tracking

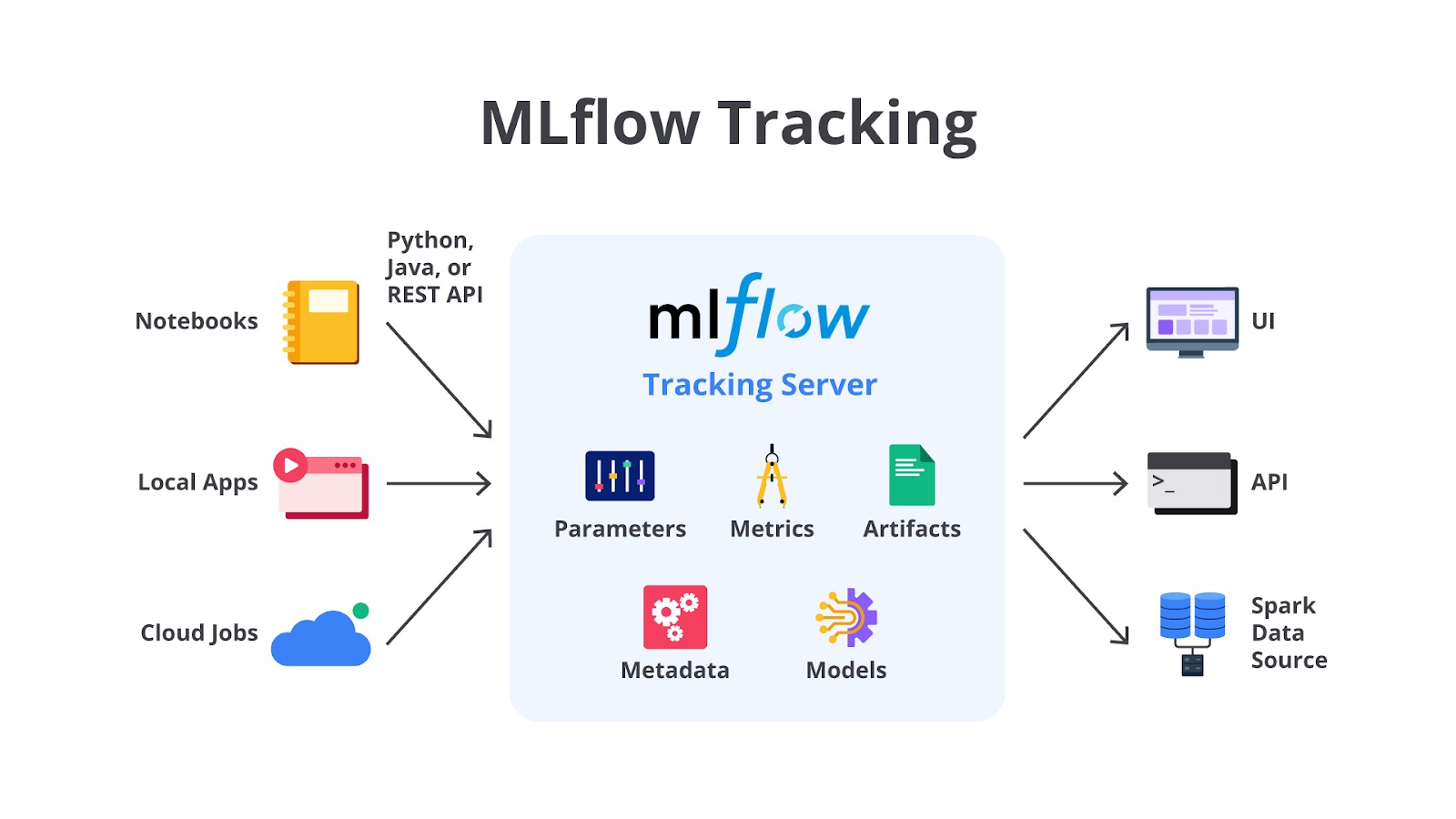

MLflow Tracking adalah komponen yang memungkinkan pengguna untuk mencatat dan melacak eksperimen machine learning. Dengan fitur ini, semua informasi penting seperti parameter, metrik, kode sumber, dan artefak (seperti file model) dapat didokumentasikan secara otomatis.

Jika tebersit sebuah pertanyaan di benak Anda, “mengapa proses pencatatan ini menjadi sangat penting ketika kita membangun sebuah model?” berarti Anda menikmati perjalanan ini. Mari kita flashback sejenak pada kelas sebelumnya ketika proses pencatatan metriks harus dilakukan secara manual sehingga kerap dilupakan atau bahkan tidak diingat sama sekali.

Sekilas perilaku di atas terlihat tidak ada salahnya ‘kan? Hal itu karena tujuan dalam membangun model machine learning tetaplah terpenuhi. Namun, ini akan menjadi bom waktu (tech debt) karena akan memberikan dampak di kemudian hari seperti ketika ingin mereplikasi model, melihat hyperparameter hingga performa ketika model dilatih.

Nah, di sinilah peran krusial MLflow dibutuhkan. MLflow dapat mempermudah pengelolaan eksperimen dengan mencatat informasi seperti parameter, metrik, dan artefak model secara otomatis. Dengan MLflow Tracking, pengguna dapat membandingkan hasil eksperimen, memastikan reproduktibilitas, dan mendokumentasikan eksperimen dalam satu tempat terpusat.

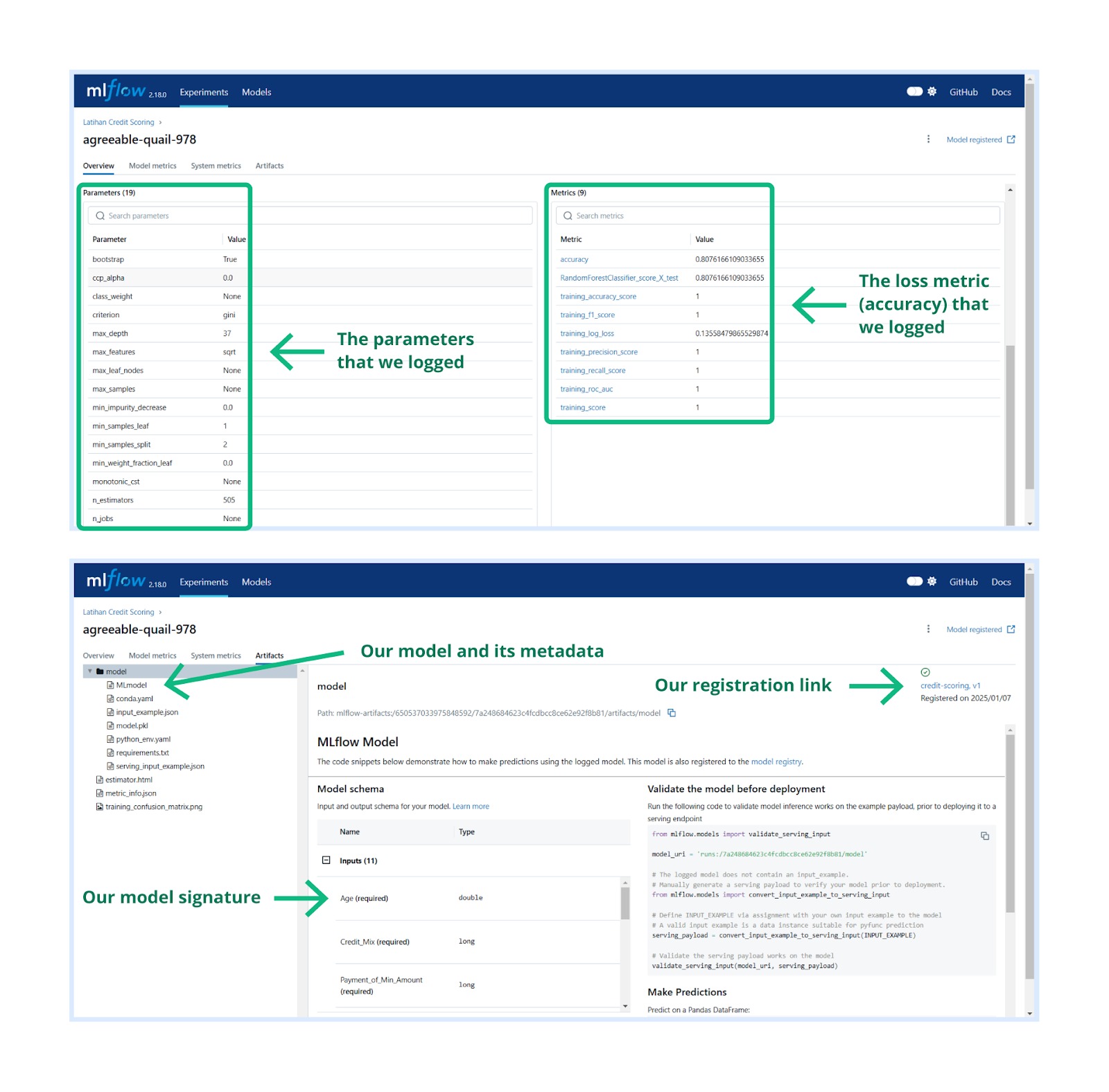

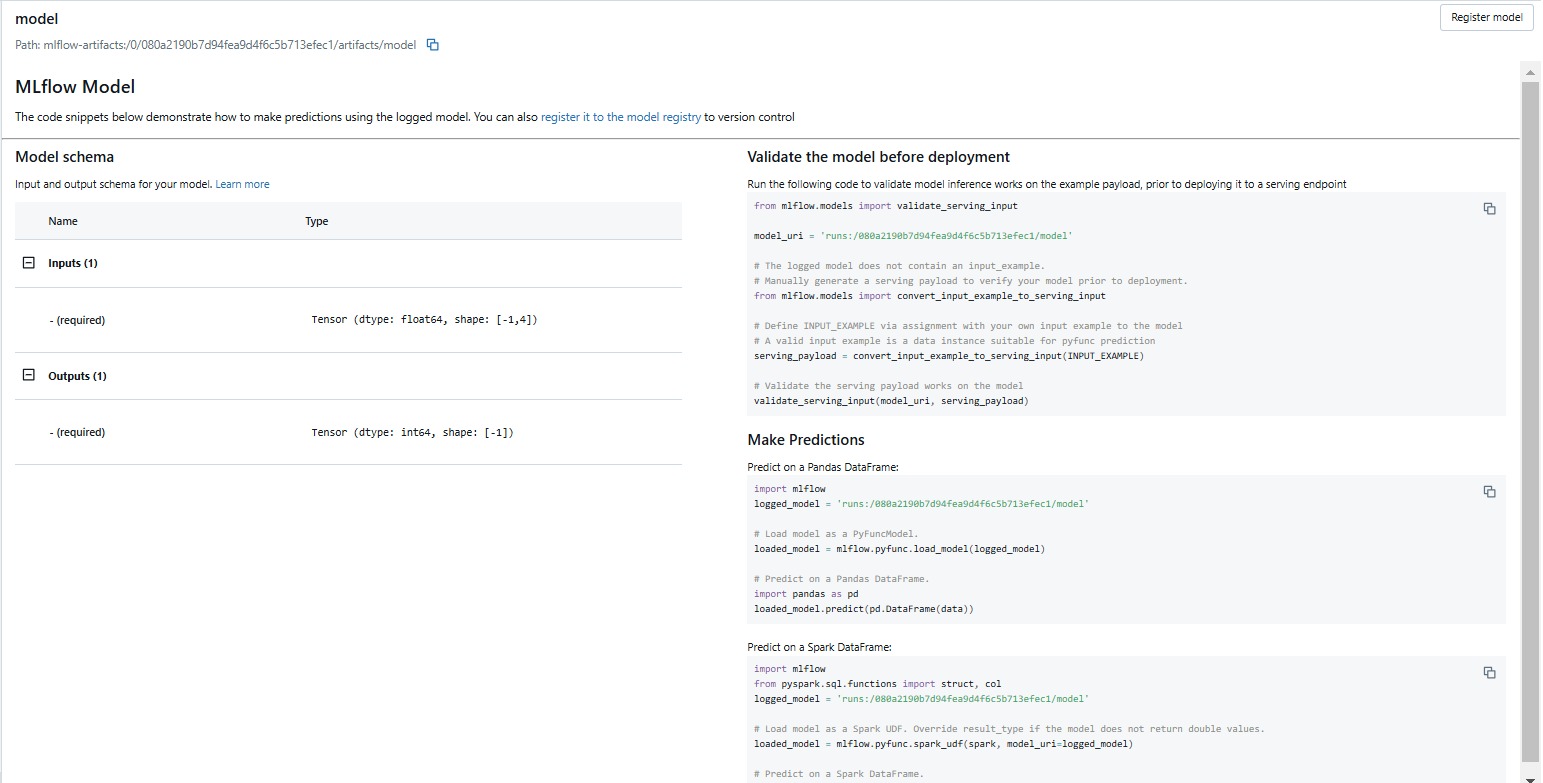

Berdasarkan gambar di atas, terdapat beberapa hal yang dapat kita tracking dengan menggunakan MLflow mencakup parameters, metrics, artifacts, metadata dan models. Pada masing-masing komponen setidaknya Anda dapat mencatat hal-hal seperti berikut.

-

Pencatatan Parameter

Parameter adalah konfigurasi model atau hyperparameter yang digunakan selama pelatihan, seperti learning_rate, batch_size, atau number_of_layers.MLflow mencatat semua parameter eksperimen sehingga pengguna dapat menganalisis pengaruhnya terhadap performa model.

-

Pencatatan Metrik

Metrik adalah hasil evaluasi model, seperti accuracy, precision, recall, atau loss.MLflow dapat mencatat metrik secara otomatis dan terstruktur untuk mempermudah perbandingan antar eksperimen.

-

Pencatatan Artefak, Metadata dan Models

Artefak adalah output yang dihasilkan selama eksperimen, seperti file model yang telah dilatih (model.pkl), file visualisasi, atau dataset yang diproses.MLflow dapat menyimpan semua artefak sehingga pengguna dapat mengaksesnya kembali di masa depan ketika dibutuhkan.

- Pencatatan Kode dan Versi

MLflow dapat mencatat informasi tentang kode yang digunakan dalam eksperimen, termasuk versi Git atau jalur file. Hal ini memastikan bahwa eksperimen dapat direproduksi dengan menggunakan versi kode yang sama. - Pelacakan Multi-Platform

MLflow Tracking dapat digunakan secara lokal, di server terpusat, atau di cloud, serta memungkinkan pelacakan eksperimen yang terdistribusi di berbagai lingkungan.

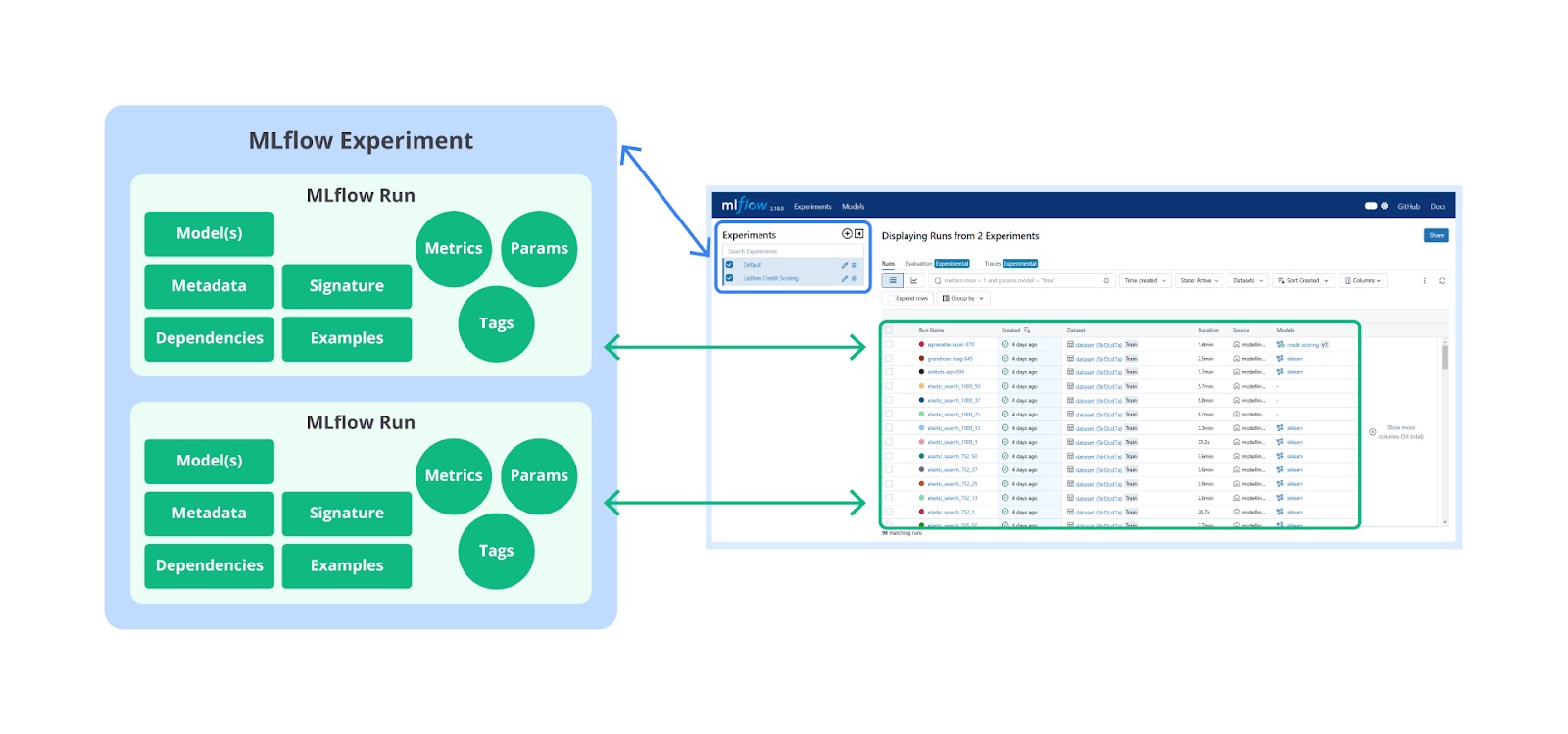

Bagaimana keren ‘kan? Dari sini kita sudah tahu bahwa MLflow merupakan kepingan puzzle yang sangat penting untuk membangun sistem machine learning, tentunya kepingan ini memiliki beberapa komponen penting yang perlu Anda ingat agar dapat menjalankan tracking dengan lengkap. Berikut merupakan komponen penting dalam MLflow Tracking.

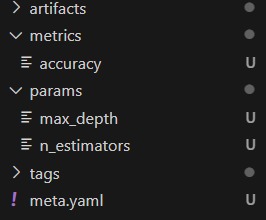

- Run

Seperti yang kita tahu bahwa MLflow Tracking dapat membantu Anda mencatat dan mengelola informasi penting dari setiap eksekusi kode machine learning Anda. Informasi ini disimpan dalam bentuk metadata dan artifacts yang terkait dengan setiap “run”. Dengan demikian, Anda dapat dengan mudah melacak, membandingkan, dan mereproduksi eksperimen machine learning Anda. Setiap “run” akan mencatat dua hal penting seperti berikut.- Metadata yang berisikan berbagai informasi yang berkaitan dengan “run” yang mencakup beberapa hal berikut.

- Metrik: performa model, misalnya akurasi, presisi, recall, F1-score.

- Parameter: nilai-nilai yang digunakan untuk mengonfigurasi model atau proses pelatihan, misalnya learning rate, jumlah epoch, jenis algoritma.

- Waktu mulai dan selesai (runtime) menjalankan fungsi “run”.

- Informasi lain yang dianggap penting.

- Metadata yang berisikan berbagai informasi yang berkaitan dengan “run” yang mencakup beberapa hal berikut.

- Artifacts yang mencakup file-file output yang dihasilkan dari “run” tersebut, seperti bobot model, gambar, dan file yang relevan.

- Bobot model: file yang berisi parameter model yang telah dilatih.

- Gambar: visualisasi data, grafik performa model, atau gambar lainnya.

- File-file output lainnya yang relevan.

-

Experiment

Kumpulan run yang terkait dikelompokkan ke dalam Experiment. Contohnya jika Anda mencoba berbagai hyperparameter untuk model tertentu, semua run dapat dikelompokkan dalam satu experiment. -

Tracking Server

Tracking Server adalah server pusat yang menyimpan semua data eksperimen. MLflow dapat diatur untuk menyimpan data ini di berbagai backend, seperti environment lokal, database (seperti MySQL, PostgreSQL) dan Cloud storage. - UI MLflow Tracking

MLflow menyediakan antarmuka web untuk melihat dan membandingkan semua run yang tercatat dalam experiment. Antarmuka ini memungkinkan pengguna untuk memfilter, mengurutkan, dan menganalisis data eksperimen.

Dengan memahami komponen di atas, Anda akan lebih mudah untuk mempelajari penggunaan MLflow tracking pada materi berikutnya. Disclaimer, pada tahap ini, kita tidak akan menjelaskan kodenya secara detail, tetapi hanya memperlihatkan contoh penggunaannya agar terbayang ketika akan berpindah ke latihan di materi berikutnya. Materi ini mendorong Anda untuk mencoba latihan yang sama, tetapi hal tersebut tidaklah wajib.

Menjalankan Tracking Runs

Nah, untuk mencatat dan mengelola eksperimen, MLflow Tracking menyediakan serangkaian fungsi yang disebut API (Application Programming Interface). Buat kalian yang belum familier dengan API mari kita ambil analogi sederhana. API ini ibarat sekumpulan tombol dan perintah yang bisa kita gunakan untuk berinteraksi dengan MLflow Tracking.

Sebagai contoh, kita bisa memanggil fungsi mlflow.start_run() untuk memulai sebuah “run” baru. Ingat, “run” itu seperti satu kali percobaan atau eksekusi kode machine learning kita. Setelah memulai “run”, kita bisa menggunakan fungsi-fungsi pencatatan lainnya seperti berikut.

- mlflow.log_param(): fungsi ini digunakan untuk mencatat parameter yang kita gunakan dalam “run” tersebut.

- mlflow.log_metric(): fungsi ini digunakan untuk mencatat metrik yang dihasilkan dari “run” tersebut.

Selain contoh di atas, masih banyak fungsi-fungsi lain yang disediakan oleh API MLflow Tracking ini. Untuk penjelasan yang lebih detail dan lengkap mengenai cara penggunaan API ini, Anda bisa merujuk ke dokumentasi resmi Tracking API. Di sana, Anda akan menemukan panduan lengkap beserta contoh-contoh kode yang akan membantu untuk memahami cara kerja setiap fungsi.

Jangan ragu untuk membuka dokumentasi tersebut dan mempelajari lebih lanjut. Semakin Anda memahami API ini, semakin mudah bagi Anda untuk melacak dan mengelola eksperimen machine learning.

Pada materi ini, kita akan menuliskan beberapa contoh penggunaan API MLflow beserta fungsinya. Sekali lagi, pada tahap ini, kita tidak akan membahas terlalu dalam mengenai kodenya, ya. Mari kita mulai dengan pencatatan yang sederhana.

-

import mlflow

- with mlflow.start_run():

- mlflow.log_param(“n_estimators”, 100)

- mlflow.log_param(“max_depth”, 5)

- # Baris ini berisikan kode untuk membangun model ML.

- …

- mlflow.log_metric(“accuracy”, accuracy)

- mlflow.sklearn.log_model(model, “random_forest_model”)

Kode di atas menunjukkan kerangka dasar dalam menggunakan MLflow Tracking. Anda memulai “run”, mencatat parameter, menjalankan kode machine learning, dan mencatat metrik yang dihasilkan. Pada kasus ini, kita akan mencatat n_estimator dan max_depth dengan menyimpan accuracy sebagai log_metric beserta karakteristik modelnya.

Dengan cara ini, MLflow membantu Anda melacak dan mengelola eksperimen machine learning dengan rapi dan terstruktur. Anda dapat melihat kembali semua “run” yang telah dilakukan, membandingkan parameter dan metriknya, dan dengan mudah mereproduksi hasil eksperimen.

Pro Tips

Anda dapat melihat semua metrics yang dicatat pada folder yang sama dengan working repository ketika Anda tidak mengatur **mlflow.set_tracking_uri(uri=”http://

Dengan menggunakan kode sebelumnya, Anda dapat menyimpan beberapa metrics yang ingin diabadikan. Namun, bagaimana jika pimpinan atau tim Anda ingin menyimpan seluruh metrics untuk tujuan tertentu? Tentu akan menjadi masalah karena kita harus menuliskan seluruh metrics pada masing-masing algoritma yang digunakan.

Chill, ada cara yang lebih cepat dan praktis untuk menangani permasalahan tersebut yaitu dengan menggunakan fitur Auto-logging.

Fitur powerful ini memungkinkan Anda untuk mencatat metrik, parameter, dan bahkan model tanpa perlu menulis kode pencatatan secara eksplisit. Bayangkan, Anda tidak perlu lagi repot-repot memanggil fungsi log_ satu per satu. Cukup dengan memanggil satu fungsi sakti mlflow.autolog() dan MLflow akan secara otomatis mencatat berbagai informasi.

Lalu, bagaimana cara menggunakannya?

Anda hanya perlu memanggil mlflow.autolog() sebelum kode pelatihan model. Sesederhana itu, lho.

-

import mlflow

- mlflow.autolog()

- # Baris ini berisikan kode untuk membangun model ML.

- …

Hebatnya lagi, auto-logging ini mendukung berbagai library machine learning populer, seperti Scikit-learn, XGBoost, PyTorch, Keras, Spark dan masih banyak lagi.

Untuk informasi lebih lanjut mengenai library yang didukung dan cara penggunaan API auto-logging untuk masing-masing library, Anda dapat merujuk ke Dokumentasi Automatic Logging. Di sana, Anda akan menemukan panduan lengkap dan contoh-contoh kode yang akan membantu untuk menguasai fitur auto-logging ini.

Intinya, dengan auto-logging Anda dapat menghemat waktu dan tenaga, serta fokus pada eksperimen machine learning Anda.

Menariknya, MLflow juga menyediakan satu fungsi yang sangat bermanfaat ketika Anda tidak menggunakan auto-logging yaitu MLflow Tracking Datasets.

Tracking datasets adalah salah satu aspek penting dalam proses pengembangan machine learning, karena perubahan pada dataset dapat berdampak besar pada hasil eksperimen dan performa model. Dengan MLflow, selain mencatat parameter, metrik, dan artefak, Anda juga dapat mencatat informasi terkait dataset yang digunakan selama eksperimen, seperti versi dataset, lokasi penyimpanan, atau hash unik dataset. Ini memastikan bahwa eksperimen dapat direproduksi dengan dataset yang sama. Wow, keren banget kan?

Mungkin, beberapa orang akan memiliki pertanyaan, “mengapa Tracking datasets penting?” Mari kita bahas alasan utamanya.

- Reproduktibilitas Eksperimen

Dataset adalah bagian inti dari machine learning. Jika dataset tidak dilacak, sulit untuk menjalankan ulang eksperimen dengan hasil yang konsisten (menggunakan dataset yang sama). - Kolaborasi

Saat bekerja dalam tim, mencatat versi dataset membantu anggota tim lain menggunakan dataset yang sama untuk eksperimen mereka. Hal ini akan meminimalisasi perbedaan output dari orang yang berbeda - Manajemen Versi Dataset

Dataset sering diperbarui, seperti penambahan data baru atau pembersihan data. Tracking membantu mengelola perubahan ini dengan baik karena Anda akan memiliki visibilitas yang baik.

Saat ini MLflow sudah memiliki fitur bawaan untuk melacak dataset secara langsung, tetapi Anda juga dapat mencatat informasi terkait dataset sebagai bagian dari parameter, artefak, atau dengan menghitung hash unik dataset. Tenang saja, walaupun banyak cara, tetapi penggunaan Tracking Dataset masih tergolong mudah kok. Mari kita bahas beberapa pendekatan yang dapat Anda lakukan.

-

Menggunakan fitur mlflow.log_input()

mlflow.log_input()adalah fungsi yang memungkinkan pengguna untuk mencatat informasi tentang input ke dalam eksperimen ML. Input ini dapat berupa dataset, file konfigurasi, atau data lain yang digunakan untuk melatih model.- import numpy as np

-

import mlflow

- array = np.asarray([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

-

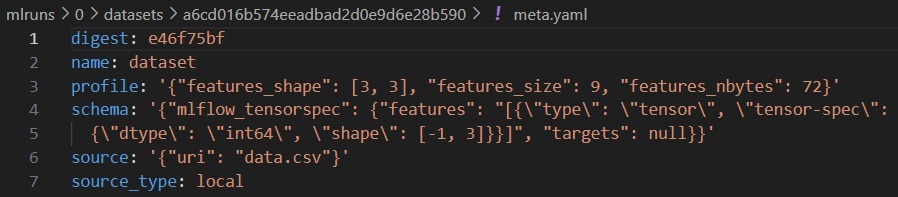

dataset = mlflow.data.from_numpy(array, source=“data.csv”)

- with mlflow.start_run():

- mlflow.log_input(dataset, context=“training”)

-

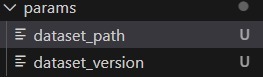

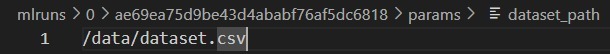

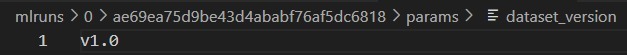

Tracking Informasi Dataset Sebagai Log Parameter

Jika dataset disimpan di lokasi tertentu atau memiliki nama versi, Anda dapat mencatat informasi tersebut menggunakan mlflow.log_param().-

import mlflow

- # Log dataset information

- dataset_version = “v1.0”

-

dataset_path = “/data/dataset.csv”

- mlflow.log_param(“dataset_version”, dataset_version)

- mlflow.log_param(“dataset_path”, dataset_path)

-

-

Tracking Dataset Sebagai Artefak

Anda dapat mengunggah dataset ke MLflow sebagai artefak menggunakan mlflow.log_artifact(). Ini memastikan dataset yang digunakan selama eksperimen tersimpan sepenuhnya dengan eksperimen tersebut.- import numpy as np

-

import mlflow

-

dataset_path = “Telco-Customer-Churn.csv”

- with mlflow.start_run():

- mlflow.log_artifact(dataset_path, artifact_path=“datasets”)

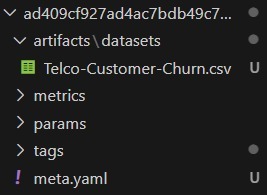

Sehingga, Anda dapat melihat kembali dataset yang digunakan pada file log seutuhnya seperti berikut.

Dataset akan tersimpan secara langsung di MLflow sehingga mudah diakses dan digunakan ulang. Namun, hal ini tidak efisien jika Anda menggunakan dataset yang besar dan tidak memiliki penyimpanan yang cukup.

-

Tracking Dataset dengan Hash Unik

Jika dataset terlalu besar untuk diunggah sebagai artefak dan perusahaan memiliki concern terhadap data privacy, Anda dapat membuat hash unik dari dataset (misalnya, dengan algoritma hashing seperti SHA-256) dan mencatat hash tersebut sebagai parameter.- import hashlib

-

import mlflow

- # Generate hash of dataset

- def generate_dataset_hash(file_path):

- sha256_hash = hashlib.sha256()

- with open(file_path, “rb”) as f:

- for byte_block in iter(lambda: f.read(4096), b””):

- sha256_hash.update(byte_block)

-

return sha256_hash.hexdigest()

- dataset_path = “Telco-Customer-Churn.csv”

-

dataset_hash = generate_dataset_hash(dataset_path)

- with mlflow.start_run():

- mlflow.log_param(“dataset_hash”, dataset_hash)

Dengan begitu, orang lain di luar perusahaan Anda tidak akan mengetahui informasi mengenai dataset yang digunakan.

-

Mengintegrasikan Dataset Version Control (DVC)

Jika Anda menggunakan Data Version Control (DVC) untuk melacak perubahan dataset, Anda dapat mengintegrasikan MLflow dan DVC. Dalam hal ini, versi dataset yang tercatat di DVC dapat dilacak di MLflow sebagai parameter. Untuk pengetahuan tambahan, silakan buka dokumentasi DVC secara mandiri karena pada kelas ini, kita tidak akan menggunakan bantuan DVC untuk membangun model machine learning.

Hufftt, tarik nafas sejenak, jangan lupa beristirahat, ya. Hingga saat ini, kita telah mengeksplorasi MLflow Tracking yang dapat membantu dalam mencatat berbagai aspek penting dalam eksperimen machine learning, mulai dari parameter, metrik, model, hingga dataset. Kita telah menggunakan API untuk mencatat informasi tersebut secara terstruktur.

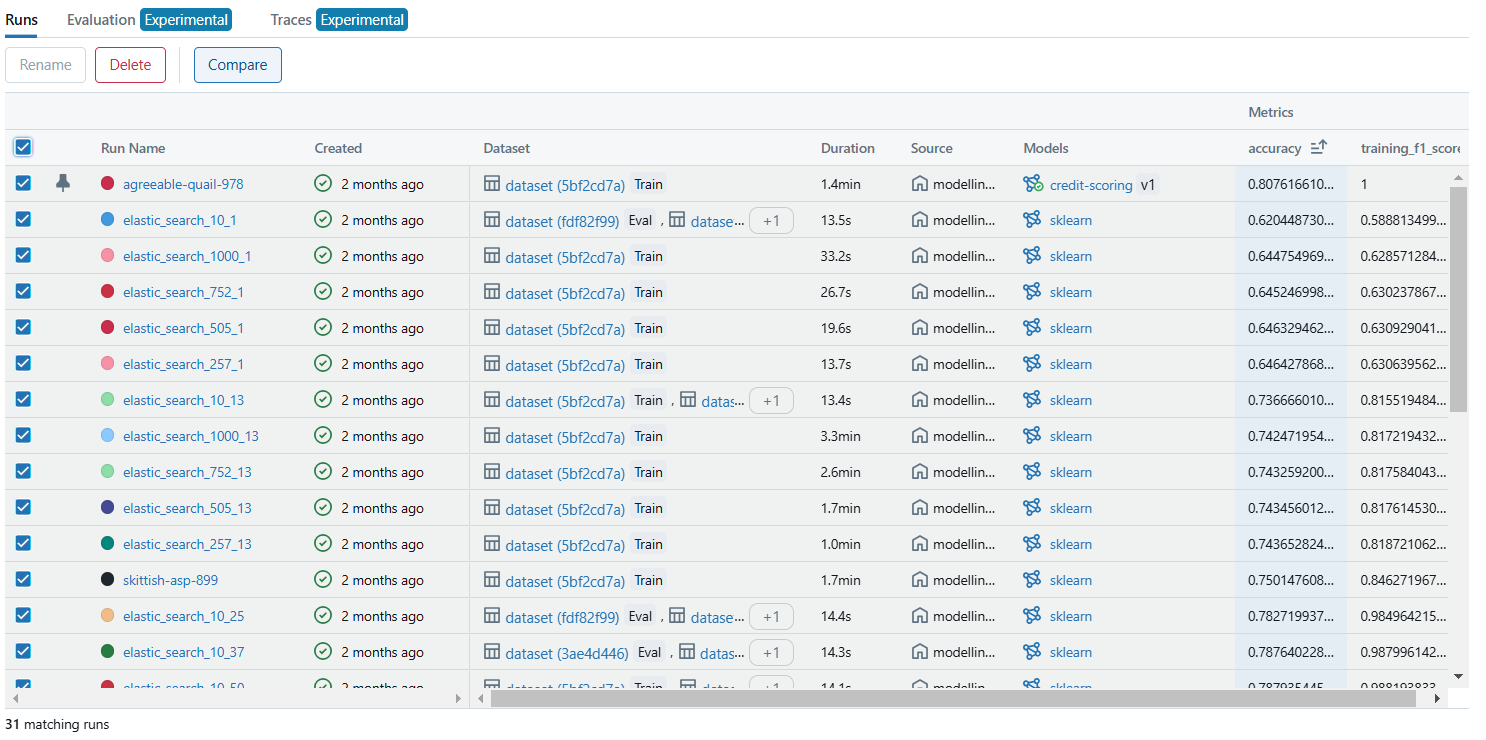

Namun, bagaimana cara kita melihat dan menganalisis semua informasi yang telah terkumpul itu? Bukankah saat ini Anda hanya dapat mengaksesnya melalui IDE yang digunakan? Tentu itu sangat melelahkan terutama jika kita memiliki banyak eksperimen.

Di sinilah MLflow Tracking UI mengambil alih kendali report dari IDE favorit menjadi sebuah visualisasi. Tracking UI menyediakan antarmuka grafis yang user-friendly sehingga memungkinkan kita untuk memvisualisasikan, membandingkan, dan mengelola run eksperimen dengan mudah secara interaktif.

Tracking UI memberikan visual untuk memeriksa eksperimen yang jauh lebih efisien dibandingkan mencatat dan menganalisis data eksperimen secara manual melalui IDE atau repositori langsung.

Pada intinya, MLflow memiliki kemampuan yang sangat cocok untuk menunjang pembangunan sistem machine learning. Mari kita tengok beberapa fitur yang sangat berguna pada proses pengembangan model.

- Membandingkan Eksperimen

Misalnya, Anda menjalankan eksperimen dengan parameter yang berbeda seperti learning_rate dan batch_size. Dalam Tracking UI, Anda dapat memfilter eksperimen berdasarkan parameter tertentu (misalnya, learning_rate=0.01) dan melihat grafik perbandingan akurasi antar run dengan parameter yang berbeda.

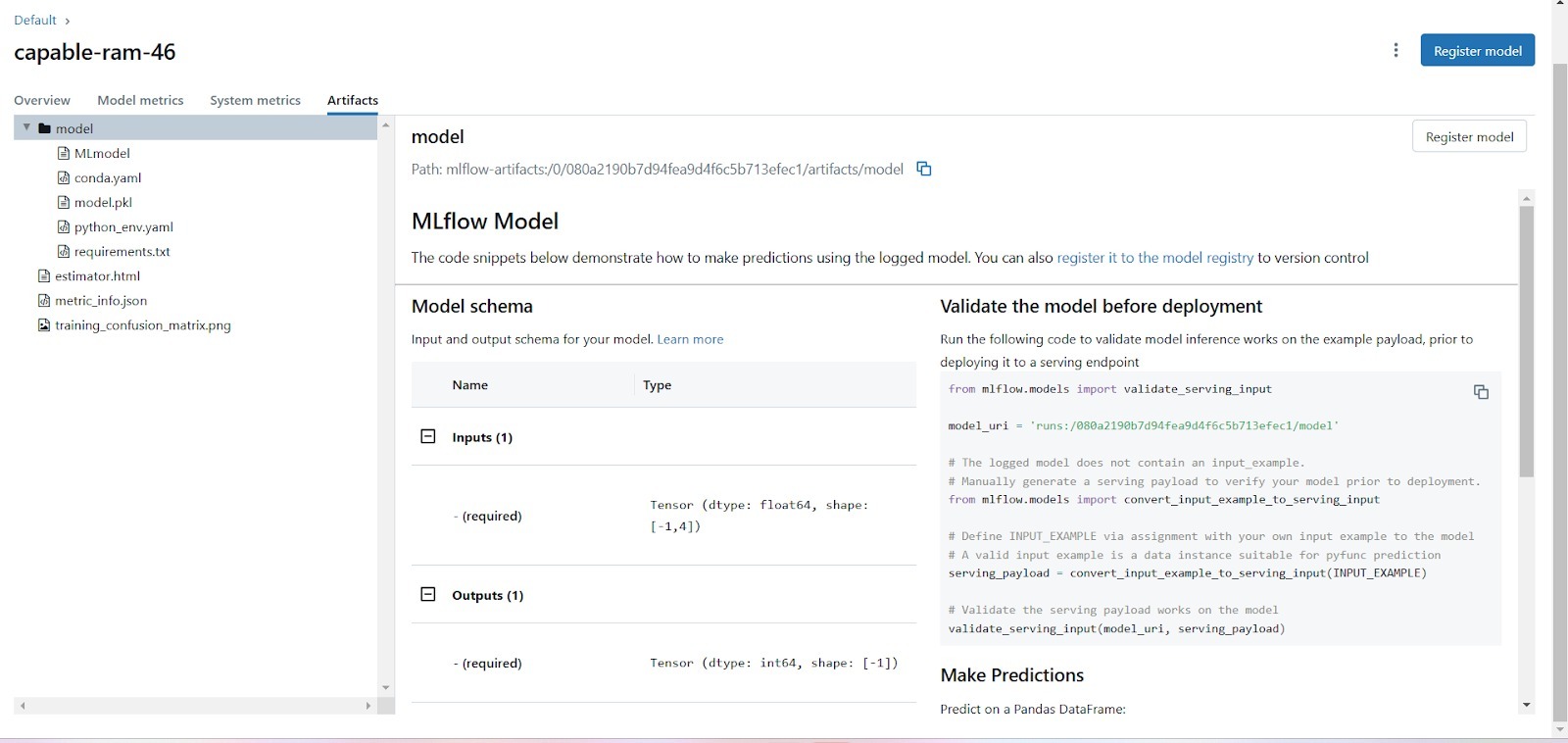

-

**Mengunduh Artefak Model

**Setelah melatih beberapa model, Anda tentu ingin menggunakan model dengan akurasi tertinggi. Dalam Tracking UI, Anda dapat mengunduh seluruh artefak dengan sangat mudah, dimulai dari membuka run dengan akurasi tertinggi, lalu klik link artefak untuk mengunduh model yang telah dilatih.

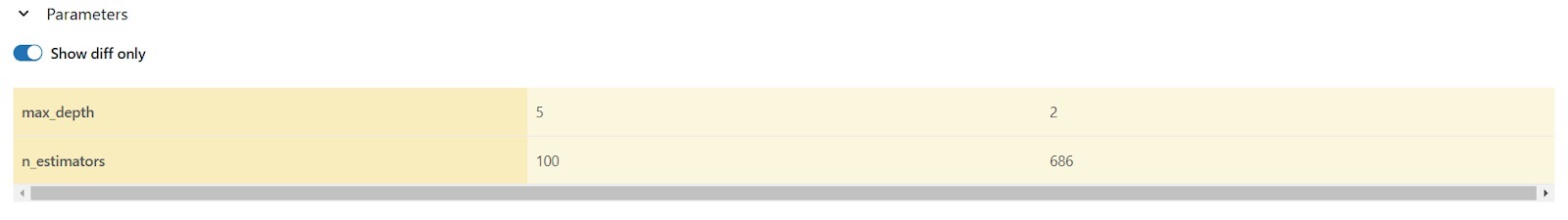

- **Melihat Perbedaan Versi Kode

**Jika Anda mencatat versi kode selama eksperimen, Tracking UI memungkinkan Anda melihat perbedaan hasil antar versi kode untuk setiap run yang berbeda. Selain itu, Tracking UI juga dapat membandingkan hyperparameter yang digunakan ketika model dilatih.

Dengan fitur-fitur MLflow Tracking di atas, kita dapat mengelola dan melacak setiap detail eksperimen machine learning kita, dari kode hingga data. Namun, bagaimana kita dapat mengakses semua informasi tersebut dengan cepat dan melakukan analisis mendalam? Tenang, interface berbasis web ini menyediakan akses yang mudah dan terorganisasi ke semua run dan eksperimen yang telah kita catat. Jika Anda ingin mencatat setiap proses ke direktori mlruns secara lokal, jalankan perintah berikut pada direktori yang ingin Anda catat.

- # Opsi pertama

-

mlflow ui --port 5000

- # Opsi kedua

- mlflow server --host 127.0.0.1 --port 8080

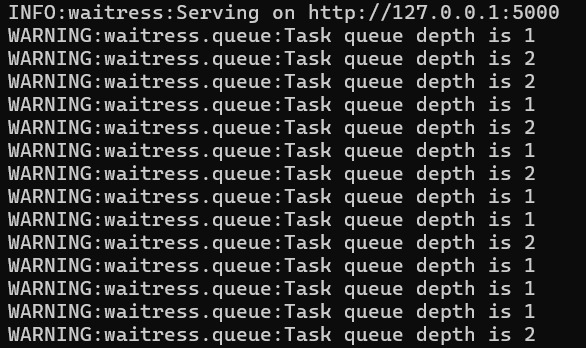

Kode di atas sebenarnya memiliki tujuan yang sama yaitu menjalankan MLflow Tracking Server, tetapi bedanya pada pilihan pertama Anda secara default akan menjalankan server secara lokal. Di sisi lain, pilihan kedua memberikan keleluasaan untuk mengatur alamat IP baik itu pada server lokal ataupun alamat remote dari sebuah VM atau server yang Anda miliki.

Ketika Anda menjalankan salah satu pilihan di atas, terminal aktif yang digunakan akan menunjukkan output seperti berikut.

Artinya, MLflow Tracking UI sudah dapat dijalankan. Lalu, bagaimana cara menghentikannya? Mudah saja, Anda bisa masuk kembali ke terminal yang menjalankan Tracking UI dan memberikan perintah “CTRL + C” untuk mengakhiri sesinya. Namun, jika ingin mengakses UI tersebut melalui peramban (browser) favorit Anda dengan memasukkan alamat berikut ke uri peramban.

- # Opsi 1

- http://localhost:

# by default port = 5000 - # Opsi 2

- http://127.0.0.1:

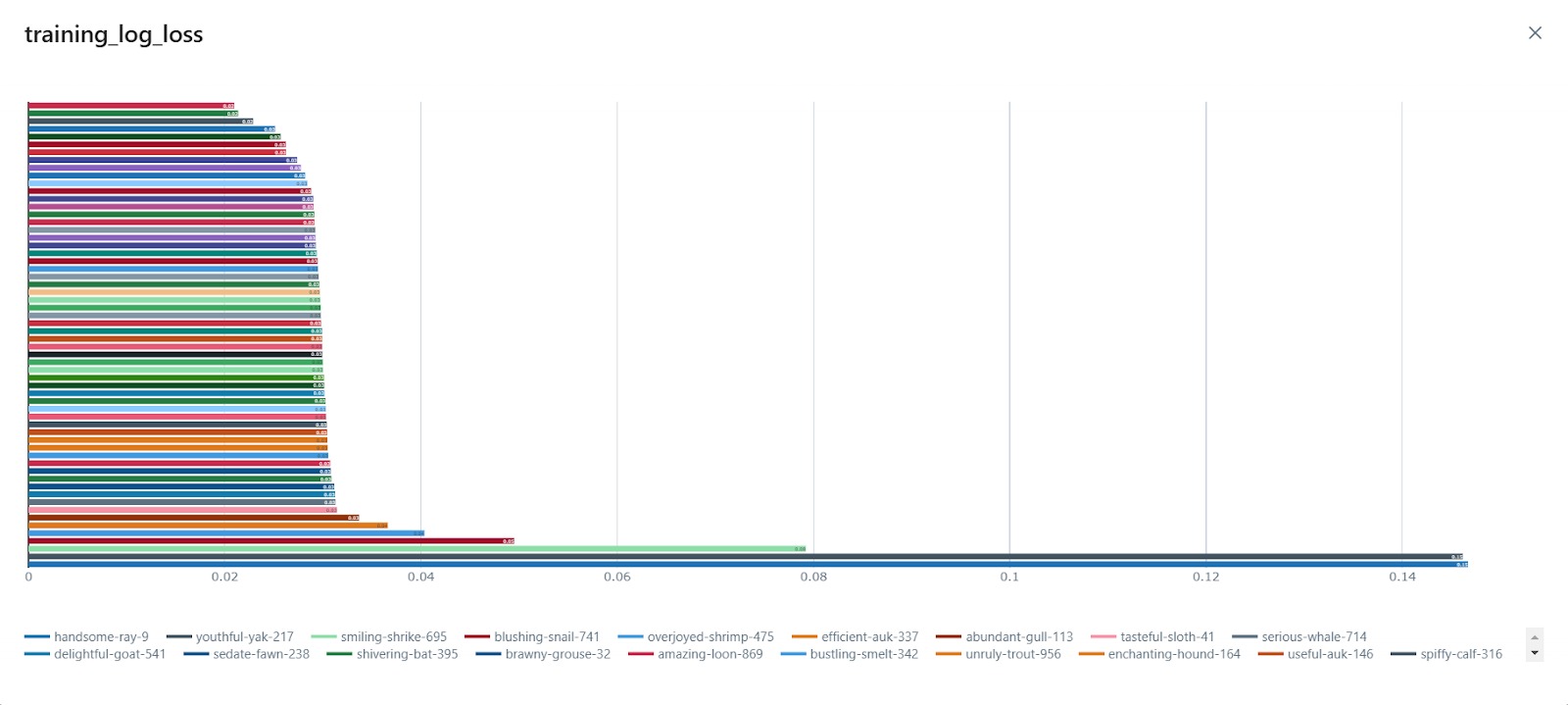

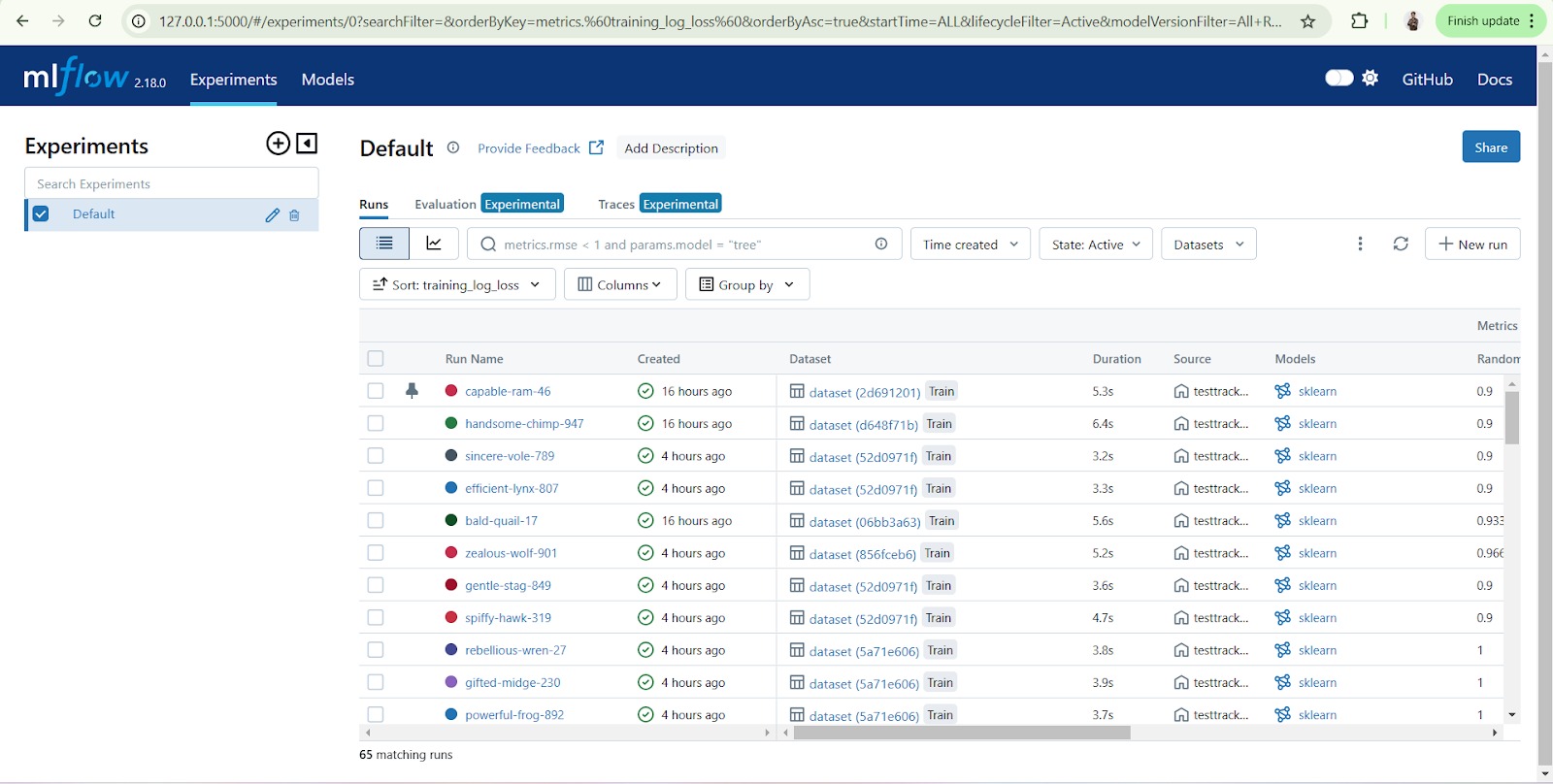

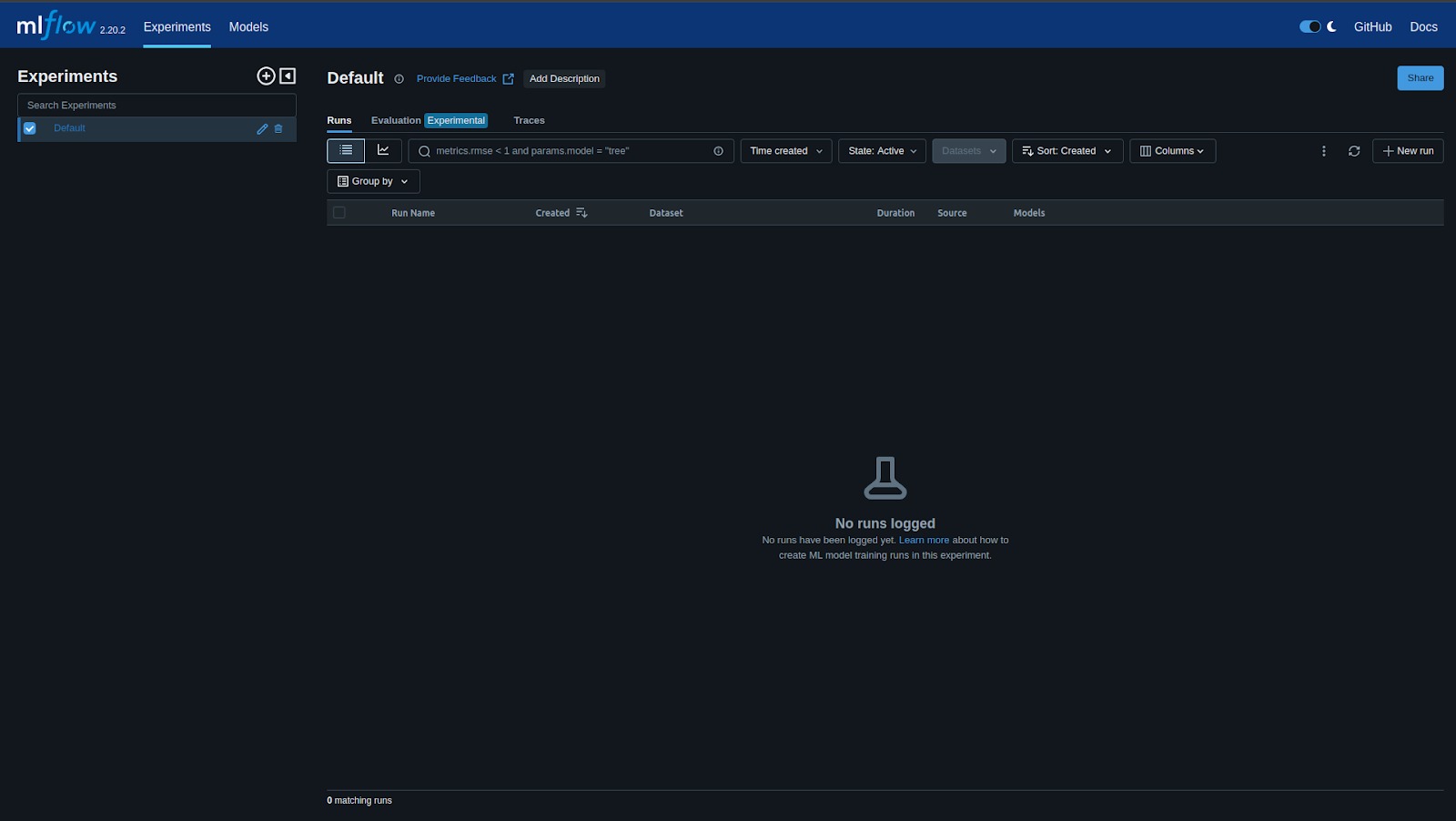

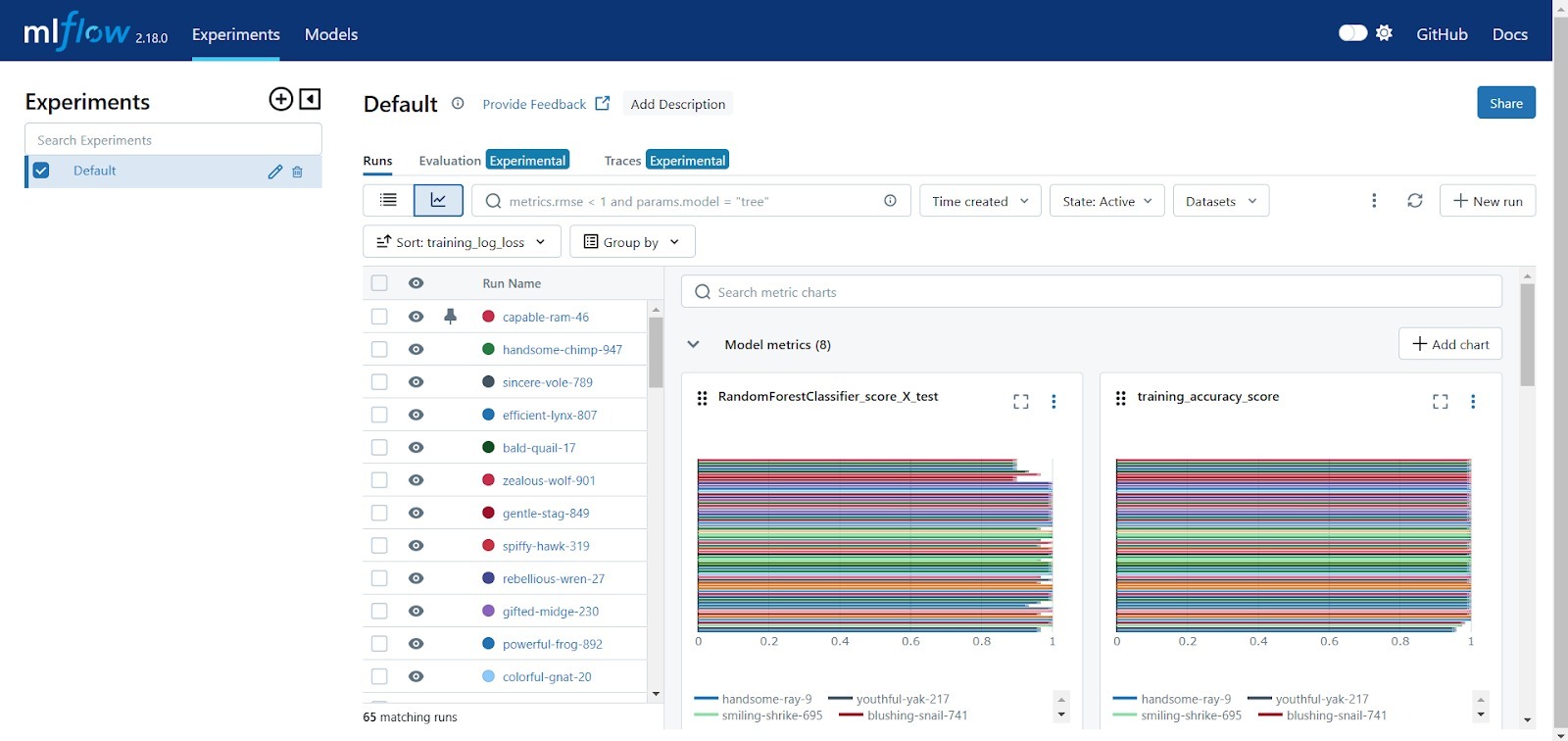

Sehingga, perintah tersebut akan menampilkan halaman seperti berikut.

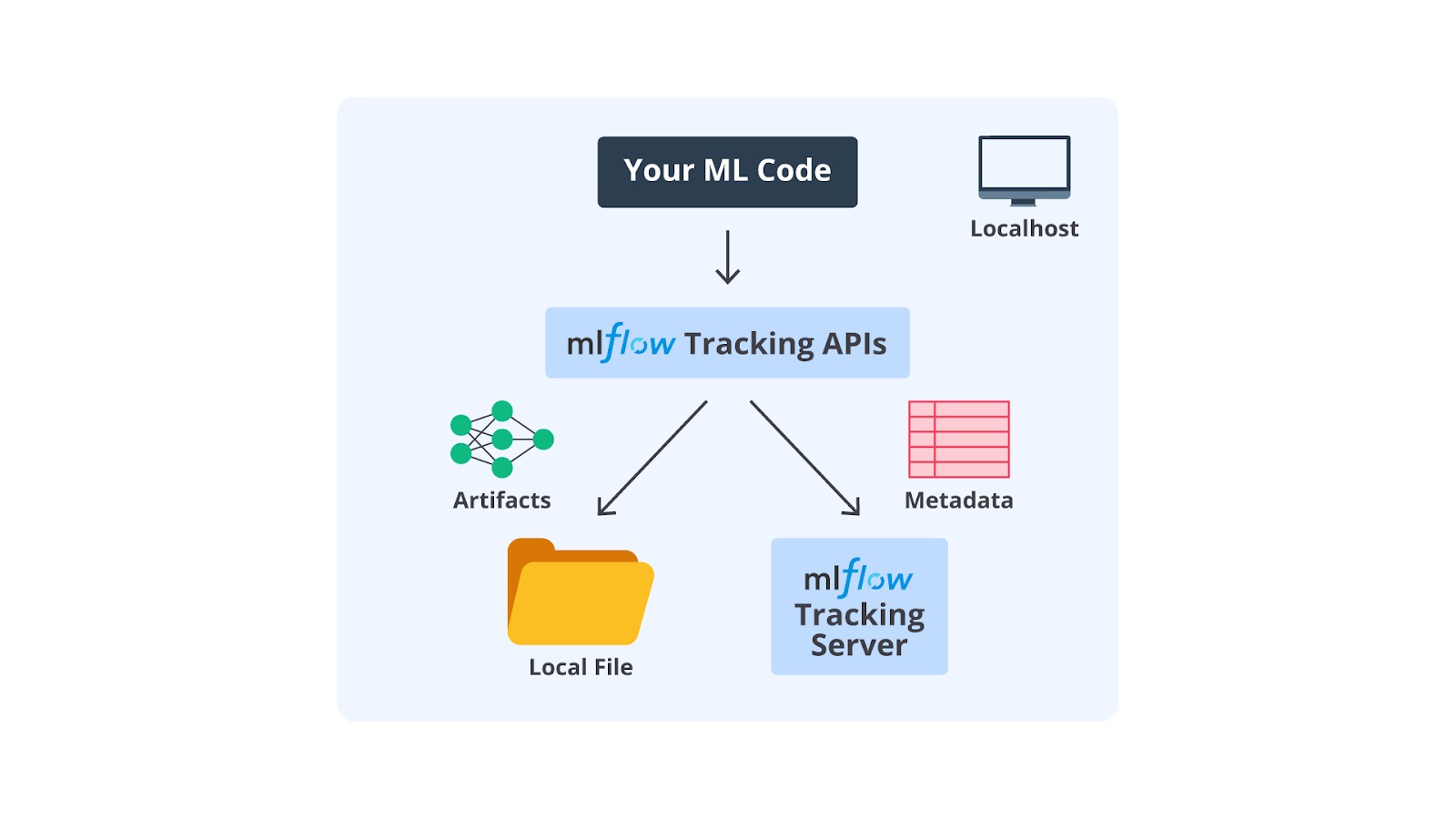

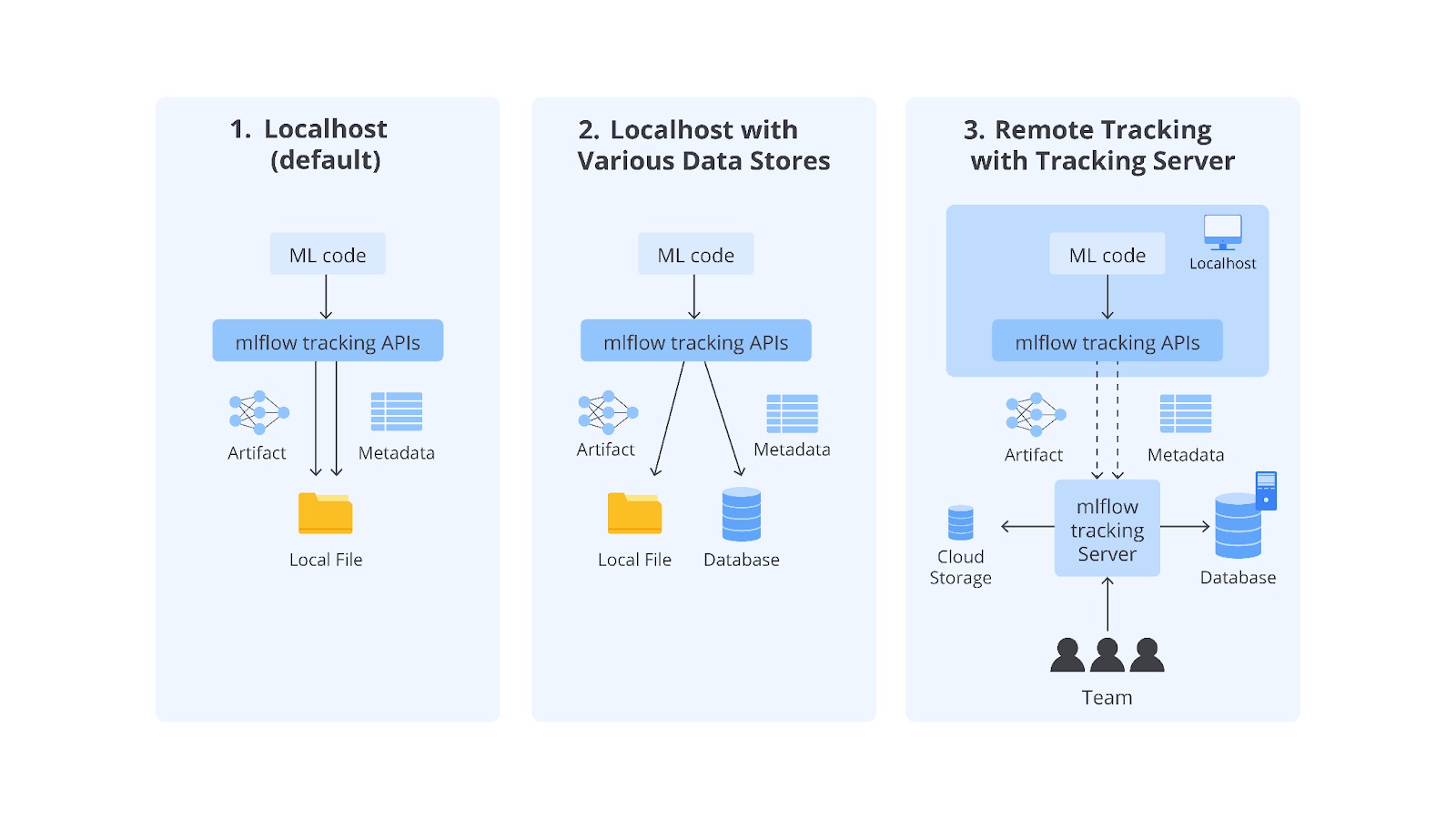

Contoh di atas merupakan salah satu common set-up untuk menerapkan MLflow Tracking UI pada lingkungan lokal (localhost). Namun, kemampuan MLflow tidak terbatas pada lingkungan lokal saja. Anda juga dapat mengombinasikan Tracking UI dengan databases atau bahkan dengan sebuah cloud storage yang dapat disesuaikan dengan alur kerja atau kebutuhan proyek. Sebagai gambaran, perhatikan common setups berikut untuk menerapkan MLflow Tracking UI pada berbagai situasi.

Berdasarkan gambar di atas, MLflow Tracking UI menyediakan tiga pilihan utama, masing-masing dirancang untuk memenuhi kebutuhan yang berbeda. Pengaturan localhost (default) sangat cocok untuk proyek individu atau eksperimen awal, sementara Local Tracking with Local Database memberikan keamanan tambahan untuk menyimpan data di database lokal. Di sisi lain, Remote Tracking with MLflow Tracking Server merupakan solusi terbaik untuk kolaborasi tim dan proyek berskala besar dengan integrasi cloud dan skalabilitas tinggi. Perhatikan tabel berikut sebagai rekap perbedaan ketiga pilihan tersebut.

| Setup | Lokasi Metadata | Lokasi Artefak | Kolaborasi | Skala Proyek |

|---|---|---|---|---|

| Localhost (Default) | mlruns/ (lokal) | mlruns / (lokal) | Tidak mendukung | Eksperimen individu atau proyek kecil |

| Local Tracking with Local Database | Database lokal (SQLite/MySQL) | Direktori lokal | Terbatas | Proyek dengan data terstruktur |

| Remote Tracking Server | Database remote (PostgreSQL/MySQL) | Cloud storage atau remote | Mendukung | Proyek tim besar atau enterprise |

Jadi, silakan sesuaikan dengan kebutuhan Anda. Sebagai informasi, pada kelas ini, kita hanya akan menggunakan pengaturan localhost, ya.

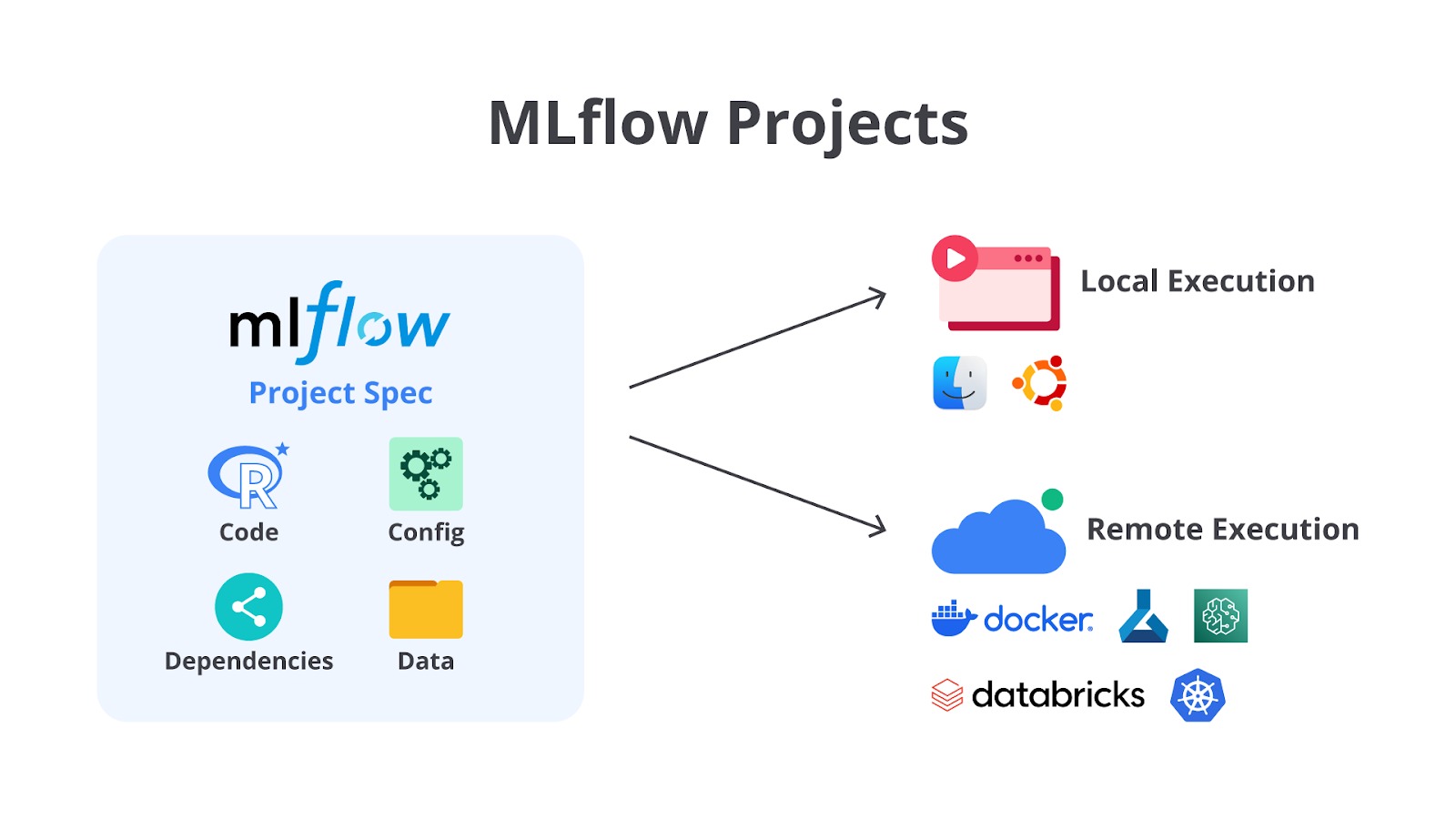

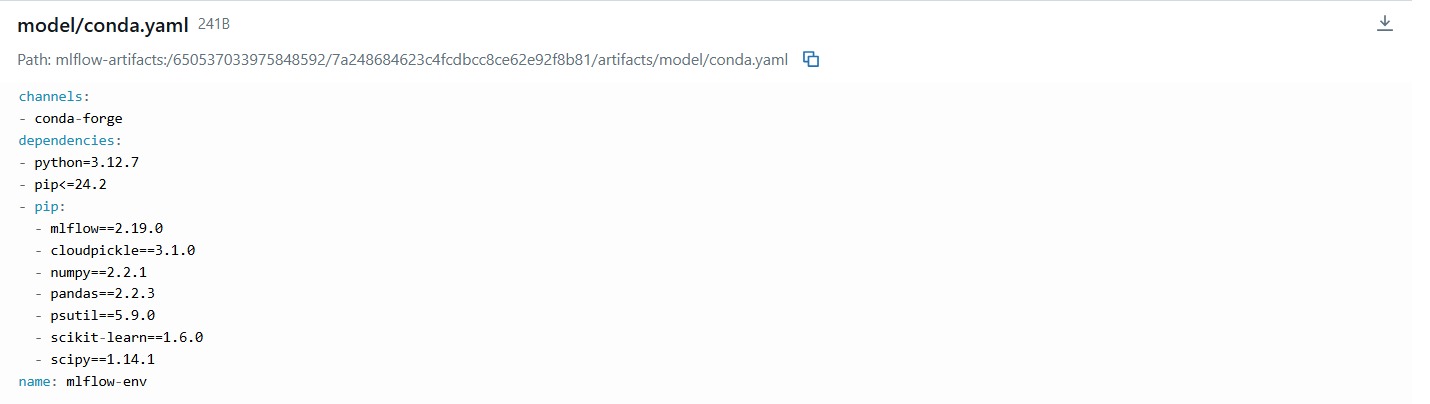

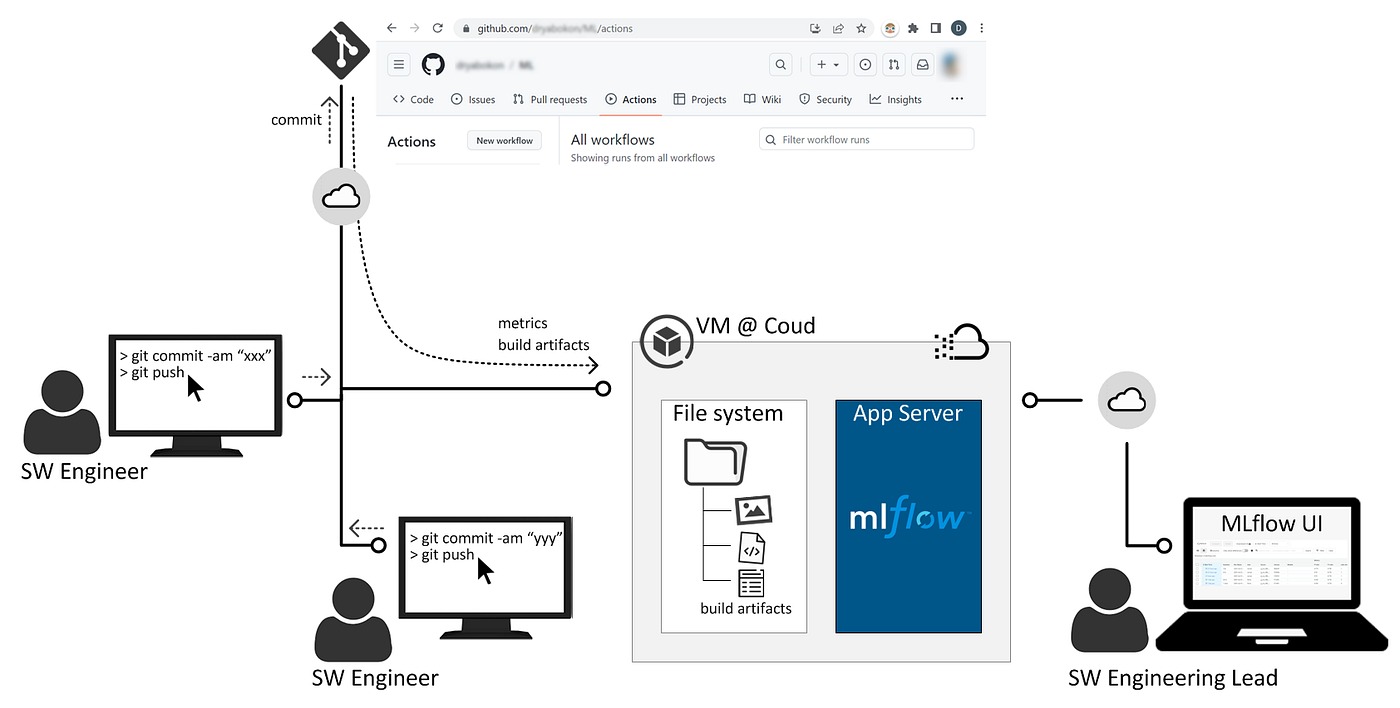

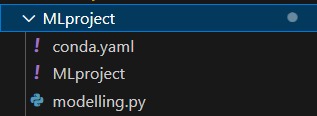

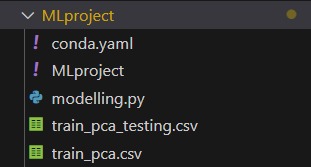

MLflow Project

Bayangkan Anda telah melakukan serangkaian eksperimen machine learning yang menarik dan ingin membagikannya kepada kolega atau supervisor Anda. Anda juga telah menggunakan MLflow Tracking untuk mencatat semua detail penting dan MLflow Tracking UI untuk menganalisis hasilnya.

Namun, bagaimana kita membungkus semua kode, dependensi, dan konfigurasi tersebut agar orang lain dapat dengan mudah menjalankannya kembali? Apakah kita perlu menjalankan semua tahapannya dari nol? Tenang saja, di sinilah MLflow Projects berperan sebagai sebuah solusi yang sangat membantu.